CycleGAN 是如何工作的?

一、说明

????????CycleGAN即循环对抗网络,是图像翻译成图像的模型;是Pix2Pix模型的扩展,区别在于,Pix2Pix模型需要输入图像和目标图像成对给出训练,CycleGAN则不需要,例如:从 SAR 生成 RGB 图像、从 RGB 生成多光谱图像、从卫星图像生成地图路线等,并且在训练中需要反向逆训练,因此称为循环Gan。

二、介绍

????????CycleGAN 是图像到图像的翻译模型,就像Pix2Pix一样。Pix2Pix模型面临的主要挑战是训练所需的数据应该配对,即源域和目标域的图像应该位于相同的位置,并且两个域的图像数量也应该相同。

????????循环生成对抗网络(CycleGAN)是一种训练深度卷积神经网络以执行图像到图像翻译任务的方法。网络使用不成对的数据集学习输入和输出图像之间的映射。例如:从 SAR 生成 RGB 图像、从 RGB 生成多光谱图像、从卫星图像生成地图路线等。

????????该模型是 Pix2Pix 架构的扩展,涉及两个生成器模型和两个判别器模型的同时训练。除了 Pix2Pix 的功能之外,我们还可以使用不配对的数据集,并且还可以使用相同的模型反向转换图像(目标到源图像)。

三、模型架构

图 1. CycleGAN 架构概述:从卫星图像转换到地图路线域 [3]

要了解 GAN 的基础知识,可以参考Pix2Pix 指南。

该模型架构由两个生成器模型组成:一个生成器(Generator-A)用于生成第一个域(Domain-A)的图像,第二个生成器(Generator-B)用于生成第二个域(Domain-B)的图像。

- 域-B ->生成器-A?-> 域-A

- 域-A ->生成器-B?-> 域-B

每个生成器都有一个相应的判别器模型(判别器-A 和判别器-B)。鉴别器模型从域中获取真实图像并从生成器中获取生成的图像来预测它们是真还是假。

- 域-A ->鉴别器-A?-> [真/假]

- 域-B -> 生成器-A ->判别器-A?-> [真/假]

- 域-B ->鉴别器-B?-> [真/假]

- 域-A -> 生成器-B ->判别器-B?-> [真/假]

在 中arcgis.learn,所有判别器和生成器都被分组为一个模型。

四、训练时loss是如何计算的?

????????用于训练生成器的损失由三部分组成:

- ????????对抗性损失:我们将对抗性损失应用于两个生成器,其中生成器尝试生成其域的图像,而其相应的判别器区分翻译样本和真实样本。生成器的目标是最小化这种损失,而相应的判别器则试图最大化这种损失。

- ????????循环一致性损失:它捕捉到了这样的直觉:如果我们将图像从一个域转换到另一个域并再次转换回来,我们应该到达我们开始的地方。因此,它计算原始图像和最终生成图像之间的 L1 损失,该图像应该看起来与原始图像相同。从两个方向进行计算:

- 正向循环一致性:域-B ->生成器-A?-> 域-A ->生成器-B?-> 域-B

- 后向循环一致性:Domain-A ->?Generator-B?-> Domain-B ->?Generator-A?-> Domain-A

- ????????身份丢失:它鼓励生成器保留输入和输出之间的颜色成分。这是通过向生成器提供目标域的图像作为输入并计算输入和生成图像之间的 L1 损失来完成的。

* Domain-A -> **Generator-A** -> Domain-A

* Domain-B -> **Generator-B** -> Domain-B

????????由于所有这些损失函数在获得高质量结果方面都发挥着关键作用。因此,这两个生成器模型都是通过所有这些损失函数的组合来优化的。

五、实施于arcgis.learn

????????首先,我们必须使用arcgis pro中的格式导出图像芯片,然后使用中的函数Export Tiles创建一个databunchprepare_dataarcgis.learn

data = arcgis.learn.prepare_data(path=r"path/to/exported/data", dataset_type='CycleGAN')

????????要传递的重要参数是:

- 到

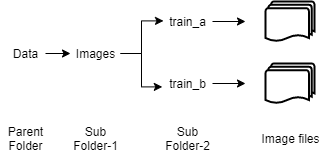

path数据目录。我们需要遵循图2所示的目录结构。这里,“train_a”和“train_b”文件夹包含域A和B的图像。

图 2. 目录结构

- 为

dataset_type“CycleGAN”。

????????创建数据束后,我们可以通过调用初始化 CycleGAN 对象

cyclegan_model = arcgis.learn.CycleGAN(data)

????????与其他一些模型不同,我们从头开始训练 CycleGAN,某些初始时期的学习率为 0.0002,然后在下一个时期将学习率线性衰减到零。

????????然后我们可以继续基本的 arcgis.learn 工作流程。有关 API 和模型的更多信息,请访问API 参考。

参考

[1] Jun-Yan Zhu,Taesung Park,Phillip Isola,Alexei A. Efros,“使用循环一致对抗网络的不配对图像到图像翻译”,2017;arXiv:1703.10593。

[2] Jason Brownlee:Cyclegan 教程。访问日期:2020 年 9 月 29 日。

[3]。康宇豪、高松和罗伯特·E·罗斯。“使用生成对抗网络传输多尺度地图样式。”?国际制图杂志 5,no。2-3(2019):115-141。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- mysql原理--redo日志1

- 1265 蓝桥杯 排序 简单

- Lunule: An Agile and Judicious Metadata Load Balancer for CephFS——论文泛读

- 公司防泄密软件监控员工哪些行为?

- PT:报告unconstrained path

- Halcon区域的最大、最小灰度值min_max _gray

- 动手学深度学习-自然语言处理-预训练

- 新品发布 | 思腾合力深思系列IW2235-2GR GPU服务器

- kubeadm来快速搭建一个K8S集群

- Spark内核解析-部署模式解析8(六)