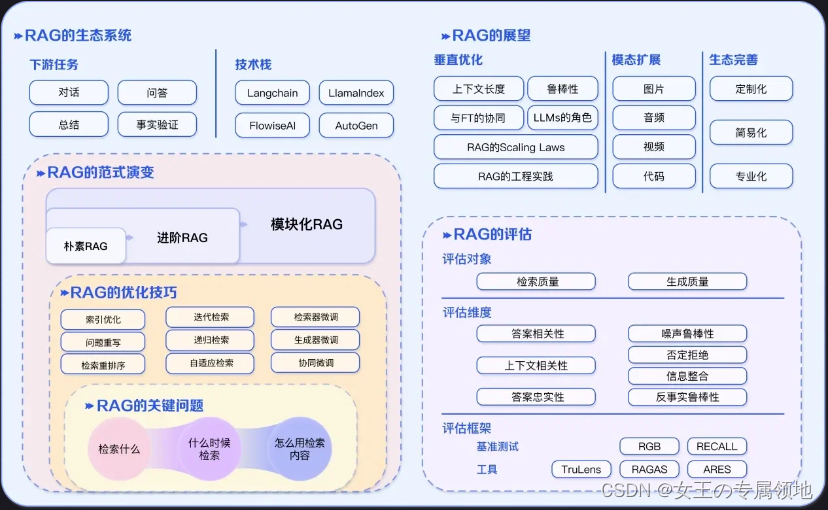

一文读懂「RAG,Retrieval-Augmented Generation」检索增强生成

Retrieval-Augmented Generation(RAG)作为机器学习和自然语言处理领域的一大创新,不仅代表了技术的进步,更在实际应用中展示了其惊人的潜力。

RAG结合了检索(Retrieval)和生成(Generation)两大核心技术,通过这种独特的混合机制,能够在处理复杂的查询和生成任务时,提供更加准确、丰富的信息。无论是在回答复杂的问题,还是在创作引人入胜的故事,RAG都展现了其不可小觑的能力。

一 、什么是RAG?

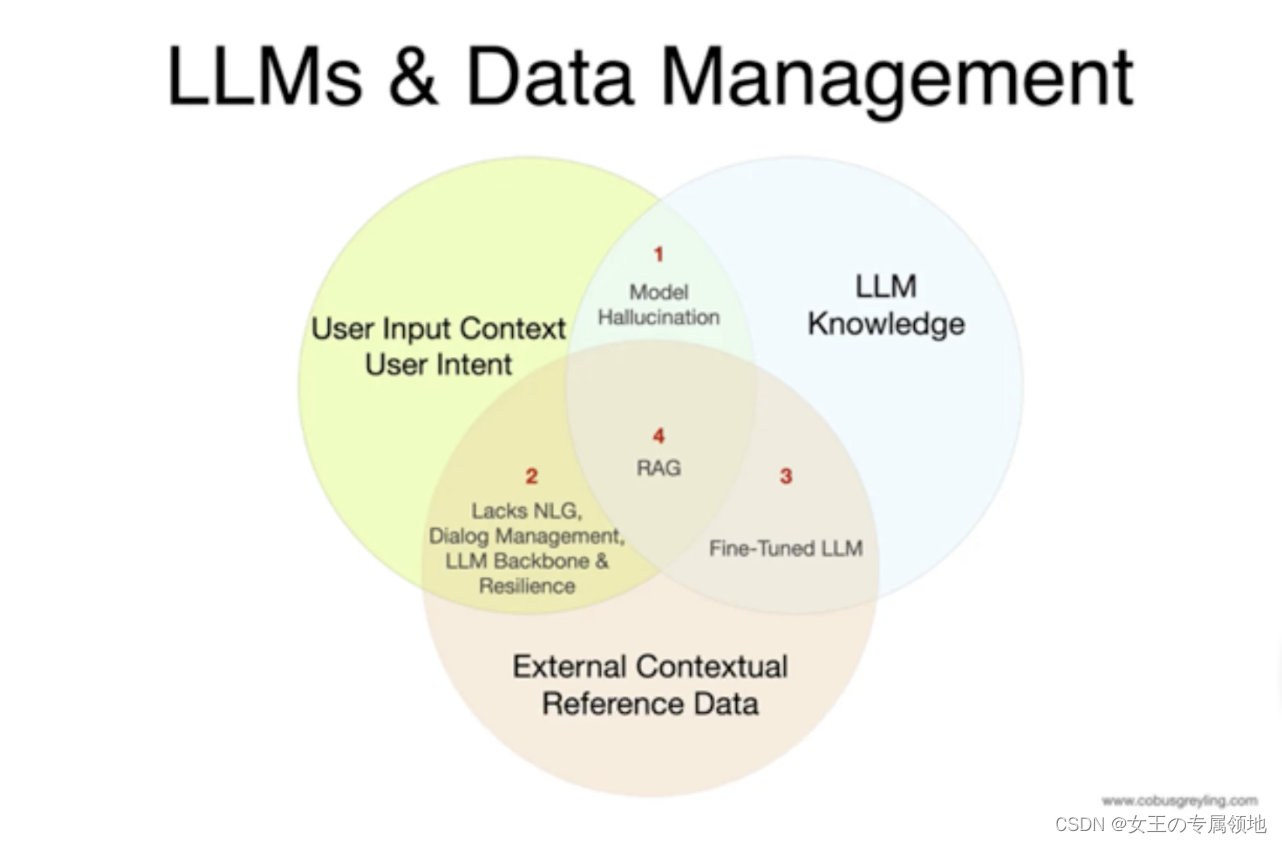

检索增强生成(Retrieval Augmented Generation),简称 RAG,已经成为当前最火热的LLM应用方案。它是一个为大模型提供外部知识源的概念,这使它们能够生成准确且符合上下文的答案,同时能够减少模型幻觉。

但是大模型应用于实际业务场景时会发现,通用的基础大模型基本无法满足我们的实际业务需求,主要有以下几方面原因:

- 知识的局限性:模型自身的知识完全源于它的训练数据,而现有的主流大模型(ChatGPT、文心一言、通义千问…)的训练集基本都是构建于网络公开的数据,对于一些实时性的、非公开的或离线的数据是无法获取到的,这部分知识也就无从具备。

- 幻觉问题:所有的AI模型的底层原理都是基于数学概率,其模型输出实质上是一系列数值运算,大模型也不例外,所以它有时候会一本正经地胡说八道,尤其是在大模型自身不具备某一方面的知识或不擅长的场景。而这种幻觉问题的区分是比较困难的,因为它要求使用者自身具备相应领域的知识。

数据安全性:对于企业来说,数据安全至关重要,没有企业愿意承担数据泄露的风险,将自身的私域数据上传第三方平台进行训练。这也导致完全依赖通用大模型自身能力的应用方案不得不在数据安全和效果方面进行取舍。

而RAG是解决上述问题的一套有效方案。

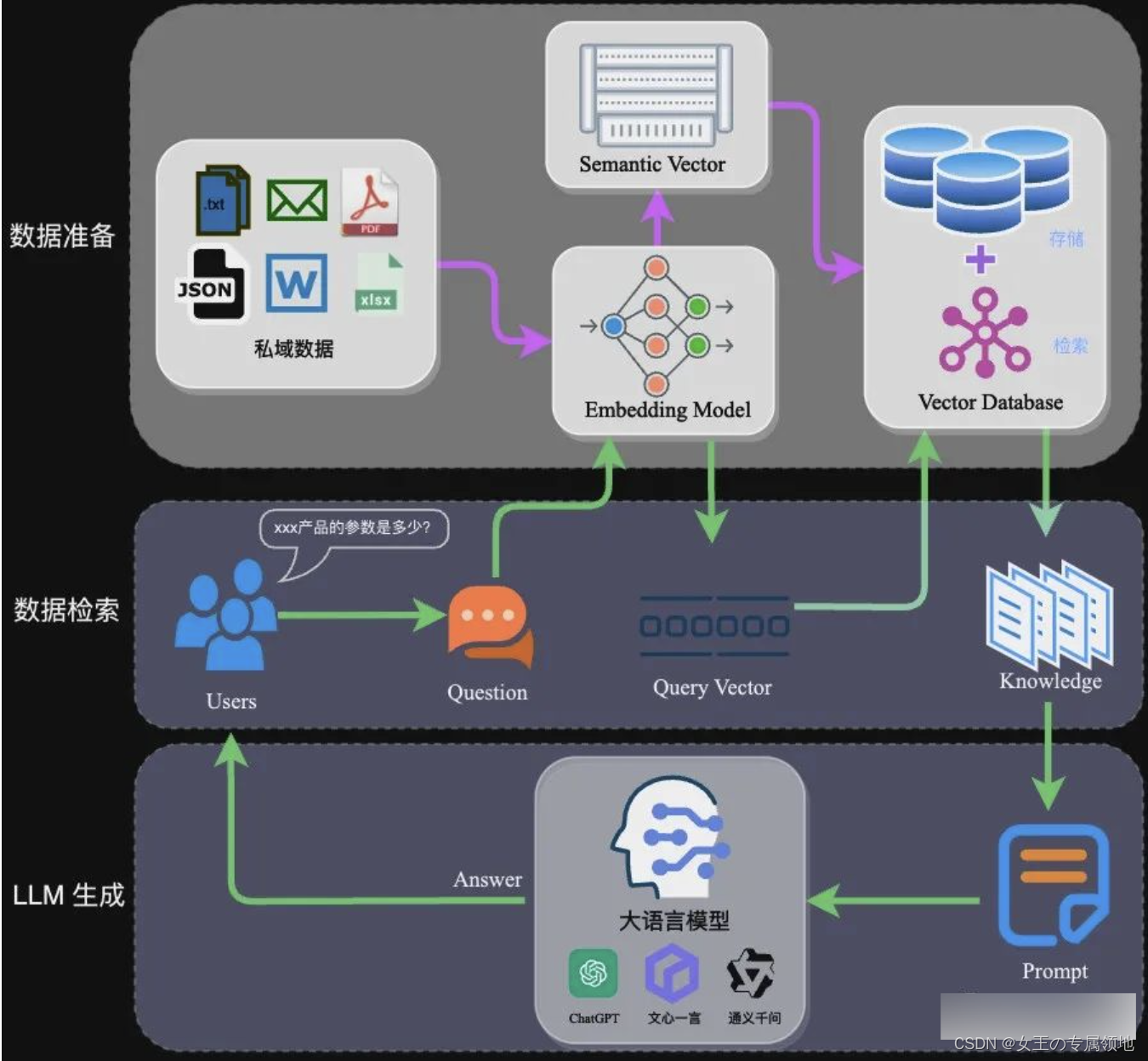

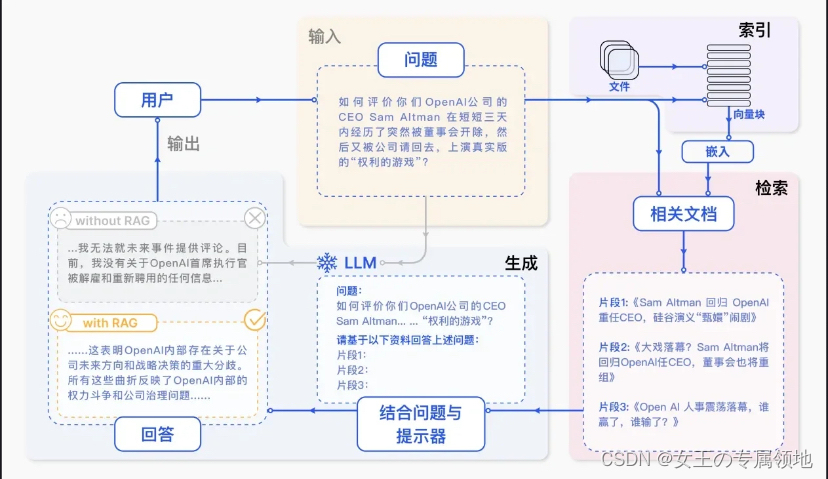

二、结构

简单来讲,RAG就是通过检索获取相关的知识并将其融入Prompt,让大模型能够参考相应的知识从而给出合理回答。因此,可以将RAG的核心理解为“检索+生成”,前者主要是利用向量数据库的高效存储和检索能力,召回目标知识;后者则是利用大模型和Prompt工程,将召回的知识合理利用,生成目标答案。

完整的RAG应用流程主要包含两个阶段:

- 数据准备阶段:数据提取—>文本分割——>向量化(embedding)——>数据入库

- 应用阶段:用户提问——>数据检索(召回)——>注入Prompt——>LLM生成答案

下面我们详细介绍一下各环节的技术细节和注意事项:

2.1 数据准备阶段:

数据准备一般是一个离线的过程,主要是将私域数据向量化后构建索引并存入数据库的过程。主要包括:数据提取、文本分割、向量化、数据入库等环节。

数据提取

-

数据加载:包括多格式数据加载、不同数据源获取等,根据数据自身情况,将数据处理为同一个范式。

-

数据处理:包括数据过滤、压缩、格式化等。

-

元数据获取:提取数据中关键信息,例如文件名、Title、时间等 。

文本分割:

文本分割主要考虑两个因素:

1)embedding模型的Tokens限制情况;

2)语义完整性对整体的检索效果的影响。

一些常见的文本分割方式如下:

-

句分割:以”句”的粒度进行切分,保留一个句子的完整语义。常见切分符包括:句号、感叹号、问号、换行符等。

-

固定长度分割:根据embedding模型的token长度限制,将文本分割为固定长度(例如256/512个tokens),这种切分方式会损失很多语义信息,一般通过在头尾增加一定冗余量来缓解。

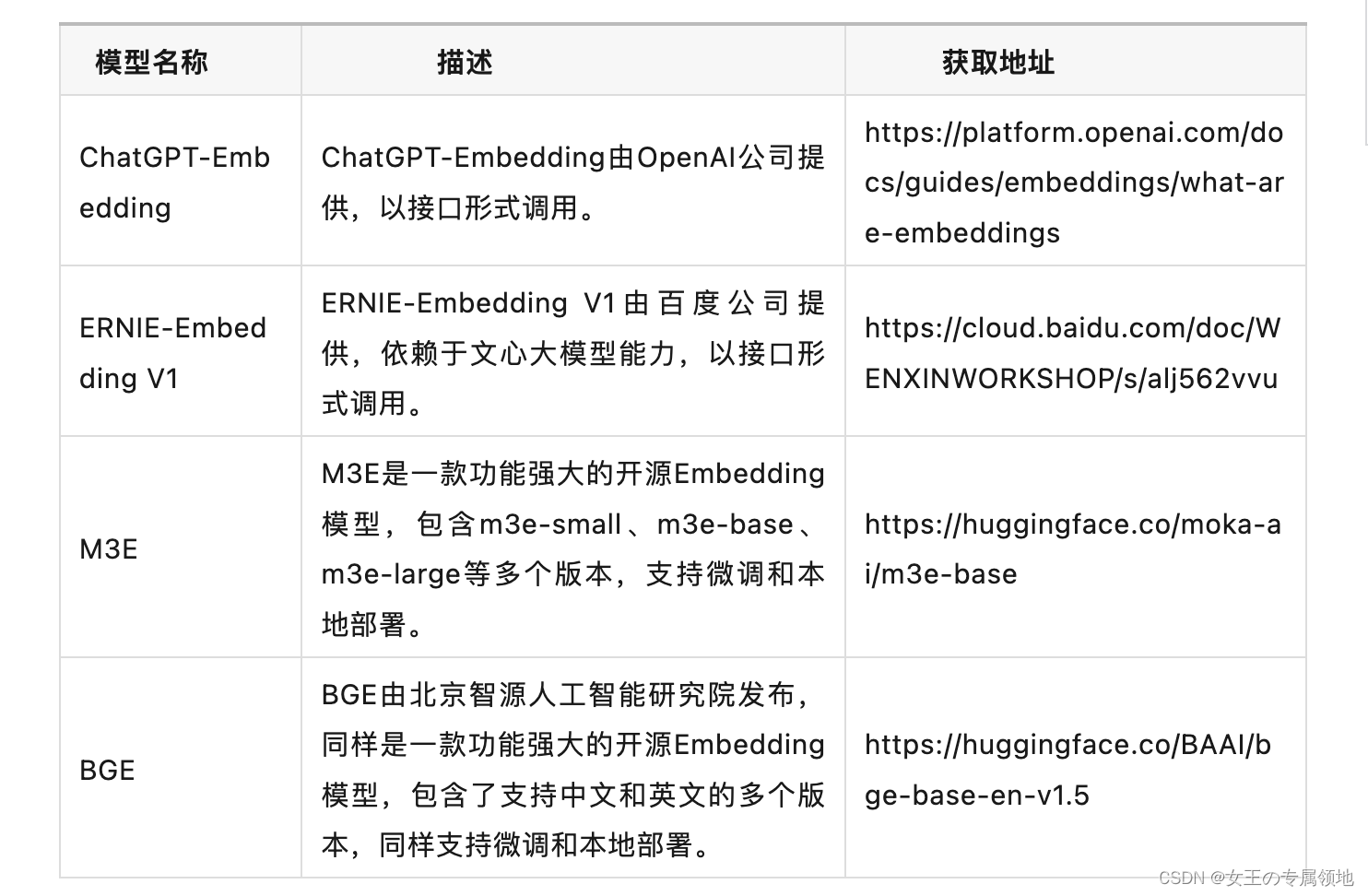

向量化(embedding):

向量化是一个将文本数据转化为向量矩阵的过程,该过程会直接影响到后续检索的效果。目前常见的embedding模型如表中所示,这些embedding模型基本能满足大部分需求,但对于特殊场景(例如涉及一些罕见专有词或字等)或者想进一步优化效果,则可以选择开源Embedding模型微调或直接训练适合自己场景的Embedding模型。

数据入库:

数据向量化后构建索引,并写入数据库的过程可以概述为数据入库过程,适用于RAG场景的数据库包括:FAISS、Chromadb、ES、milvus等。一般可以根据业务场景、硬件、性能需求等多因素综合考虑,选择合适的数据库。

2.2 应用阶段

在应用阶段,我们根据用户的提问,通过高效的检索方法,召回与提问最相关的知识,并融入Prompt;大模型参考当前提问和相关知识,生成相应的答案。关键环节包括:数据检索、注入Prompt等。

数据检索

常见的数据检索方法包括:相似性检索、全文检索等,根据检索效果,一般可以选择多种检索方式融合,提升召回率。

-

相似性检索:即计算查询向量与所有存储向量的相似性得分,返回得分高的记录。常见的相似性计算方法包括:余弦相似性、欧氏距离、曼哈顿距离等。

-

全文检索:全文检索是一种比较经典的检索方式,在数据存入时,通过关键词构建倒排索引;在检索时,通过关键词进行全文检索,找到对应的记录。

注入Prompt

Prompt作为大模型的直接输入,是影响模型输出准确率的关键因素之一。在RAG场景中,Prompt一般包括任务描述、背景知识(检索得到)、任务指令(一般是用户提问)等,根据任务场景和大模型性能,也可以在Prompt中适当加入其他指令优化大模型的输出。一个简单知识问答场景的Prompt如下所示:

【任务描述】 假如你是一个专业的客服机器人,请参考【背景知识】,回 【背景知识】 {content} // 数据检索得到的相关文本 【问题】

石头扫地机器人P10的续航时间是多久?

Prompt的设计只有方法、没有语法,比较依赖于个人经验,在实际应用过程中,往往需要根据大模型的实际输出进行针对性的Prompt调优。

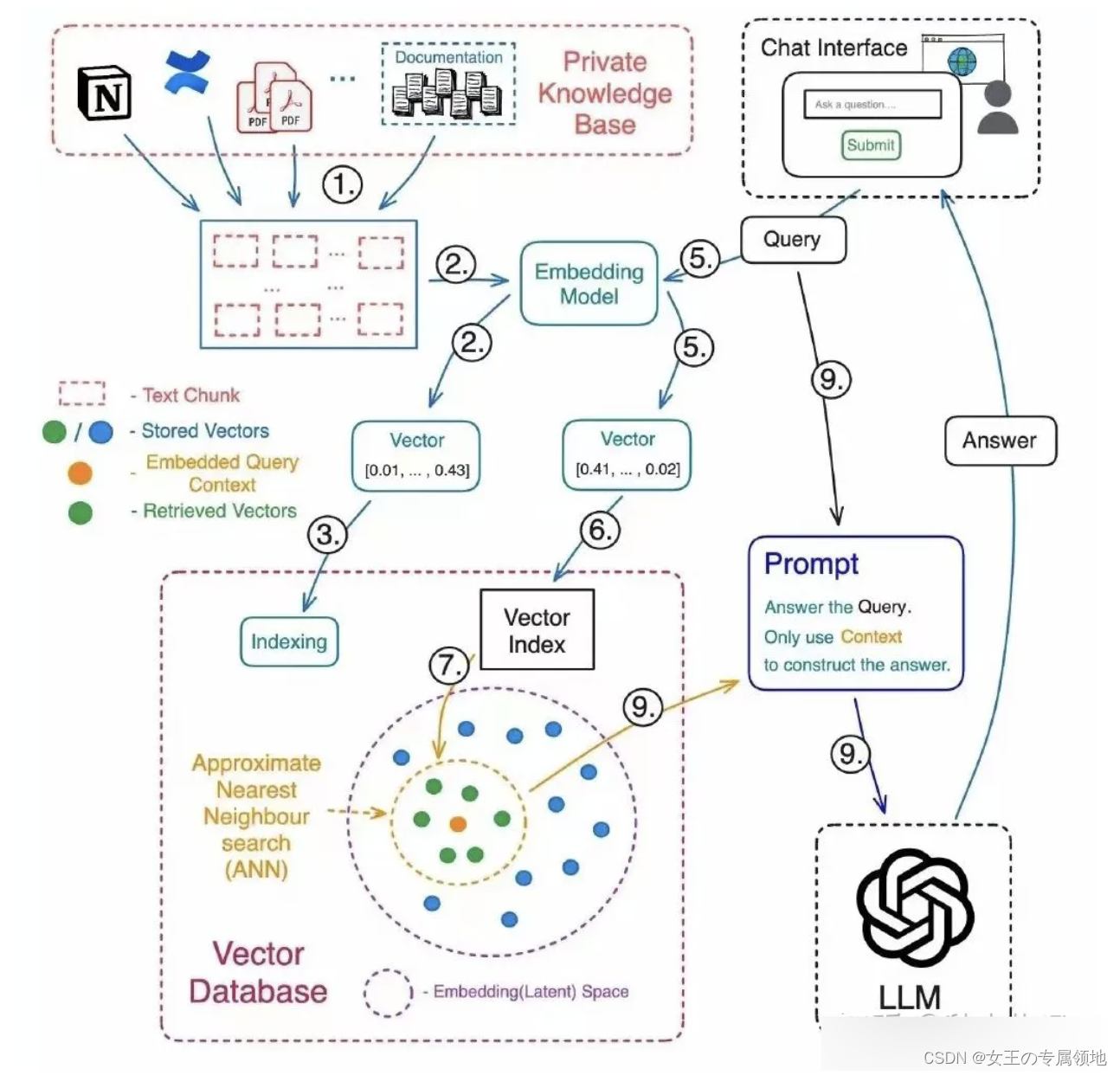

三、执行流程

索引生成部分

-

文档处理:将私有知识库中的文档转换成可以处理的文本块。

-

嵌入模型:使用嵌入模型(如BERT、GPT等)将文本块转换成向量。

-

索引:创建文本块向量的索引,以便能够快速检索。

-

数据库:嵌入向量被存储在一个向量数据库中,通常使用近似最近邻(ANN)搜索来优化检索速度。

用户问答部分

-

查询:用户在聊天界面输入查询。

-

查询嵌入:查询也被转换成向量,以便与文档的嵌入向量进行比较。

-

检索向量:查询的向量在向量索引中被用来找出最相近的文本块向量,最相近的文本块向量代表了与用户查询最相关的知识片段。

-

提示和回答:生成模型(LLM)接收到用户的查询和检索到的知识片段,然后生成回答。这个回答既包含了用户查询的上下文,也融合了从知识库中检索到的信息。

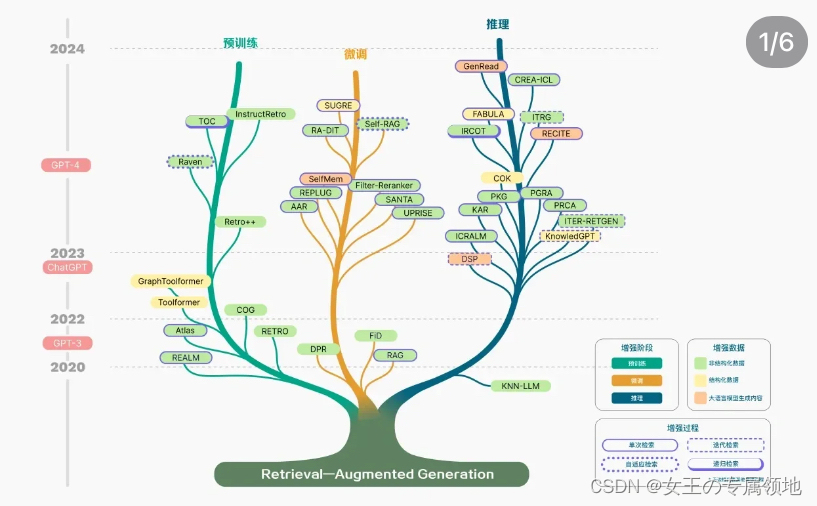

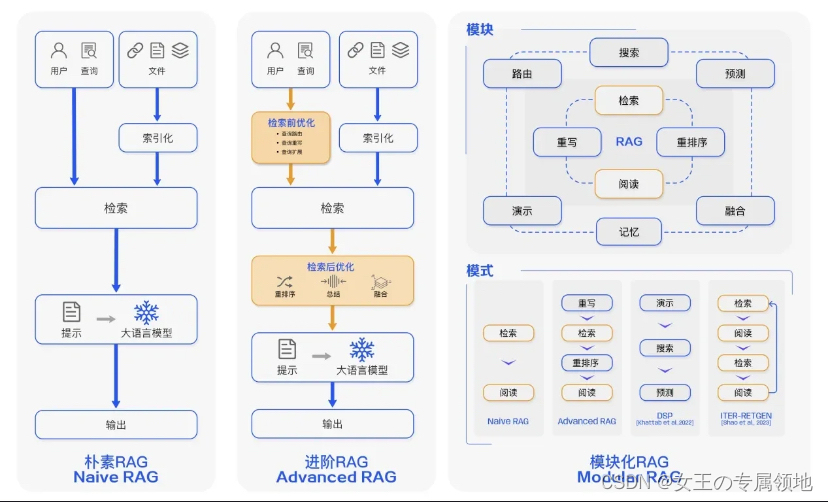

四、分类

五、作用

1. 保持知识更新

将大型语言模型(LLM)如ChatGPT配备能够随时查阅最新资讯的能力,就好比为它安装了一对能够观察现实世界的“眼睛”。这种能力的增加不仅极大地扩展了模型的知识范围,还提高了其与现实世界同步的能力,让它能够更有效地参与到关于时事的对话中。

2. 提供专业知识

如果你的问题涉及特定的专业领域,RAG就像一个熟练的图书管理员,它不仅掌握着大量的专业书籍,还能够迅速而准确地从这些书籍中找到与你的问题最相关的答案。这样的能力使得RAG在处理复杂和专业性问题时表现出色。

3. 私有知识的安全

随着人工智能的发展,数据安全成为了企业关注的重点。对于企业而言,将长期累积的独有的知识库、敏感的经营数据、合同文件等机密信息上传到互联网上的大型模型可能会带来安全风险。在这种背景下,RAG技术提供了一种有效的解决方案。

4. 增加可信度

RAG赋予机器人在回答问题时提供信息来源的能力,这是一个重要的特性。当你向机器人提问时,它不仅能给出答案,还能明确告诉你这些答案是基于哪些资料或数据得出的。这种透明度极大地增加了机器人提供的信息的可信度,并帮助用户区分信息的真实性和准确性。

5. 减少大模型LLM的“幻觉”

大型语言模型(如GPT系列)在生成文本时偶尔出现的“幻觉”(hallucination)现象,是由于模型在处理特定查询时,可能会生成不准确、不相关或虚构的信息。这种现象往往发生在模型对于回答问题所需的知识不了解或不熟悉的情况下。RAG的出现,通过利用外部知识源,可以有效地弥补这一缺陷。

六、面临的挑战

RAG在实施过程中确实面临着多项挑战,其中包括嵌入质量、性能优化和上下文理解。这些难点不仅关系到RAG系统的效率,还直接影响到最终生成文本的准确性和可用性。

1. 提升嵌入的质量

将外部知识源转换为向量时,需要保证嵌入(embedding)的高质量至关重要,这一过程对于提高查询与知识库信息匹配的准确性至关重要。技术上,这要求嵌入能够捕获和保留文本的深层语义特征,包括上下文关系和词汇间的微妙联系。

此外,为了避免训练过程中的数据偏见,需要用到平衡和多样化的数据集。只有这样,通过嵌入生成的向量才能真正代表原始文本的意图和内容,从而在查询时提供更准确、更相关的结果。

2. 查找精确知识的挑战

从外部知识源中准确地查找与当前问题最匹配的知识是一个复杂的挑战。这要求大模型LLM能够深入理解用户查询的真实意图,同时利用高效的检索算法在庞大的数据集中快速定位相关信息。此外,确保检索结果的相关性和质量,以及处理大量数据的能力,也是这一挑战的关键部分。同时,系统还需要适应模糊或复杂的查询,并保持知识库的时效性和准确性。

3. 上下文内容的理解

上下文理解是一个核心挑战,要求生成模型不仅深入理解检索到的上下文信息,包括其隐含含义和语境;

在理解检索到的内容后,挑战在于如何将这些信息与原始查询请求以及模型已有的知识库相结合。这要求模型能够在回答生成过程中,不仅准确地引用检索信息,还要保证信息的连贯性和逻辑性。

上下文理解的挑战要求RAG在处理和生成回答时,能够展现出高度的理解能力和灵活的信息整合能力。这对于提升回答的质量和用户满意度至关重要。

七、应用场景

RAG在未来的应用前景非常广阔,几乎覆盖了所有企业和行业。这是因为RAG能够结合大型语言模型的强大处理能力和企业或行业自身独有的知识体系,从而制定出行业或企业专属的AI解决方案。无论是金融、医疗、法律、教育,还是零售、制造、娱乐等行业,企业都可以利用RAG技术构建专门的小型模型,以满足特定的业务需求。

1. 医疗行业

在医疗领域,RAG可以被用作临床决策支持工具。通过结合医学数据库和研究论文,RAG能够帮助医生快速获得关于疾病诊断、治疗方案和药物信息的最新研究。例如,对于罕见病的诊断,RAG可以通过检索最新的医学文献和病例报告,提供可能的诊断建议和治疗方法。

2. 法律行业

在法律行业,RAG可以辅助律师进行案例研究和提供法律咨询。通过访问法律数据库和历史案例,RAG能够帮助律师找到相关的法律先例和法规,从而提高案件分析的效率和准确性。这对于处理复杂的法律问题,如知识产权纠纷或国际法案,尤为有用。

3. 教育领域

在教育领域,RAG可以作为学习资源和研究辅助工具。教师和学生可以利用RAG快速访问大量的教育资料、学术论文和案例研究,从而丰富教学内容和加深学习理解。例如,学生在准备论文时,可以用RAG来查找相关的研究工作和理论框架。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!