【airsim】两分钟,用python脚本获取虚拟数据集

发布时间:2024年01月07日

现有的教程在配置基于python的airsim环境过程中,都要求执行完整的编译步骤。然而,在linux和windows上的编译过程中会遇到诸多问题,大概需要半天左右时间。

如果你只是想采集一些数据,测试一下虚拟数据的效果,那么解决这些bug所需要的时间非常不值得。

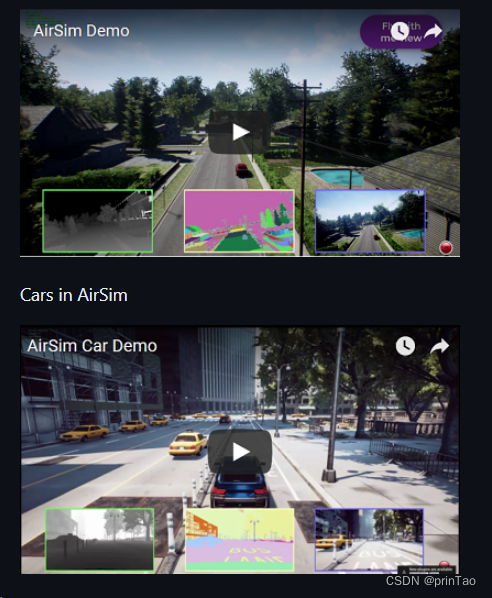

本文将从快速创建一个环境着手,分割、检测、去雾、深度估计、多传感器融合等方向的从业者可以快速采集一些数据,用于训练、测试自己的模型。

请注意,如果你是从传统深度学习时代入门的,你可能对于虚拟数据不屑一顾。但是我在目前的多个diffsion、Transformer模型的测试结果上看,虚拟数据集是非常有效的。

- 下载编译后的二进制模型,记住版本号。

- 创建conda环境,pip安装airsim。可以到pypi上查看版本号,注意匹配。

- 打开二进制模型,不要关闭。

- 使用airsim控制、采集数据。

具体python代码:

import airsim #pip install airsim

import numpy as np

import random

# for car use CarClient()

client = airsim.MultirotorClient()

png_image = client.simGetImage("0", airsim.ImageType.Scene)

# do something with image

responses = client.simGetImages([

# png format

airsim.ImageRequest(camera_name=0, image_type=airsim.ImageType.Scene, pixels_as_float=False, compress=True),

# uncompressed RGB array bytes

airsim.ImageRequest(0, airsim.ImageType.Infrared, pixels_as_float=False, compress=True),

# 深度视差图,每个像素值是浮点型

airsim.ImageRequest(0, airsim.ImageType.DisparityNormalized, pixels_as_float=False, compress=True),

# 深度视差图,每个像素值是浮点型

airsim.ImageRequest(0, airsim.ImageType.DepthPerspective, pixels_as_float=False, compress=True),

# 深度视差图,每个像素值是浮点型

airsim.ImageRequest(0, airsim.ImageType.DepthVis, pixels_as_float=False, compress=True),

# 深度视差图,每个像素值是浮点型

airsim.ImageRequest(0, airsim.ImageType.DepthPlanar, pixels_as_float=False, compress=True)

])

详细api参考官方文档。

例程:https://github.com/microsoft/AirSim/blob/main/PythonClient/airsim/client.py

如果pip安装无效,可以手动下载,本地安装。

文章来源:https://blog.csdn.net/prinTao/article/details/135436636

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 【无标题】

- 【JavaScript】面向对象

- Uniapp软件库源码-全新带勋章等

- MySQL表的约束

- 杨中科 EFCORE 第四部分 命令详解56-61

- 微信小程序(uniapp)api讲解

- 这 5 种 React 组件设计模式,请查收!

- 【JaveWeb教程】(12) 一篇文章教你轻松搞定IDEA集成Maven(最详细)

- CorelDRAW2024国内专业免激活版下载安装教程

- 有了 Prisma,就别用 TypeORM 了