书生·浦语大模型实战1

发布时间:2024年01月05日

书生·浦语大模型全链路开源体系

视频链接:书生·浦语大模型全链路开源体系_哔哩哔哩_bilibili

大模型之所以能收到这么高的关注度,一个重要原因是大模型是发展通用人工智能的重要途径

深度信念网络:

(1)又被称为贝叶斯网络,是一种有向无环图

(2)可以在任意叶子节点生成无偏的样本集合

(3)通过不断积累RBM(受限玻尔兹曼机)形成。每当一个RBM被训练完成时,其隐藏单元又可以作为后一层RBM的输入

(4)DBN的基本思想是允许每一次RBM模型接收数据的不同表示

书生 · 浦语大模型开源历程

书生 · 浦语大模型系列

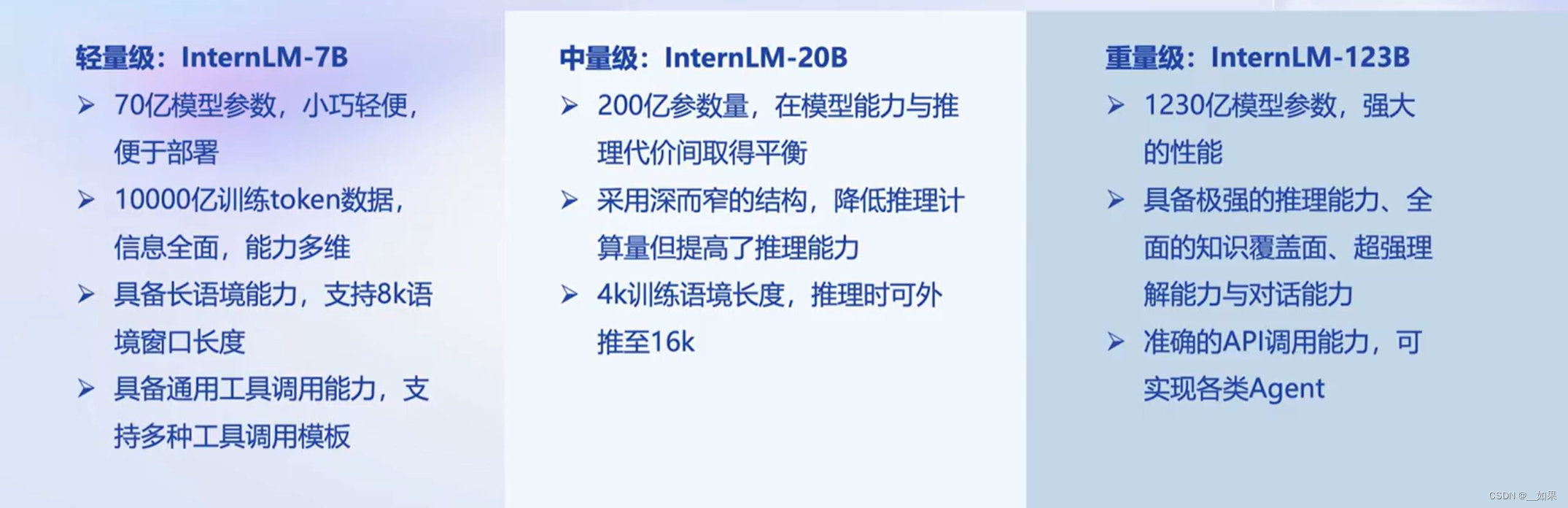

已经完成了覆盖轻量级、中量级、重量级的一套系列

InternLM-7B:方便部署,社区低成本可用最佳模型规模

InternLM-20B:商业场景可开发定制高精度,较小模型规模

InternLM-123B:通用大语言模型能力全面覆盖,千亿模型规模

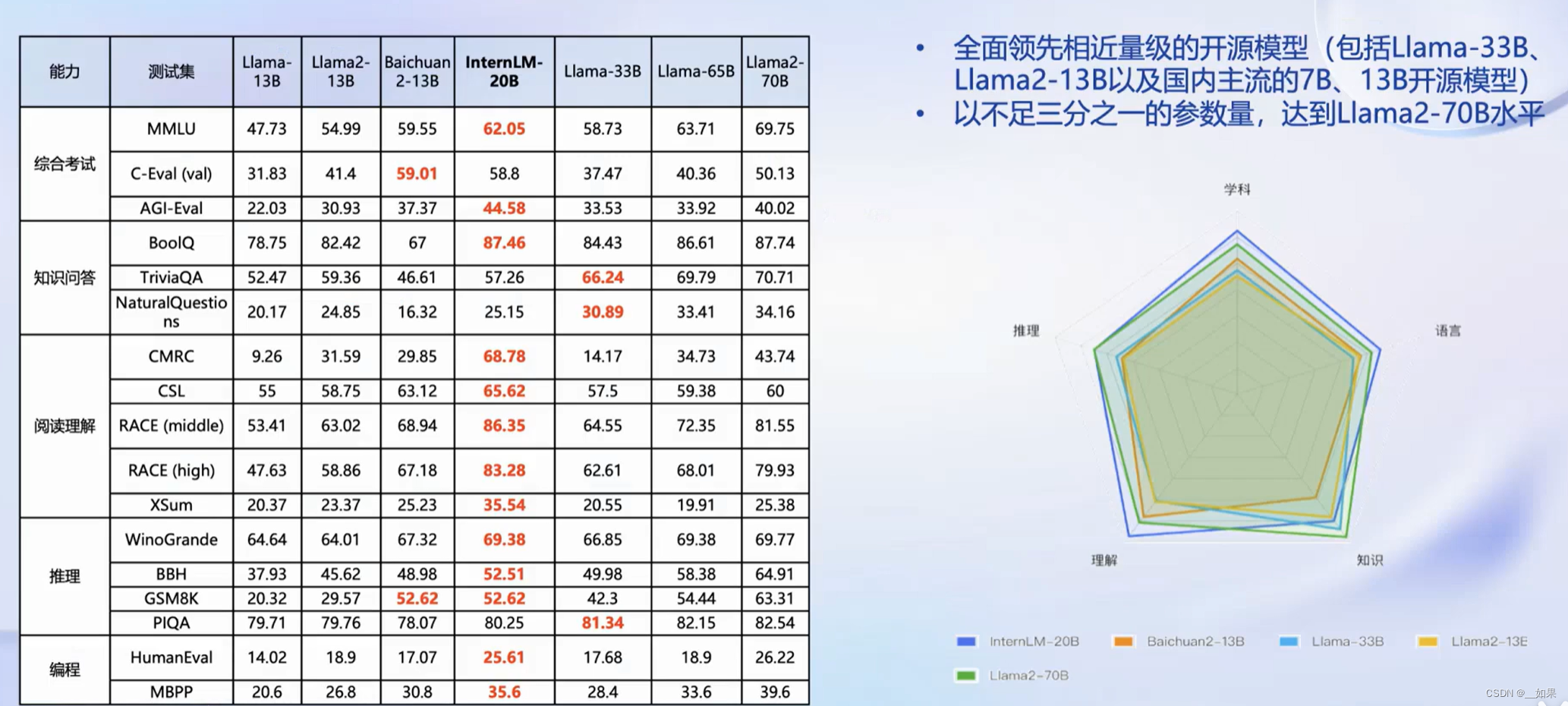

书生 · 浦语20B开源大模型性能

在综合考试、知识问答、阅读理解、推理、编程等任务中展现的能力都要超过相近量级的其他模型

值得一提的是InternLM-20B以不到三分之一的参数量,达到了Llama2-70B的水平,在很多数据集上能够接近甚至超越

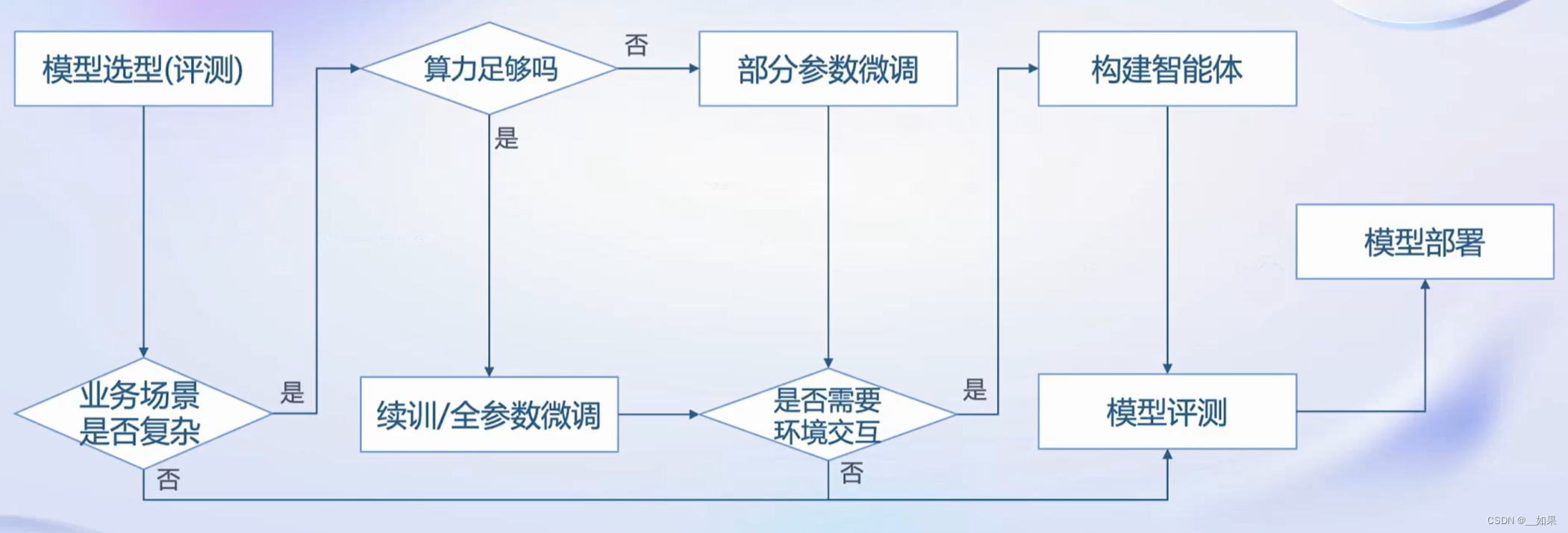

从模型到应用

这是一个比较典型的例子:

我们从开源社区提供的开源模型中关注模型的能力,比如在不同维度上的的能力、针对应用场景比较相关的能力

如果业务场景比较复杂,直接用开源模型可能没法满足需求,需要微调;如果业务场景比较简单,我们可以通过一些prompt engineering的方式,把模型接入到业务场景

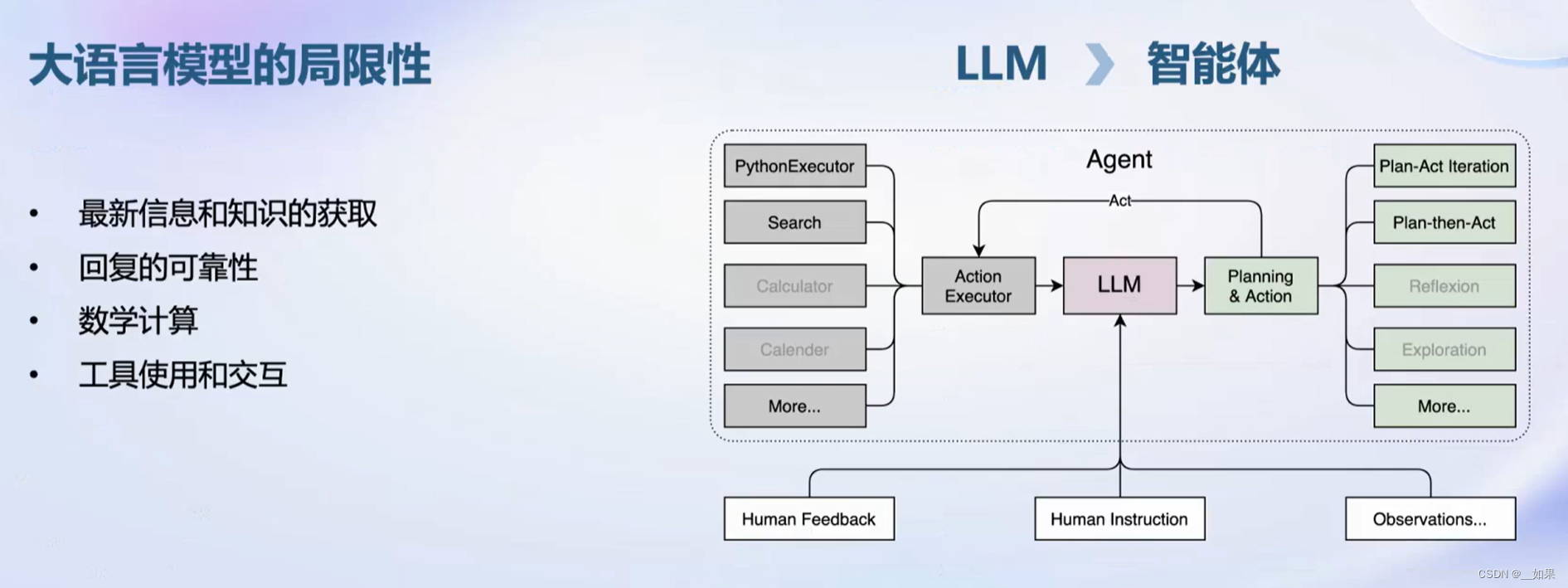

在某些业务场景中需要与外界环境交互,比如需要调用外部的一些API或者和已有的业务数据库进行交互,这时构建一个Agent在业务场景会有更好的表现

书生·浦语大模型全链路开源体系

针对模型到应用的过程,开源了书生·浦语大模型全链路开源体系

Lagent是一个轻量级的Agent搭建框架

AgentLego提供了供大模型调用的工具箱

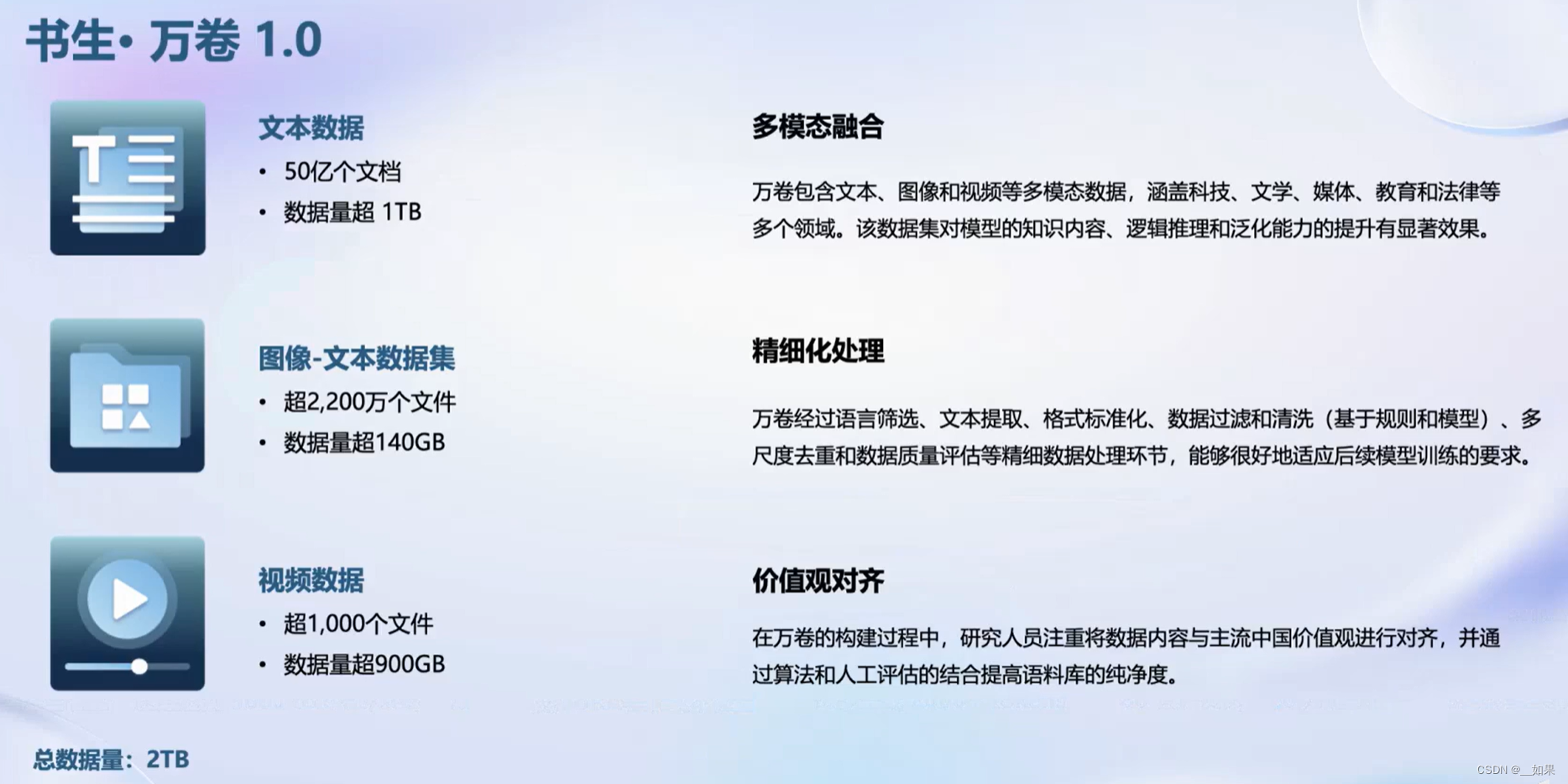

数据

预训练

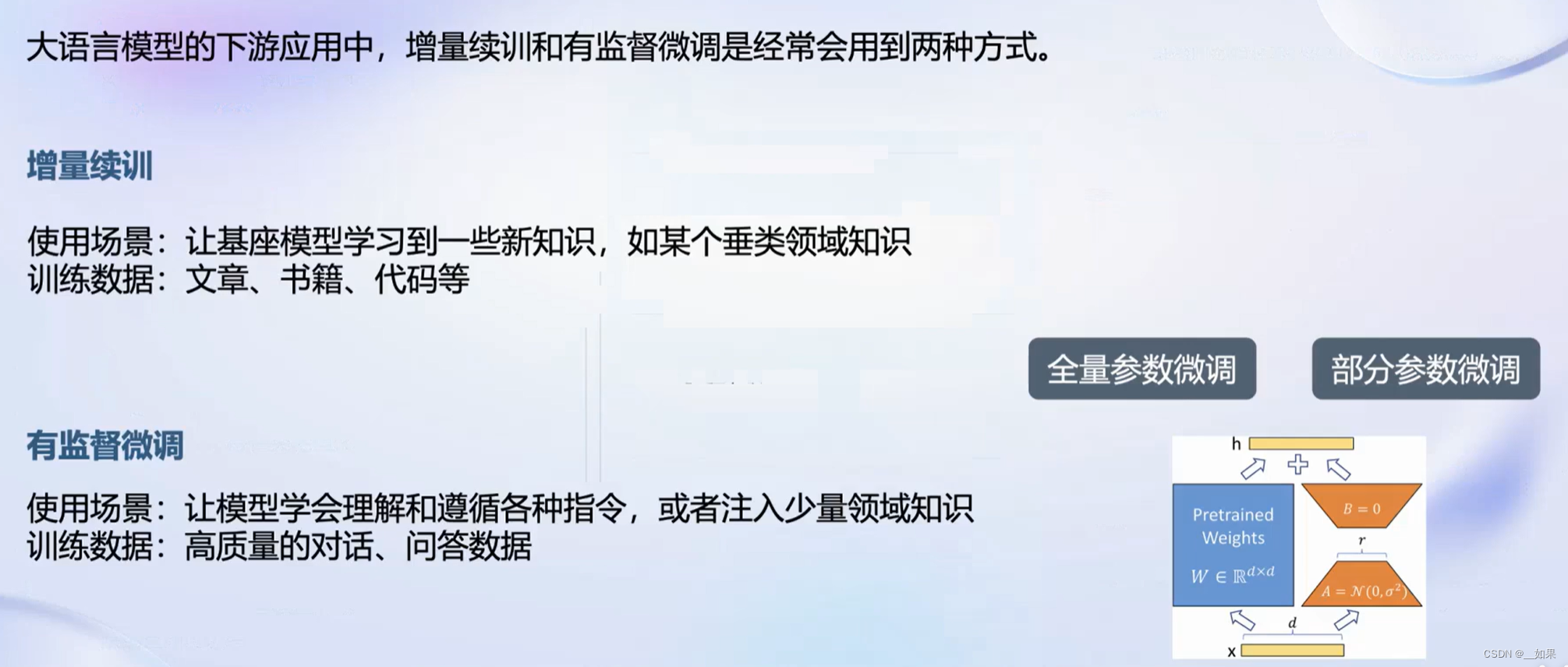

微调

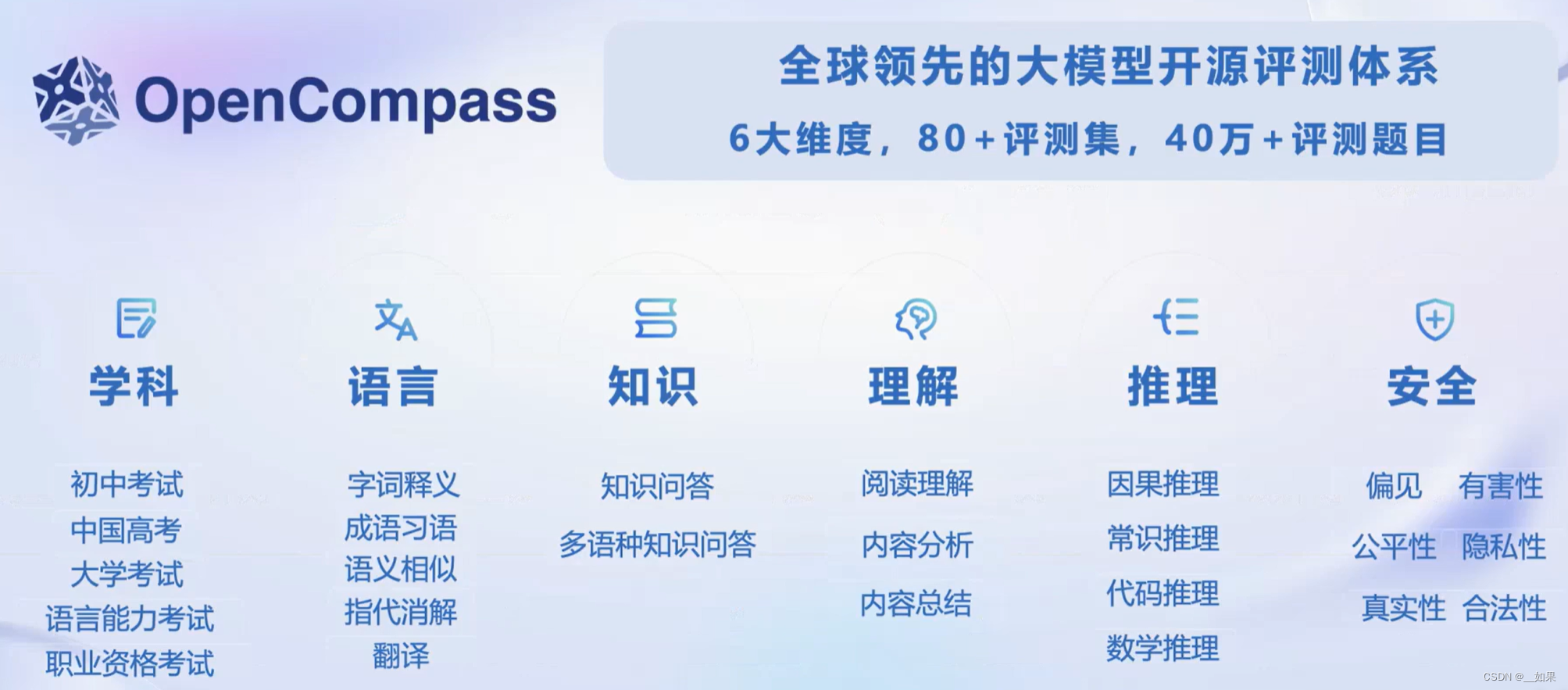

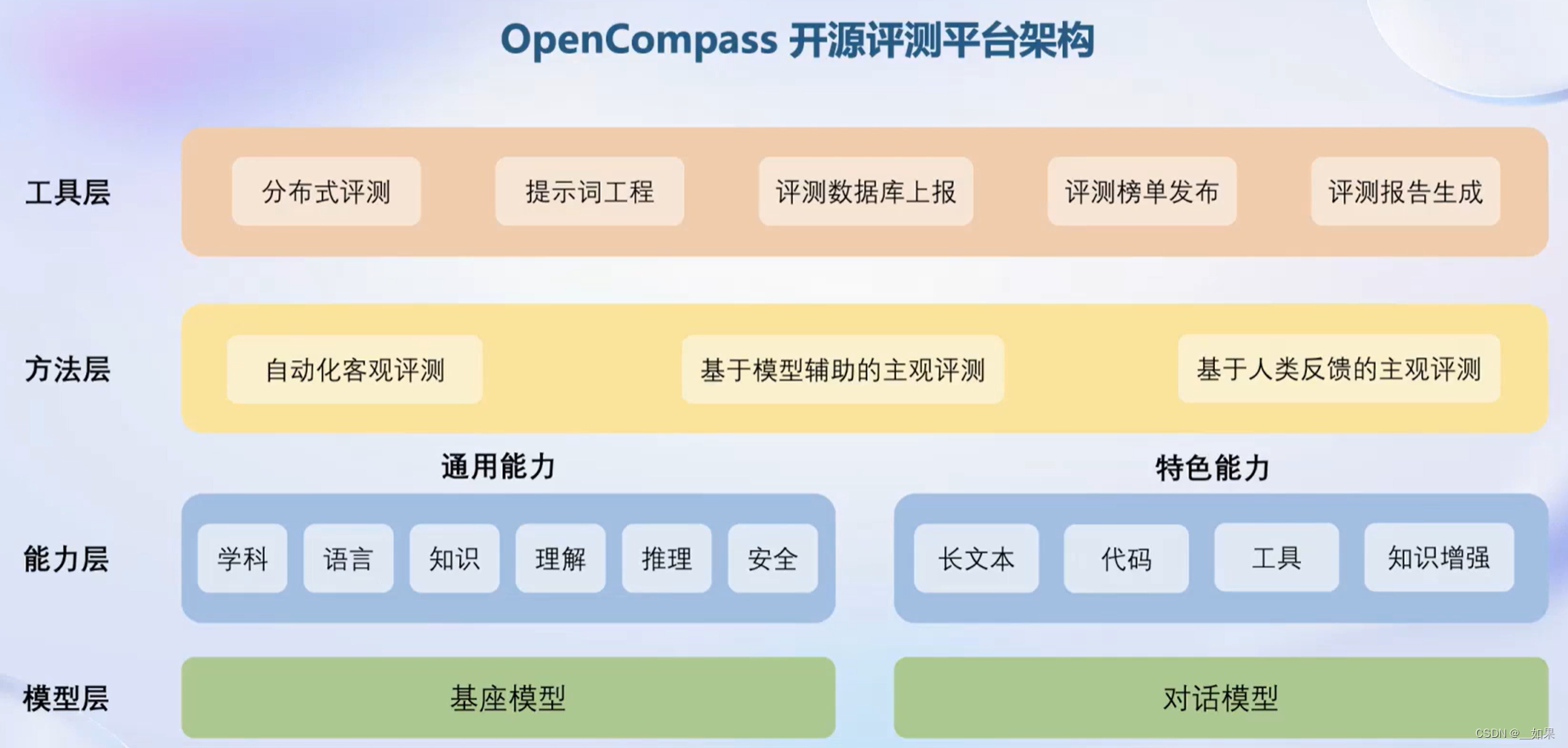

评测

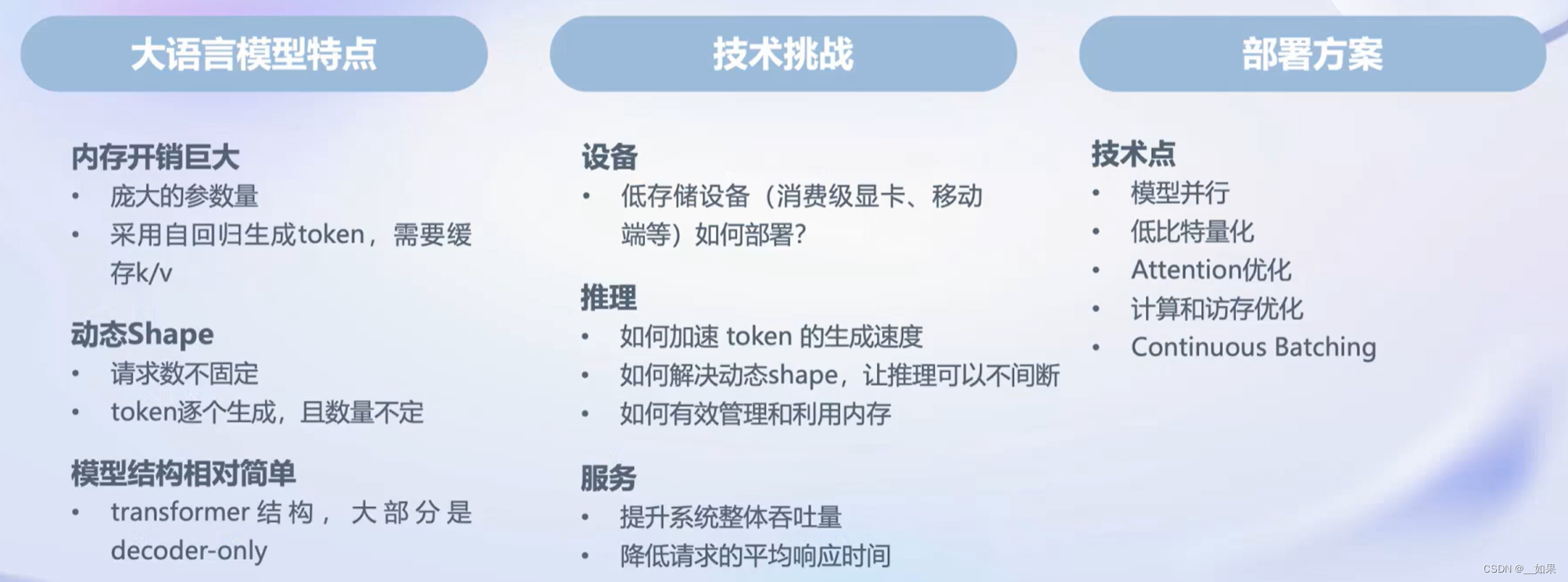

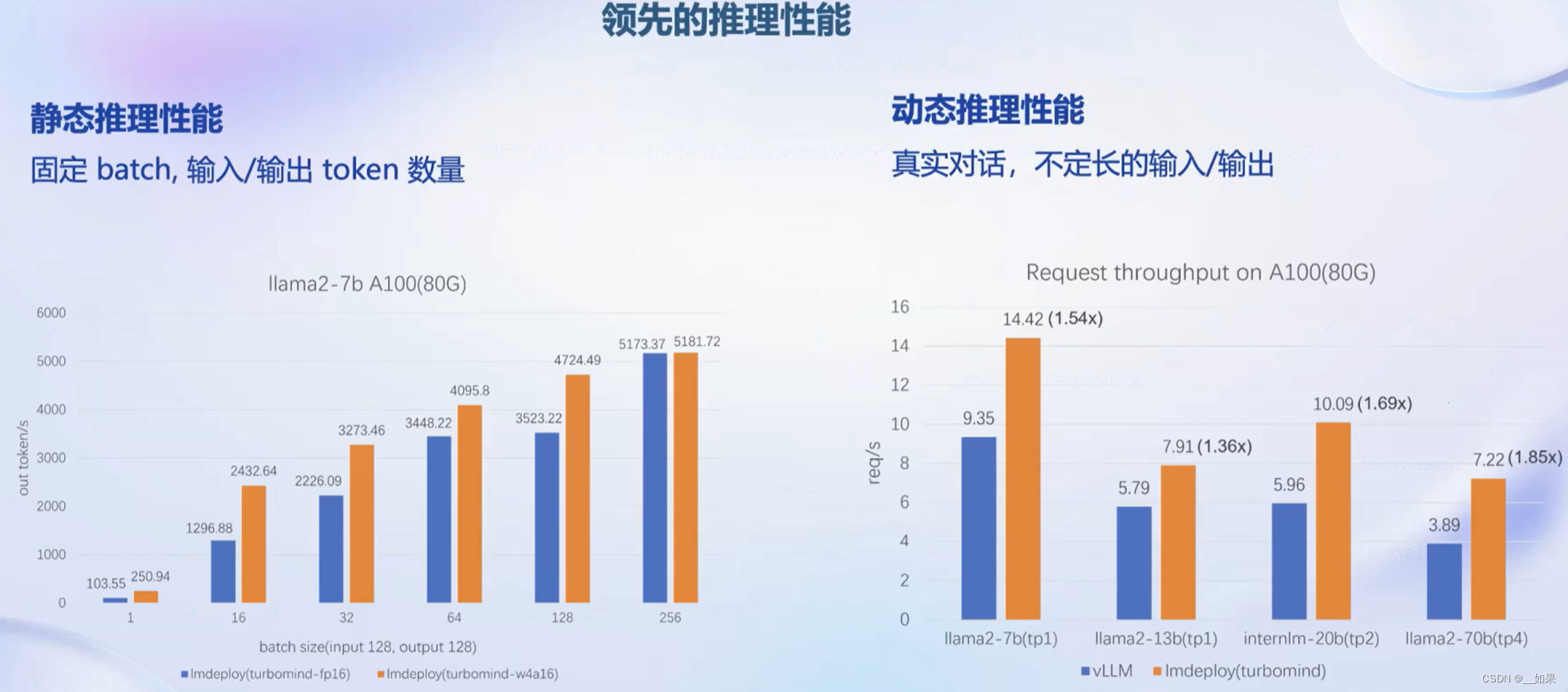

部署

智能体

文章来源:https://blog.csdn.net/m0_73202283/article/details/135405586

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- ElasticSearch之RestClient笔记

- 【wrf-python】批量读取多个nc文件中共同的变量并保存为csv文件

- 【起草】第二章 ChatGPT 的基本用法

- echarts的自定义图例的点击事件

- 字符串函数&&内存函数(从零到一)【C语言】

- AnyText多语言文字生成与编辑模型——让AI绘图自由添加精美文字

- 算法练习-删除链表倒数第n个节点(思路+流程图+代码)

- 【进阶KMP算法】nextval手算代码均有详解(每步配图)

- Go语言中的Select:深度解析与实战案例

- 常见的Webpack面试题及答案