【大模型知识库】(5):本地环境运行dity+fastchat的BGE模型,可以使用embedding接口对知识库进行向量化,连调成功。

发布时间:2023年12月19日

1,视频演示地址

2,关于 dify 项目

https://github.com/langgenius/dify/blob/main/README_CN.md

Dify 是一个 LLM 应用开发平台,已经有超过 10 万个应用基于 Dify.AI 构建。它融合了 Backend as Service 和 LLMOps 的理念,涵盖了构建生成式 AI 原生应用所需的核心技术栈,包括一个内置 RAG 引擎。使用 Dify,你可以基于任何模型自部署类似 Assistants API 和 GPTs 的能力。

项目部署脚本地址:

https://gitee.com/fly-llm/dify-docker-compose

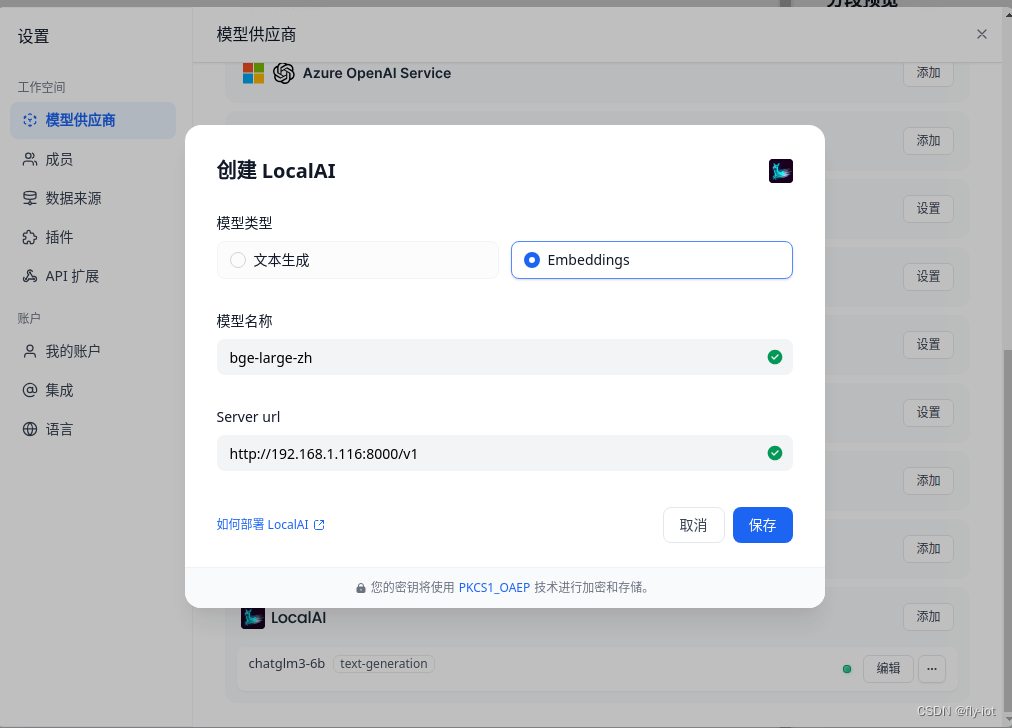

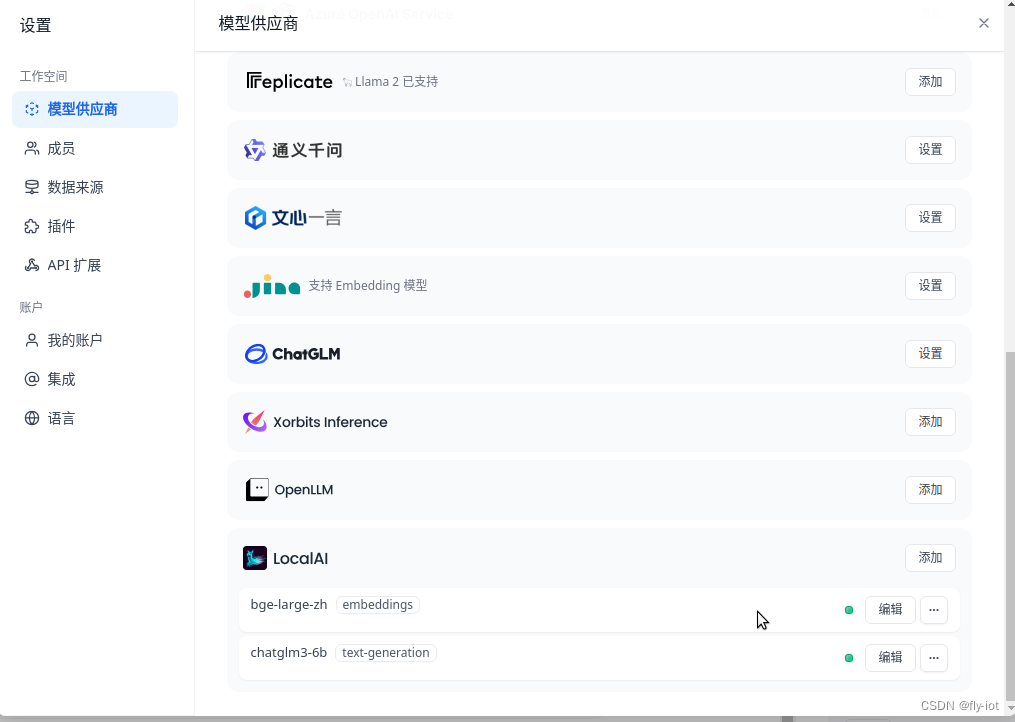

3,配置知识库 bge-large-zh 进行embedding

使用 embedding 接口

特别注意,这次需要增加 /v1 路径了:

http://192.168.1.116:8000/v1

本地模型就多了两个接口可以使用了

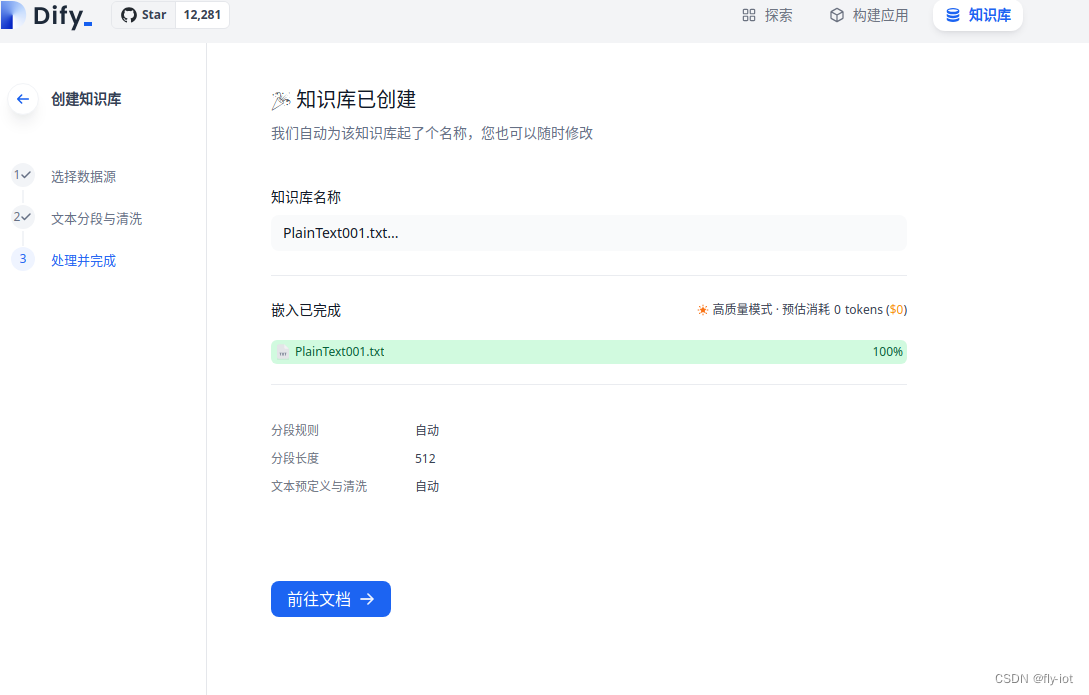

4,然后配置知识库导入

然后就可以使用高质量索引了:

可以看到分成的文档段落:

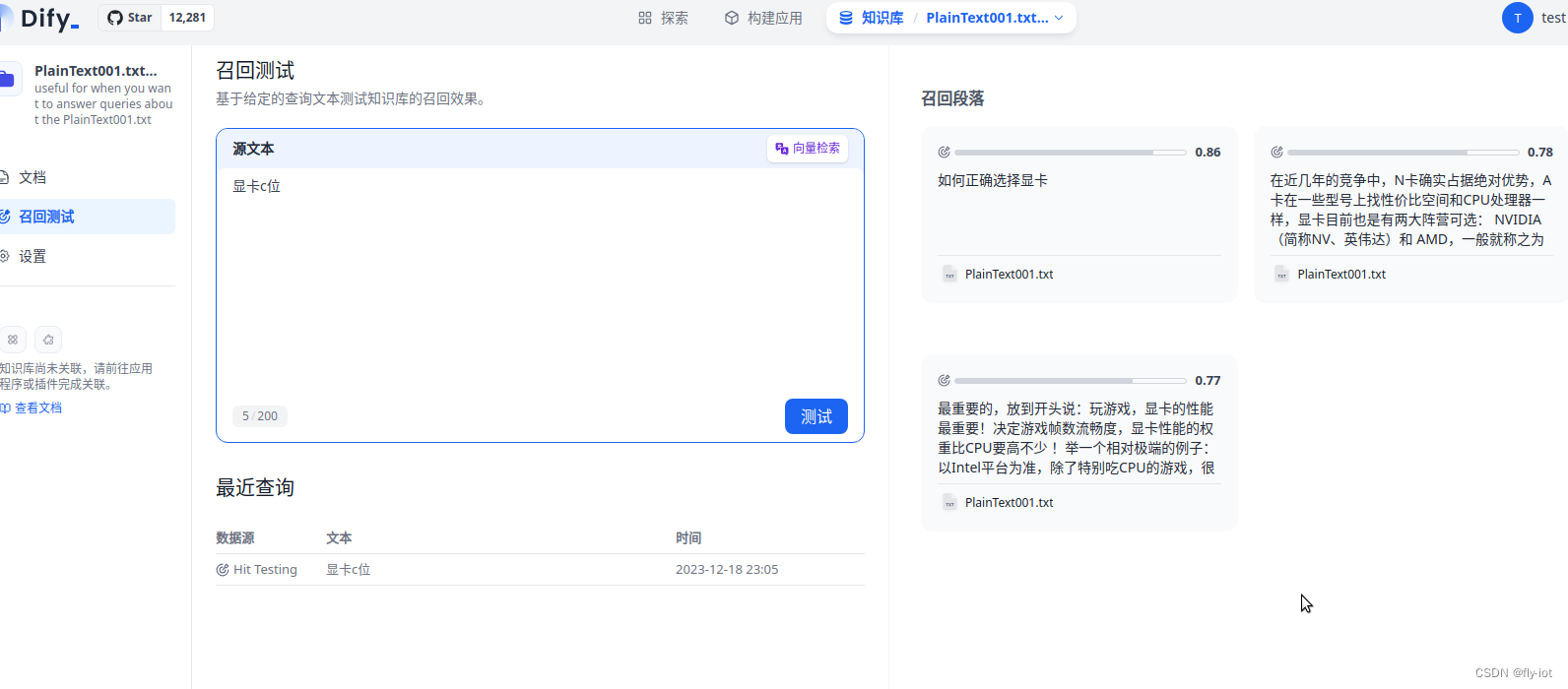

5,进行召回测试

然后就可以配合知识库使用了。

6,总结

知识库使用起来也是非常的方便的,配置bge的embedding 接口。

文章来源:https://blog.csdn.net/freewebsys/article/details/135073600

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!