【Transformer】Transformer and BERT(1)

文章目录

太…完整了!同济大佬唐宇迪博士终于把【Transformer】入门到精通全套课程分享出来了,最新前沿方向

学习笔记

Transformer

无法并行,层数比较少

词向量生成之后,不会变,没有结合语境信息的情况下,存在一词多义,无法处理

词如何编码成向量

第一句话中,it 和 animal 的相应最高

内积,正交的话内积为0,越相近(相关),内积越大

d k \sqrt{d_k} dk?? 的目的,向量维度越大,内积也越大, d k \sqrt{d_k} dk?? 起到 scale 的作用

对于每个输入 x1 … xn, 计算一样的,可以并行为一个矩阵乘法

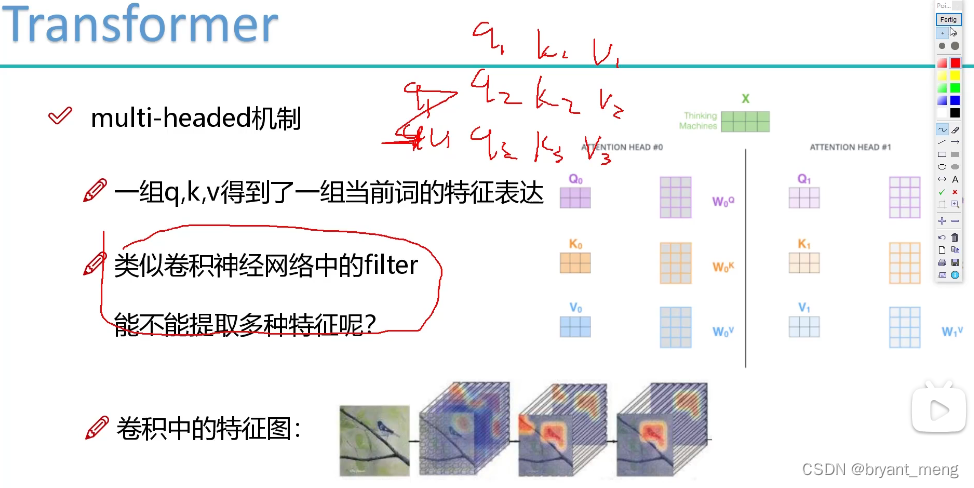

多头类比多个卷积核,来提取多种特征

不同的头得到的特征表达也不相同

多头包含在了 self-attention 中了

引入位置编码,形式有很多,比如 one-hot,原文中作者使用的是周期性信号进行编码

layer normalization 和 residual structure

encoder-decoder attention,encoder 的 K,V,decoder 的 Q

mask 机制:以翻译为例,不能透答案了,翻译到 I am a 的时候,student 要被 mask 起来,只能计算 I am a 的注意力

不能用后面未知的结果当成已知的条件

BERT

语料

预测出 mask,来训练提升特征编码能力

end-to-end 的形式,词编码表达和 task 一起训练

答案 d2->d3

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- hcip高级网络知识

- ICC2:如何用阵列摆放instance

- Guava:Throwables 异常工具

- airflow通过restapi触发的网络大坑的解决办法

- 【UML】第9篇 类图

- 部署YUM软件仓库

- C++11——包装器

- GNSS模块引领共享出行新纪元:创新微公司的技术创新之路

- pycharm管理仓库(Manager Repository)不见了

- 科技云报道:2024年六大科技趋势前瞻,最热门的技术都在这里了!