机器学习周记(第二十五周:文献阅读-DSTIGNN)2024.1.8~2024.1.14

目录

5.2.1 时空交互学习模块(Spatiotemporal Interactive Learning Module)

5.2.2?动态图推理模块(Dynamic Graph Inference Module)

5.2.3 动态图卷积模块(Dynamic Graph Convolution Module)

5.2.4 输出模块与训练过程(Output Module And Training Process)

摘要

? 本周学习了一篇基于STFGNNs的多变量时间序列预测的论文,论文的模型为DSTIGNN(动态时空交互图神经网络),主要包括如下四个模块:时空交互学习模块(Spatiotemporal Interactive Learning Module)、动态图推理模块(Dynamic Graph Inference Module)、动态图卷积模块(Dynamic Graph Convolution Module)以及输出模块(Output Module)。动态图推理模块通过融合两类异构信息对变量之间的动态空间关联进行建模,并与动态图卷积模块相结合,在空间维度上进行信息传播。同时,利用下采样操作和多个样本卷积模块联合捕获多分尺度时间相关性。随后,这些模块被集成到一个时空交互学习框架中,实现了时间和空间特征的同步捕获。在6个基准数据集上进行了大量实验,实验结果表明,DSTIGNN表现出了最先进的性能。

ABSTRACT

This week, We learned a paper on multivariate time series forecasting based on STFGNNs. The model of the paper is DSTIGNN (Dynamic Spatio-Temporal Interaction Graph Neural Network), which mainly includes the following four modules: Spatiotemporal Interactive Learning Module, Dynamic Graph Inference Module, Dynamic Graph convolution module Convolution Module) and Output Module. The dynamic graph inference module models the dynamic spatial association between variables by fusing two types of heterogeneous information, and combines it with the dynamic graph convolution module to propagate information in the spatial dimension. At the same time, the down-sampling operation and multiple sample convolution modules are used to jointly capture the multi-subscale temporal correlation. Subsequently, these modules are integrated into a spatio-temporal interactive learning framework, which enables the simultaneous capture of temporal and spatial features. Extensive experiments are conducted on six benchmark datasets, and the experimental results show that DSTIGNN exhibits the state-of-the-art performance.

1 论文标题

Dynamic spatiotemporal interactive graph neural network for multivariate time series forecasting

2 论文摘要

? 多变量时间序列(MTS)预测对于复杂现实现象的决策具有重要意义。然而,变量内部的非线性时间相关性和变量之间的动态空间相关性使得准确的MTS预测具有挑战性。目前,有许多研究人员构建了各种时空图神经网络(spatiotemporal graph neural networks,STGNNs)并将其应用于该领域。然而,现有的方法大多使用单一类型的信息构建图结构,并分别捕获时间和空间特征。这些因素会导致模型无法提取完整的时空特征,从而限制其性能。为克服这些限制,本文提出动态时空交互图神经网络(DSTIGNN),一种用于MTS预测的新型STGNN。所提出的动态图推理模块(dynamic graph inference module,DGIM)通过融合两类异构信息对变量之间的动态空间关联进行建模,并与动态图卷积模块(dynamic graph convolution module,DGCM)相结合,在空间维度上进行信息传播。同时,利用下采样操作(downsampling operations)和多个样本卷积模块(sample convolution modules,SCM)联合捕获多分尺度时间相关性。随后,这些模块被集成到一个时空交互学习框架中,实现了时间和空间特征的同步捕获。在6个基准数据集上进行了大量实验,实验结果表明,DSTIGNN表现出了最先进的性能。

3 论文背景?

? 多变量时间序列(MTS)预测的目标是通过揭示历史数据之间的模式和关系来预测未来数据。数据科学和人工智能技术的进步,将MTS预测提升为数据驱动决策和优化的重要工具。MTS预测广泛应用于能源、天气、交通等领域,包括电力负荷预测、天气预测、交通流量预测等。准确的MTS预测对于使个人能够做出明智的决定和驾驭不确定的未来至关重要。MTS预测的困难在于捕获每个变量内在的非线性时间相关性。必须充分考虑多个变量之间的相互作用和影响,这种相关性可能会随着时间的推移而变化。近年来,深度学习因其能够从数据中自动学习最优的特征表示而得到迅速普及。许多研究人员开始构建基于深度学习的方法,用于MTS预测领域的应用。例如,有许多方法结合了循环神经网络(RNNs)和卷积神经网络(CNNs),以捕获变量内的时间相关性和变量之间的空间相关性。然而,CNN具有全局聚合属性,阻止了它们捕获变量之间的成对依赖关系,这可能会限制模型的性能。最近,图神经网络(GNNs)的出现能够用来解决这个问题。GNN将MTS中的每个变量视为图结构中的一个节点,变量之间的成对依赖关系视为图结构中的边。然后通过图结构进行信息传播,允许每个节点与其相邻节点交互并学习其特征表示。因此,许多研究人员开始将GNNs与其他深度神经网络结合在专用时空图神经网络(STFGNNs)中以提高模型的预测性能。

4 过去研究

? 目前,STGNNs可以根据其架构和构造的图结构进行分类。从STGNNs的架构来看,这些网络通常将GNNs与注意力机制(Attention)、CNN或RNN相结合,以捕获MTS中的时空依赖关系。然而,与基于CNN和基于RNN的方法相比,这种方法在捕获短期依赖方面相对较低效,并且可能受到内存和计算资源的限制。基于CNN的方法通常使用时间卷积网络(TCN)来有效捕获数据中的时间依赖关系,然后将其与以串行或并行方式捕获空间依赖关系的GNN相结合以预测MTS。然而,这些方法忽略了时间和空间特征之间的相互作用,潜在地削弱了时空相关性。基于循环神经网络的方法通常使用循环神经网络及其变体,长短期记忆网络(LSTM)和门控循环单元(GRU)可以有效地提取时间特征。这些方法通常将GNN嵌入到RNN单元中,以同步捕获空间和时间依赖关系。基于RNN的方法考虑了时空特征之间的相互作用,但可能面临梯度爆炸或消失等挑战。尽管现有方法在MTS预测任务中取得了很好的效果,但仍然存在一定的局限性。此外,这些方法在捕获时序依赖关系时往往忽略了时间序列的特性,如季节性和趋势性。在论文Spatial-Temporal Interactive Dynamic Graph Convolution Network for Traffic Forecasting中率先将时间序列的特性与时空交互学习相结合,在交通数据上取得了优异的预测性能。然而,他们的模型采用了单层结构,这在一定程度上限制了其对其他时间序列数据中可能存在的各种依赖关系的适用性。因此,设计一个灵活高效的模型,同时考虑时空交互学习和时间序列的特性,是一项具有挑战性的任务。无论STGNNs的架构如何,都需要建立信息传播的图结构。因此,构建一个合适的图结构也是非常重要的。

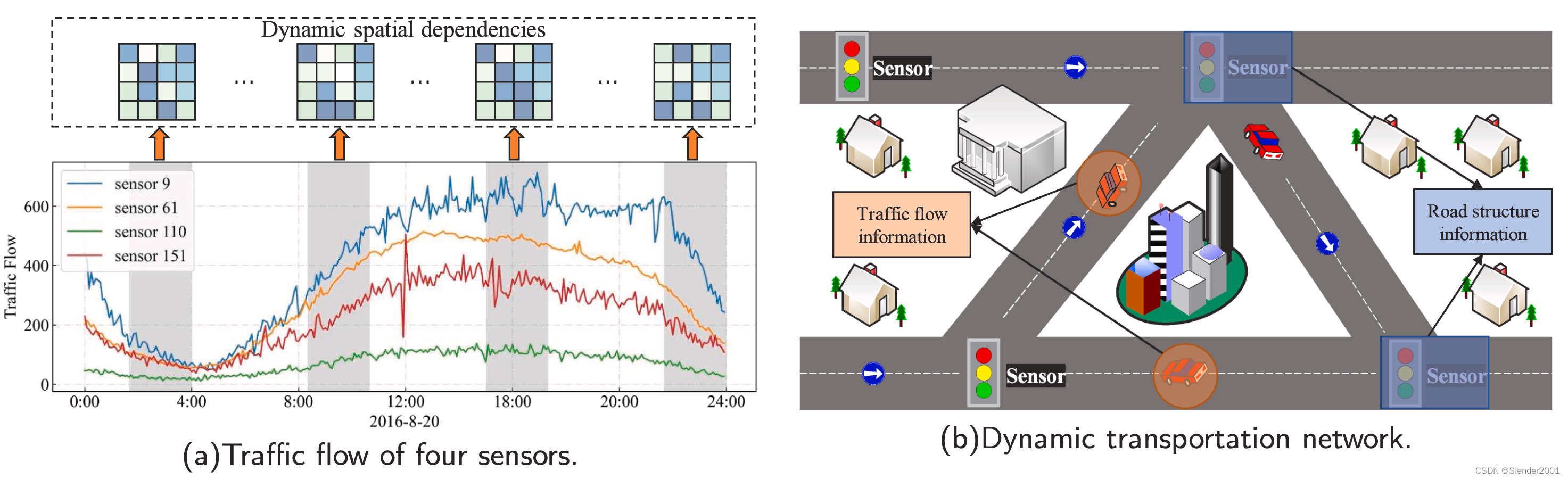

? 根据构造的图结构,STGNNs可以根据预定义图、自适应图(动态图)进行分类。基于预定义图的方法通常基于先验知识或单一规则构建图结构,如空间距离、Pearson相关系数、动态时间规整(dynamic time warping)等。虽然这些预定义的图可以在一定程度上反映节点之间的因果关系,但对于抽取节点之间的复杂关系还不够。自适应图的出现很好地解决了这个问题。它们对节点信息进行参数化,并自适应地学习变量之间的空间关系。然而,预定义图结构和自适应图结构都是静态的,缺乏建模节点之间动态空间关联的能力。如下图(a)所示,四条不同颜色的折线代表四个不同传感器处的交通流。从图中可以看出,节点间的空间关联随时间变化,每个时间步长的空间关联可以建模为图结构。这个问题促使研究人员构建动态图。论文Dynamic and Multi-faceted Spatio-temporal Deep Learning for Traffic Speed Forecasting通过分配三个节点嵌入矩阵和一个可学习的核心张量在每个时间步骤计算动态图。节点嵌入可以将节点映射为捕捉节点之间内在结构信息的潜在信息,通常以空间维度表示。论文Learning the Evolutionary and Multi-scale Graph Structure for Multivariate Time Series Forecasting使用膨胀卷积来提取序列内的多尺度时间相关性,然后在每一层网络中递归地构建演化动态图。虽然两组都取得了很好的效果,但它们只考虑了单一的信息来构建动态图。如下图(b)所示,每个传感器处的车流量不仅受到实时车流量的影响,还受到固定道路结构的影响。因此,需要将这两类异构信息结合起来建模动态空间关联。由于不同类型的异构信息可能会相互限制或排除,因此平衡这些信息是一个挑战。

5 论文研究

? 为了克服这些挑战,本文提出了DSTIGNN。为了有效地建模动态空间关联,设计了一个新的动态图推理模块(DGIM),利用节点嵌入信息和动态输入信息来推断最优的动态图。同时,引入GRU层来平衡这两类异构信息。生成的动态图作为动态图卷积(DGCN)模块的输入,实现信息传播。此外设计了一种用于MTS预测的分层时空交互学习架构。该架构通过将MTS下采样为子序列并使用多个样本卷积(SConv)模块来提取多分尺度时间特征,其中每个SConv模块由两个不同的卷积filter组成。然后,将多个SConv模块与DGCN模块集成,以同步捕获非线性时间相关性和动态空间相关性。

5.1 问题描述

? 本文为基于GNNs的MTS预测提供了一个详细的问题表述。使用图来建模变量之间的关联,将每个变量看作图结构中的一个节点,变量之间的关联看作图结构中的一条边。具体定义如下:

定义一(图):图可以描述为,其中

是顶点的集合,

是节点(变量)的数量,

是边的集合,

表示用于描述节点之间连接的加权邻接矩阵。这个图可以看作是一个静态图,因为边的权重随着时间的推移是恒定的。

定义二(动态图):动态图可以描述为,它捕获了每个时间步

的变量之间的关系。或者,它可以解释为一个静态图序列,其中

和

分别表示时间步

的顶点和边的集合,

表示该特定时间步的加权邻接矩阵。

定义三(MTS预测):MTS可以描述为,其中

是所有变量在时间步

(

)的值,

表示每个变量的特征维数。MTS预测的主要目标是根据过去的观测值对所有变量的未来值进行预测。根据未来要预测的时间步数,该预测任务可以分为单步预测或多步预测。在单步预测的情况下,目标是利用窗口长度为

的历史MTS(表示为

),来预测第

个时间步长的未来值,具体来说就是

。相反,在多步预测中,目标是利用历史MTS来预测未来的后续

个时间步的值,表示为

。

5.2 论文模型

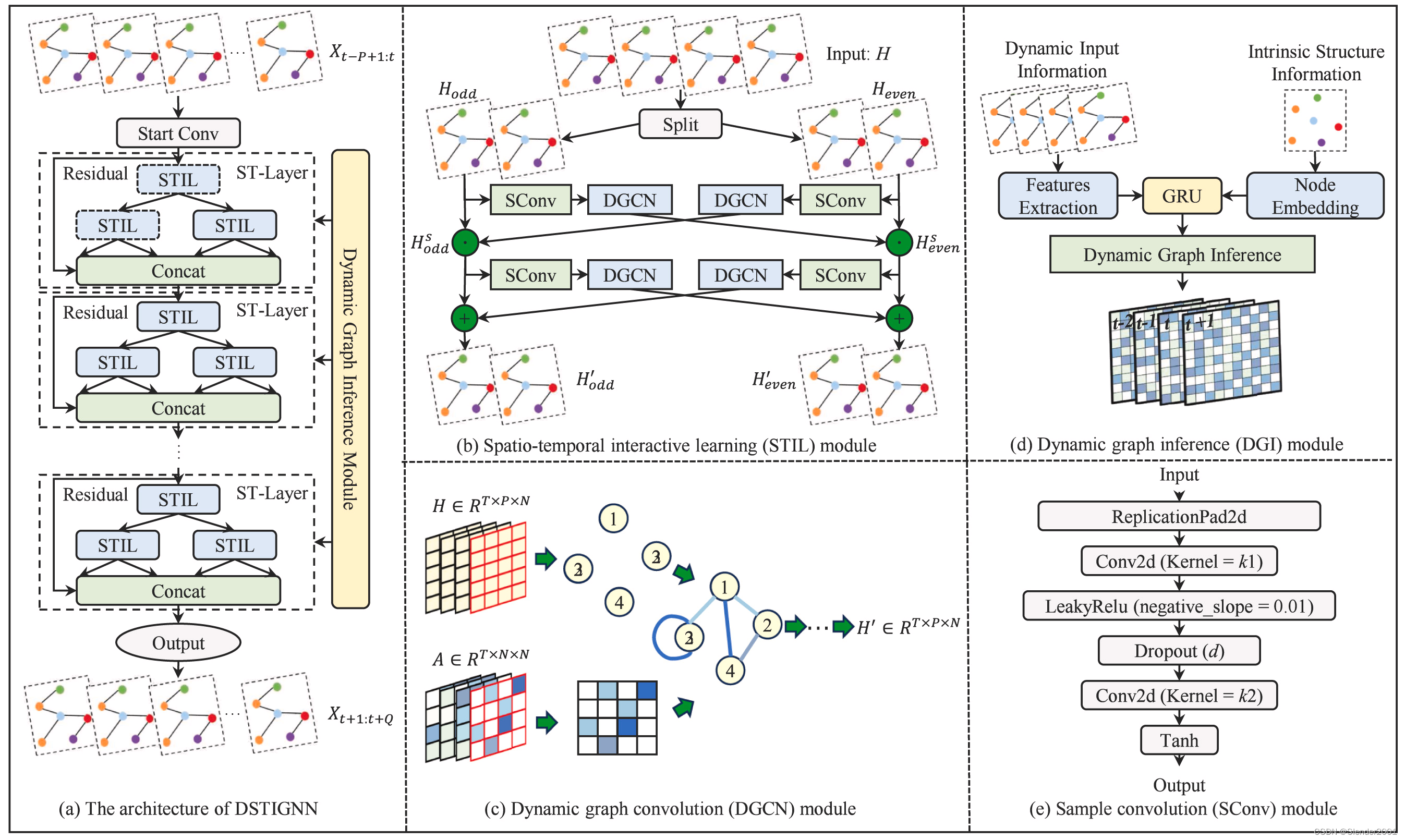

? DSTIGNN的总体架构如下,其核心思想是利用异构信息对动态空间关联进行建模,并通过考虑时间序列特性的交互式学习架构同步捕获时间和空间相关性。该模型采用由动态图推理模块、多个时空层(ST层)和输出模块组成的分层结构,如下图(a)所示。每个ST层由3个时空交互学习模块组成,以二叉树结构排列,有利于在多种尺度下捕获时空特征。初始输入首先被送入1 × 1卷积以获得初始特征表示

,如下图(b)所示。然后,每个STIL模块将数据下采样为两个子序列,然后将它们馈送到交互式学习结构中,以同步提取时间和空间相关性。该结构主要由样本卷积模块和动态图卷积模块组成。样本卷积模块用于捕获数据中的时间相关性,如下图(e)所示。另一方面,利用动态图卷积模块捕获数据中的空间相关性,如下图(c)所示。如下图(d)所示,动态图推理模块旨在根据两类异构信息推断出动态图,对节点之间的动态空间关联进行建模,作为动态图卷积模块的输入之一。在每个ST层的末尾,将捕获到的特征按照原始时间顺序集成到一个新的序列中。通过残差拼接将其与原始序列相结合,得到最终的序列表示。通过堆叠多个ST层来获得深度时空特征。最后,通过由ReLU激活函数和两个1 × 1卷积层组成的输出模块得到预测结果。

5.2.1 时空交互学习模块(Spatiotemporal Interactive Learning Module)

? 时间序列数据有一个独特的性质,即当将数据下采样为两个序列时,原始数据中的时间关系在很大程度上得到保留。受此启发,设计了一个STIL模块,通过下采样操作将原始MTS分割为两个子序列,然后通过样本卷积模块和动态图卷积模块之间的交互学习同步捕获时间和空间相关性。从递归思维中汲取灵感,设计了一个具有三个STIL模块的二叉树结构,对多个子序列进行建模,并捕获多分尺度时空特征。Fig.1(b)显示了STIL模块的结构。给定输入,其中

表示窗口长度,

表示节点数,

表示通道数。分裂操作根据奇偶索引排列将

分为两个子序列

和

。这些子序列的尺度较低,但仍然保留了大多数时间关系。通过交互结构传递它们,从两个独立捕获时间相关性的样本卷积模块开始。Fig.1(e)显示了样本卷积的结构,由两个不同的卷积核组成,便于从数据中提取不同但有价值的时间特征。然后,将提取的时间特征输入到动态图卷积模块中以捕获空间相关性。最后,两个子序列在动态图卷积模块中相互学习共享参数权重,完成初始时空交互学习过程。形式上,第一个交互式学习可以定义如下:

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? (1)

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ?(2)

?? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? (3)

其中和

表示第一次交互学习后学习到的两个子序列的表示,

是哈达玛积,

是分裂操作,

表示双曲正切函数。为了防止下采样操作造成的信息损失,对获得的特征进行第二次交互式学习。形式上,第二个交互式学习可以定义如下:

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? (4)

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? (5)

其中表示STIL模块的输出。如果当前的STIL模块位于ST层的顶部,则该模块的两个输出将作为ST层底部的两个STIL模块的输入,如Fig.1(a)所示。否则,将该模块和另一个模块的输出按照原始时间顺序重新排列,形成新的序列表示,并通过残差连接将其与原始输入序列相结合,得到最终的序列表示。

5.2.2?动态图推理模块(Dynamic Graph Inference Module)

? 对于基于STGNN的模型,图结构的精确构建至关重要。已有研究倾向于构建预定义或自适应的图,但它们是静态的,无法反映节点之间的时变关系。最近的研究从单一的动态信息推断出动态图,取得了较好的结果。然而,动态空间关联往往受到多种类型信息的影响。为解决这个问题,本文提出一种新的DGI模块,旨在基于两种不同类型的异构信息来建模节点之间的动态空间关联:动态输入信息和内在结构信息。DGI模块的架构如Fig.1(d)所示。具体来说,给定时间步的动态输入信息

,其中

表示初始节点维度。使用CNN提取特征,得到

,其中

是节点嵌入维度。同时,初始化一个节点嵌入字典

作为内在结构信息。节点嵌入促进了将每个节点的信息映射到低维向量表示中,从而能够在训练期间推断结构信息。为了有效地利用两类异构信息,并缓解它们之间潜在的冲突或约束,使用GRU层进行平衡。GRU层的数学表达式为:

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ?(6)

其中,、

、

表示可学习参数,

表示时间步

的融合信息。然后,使用余弦相似度来推断动态图,计算方法如下:

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? (7)

其中表示转置操作,使用softmax函数对邻接矩阵进行归一化,使用ReLU激活函数消除弱连接。

表示时间步

的动态图。

5.2.3 动态图卷积模块(Dynamic Graph Convolution Module)

??图卷积主要通过聚合相邻节点的信号来提取和利用每个节点的特性。论文Diffusion Convolutional Recurrent Neural Network: Data-Driven Traffic Forecasting是将交通流视为图结构上的扩散过程的先驱,使捕获节点之间的空间相关性成为可能。这种直观的建模方法已经在众多时空建模任务中得到了验证。具体地,对于输入序列、带有自环的归一化邻接矩阵

和参数矩阵

,扩散图卷积的形式化表示如下:

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? (8)

其中表示输出,

是扩散步骤的数量。

表示转移矩阵的幂级数,同时

,其中

是

的度矩阵。这个过程是针对无向图的。对于有向图,图卷积的扩散过程具有前向和后向两个方向。

为正向转移矩阵,

为逆向转移矩阵。形式上,对于有向图,扩散图卷积可以表示为:

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ?(9)

这些图卷积方法是针对静态图设计的。本文提出一种图卷积的动态变体。这种动态图卷积是基于从动态图推理模块获得的动态推断图。动态图卷积模块的架构如Fig.1(c)所示。它在不同的时间步骤执行图卷积,以捕获节点之间不断演化的空间关系。重要的是要强调,论文的动态图是规范化的,可以认为等同于。因此,动态图卷积的表述可以表示为:

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ?(10)

其中和

分别表示样本卷积模块和动态图卷积模块的输出。

是模型参数。在本研究中,将

设为2。通过上面的等式,能够捕获节点之间的空间特征。回想一下,在5.2.1节中,论文使用动态图卷积模块和样本卷积模块构建了一个时空交互学习模块。该模块的目的是通过有效地同步捕获时间和空间相关性来提高MTS预测的准确性。

5.2.4 输出模块与训练过程(Output Module And Training Process)

该网络采用分层结构,即堆叠多个ST层。如Fig.1(a)所示,在每个ST层中添加残差连接以防止梯度消失。输出模块由两个1 × 1卷积和ReLU激活函数组成,可以形式化如下:

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? (11)

其中表示1 × 1卷积,

是第

个ST层的输出,

是预测结果。在训练过程中,使用平均绝对误差作为损失函数。然后,结合预测结果和损失函数更新模型参数。形式上,训练目标定义如下:

? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ?(12)

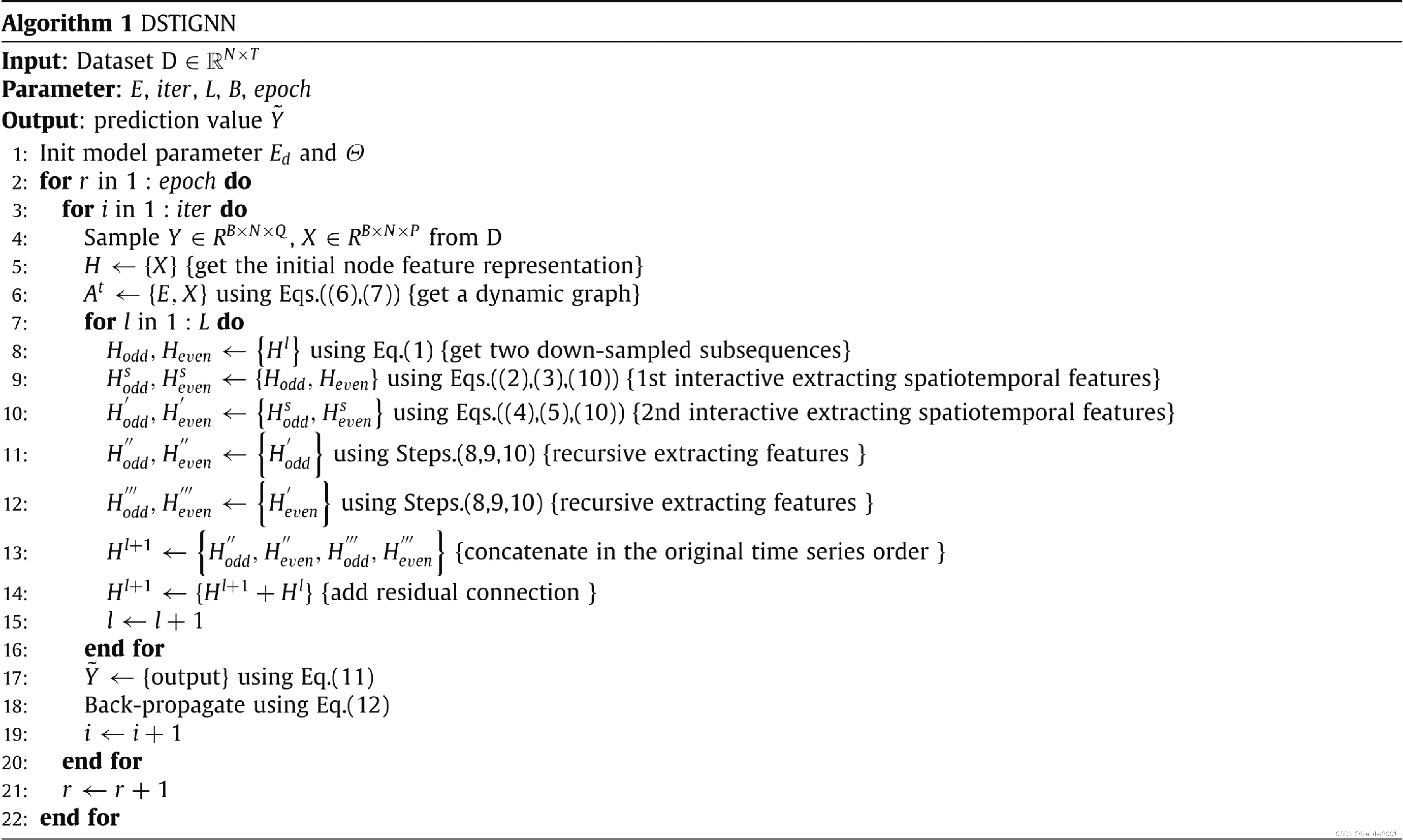

其中是DSTIGNN的所有参数,

是平均绝对误差损失函数。最后,算法1中概述了DSTIGNN的训练过程。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- SpringSecurity入门

- 2023年12月24日学习总结

- 用JAVA编写一个饼图

- SpaceDesk如何连接平板/PC(生产力副屏)

- 移动图书盘点系统需求说明书

- 第二证券:持股锁定期是不是限制了股票减持?

- 2024年远控软件年度盘点:安全、稳定、功能之选

- 移动通信的发展历程与Matlab应用

- 毕业设计:基于机器学习xgboost lgbm adaboost 的空气质量预测pm2.5‘, ‘so2‘, ‘no2‘ 完整代码数据-可直接运行

- 数据结构:第11关:查找链表中倒数第k个结点