Stable LM Zephyr 3B:手机上的强大LLM助手

概览

最近,Stability.ai宣布开源了Stable LM Zephyr 3B,这是一个30亿参数的大语言模型(LLM),专为手机、笔记本等移动设备设计。其突出的特点是参数较小、性能强大且算力消耗低,能够自动生成文本、总结摘要等,与70亿、130亿参数的模型相媲美。

-

Huggingface模型下载: https://huggingface.co/stabilityai/stablelm-zephyr-3b

-

AI快站模型免费加速下载: https://aifasthub.com/models/stabilityai/stablelm-zephyr-3b

核心架构

Zephyr 3B的核心架构来源于Zephyr 7B,后者是基于Mistral AI的Mistral-7B模型微调而成。Zephyr 3B在训练数据集和人工智能反馈方面利用了GPT系列模型,从而拥有强大的ChatGPT基因。

监督学习优化

通过OpenAI的GPT-3.5模型生成的大规模对话数据集“UltraChat”,Zephyr 3B经历了严格的监督学习优化。这个过程通过自动生成的高质量数据,最大限度地降低了“交叉熵”误差,优化了模型的训练效率。

人工智能反馈

研究团队使用第二个数据集“UltraFeedback”,对不同主题下的大语言模型回复进行打分评价。这一过程涉及到GPT-4模型的深度参与,进一步提升了Zephyr 3B的文本生成和理解精准度。

直觉优化指导学习

使用“UltraFeedback”收集的样本和GPT-4的质量评价,Zephyr 3B采用直觉优化指导学习(dDPO)方法。这种方法通过反向传播优化模型参数,高效地微调模型结构。

测试与性能

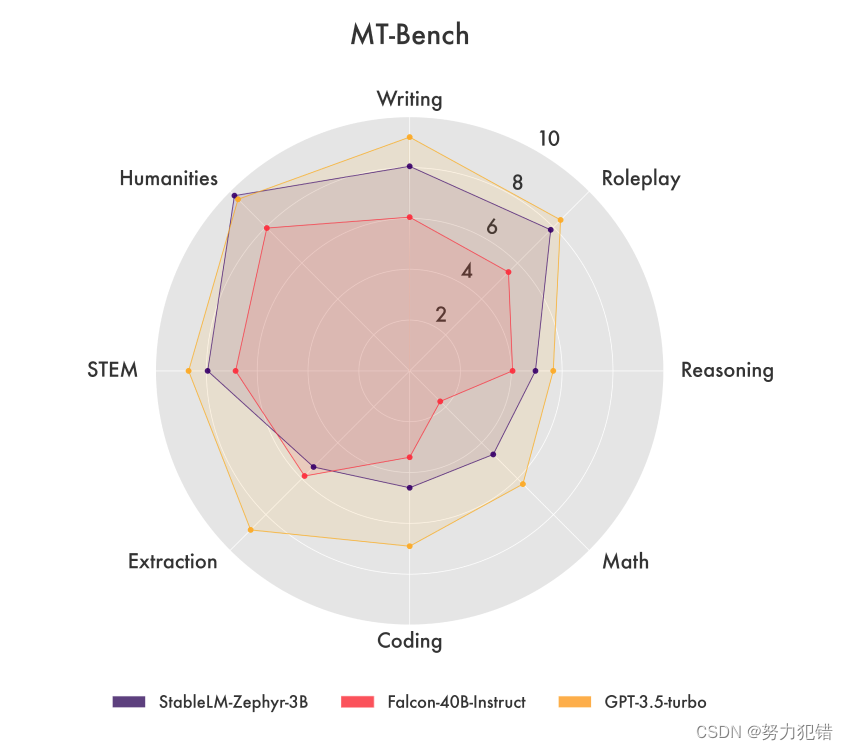

Stability.ai指出,Zephyr 3B在MT Bench、AlpacaEval等平台上展示了出色的性能,尤其擅长创意、个性化文本生成。其性能与Falcon-4b-Instruct、WizardLM-13B-v1、Llama-2-70b-chat和Claude-V1等大参数模型相当。

结论

Stable LM Zephyr 3B的发布,标志着高效、低成本的大型语言模型在边缘设备上的实际应用成为可能。它不仅在文本生成领域展现了巨大潜力,同时也为移动设备上的AIGC应用开辟了新的道路。

模型下载

Huggingface模型下载

https://huggingface.co/stabilityai/stablelm-zephyr-3b

AI快站模型免费加速下载

https://aifasthub.com/models/stabilityai/stablelm-zephyr-3b

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- Vue router-view 组件如何实现回调处理

- 2020年认证杯SPSSPRO杯数学建模A题(第一阶段)听音辨位全过程文档及程序

- 『OPEN3D』1.12 RGBD三维重建

- Java_特殊文件、日志技术、多线程

- 视频搜索AI平台,输入关键词全网查找相关内容

- Java基础入门——初识Java

- 重装系统之----Rufus创建UEFI启动盘

- Flink Job 执行流程

- Visual Studio 2022 AI Code 支持

- PHP在线sqlite转html表格小功能(sqlite2html)