论文阅读 BERT GPT - transformer在NLP领域的延伸

发布时间:2024年01月09日

文章目录

不会写的很详细,只是为了帮助我理解在CV领域transformer的拓展

1 摘要

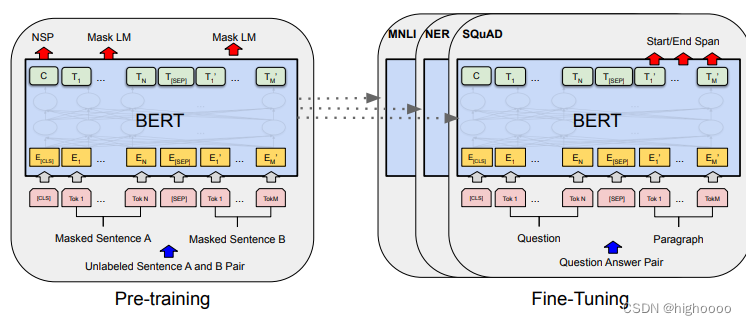

1.1 BERT - 核心

双向 编码器 加上mask做完形填空超大模型无监督预训练 需要整个模型作为pretrain weight到下游任务做fintune

1.2 GPT - 核心

自回归 解码器 无需训练 只需Prompt

2 模型架构

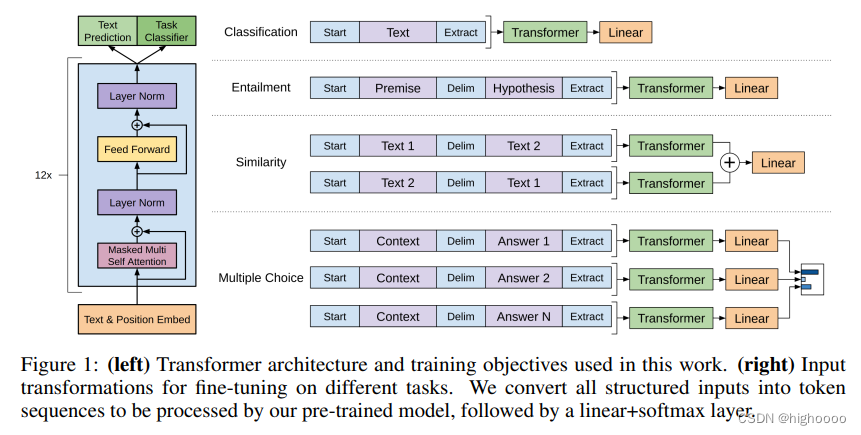

2.1 概览

3 区别

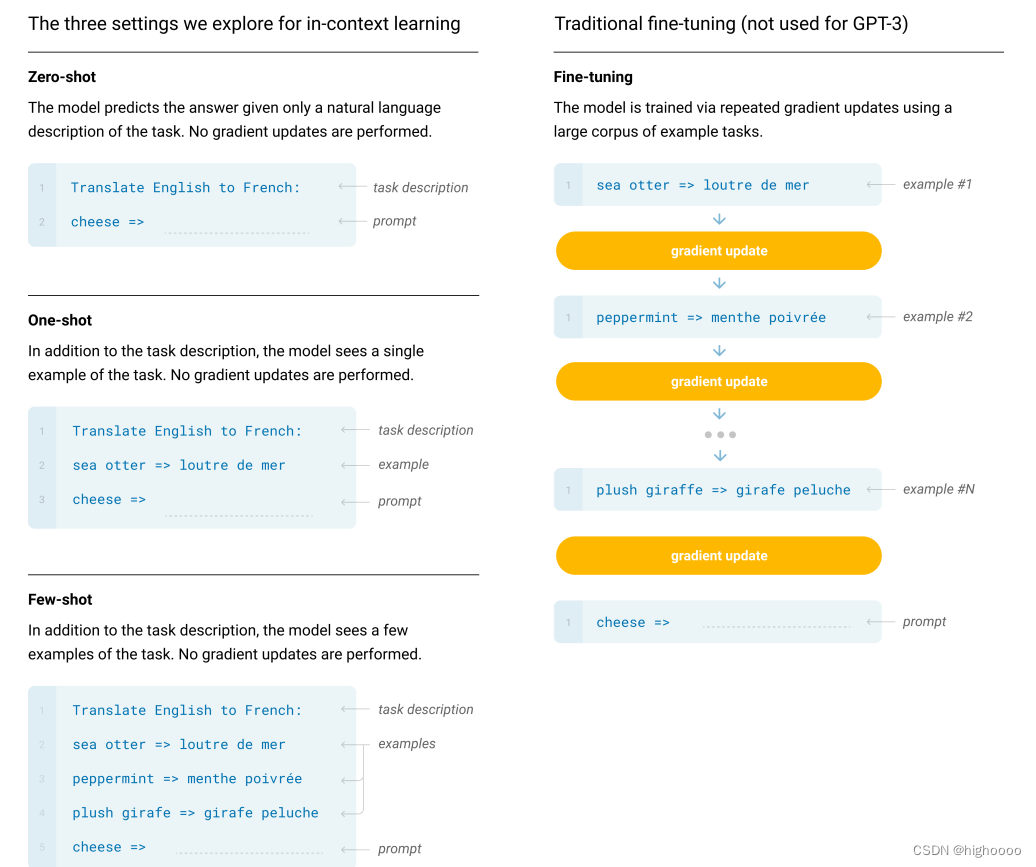

3.1 finetune和prompt

BERT需要全部参数进行训练

GPT不需要训练即可完成下游任务

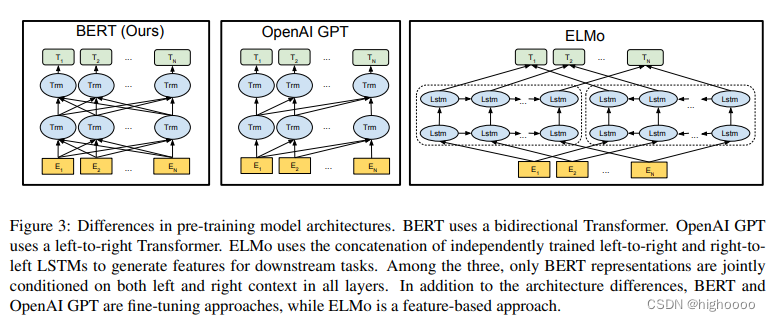

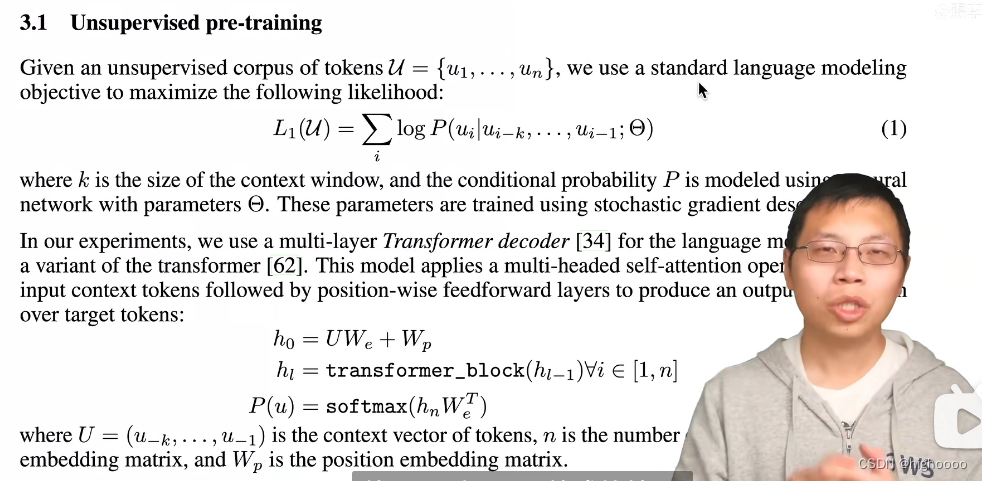

3.2 transformer及训练

BERT使用双向的编码器

GPT使用自回归的解码器

总结

总结个毛

文章来源:https://blog.csdn.net/highoooo/article/details/135487425

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- uni-app和Vue.js有什么区别?

- C语言--有一个3*4的矩阵,求出其中最大值的那个元素的值,以及其所在的行号和列号

- STM32用ST-LINK V2-1烧录后,不会自动重启执行--Keil设置

- leetcode670最大交换

- (Arcgis)Python3.8批量裁剪利用shp文件裁剪tif栅格影像数据

- 每日一题——LeetCode860

- Linux中的强大的行处理器工具!awk!

- curl命令是什么?(答:请求 Web 服务器)

- 记一次JSF异步调用引起的接口可用率降低 | 京东云技术团队

- 基础数据结构第十期 哈希表(数组+STL)