信息论与编码期末复习——计算题+基础汇总(二)

?个人名片:

🦁作者简介:一名喜欢分享和记录学习的在校大学生

🐯个人主页:妄北y🐧个人QQ:2061314755

🐻个人邮箱:2061314755@qq.com

🦉个人WeChat:Vir2021GKBS

🐼本文由妄北y原创,首发CSDN🎊🎊🎊

🐨座右铭:大多数人想要改造这个世界,但却罕有人想改造自己。

专栏导航:

妄北y系列专栏导航:

C/C++的基础算法:C/C++是一种常用的编程语言,可以用于实现各种算法,这里我们对一些基础算法进行了详细的介绍与分享。🎇🎇🎇

C/C++刷题库:分享一些关于编程的练习基础题,也会后续加入一系列的算法题,分享自己的解题思路和方法。🥰🥰🥰

计算机网络:对计算机网络的基础知识框架有一个简单的学习与认识,对计算机网络中常见的题型进行一个总结与归纳。🍾🍾🍾

QT基础入门学习:对QT的基础图形化页面设计进行了一个简单的学习与认识,利用QT的基础知识进行了翻金币小游戏的制作🤹🤹🤹

Linux基础编程:初步认识什么是Linux,为什么学Linux,安装环境,进行基础命令的学习,入门级的shell编程。🍻🍻🍻

Linux的系统编程+网络编程:IO编程、进程、线程、进程间通讯(包括管道、信号、信号量、共享内存等)网络编程主要就是socket,poll,epoll,以及对TCP/IP的理解,同时要学会高并发式服务器的编写。🙌🙌🙌

Linux应用开发基础开发:分享Linux的基本概念、命令行操作、文件系统、用户和权限管理等,网络编程相关知识,TCP/IP 协议、套接字(Socket)编程等,可以实现网络通信功能。💐💐💐

Linux项目开发:Linux基础知识的实践,做项目是最锻炼能力的一个学习方法,这里我们会学习到一些简单基础的项目开发与应用,而且都是毕业设计级别的哦。🤸🤸🤸

非常期待和您一起在这个小小的互联网世界里共同探索、学习和成长。💝💝💝 ?? 欢迎订阅本专栏 ???

文章介绍:

🎉本篇文章对信息论与编码学习的相关知识进行分享!🥳🥳🥳

如果您觉得文章不错,期待你的一键三连哦,你的鼓励是我创作动力的源泉,让我们一起加油,一起奔跑,让我们顶峰相见!!!💪💪💪

🎁感谢大家点赞👍收藏?评论??

目录:

目录

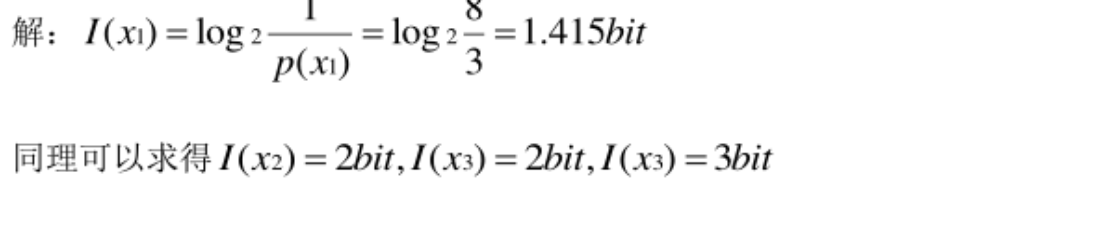

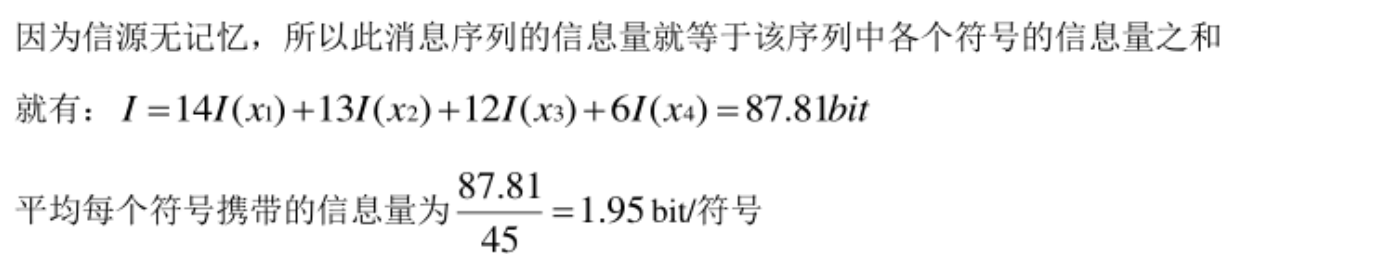

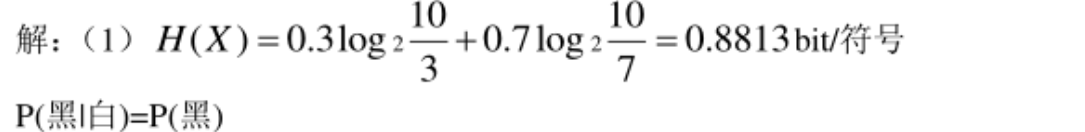

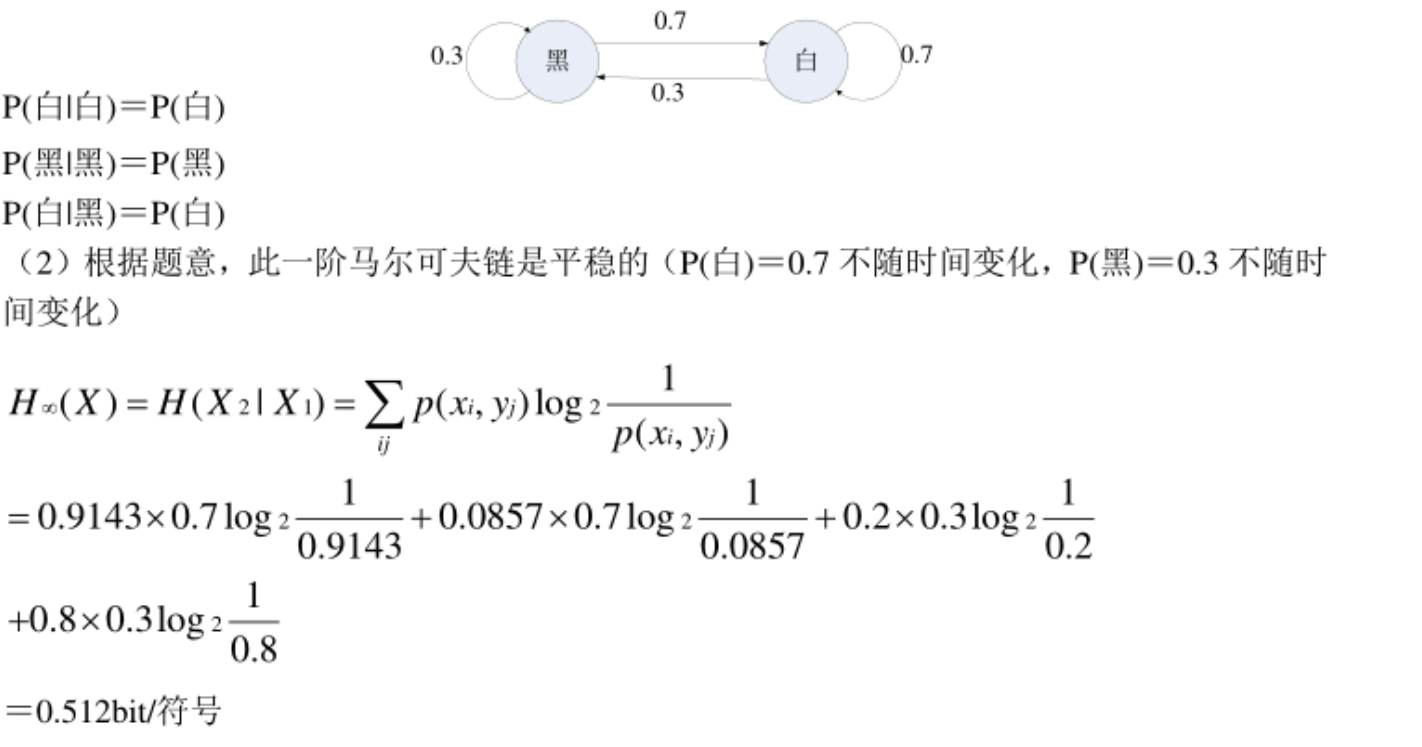

计算题:

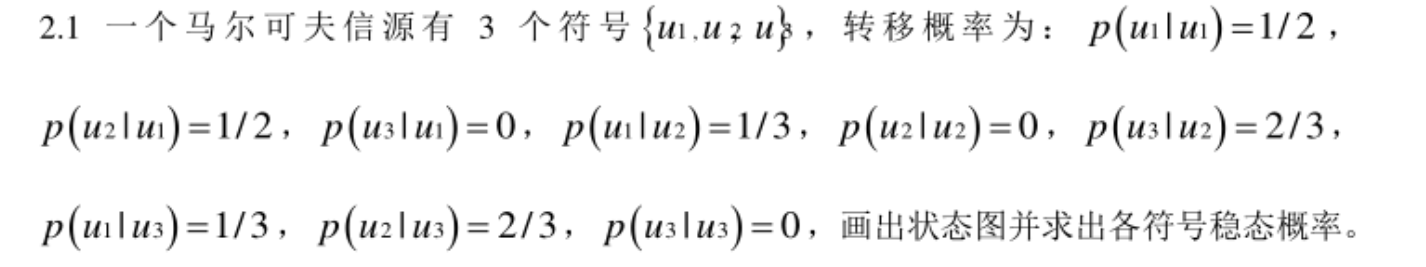

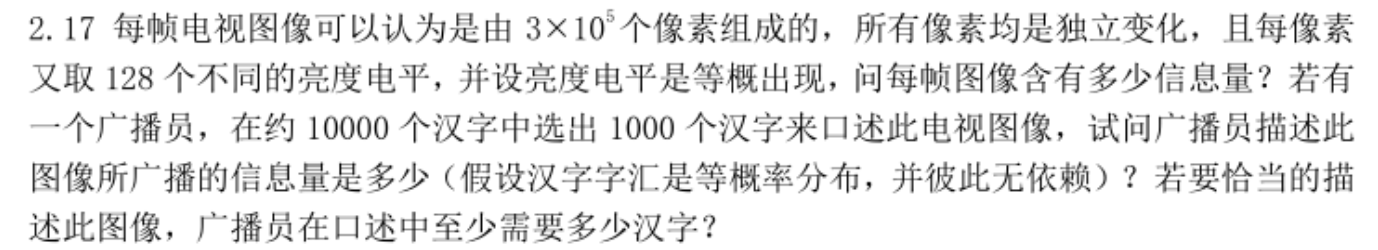

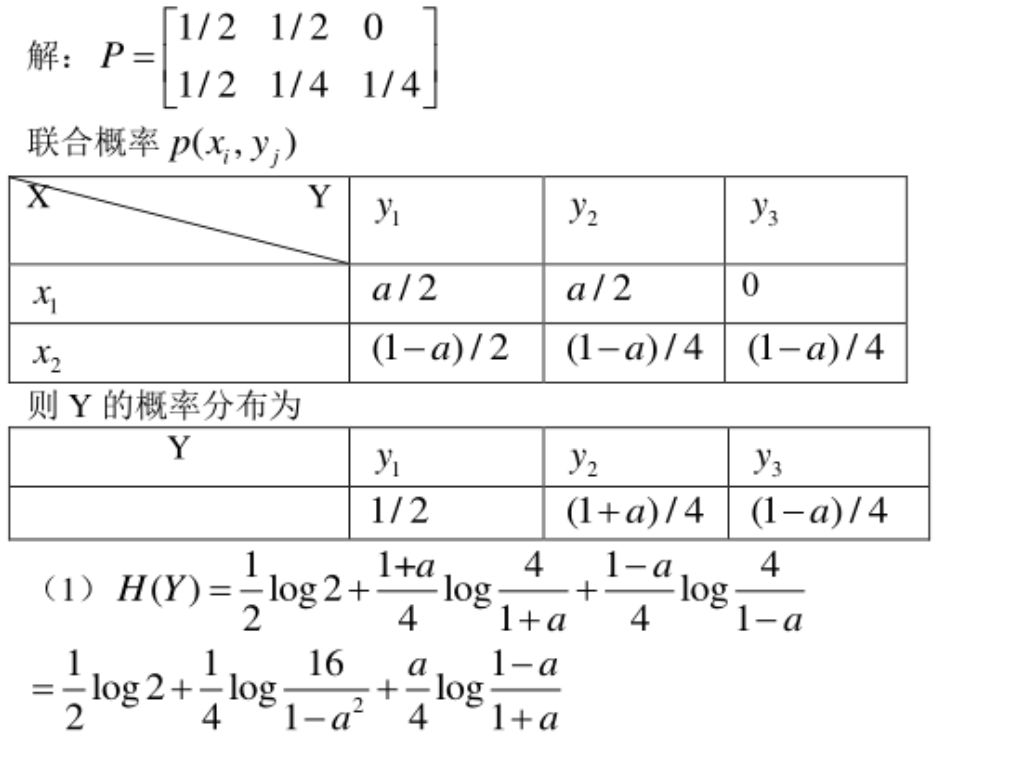

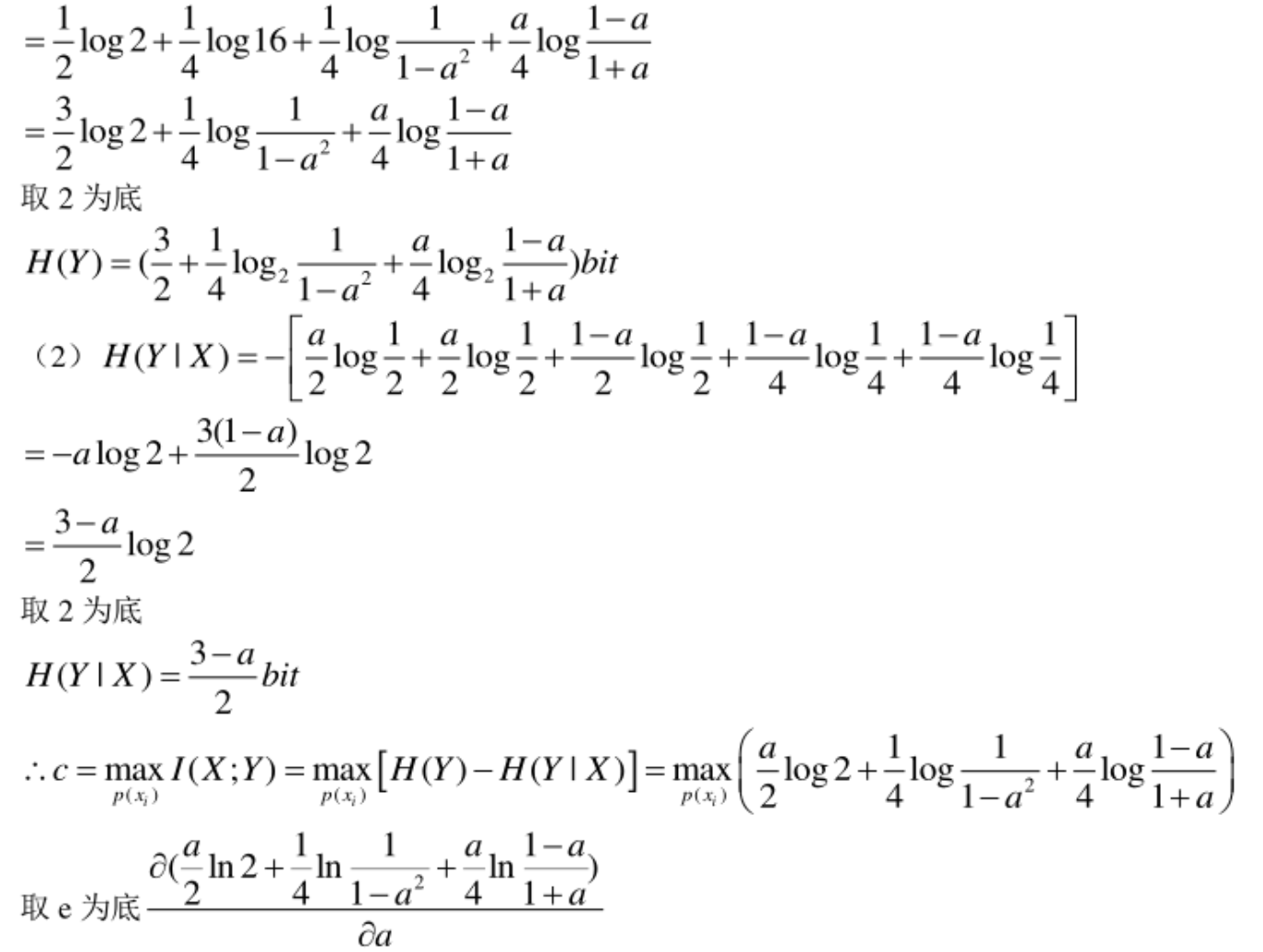

?

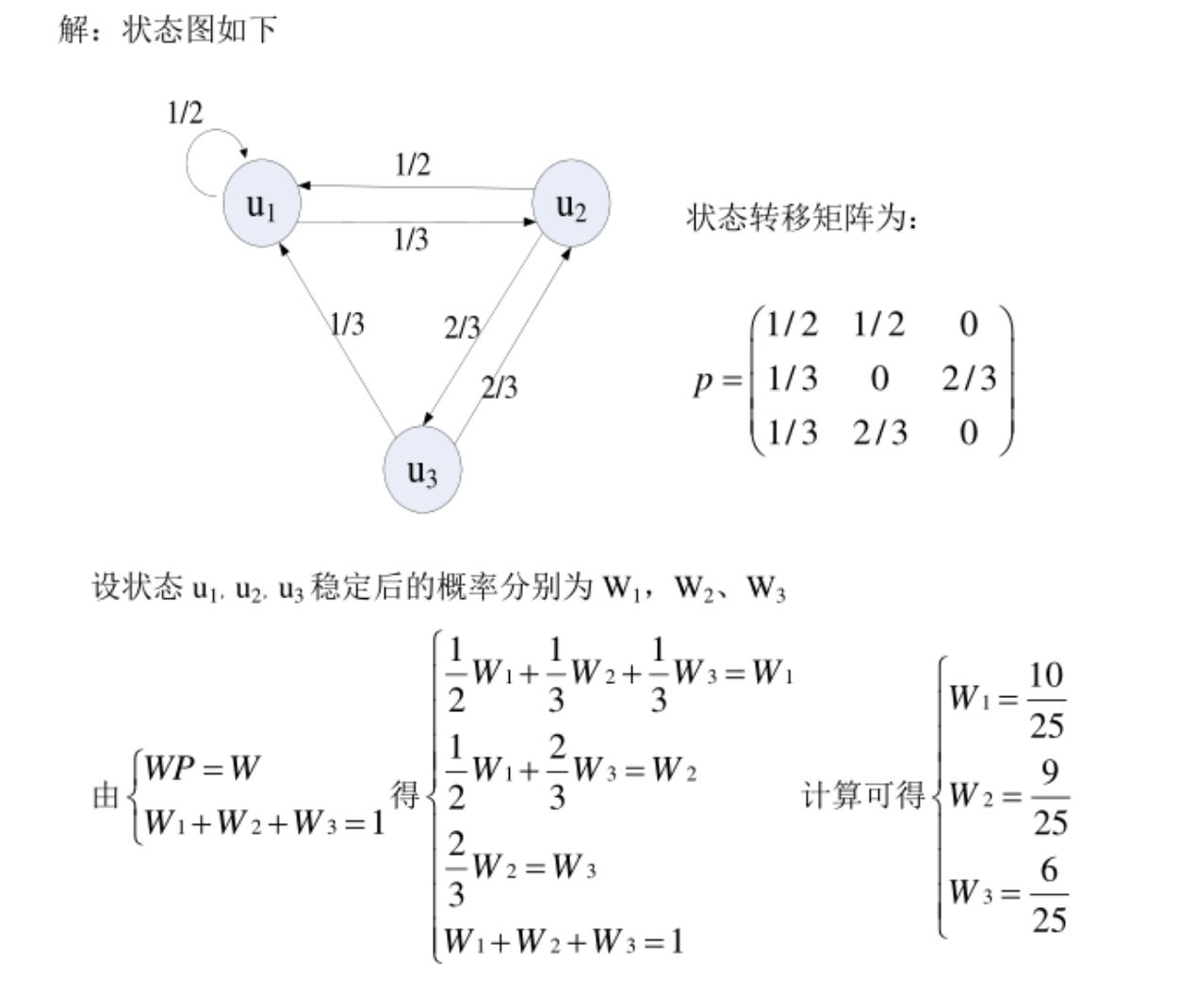

?

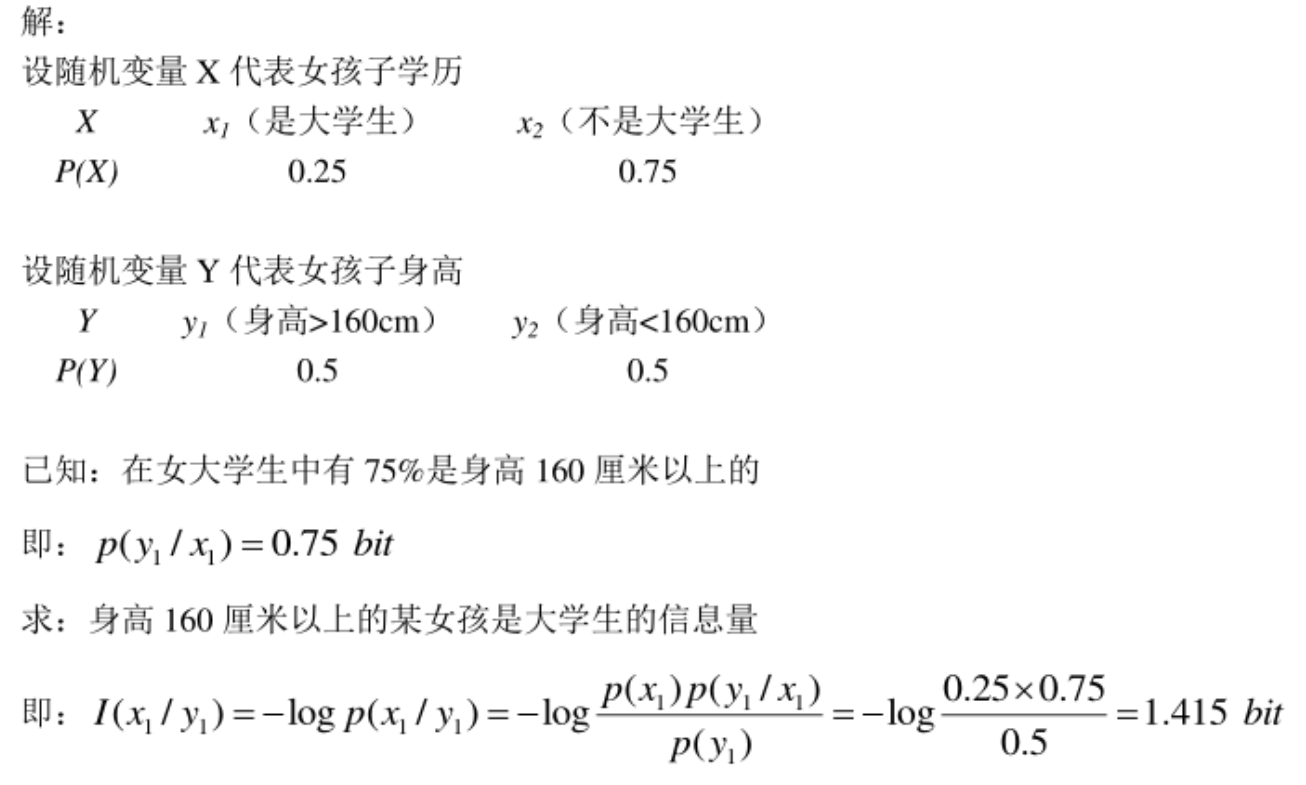

?

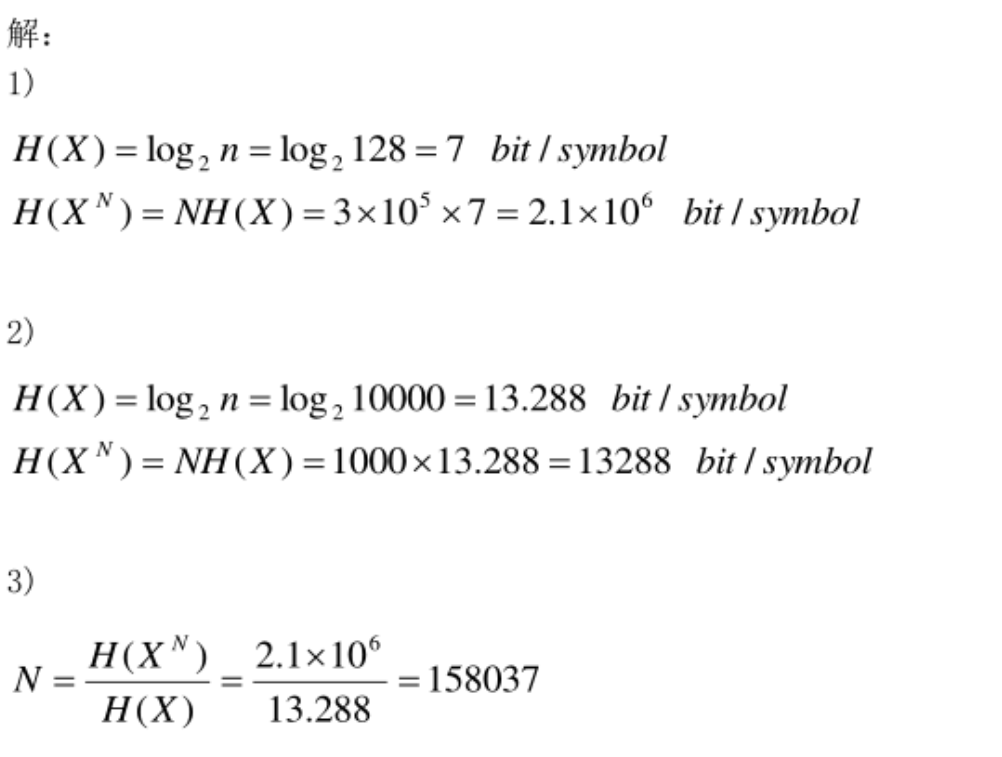

?

?

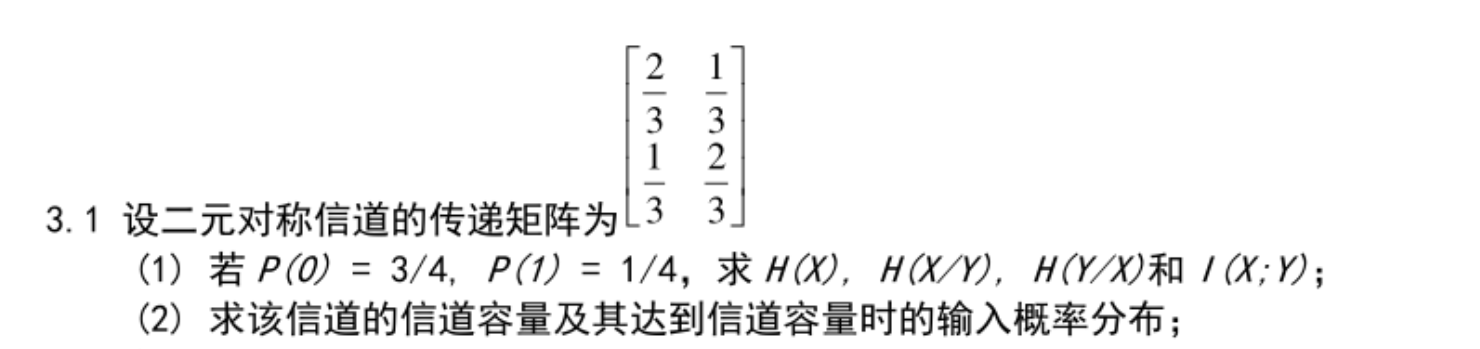

?

?

?

?

?

?

选择:??

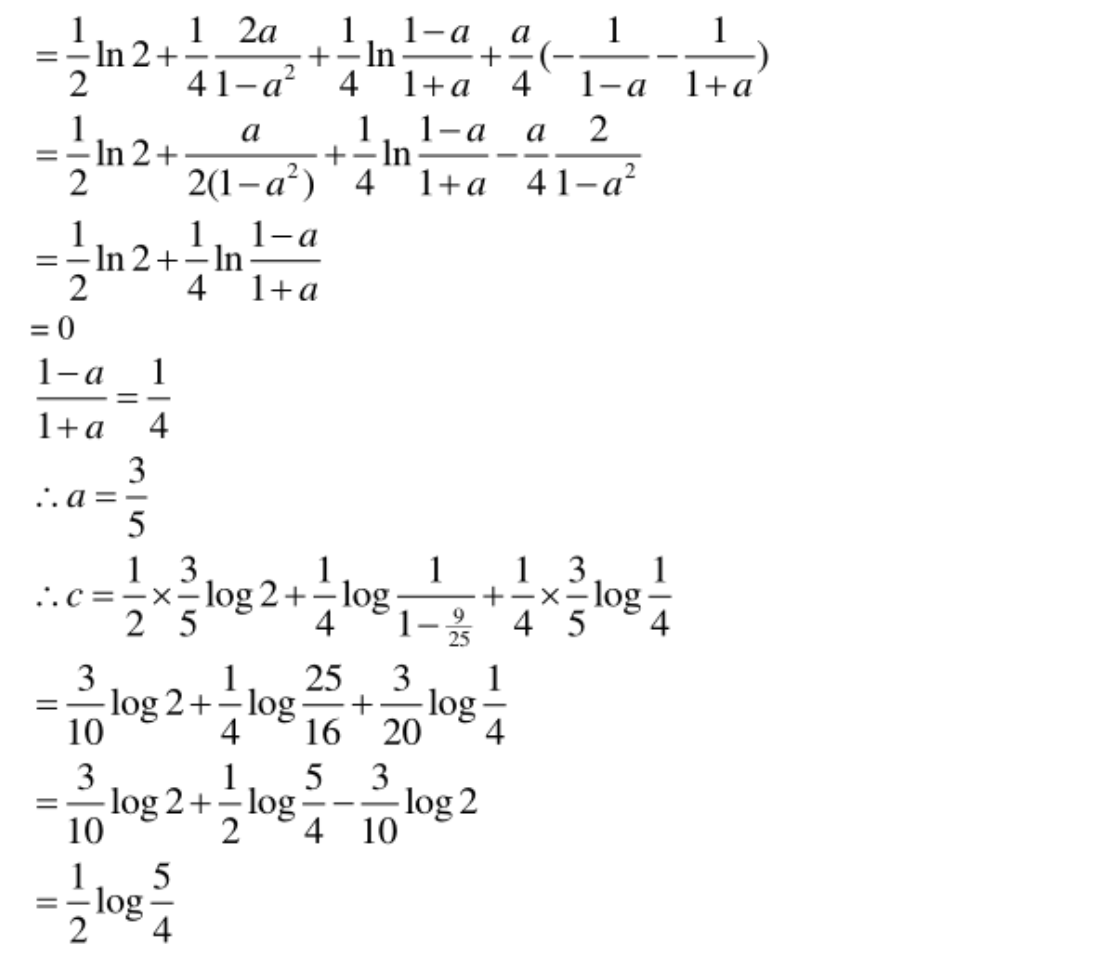

后香农时代,面向数学的十大挑战问题中与本课程有关的问题是:CD

?A、Massive MIMO 容量域问题

?B、网络基本业务模型问题

?C、有损压缩的极限问题(语义信息论)

?D、突破信源编码理论,挑战无损信源压缩极限

信息论的研究内容包括:ABC

?A、侠义信息论

?B、广义信息论

?C、一般信息论

?D、经典信息论?

农信息论的科学体系中包含:BCD

?A、无失真编码理论

?B、压缩理论

?C、传输理论????????

C、保密理论

数字通信系统模型主要部分由(ABC)和其他部分组成

?A、信源

?B、信道

?C、信宿

?D、噪声

某一事件的先验概率与其不确定度的关系是:B

?A、无关

?B、反比

?

?C、正比

?D、可逆

某事件的不确定度与信息量之间的关系是:B

?A、反比

?B、正比

?C、可逆

?D、无关

某事件的先验概率值与信息量的关系是:B

?A、无关

?B、反比

?C、正比

?D、线性

某一事物状态出现的概率越小,其不确定性越大。

A、大、大

B、小、小

C、小,大

D、大,小

某一事物状态出现的概率接近于1,即预料中肯定会出现的事件,那它的不确定性就接近于0。

?A、1,1

?B、1,0

?C、0,1

?D、0,0

1948年香农在《贝尔系统技术杂志》上发表了244页的长篇论著《通信的数学理论》

?A、牛顿

?B、爱因斯坦

?C、香农

?D、哈夫曼

当信源多个符号中有一个符号几乎必然出现,则该信源是一个确知信源,此信源的熵为:D

?A、1

?B、0.5

?C、0.1

?D、0

当信源符号的概率的顺序任意互换时,熵函数的值不变?,此性质称为熵函数的对称性。

?A、不变、对称性

?B、变大,互异性

?C、变大,对称性

?D、变小、线性

若信源X的符号个数为6,则其二次扩展信源的符号个数为:36

?A、12

?B、24

?C、36

?D、6

若离散无记忆信源X的熵为H(X),则该信源的N次扩展信源的熵等于:N*H(X)

?A、H(X)- N

?B、H(X)+ N

?C、N*H(X)

?D、H(X)

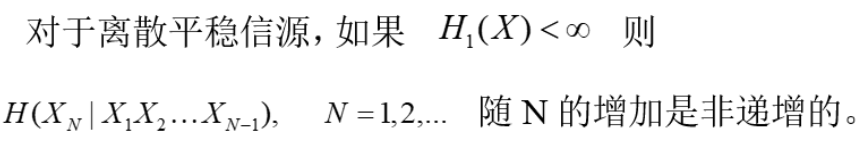

对于离散平稳有记忆信源来说,条件较多的熵必小于或等于条件较少的熵。

?A、小于或等于

?B、小于

?C、等于

?D、大于

马尔科夫(Markov)信源是一类相对简单的有记忆信源。

?A、香农信源

?B、费诺信源

?C、离散信源

?D、马尔科夫(Markov)信源

马尔可夫信源可以用状态转移图和状态转移概率矩阵来描述

?A、状态转移图

?B、协方差矩阵

?C、互相关矩阵

?D、误差矩阵

信源的冗余度的大小很好的反映信源符号间的相关性大小

?A、熵

?B、信息量

?C、冗余度

?D、不确定度

若信源中某事件发生的概率为1/8,则该事件还有的信息量为3bit

?A、1bit

?B、2bit

?C、3bit

?D、4bit

?判断:

?信息是指各个事物运动的状态及状态变化的方式。√

信息是抽象意识或知识,它是看不见、摸不到的。√

信息论是研究信息的基本理论,主要研究可能性和存在性问题,为具体实现提供理论基础。√

信息技术主要研究如何实现、怎样实现的问题。√

信息论是一门应用概率论、随机过程、数理统计和近代代数的方法,来研究信息传输、提取和处理系统中一般规律的学科。√

信息包含在信号之中,信号是信息的载体。通信的结果是消除或部分消除不确定性,从而获得信息。√

信息可以产生,也可以消失,同时信息可以被携带、贮存及处理;信息是可以量度的,信息量有多少的差别。√

离散信源的熵函数H(X)是严格上凸函数。√

? ?√

?√

香农定义的信息概念是一个科学的定义,有明确的数学模型和定量计算。√

一般简单的单符号离散信道的数学模型除用概率空间来描述,还可以用图来描述。√

从一事件提取关于另一事件的信息量,最多只有另一事件的信息熵那么多。√

连续信源的熵不具有非负性。√

信道的传递概率矩阵中任意一行的元素之和等于一。√

信道输入与输出之间的平均互信息是输入概率分布的上凸函数。√

对称离散信道的信道容量只与对称信道矩阵中的行矢量和输出符号集合的个数有关。√

二元对称信道是一种强对称信道。√

信道中平均每个符号所能传送的信息量,即为信道的信息传输率R。√

通过数据处理后,一般只会增加信息的损失。√

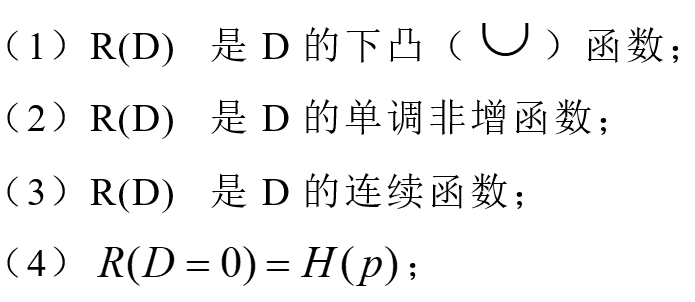

?对离散、单个消息限定失真信源,其R(D)函数满足下列性质。√

?![]() ?√

?√

只要码字传输的信息量大于信源序列携带的信息量,总可以实现无失真编码。√

非奇异的定长码是唯一可译码。√

信源编码可以提高信息传输的有效性。√

信源编码往往通过压缩信源的冗余度来提高信息传输速率的 。√

将信源符号按一定的数学规则映射成码符号序列的过程称为信源编码。√

从信息量来看,通过数据处理后会损失一部分信息,最多保持信源所提供的信息,此定理称为数据处理定理。√

信息是静止的,它不会消亡。X(信息不是静止的,它会产生也会消亡)

信息论不关心信息是否可以度量,他是直接研究有效地和可靠地传递信息的科学;它涉及信息量度,信息特性、信息传输速率、信道容量、干扰对信息传输的影响等方面的知识;X(信息论是在信息可以量度的基础上,研究有效地和可靠地传递信息的科学,它涉及信息量度、信息特性、信息传输速率、信道容量、干扰对信息传输的影响等方面的知识?)

在通信系统中,实际传输的是信号,亦其本质内容的就是信号。X(信息包含在信号之中,信号是信息的载体。通信的结果是消除或部分消除不确定性,从而获得信息)

信息的基本概念在于它的不确定性,任何已确定的事物都含有大量信息。X(信息的基本概念在于它的不确定性,任何已确定的事物都不含信息)

离散信源的熵函数H(X)可为负值。X(不可以为负数值)

对于离散平稳有记忆信源,若已知信源发出的符号越多,则下一符号发生的不确定性越大。X

随机事件进行合并处理后,使得获得的信息量减少。X

平均互信息可取正值,可取负值。X(平均互信息不小于零)

二元删除信道在实际中是不存在的。X

信道疑义度始终大于零。X

信道的传递概率矩阵中任意一列的元素之和等于一。X

对称离散信道的信道容量只与对称信道矩阵中的行矢量有关。X

信道的噪声熵始终为正。X

唯一可译码一定是即时码。X

即时码一定是唯一可译码。√

信源编码可以提高信息传输的可靠性。X??

大佬觉得有用的话点个赞 👍🏻 呗。

??????本人水平有限,如有纰漏,欢迎各位大佬评论批评指正!😄😄😄💘💘💘如果觉得这篇文对你有帮助的话,也请给个点赞、收藏下吧,非常感谢!👍 👍 👍

🔥🔥🔥任务在无形中完成,价值在无形中升华,让我们一起加油吧!🌙🌙🌙

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- Modeless dialog in html

- 【Webpack】模块打包 CommonJS和ES6 Module语法介绍

- 配置OSPF多区域,实现内网互通---实验

- 腾讯云特惠-云服务器62元/1年-腾讯云官网

- 内存数据库Redis 7.2性能优化经验技巧

- 抖音跳微信,实现原理是怎样的?

- 7. 分页插件

- Rocky Linux 9.3 安装 Jenkins 2.426.2 (超级详细版本)

- 36.MYSQL的外键(foreign key)

- Vue2 - Vue.observable 介绍