PyTorch深度学习实践 06.逻辑斯蒂回归

发布时间:2023年12月28日

最近在?B站 刘二大人 学习PyTorch ,上传一些学习用的代码,仅供参考和交流。

import numpy as np

import torch

import matplotlib.pyplot as plt

#定义数据集

x_data=torch.Tensor([[1.0],[2.0],[3.0]])

y_data=torch.Tensor([[0],[0],[1.0]])

#定义模型

class logisticRegressionModel(torch.nn.Module):

def __init__(self):

super(logisticRegressionModel,self).__init__()#调用父类的init

self.linear=torch.nn.Linear(1,1)#构造一个linear的对象,指定输入特征的维度和输出特征的维度

def forward(self,x):

y_pred=torch.sigmoid(self.linear(x))

return y_pred

model=logisticRegressionModel()#模型实例化

#构造损失函数和优化器

criterion=torch.nn.BCELoss(reduction='sum')#损失函数,不求均值

optimizer=torch.optim.SGD(model.parameters(),lr=0.01)#SGD优化器

#训练过程

epochs=[]

losses=[]

for epoch in range(1000):

y_pred=model(x_data)

loss=criterion(y_pred,y_data)

# print(epoch,loss.item())

epochs.append(epoch)

losses.append(loss.item())

optimizer.zero_grad()

loss.backward()

optimizer.step()

#显示训练结果

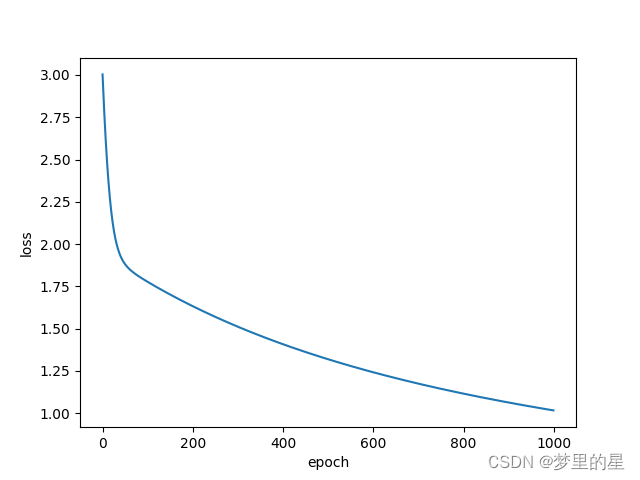

plt.figure(1)

plt.plot(epochs,losses)

plt.xlabel('epoch')

plt.ylabel('loss')

# plt.show()

#测试数据

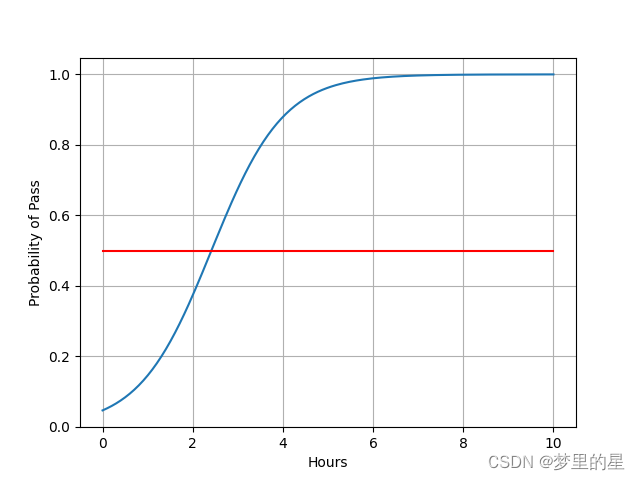

x=np.linspace(0,10,200)

# 将 NumPy 数组 x 转换为 PyTorch 的张量(tensor),并将其形状改变为 (200, 1)

x_t=torch.Tensor(x).view(200,1)#view函数用来改变张量的维度

y_t=model(x_t)

y=y_t.data.numpy()# 将 PyTorch 张量 y_t 转换为 NumPy 数组

plt.figure(2)

plt.plot(x,y)

plt.plot([0,10],[0.5,0.5],c='r')

plt.xlabel('Hours')

plt.ylabel('Probability of Pass')

plt.grid()#显示网络

plt.show()

训练过程中损失函数变化如下:

测试结果如下:

文章来源:https://blog.csdn.net/weixin_50094205/article/details/135254959

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!