elabRadio学习笔记4---信宿模块

?1.什么是信宿模块?

信宿模块(eSIM)是指嵌入式SIM卡,也被称为嵌入式通信模块(Embedded SIM)。它是一种不需要物理插卡的SIM卡技术,将SIM卡中的识别信息嵌入到设备的芯片中。与传统的物理SIM卡相比,eSIM具有更小的尺寸和更高的灵活性。

使用eSIM技术,用户可以通过网络连接直接将移动通信运营商的信息下载到设备的eSIM芯片中,从而完成激活和绑定操作,无需插卡或更换SIM卡。这使得用户可以更方便地切换运营商或在国际漫游时更轻松地连接到本地运营商的网络。

信宿模块通常内置在智能手机、平板电脑、智能手表、可穿戴设备和物联网设备等移动设备中。它为用户提供了更简单、更灵活的移动通信体验。

但在elabRadio中,并非上述概念,而是代表硬件上的终端,具体表现为视频播放终端,文本显示终端,音频播放终端。

2.elabRadio提供的模块:

视频播放终端:

视频播放终端通常指可用于播放视频内容的设备,如智能电视、电脑、手机、平板电脑等。这些设备通常具有播放视频的硬件和软件支持。

视频播放终端通常指可用于播放视频内容的设备,如智能电视、电脑、手机、平板电脑等。这些设备通常具有播放视频的硬件和软件支持。

输入的数据是什么?

视频播放终端输入的数据通常是视频文件。视频文件可以包含音频和视频流。视频播放终端会读取并解码视频文件中的数据,然后将其渲染在设备的屏幕上,同时播放其中的音频流。

通常,视频文件可以以多种格式存在,如MP4、AVI、MKV等。这些文件格式使用特定的编码算法将视频和音频流压缩,并以二进制数据的形式存储。视频播放终端会根据文件格式和编码算法来解码这些数据,以便正确地播放视频和音频。此外,一些视频播放终端还支持流媒体服务,如YouTube、Netflix等。在这种情况下,输入的数据并不是完整的视频文件,而是通过网络流式传输的视频数据。视频播放终端会从流媒体服务器获取视频数据,并动态地解码和播放。

视频播放终端的输入数据主要是视频文件或通过流媒体传输的视频数据。播放终端会对数据进行解码和渲染,以在设备上显示和播放视频内容。

详细讲一下使用特定的编码算法将视频和音频流压缩,并以二进制数据的形式存储的大致步骤;

要使用特定的编码算法将视频和音频流压缩,并以二进制数据的形式存储,您通常需要使用以下几个模块或组件:

1. 编码器(Encoder):编码器负责将原始视频和音频流转换成压缩格式。常见的视频编码器包括H.264(或称为AVC)、H.265(或称为HEVC)、VP9等,音频编码器包括AAC、MP3、Opus等。编码器压缩数据以减小文件大小并保持一定的质量。不太清楚的同学可以去看一下“elabRadio学习笔记3---信源编译码”

2. 压缩库或SDK(Software Development Kit):为了使用特定的编码算法,您可以使用相关的压缩库或SDK。例如,x264是一个开源的H.264视频编码库,libvpx是VP8和VP9视频编码库,而ffmpeg是一个流行的多媒体处理库,提供了多种编码和解码器。

3. 文件格式器(Container Format):文件格式器负责将压缩后的视频和音频流封装成特定的二进制文件格式。常见的视频文件格式包括MP4、AVI、MKV等,它们可以容纳各种编码的视频和音频流,并提供了相关的元数据和索引信息。

4. 存储模块:一旦视频和音频流经过编码和封装,您需要将其存储为二进制数据。您可以使用文件系统或数据库来存储这些二进制数据,具体取决于您系统的需求和设计。

怎么使用?

点击模块双击,即可打开。

文本显示终端:

文本显示终端是指能够显示文本内容的设备或应用程序。这些终端通常通过屏幕显示字符和字符串,使用户能够查看和阅读文本信息。

以下是一些常见的文本显示终端:

1. 终端仿真器:终端仿真器是一种软件应用程序,在计算机上模拟传统终端设备的功能。它们允许用户在屏幕上输入和输出文本,并与计算机系统进行交互。常见的终端仿真器包括Windows的命令提示符(CMD)和Unix/Linux的终端仿真器(如Terminal、GNOME Terminal等)。2. 控制台3. 文本编辑器和处理器4. 终端显示设备5. 电子阅读器

输入的数据是什么?

对于文本显示终端,输入的数据通常是文本内容。用户可以通过键盘或其他输入设备输入字符和字符串,以便在文本显示终端上进行显示和处理。

。

在仿真中,如果你需要进行文本内容的信号处理,你可能需要一些特定的模块或库,以便处理和分析文本数据。

以下是一些常见的用于文本信号处理的模块:

1. 自然语言处理库(NLP Libraries):像NLTK(Natural Language Toolkit)、spaCy、TextBlob等这样的自然语言处理库提供了一系列功能和工具,用于分词、词性标注、命名实体识别、文本分类等任务。

2. 机器学习库(Machine Learning Libraries):诸如Scikit-learn、TensorFlow、PyTorch等机器学习库提供了许多用于文本信号处理的算法和模型,如分类器、聚类算法、语言模型等。

3. 编码器/解码器模型库(Encoder/Decoder Libraries):如果你需要使用预训练的编码器/解码器模型,如BERT、GPT等,在仿真中,你可能需要相应的模型库来加载和使用这些模型,例如Hugging Face Transformers库。使用最多。

4. 文本预处理库(Text Preprocessing Libraries):对于文本预处理操作,如清洗文本、移除停用词、词干化、标准化等,你可以使用像NLTK、spaCy、TextBlob等库提供的功能。

5. 序列建模库(Sequence Modeling Libraries):如果你需要基于序列的建模,如循环神经网络(RNN)、长短时记忆网络(LSTM)、卷积神经网络(CNN)等,你可能需要一些机器学习库来实现这些模型。

6. 文本向量化库(Text Vectorization Libraries):当你需要将文本数据转换为数字向量表示时,可以使用诸如词袋模型(Bag-of-Words)、TF-IDF、Word2Vec、GloVe等模型或库进行文本向量化。

音频播放终端:

?

音频播放终端是指能够播放音频文件的设备或应用程序。它可以是以下几种形式的终端:

1. 个人电脑/笔记本电脑:现代的个人电脑/笔记本电脑通常配备了内置的扬声器和音频输出接口(如耳机插孔),可以通过安装音频播放软件(如Windows Media Player、iTunes、VLC等)来播放音频文件。

2. 智能手机/平板电脑:智能手机和平板电脑通常都具备音频播放功能,用户可以通过内置的扬声器或连接耳机等外部设备来播放音频文件。智能手机和平板电脑上通常会预装音频播放器应用(如Apple Music、Google Play Music等),也可以从应用商店下载其他音频播放器应用。

3. 数字音频播放器:数字音频播放器是专门用于播放音频文件的便携设备,例如iPod、MP3播放器、便携式CD播放器等。这些设备通常支持多种音频格式,并提供用户界面和控制按钮来选择和播放音频文件。

输入的数据是什么?

对于音频播放终端来说,输入数据通常是音频文件或音频流。具体来说:

1. 音频文件:音频文件是以数字形式存储的音频内容,可以是以各种格式(如MP3、WAV、AAC等)保存的音频数据。用户可以通过从本地存储设备(如计算机硬盘、手机存储等)导入音频文件到播放终端,然后使用播放终端播放这些文件中的音频内容。

2. 音频流:音频流是一种实时传输的音频数据,可以通过网络传输(如音频直播、在线音乐流媒体等)或通过输入设备(如麦克风)实时捕获的音频数据。用户可以通过音频播放终端接收和播放来自互联网上的音频流。

无论是音频文件还是音频流,它们都可以包含音乐、语音、对话、声效等各种类型的音频内容。

在音频播放终端中,这些输入数据会经过解码器进行解码,以还原音频信号,并通过内置扬声器或外部音频设备播放出来。用户可以通过播放绂端的界面或控制按钮来选择和控制音频的播放,例如调整音量、暂停/播放、跳转到特定时间点等操作。

如果要通过无线网络远程传输音频模拟信号,需要经历以下过程:

1. 模拟信号转换为数字信号:首先,音频的模拟信号需要经过模数转换器(ADC),将其转换为数字信号。这样可以方便地对音频信号进行数字信号处理和压缩,以便于在无线网络中传输和存储。

2. 数字信号压缩:接下来,数字音频信号可能需要进行压缩,以便于传输和存储。常见的音频格式(如MP3、AAC等)都使用了基于压缩算法的编码技术,通过减小音频文件大小和带宽,以满足在网络上和设备上进行传输和存储的需求。

3. 数据封装:接着,数字音频信号和其他相关的音频信息(如元数据、编码格式等)会被封装为网络包或数据包,以便于在网络中进行传输。常见的网络协议(如TCP、UDP等)都提供了相应的数据封装和传输机制。一般使用编码器。

4. 无线传输:封装好的数据包会经过无线信号传输,传输方式可能会根据不同的网络和硬件设备而有所不同。例如,Wi-Fi网络可以使用IEEE 802.11协议,蓝牙可以使用蓝牙协议等等。这些协议都利用了无线电波传输数据,可以跨越一定的距离和穿透物体障碍,使音频信号得以远程无线传输。

5. 数据解封:在接收端,接收到的数据包会被解封,获取音频信号和其他相关信息。得到的音频信号会经过解码器,将数字信号转换为模拟信号。同时,其他的音频信息(如元数据)也可以用于播放音频或显示音频信息。

6. 信号输出:最后,音频的模拟信号会经过扬声器、耳机等输出设备,在接收端播放出来。此时,无线传输的音频信号就已经实现了远程传输并在另一端成功输出。

在这里我只是提供了一个大致思路,仿真的做法过多,需根据实际情况进行选择对应的模块。

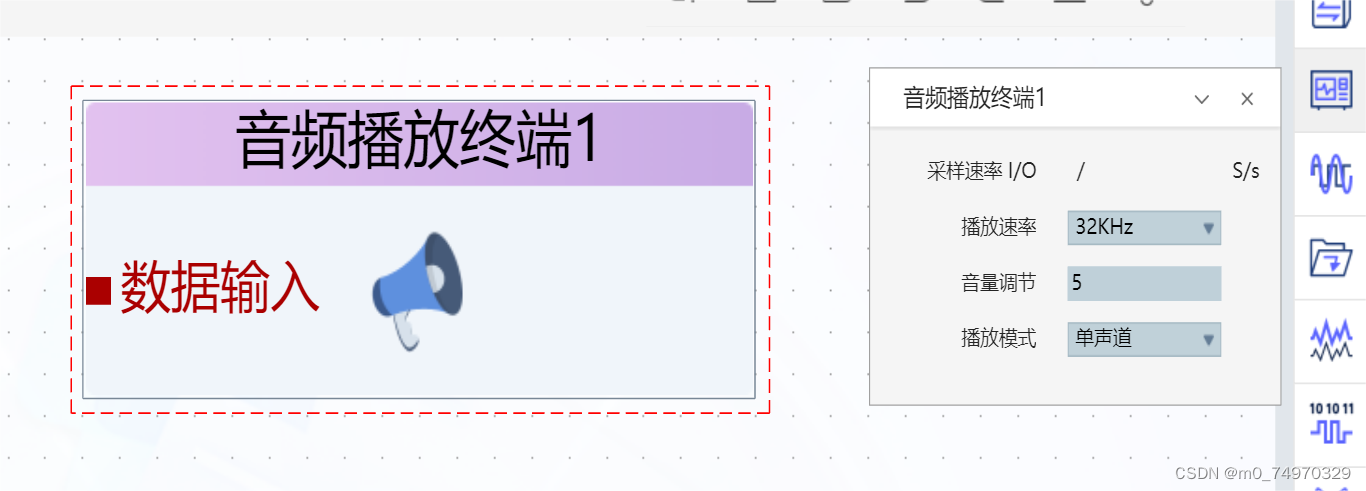

模块使用:

鼠标双击打开参数调节。

1.播放速率:

播放速率是指音频的播放速度,可以控制音频的快慢程度。常见的播放速率调节选项包括正常速度、加速播放(快进)和减速播放(慢放)。通过调整播放速率,用户可以根据自己的需求来进行音频的快速扫描或详细聆听。

2.音量调节:

音量调节是指调整音频的音量大小。播放终端通常提供音量控制功能,使用户能够增大或减小音频的音量。这可以通过控制终端的音量按钮、滑动条或声音控制键盘快捷键等方式来实现。音量调节可以帮助用户根据环境或个人喜好来调整音频的听觉效果。

3.播放模式:

分为:单声道(Mono)和立体声(Stereo)

单声道

指的是音频信号或音频设备只有一个声道,因此只有一路音频信号被采集和播放。单声道音频可以传递感觉到的声音和基本的音频信息,但无法提供立体声场效果,因为在单声道音频中只有一个声道,音频信号没有左右分离。

立体声

指的是音频信号或音频设备具有两个声道(左声道和右声道),因此能够提供比单声道更真实、更丰富、更立体的音效,在播放过程中可以使听众感受到音乐和声效在空间上的分布和方向,实现更具沉浸感的音频体验。

目前,立体声已成为标准的音频格式,并被广泛应用于多媒体制作、音乐演出、电影配乐、游戏音效等领域。然而,对于一些应用场景中,比如电话会议、语音导航等,由于立体声需要更多的带宽和资源,还需要考虑一些设备兼容性和技术复杂性等问题,因此单声道的使用仍然较为常见。

由于本人非通信专业,只是暂做竞赛使用,帮助自己快速使用上手elabradio所作笔记。如有错误,请多海涵。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- CSGO服务器搭建细节

- 机器学习系列10:数据预处理——特征缩放

- 图解python | 基础数据类型

- Simply简洁博客主题源码 | EmlogPro主题模版

- 【一分钟】ThinkPHP v6.0 (poc-yaml-thinkphp-v6-file-write)环境复现及poc解析

- 干货|移动端App自动化之触屏操作自动化

- Dokit 开源库:简化 Android 应用开发的利器

- 编译时AndroidX冲突报错

- 15 Linux 按键

- 在Jetpack Compose中使用ExoPlayer实现直播流和音频均衡器