精选11篇顶会论文,深度学习时间序列预测模型汇总!(含2024最新)

在当前这个数据为王的时代,时间序列预测技术在金融市场分析、医疗诊断、气象预报等多个重要领域中扮演着关键角色。而深度学习,作为人工智能领域的一个重要分支,它强大的算法和模型为我们解决复杂多变的时间序列预测问题提供了前所未有的有力工具。

本文精心汇总了11篇深度学习时间序列预测模型的顶会论文,涵盖基于递归神经网络(RNN)、卷积神经网络(CNN)、Transformer架构以及多元时序预测等多种类型的模型。这些论文不仅代表了该领域的最新研究进展,而且为我们提供了关于如何有效利用深度学习进行时间序列预测的新思路和方法。

? RNN时序预测模型??

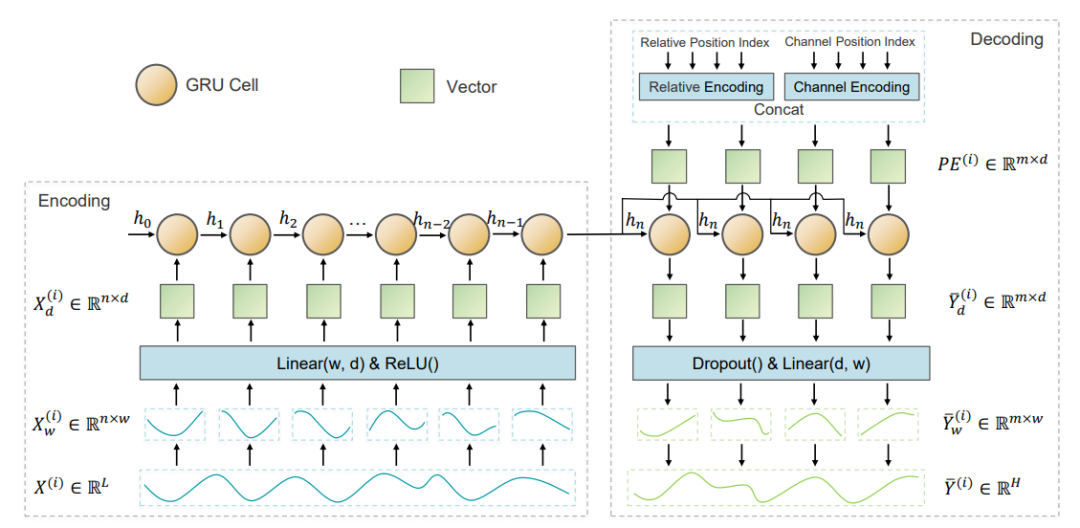

1、SegRNN: Segment Recurrent Neural Network for Long-Term Time Series Forecasting(ICLR 2024)

SegRNN:用于长期时间序列预测的分段递归神经网络

简述:本文提出了两种创新策略,即分段迭代和并行多步预测(PMF),以减少RNN在长期时间序列预测(LTSF)任务中的循环迭代次数。通过整合这些策略,研究人员开发了一种新的RNN变体,称为SegRNN。实验结果表明,SegRNN不仅提升了预测的准确性,还显著加快了推理速度,并且在运行时间和内存使用上相比基于Transformer的模型减少了78%以上。

2、WITRAN: Water-wave Information Transmission and Recurrent Acceleration Network for Long-range Time Series Forecasting(NeurIPS 2023)

Witran:用于长期时间序列预测的水波信息传输和递归加速网络

简述:本文提出了一种新型水波信息传输(WIT)框架,它通过双粒度捕获长短期重复模式,并利用水平垂直门控选择单元(HVGSU)处理全局和局部信息。为提升效率,研究人员还设计了循环加速网络(RAN),降低了时间复杂度。综合这两点,这种方法WITRAN在四个数据集上的长程和超长程时间序列预测均显著优于现有方法,提升幅度分别为5.80%和14.28%。

CNN时序预测模型??

3、Towards Better Forecasting by Fusing Near and Distant Future Visions(AAAI 2020)

通过融合近距离和远距离的未来视觉来实现更好的预测

简述:本文提出了多层次解释神经网络(MLCNN),一种新的多任务深度学习框架,该模型结合了卷积神经网络和改进的编码器-解码器架构,通过融合不同时间点的预测信息来提升预测性能。结合自回归模型,MLCNN在真实数据集上的表现优于现有技术,RMSE和MAE指标分别平均降低了4.59%和6.87%。

Transformer时序预测模型??

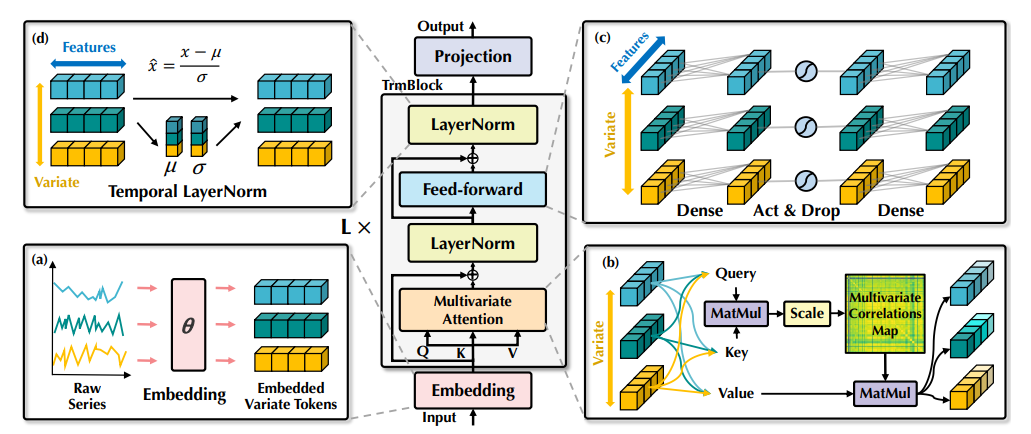

4、iTransformer: Inverted Transformers Are Effective for Time Series Forecasting(ICLR 2024)

iTransformer:反相变压器对时间序列预测有效

简述:本文提出了iTransformer模型,通过将时间序列中的每个变量独立嵌入为变量子token,并应用自注意力机制和前馈网络来学习非线性表示,有效地捕捉多变量相关性并提高预测性能。iTransformer在具有挑战性的真实数据集上实现了最先进的技术,增强了Transformer系列的性能、泛化能力以及对任意回溯窗口的利用,使其成为时间序列预测的基本支柱。

5、Multi-scale Transformers with Adaptive Pathways for Time Series Forecasting(ICLR 2024)

具有自适应路径的多尺度变换器用于时间序列预测

简述:本文提出了Pathformer,一种具有自适应通路的多尺度Transformer模型,用于时间序列预测。该模型通过将时间序列划分为不同尺度的斑块并进行双重注意力机制,捕捉全局和局部特征。自适应路径进一步优化了多尺度建模过程,提升了预测精度和泛化性。实验证明,Pathformer在多个真实数据集上超越了当前所有模型,展现了卓越的性能和泛化能力。

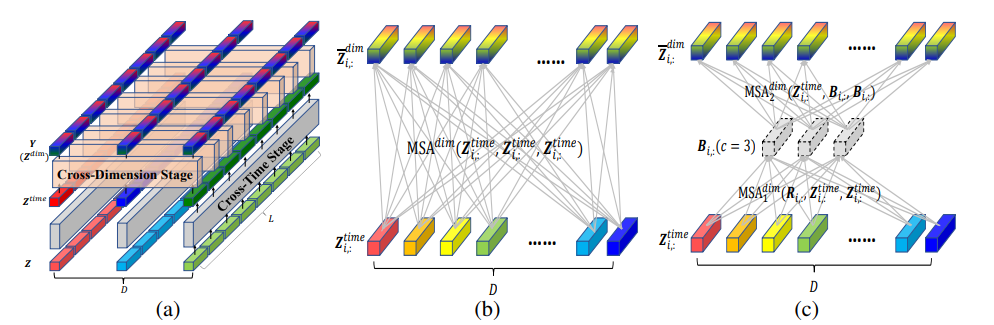

6、Crossformer: Transformer Utilizing Cross-Dimension Dependency for Multivariate Time Series Forecasting(ICLR 2023)

Crossformer:利用跨维依赖进行多变量时间序列预测的转换器

简述:本文提出了一种基于Transformer的模型Crossformer,专为多变量时间序列(MTS)预测而设计,它通过DSW嵌入方法将MTS数据转为2D阵列,并使用两阶段注意力(TSA)层捕捉时间和跨维度依赖。该模型采用了分层编码器-解码器(HED)框架,以便有效地利用不同尺度的信息进行预测。实验结果表明,Crossformer 在真实世界数据集上的表现优于之前的技术。

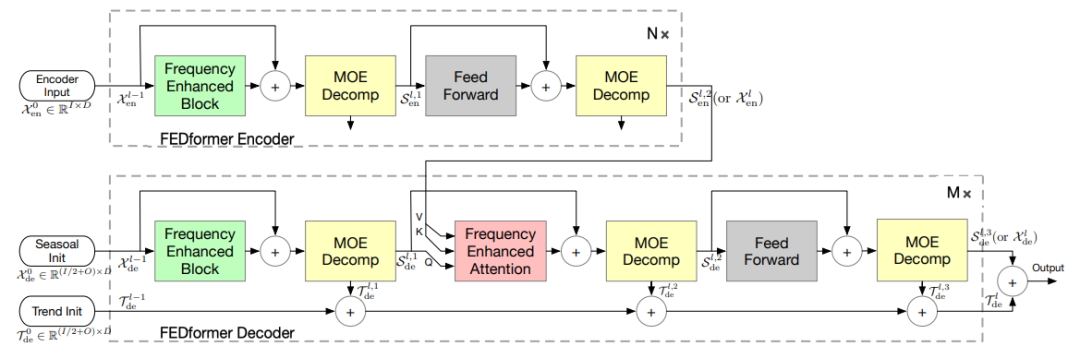

7、FEDformer: Frequency Enhanced Decomposed Transformer for Long-term Series Forecasting(ICML 2022)

FEDformer:用于长期序列预测的频率增强型分解变压器

简述:本文提出了一种新的时间序列预测方法FEDformer,结合了Transformer和季节性趋势分解,以捕捉时间序列的全局趋势和细节结构。利用时间序列在傅里叶变换中的稀疏表示,FEDformer提高了长期预测的效率和准确性,具有线性复杂度。实验显示,FEDformer在多变量和单变量时间序列预测上的表现优于现有技术,显著降低了预测误差。

多元时序预测模型??

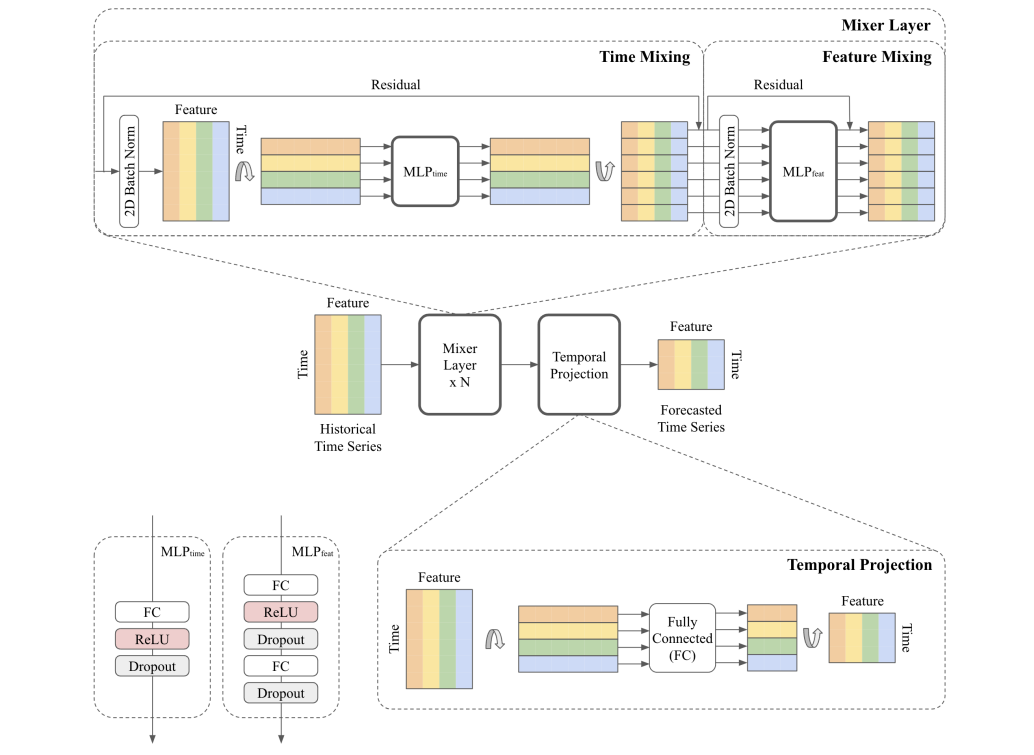

8、TSMixer: An all-MLP Architecture for Time Series Forecasting(KDD 2023)

TSMixer:用于时间序列预测的全 MLP 架构

简述:本文研究了线性模型在时间序列预测中的应用,并介绍了新型架构——时间序列混频器(TSMixer),它采用多层感知器(MLP)堆叠设计,通过混合时间和特征维度信息来高效提取数据特征。在多个基准测试中,TSMixer的简单实现与专用于特定任务的先进模型相当,甚至在真实零售数据集M5上超越了其他最先进模型。

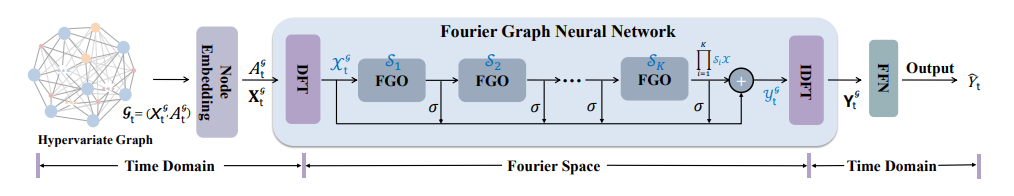

9、FourierGNN:Rethinking Multivariate Time Series Forecasting from a Pure Graph Perspective(NeurIPS 2023)

FourierGNN:从纯图的角度重新思考多变量时间序列预测

简述:本文提出了傅里叶图神经网络(FourierGNN),一种新的多变量时间序列预测方法,通过将每个序列值视为图节点并将滑动窗口表示为时空全连接图,统一考虑时空动态。FourierGNN通过堆叠文中提出的傅里叶算子(FGO)在傅里叶空间中执行矩阵乘法,具有低复杂度和高效的表达能力。实验结果表明,FourierGNN在预测性能、效率和参数数量上优于最先进的方法。

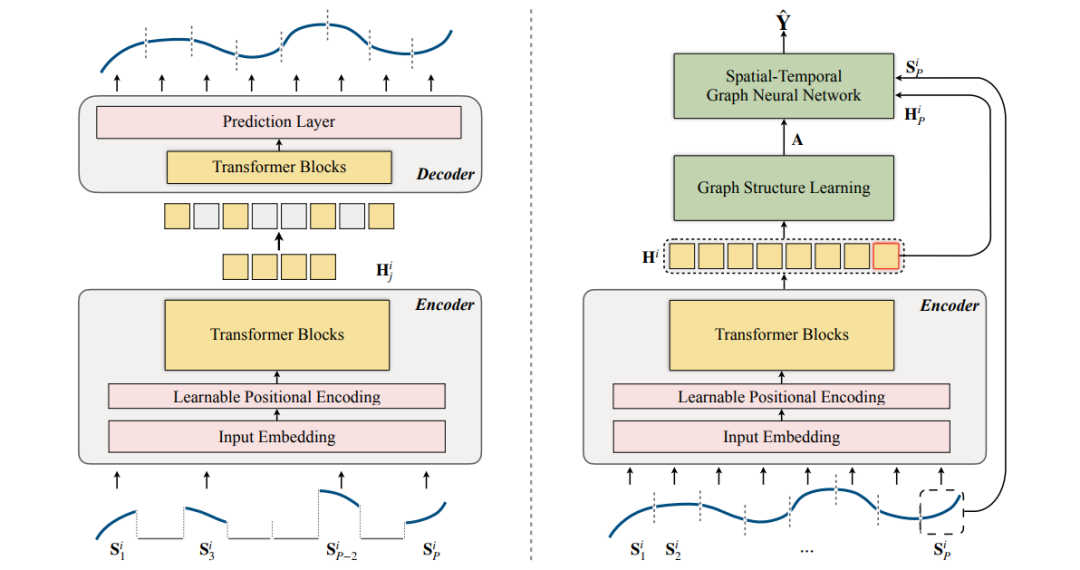

10、Pre-training Enhanced Spatial-temporal Graph Neural Network for Multivariate Time Series Forecasting(KDD 2022)

面向多变量时间序列预测的预训练增强时空图神经网络

简述:本文提出了一种新的框架,通过可扩展的时间序列预训练模型(STEP)增强时空图神经网络(STGNNs),以处理长期历史时间序列数据。STEP模型从过去两周的历史数据中学习时间模式,生成片段级表示,为STGNNs提供上下文信息,促进时间序列依赖关系的建模。实验表明,这个框架显著增强了STGNNs的性能,预训练模型有效地捕获了时间模式。

11、Connecting the Dots: Multivariate Time Series Forecasting with Graph Neural Networks(KDD 2020)

连接点:多元时间序列预测与图神经网络

简述:本文提出了一种针对多变量时间序列数据设计的通用图神经网络框架,通过图学习模块自动提取变量间的单向关系,并允许集成外部知识。该方法结合了混合跳跃传播层和膨胀起始层,以捕获时间和空间依赖性。实验结果显示,该模型在多个基准数据集上优于最先进的方法,并在提供额外结构信息的交通数据集上与其他方法性能相当。

码字不易,欢迎大家点赞评论收藏!

关注下方《享享学AI》

回复【深度学习时间序列预测】获取完整论文

👇

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 小程序中使用wx.previewImage实现图片预览与缩放

- 常见的hooks

- R语言【paleobioDB】——pbdb_taxon():通过名称或标识符,获得一个类群名的基本信息

- ORACLE 11G 内置库详解

- Mistral AI发布开放权重的高质量SMoE模型Mixtral 8x7B

- matlab appdesigner系列-常用13-标签

- SpringBoot整合JWT+Spring Security+Redis实现登录拦截(一)

- 计网自顶向下(多线程Web代理服务器)

- PHP分类信息网站源码商业运营版+完整的代码包+完整的搭建教程

- 高性价比、低价云服务器云主机推荐,这几款腾讯云服务器价格很划算