用Audio2Face驱动UE - MetaHuman

发布时间:2024年01月03日

????????新的一年咯,很久没发博客了,就发两篇最近的研究吧。

开始之前说句话,别轻易保存任何内容,尤其是程序员不要轻易Ctrl + S

在UE中配置Audio2Face

- 先检查自身电脑配置看是否满足,按最小配置再带个UE可能会随时崩,按推荐来带个UE可能会略有小卡(亲身体会)。

- 下载 Omniverse Develop on NVIDIA Omniverse Platform | NVIDIA Developer

- 之后下载Audio2Face,如果在第三步找不到该应用,则到第四步搜索

- 找到Audio2Face下和UE的相关插件(audio2face-ue-plugins),拷贝到UE - Plugins文件夹下(选择和UE版本相匹配的)。路径如下:

安装路径\audio2face-2023.2.0\ue-plugins\audio2face-ue-plugins

- 接着打开Audio2Face插件,并重启UE

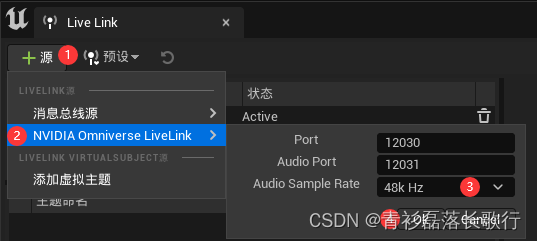

- 打开LiveLink(该插件默认开启,没开启自己开一下),增加一个NVIDIA Omniverse Live Link源,调整为48k Hz

-

至此,配置完成

开启Audio2Face驱动

- 启动Audio2Face,并且下载亚洲人相关模型

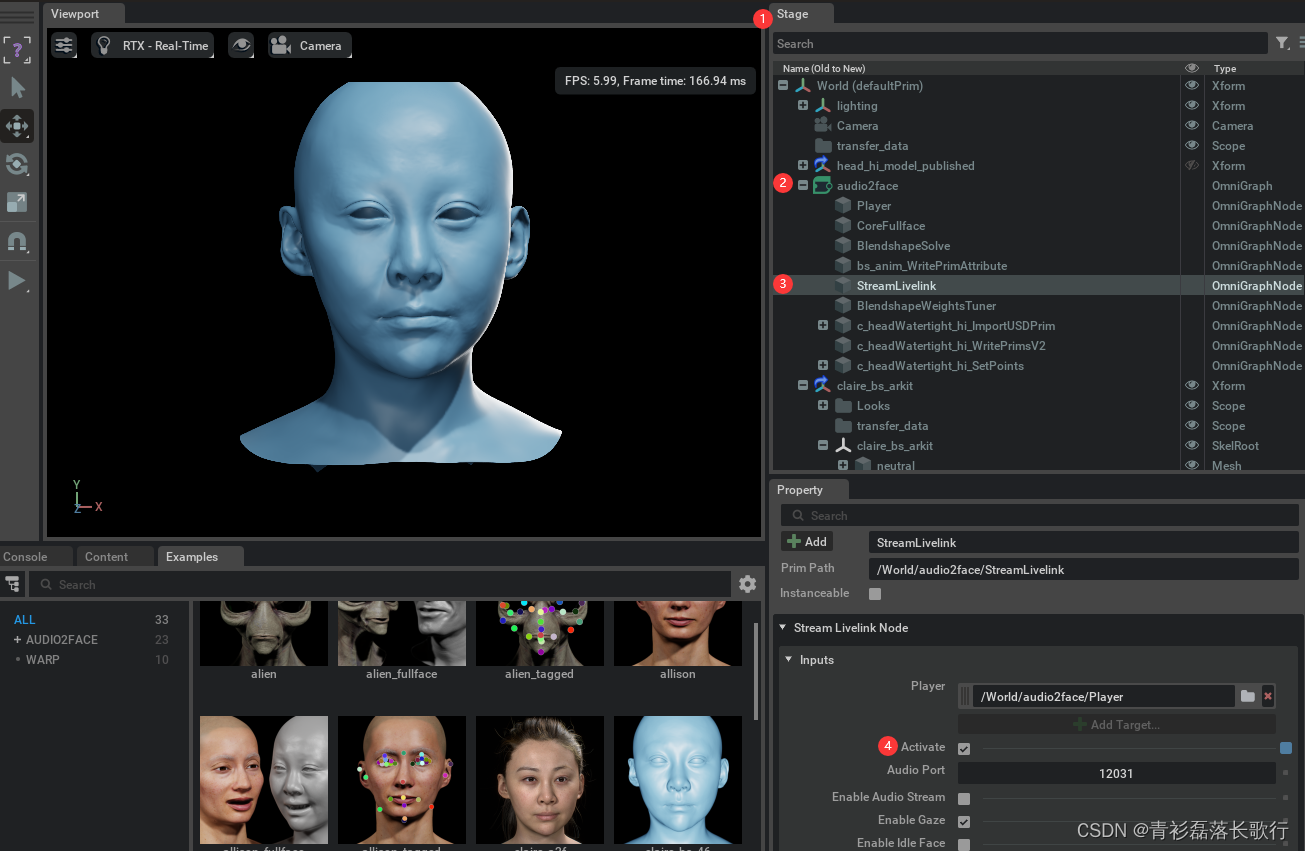

- 激活流链接

- 回到UE找到MetaHuman的模型,在Live Link面板下,选择Face Subj 为 Audio2Face(如果这里没有找到,则检查是否更改了端口号、或者重启一下Audio2Face),并且开启Use ARKit Face。

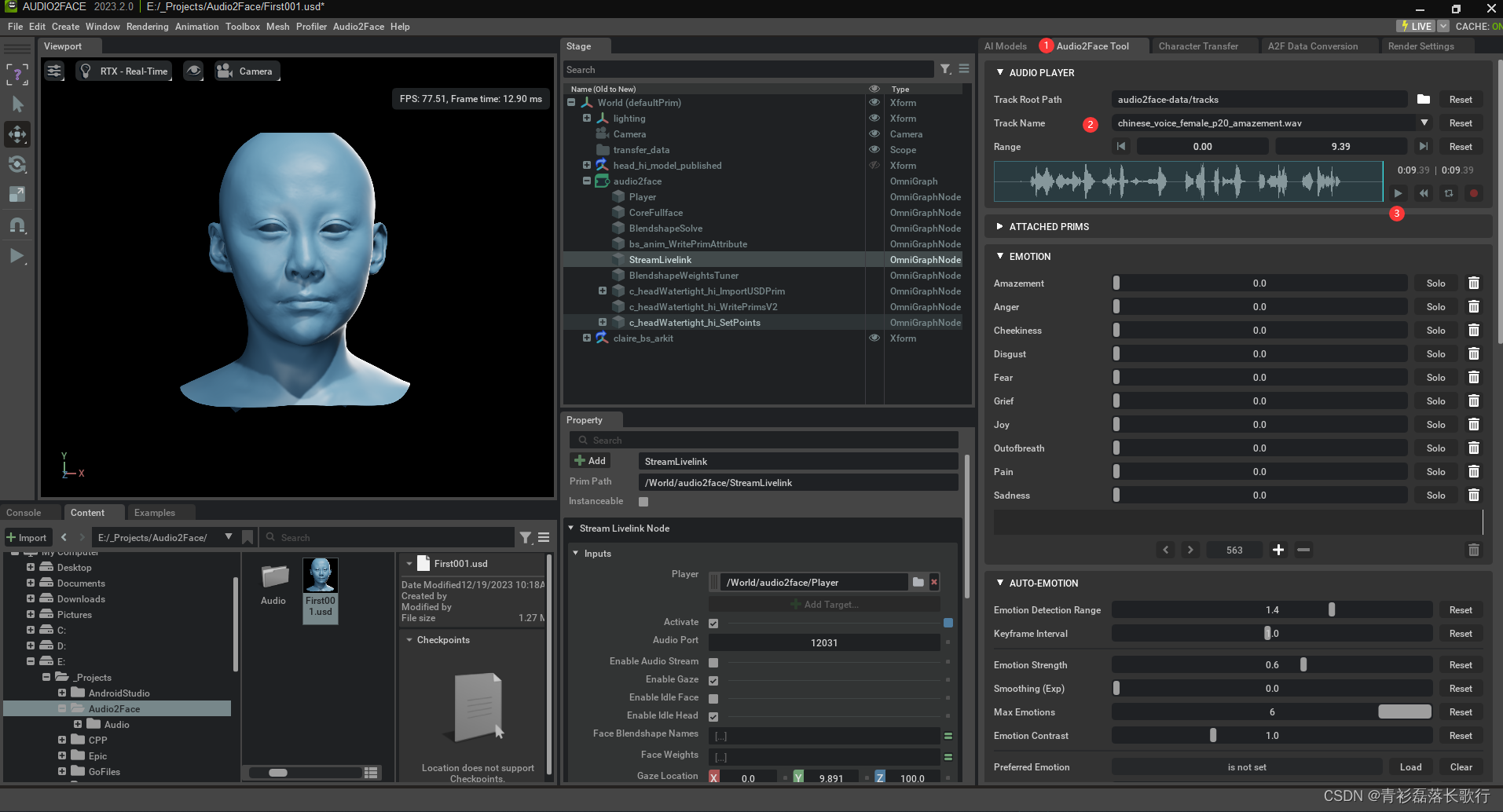

- 接着再回到Audio2Face,选择Audio2Face Tool面板,随便选择一个音轨进行播放

- 同时看UE,发现MetaHuman人物模型的面部也跟着动了起来,我就不给大家放动图了,太卡了。(原谅我俩屏幕一横一竖)

- 在Audio2Face Tool面板下,大家可以看到设置选项条,很多很多,都可以自己尝试着调一下试试

- 好了,彻底完成了,后一篇等我整理完毕我再发布。发布之后我会把链接放到这里

文章来源:https://blog.csdn.net/Wenhao_China/article/details/135369976

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- uniapp点击事件报错 Cannot read property ‘stopPropagation‘ of undefined

- 初二英语语法汇总

- 普通人想通过抖音赚钱要先知道这4点

- Jenkins 还可以支持钉钉消息通知?一个插件带你搞定!

- DS18B20温度传感器

- MySQL和 Oracle查看表信息

- 麒麟KYLINOS|通过不同方法设置用户访问文件及目录权限

- c++静态数据成员

- 15张超级有用的电商模版

- 【C++】__declspec含义