【书生·浦语大模型实战营第6课】OpenCompass大模型评测

一、关于大模型评测的三个问题:Why,What,How

-

问题一、为什么需要评测(Why)

- 比较不同大模型间的优劣

- 探索模型能力提升的边界

- 真实应用场景的效果评估

-

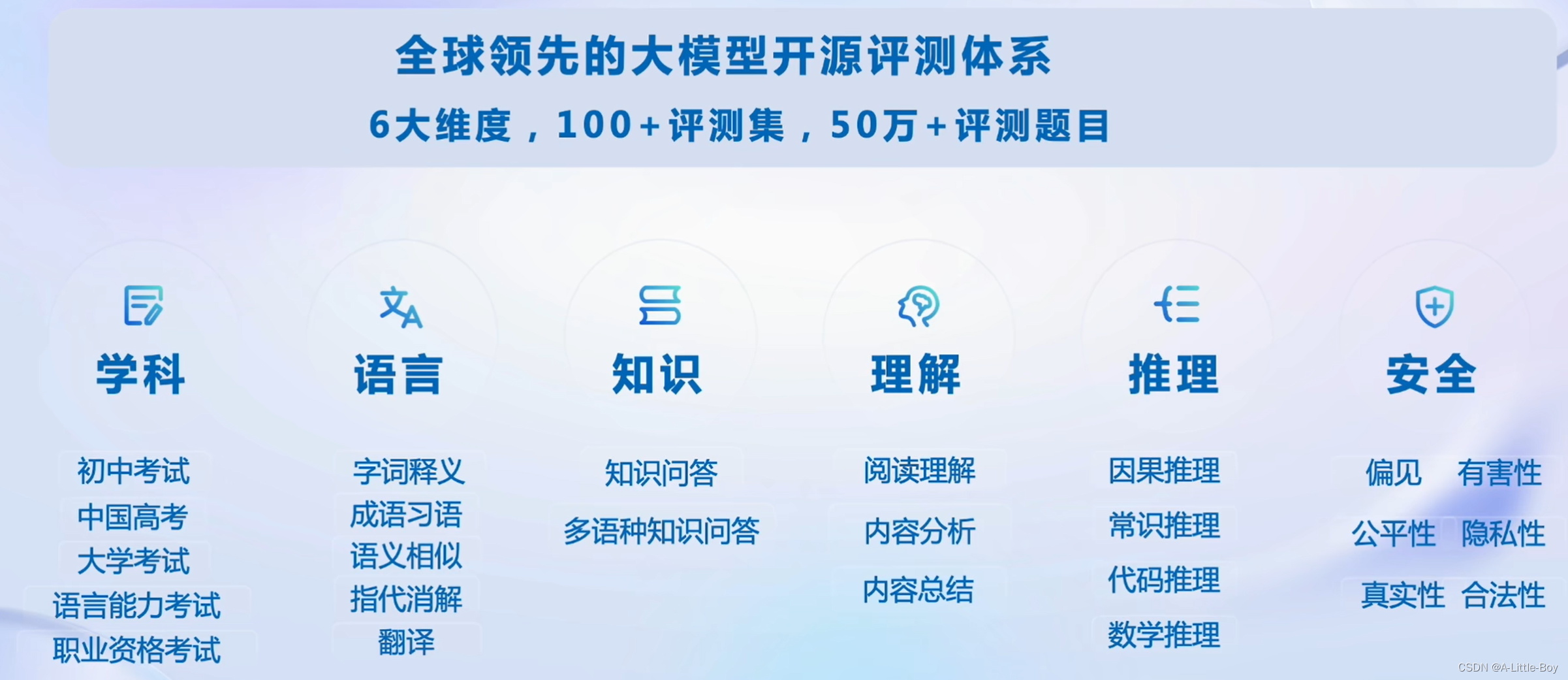

问题二、评测什么(What)

- 知识、推理、语言

- 长文本、智能体、多轮对话

- 情感、认知、价值观

-

问题三、如何评测?(How)

- 客观评测:问答题、多选题、判断题、分类题等

- 主观评测:人工评价、模型评价

-

现有的主流大模型评测框架

- 加州大学伯克利分校提出了MMLU测试集,构建了涵盖高中和大学的多项考试,来评估模型的知识能力和推理能力。

- 谷歌也提出了包含数理科学,编程代码,阅读理解,逻辑推理等子任务的评测集Big-Bench,涵盖200多个子任务,对模型能力进行系统化的评估。

- 国内的学术机构也提出了如CLUE,CUGE等评测数据集,从文本分类,阅读理解,逻辑推理等方面评测语言模型的中文能力。

-

OpenCompass介绍

OpenCompass提供设计一套全面、高效、可拓展的大模型评测方案,对模型能力、性能、安全性等进行全方位的评估。OpenCompass提供分布式自动化的评测系统,支持对(语言/多模态)大模型开展全面系统的能力评估。

-

OpenCompass开源评测平台架构

-

模型层:大模型评测所涉及的主要模型种类,OpenCompass以基座模型和对话模型作为重点评测对象。

- 基座模型:一般是经过海量的文本数据以自监督学习的方式进行训练获得的模型往往具有强大的文字续写能力。

- 对话模型:一般是在的基座模型的基础上,经过指令微调或人类偏好对齐获得的模型,能理解人类指令,具有较强的对话能力。

-

能力层:OpenCompass从本方案从通用能力和特色能力两个方面来进行评测维度设计。在模型通用能力方面,从语言、知识、理解、推理、安全等多个能力维度进行评测。在特色能力方面,从长文本、代码、工具、知识增强等维度进行评测。

-

方法层:OpenCompass采用客观评测与主观评测两种评测方式。客观评测能便捷地评估模型在具有确定答案(如选择,填空,封闭式问答等)的任务上的能力,主观评测能评估用户对模型回复的真实满意度,OpenCompass采用基于模型辅助的主观评测和基于人类反馈的主观评测两种方式。

-

工具层:OpenCompass提供丰富的功能支持自动化地开展大语言模型的高效评测。包括分布式评测技术,提示词工程,对接评测数据库,评测榜单发布,评测报告生成等诸多功能。

-

-

OpenCompass评测流水线设计

-

在 OpenCompass 中评估一个模型通常包括以下几个阶段:配置 -> 推理 -> 评估 -> 可视化。

-

配置:这是整个工作流的起点。您需要配置整个评估过程,选择要评估的模型和数据集。此外,还可以选择评估策略、计算后端等,并定义显示结果的方式。

-

推理:推理阶段主要是让模型从数据集产生输出

-

评估:评估阶段则是衡量这些输出与标准答案的匹配程度。

-

可视化:将评估结果整理成易读的表格,并将其保存为 CSV 和 TXT 文件。

-

二、实操部分

使用 OpenCompass 评测 InternLM2-Chat-7B 模型在 C-Eval 数据集上的性能

- 创建环境

bash

conda create --name opencompass --clone=/root/share/conda_envs/internlm-base

conda activate opencompass

git clone https://github.com/open-compass/opencompass

cd opencompass

pip install -e .

- 数据准备

# 解压评测数据集到data/处

cp /share/temp/datasets/OpenCompassData-core-20231110.zip /root/opencompass/

unzip OpenCompassData-core-20231110.zip

# 将会在opencompass下看到data文件夹

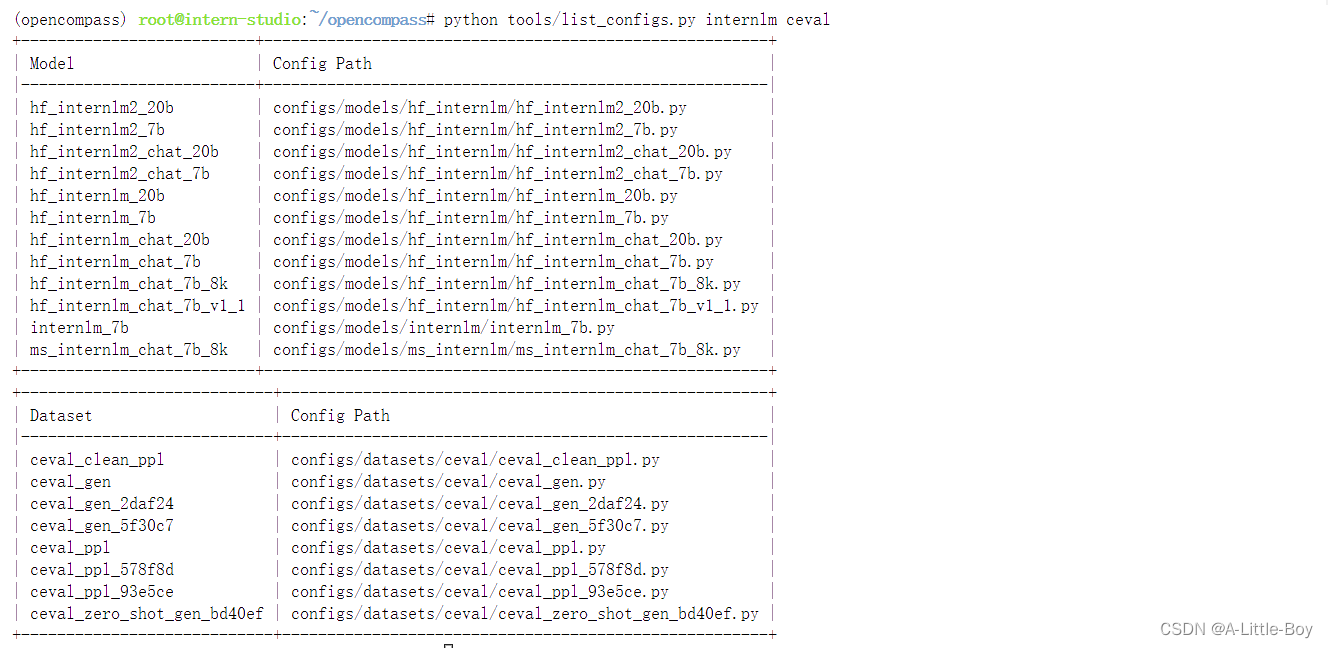

- 查看支持的数据集和模型

python tools/list_configs.py internlm ceval

- 启动评测

python run.py \

--datasets ceval_gen \

--hf-path /root/share/model_repos/internlm2-chat-7b/ \

--tokenizer-path /root/share/model_repos/internlm2-chat-7b/ \

--tokenizer-kwargs padding_side='left' truncation='left' trust_remote_code=True \

--model-kwargs trust_remote_code=True device_map='auto' \

--max-seq-len 2048 \

--max-out-len 16 \

--batch-size 4 \

--num-gpus 1 \

--debug

- 可视化评估结果

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- java面试题-Spring常见的异常类有哪些?

- 【计算机毕业设计】基于Springboot的网上购物商城销售系统

- 数码管不同位显示不同的数字

- 一天吃透计算机网络面试八股文

- PyCharm安装插件后重启报错:java.lang.RuntimeException

- linux系统使用POSIX信号量实现多线程同步sem_init sem_wait sem_post sem_destroy

- 武汉CCRC认证初次申请的流程指南

- 道排技术标书:引领交通工程的未来

- 5个免费视频绿幕、特效素材网

- API 安全设计的建议