大模型实战营Day3 基于 InternLM 和 LangChain 搭建你的知识库

发布时间:2024年01月13日

LLM的局限性: 知识时效性,专业能力,定制化成本

两种大模型开发范式: RAG FineTune

RAG: 检索问答生成 外挂知识库 成本低

FineTune: 更新成本高 GPU算力要求高

RAG开发框图: 用户输入 文本向量化 匹配相似文本段

LangChain框架介绍

开源工具 提供LLM通用接口 简化应用程序开发

核心组件: 链(chains) 例如 检索问答链 覆盖RAG的全部流程

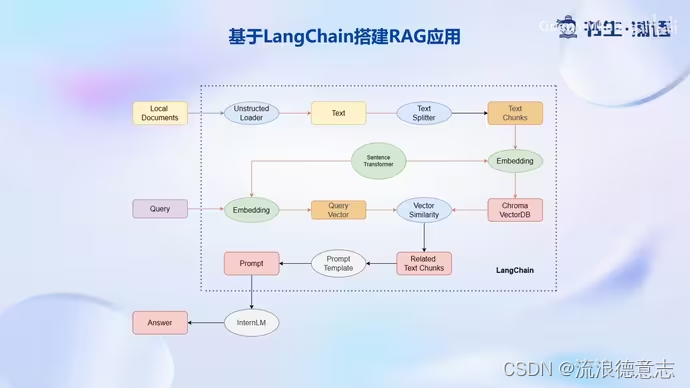

基于LangChain搭建RAG应用

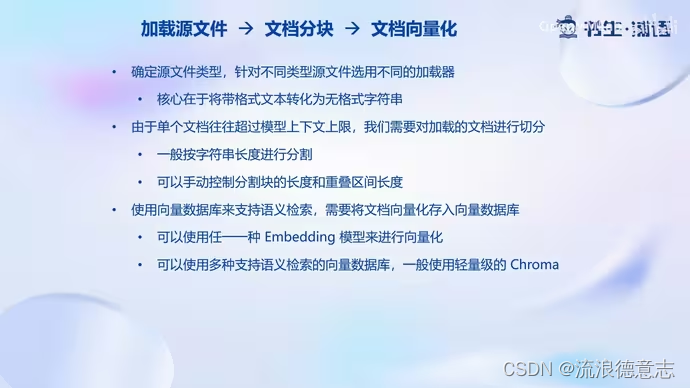

加载源文件 文档分块 文档向量化

InternLM接入LangChain

向量数据库构建

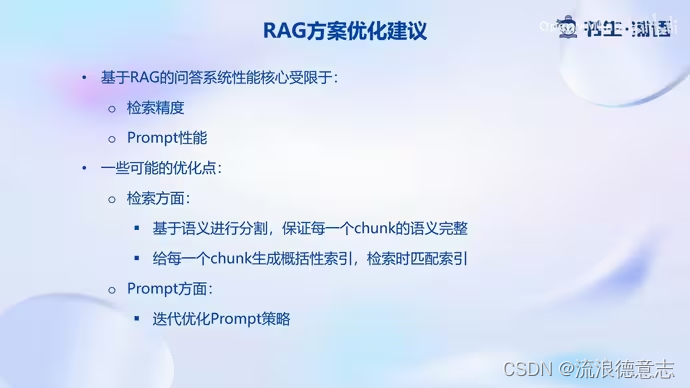

基于RAG问答系统可能的优化点: 检索方向 Prompt

文章来源:https://blog.csdn.net/li4692625/article/details/135565829

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- Python机器学习原理与算法实现中绘制散点图和线图的操作

- C语言学习记录—进阶作业(通讯录静态版本)

- FPGA与ASIC有什么差异?二者该如何选用?

- 源码编译安装 LAMP

- 海凌科HLK-V2语音识别模块更新词条

- ArrayBlockingQueue

- 2024 年 SEO 您需要了解的 8 个关键 SEO 趋势

- ChatGPT:你真的了解网络安全吗?浅谈攻击防御进行时之传统的网络安全

- Faster R-CNN

- openresty介绍、安装、使用