李沐之池化层

发布时间:2024年01月11日

目录

1.池化层原理

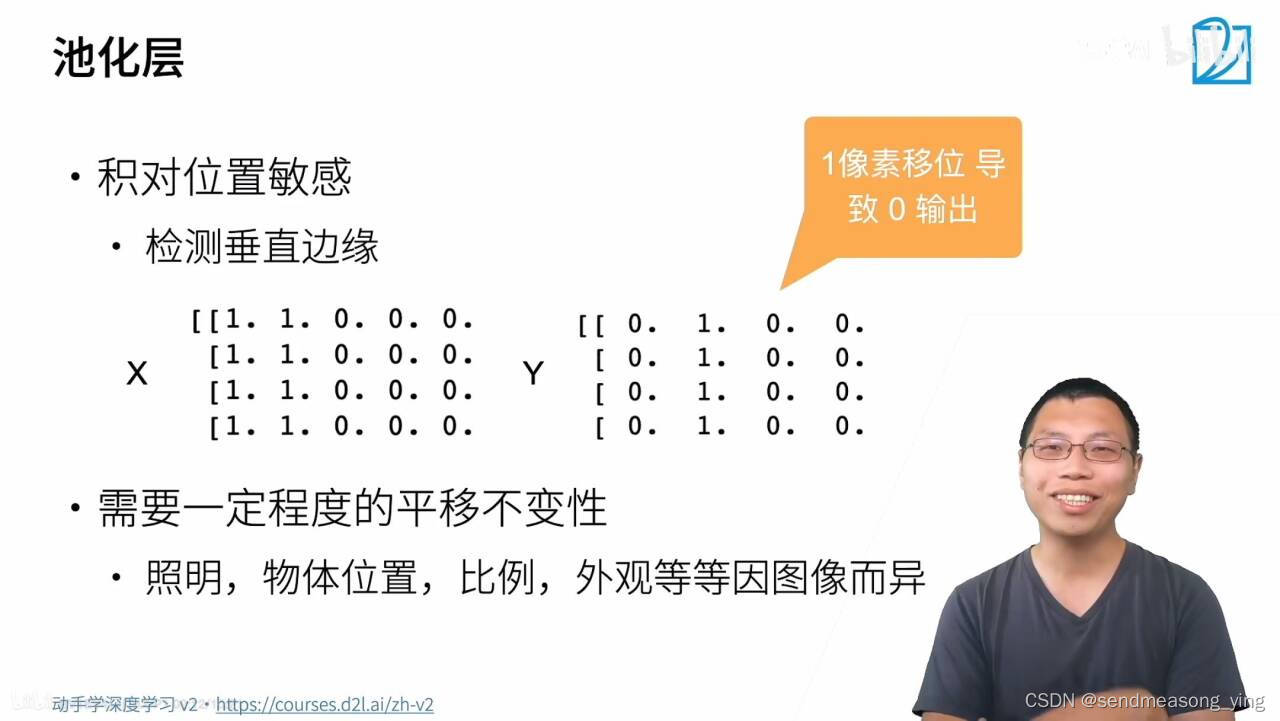

卷积对位置的变化非常敏感,一个像素的变化就会导致0输出,边缘在真实图片中不是正好就夹在那个地方,相机抖动,物体抖动都会使像素发生变化。因此需要一定的平移不变性,就是说物体有稍微的改动在原来那个像素点,那个位置的值还是不变。

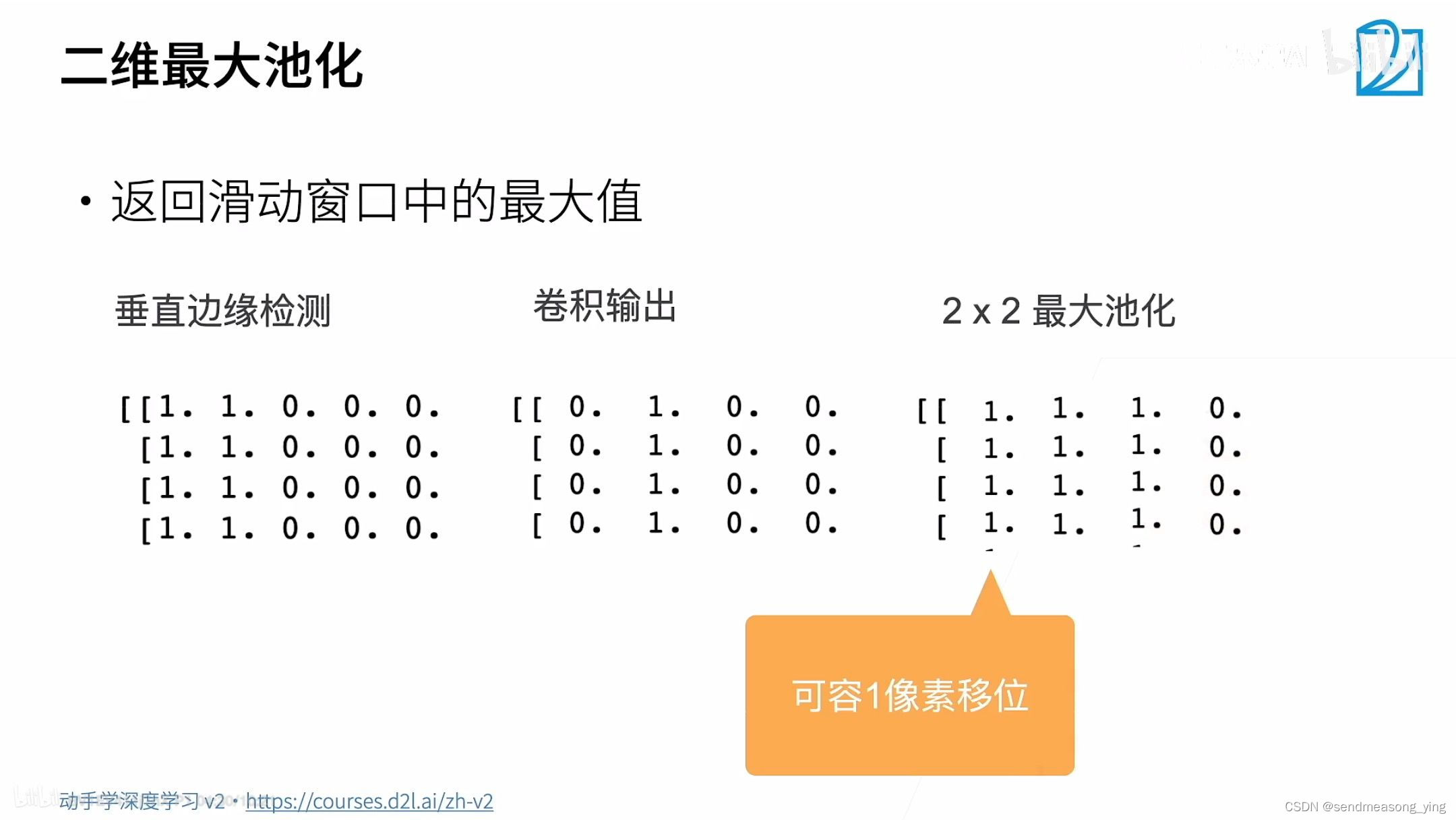

工作过程就是每次有一个滑动窗口,然后选取最大的值作为输出。

上图中有个错误,第3个矩阵的第3列也是全0。池化允许输入做一点小小的偏移。

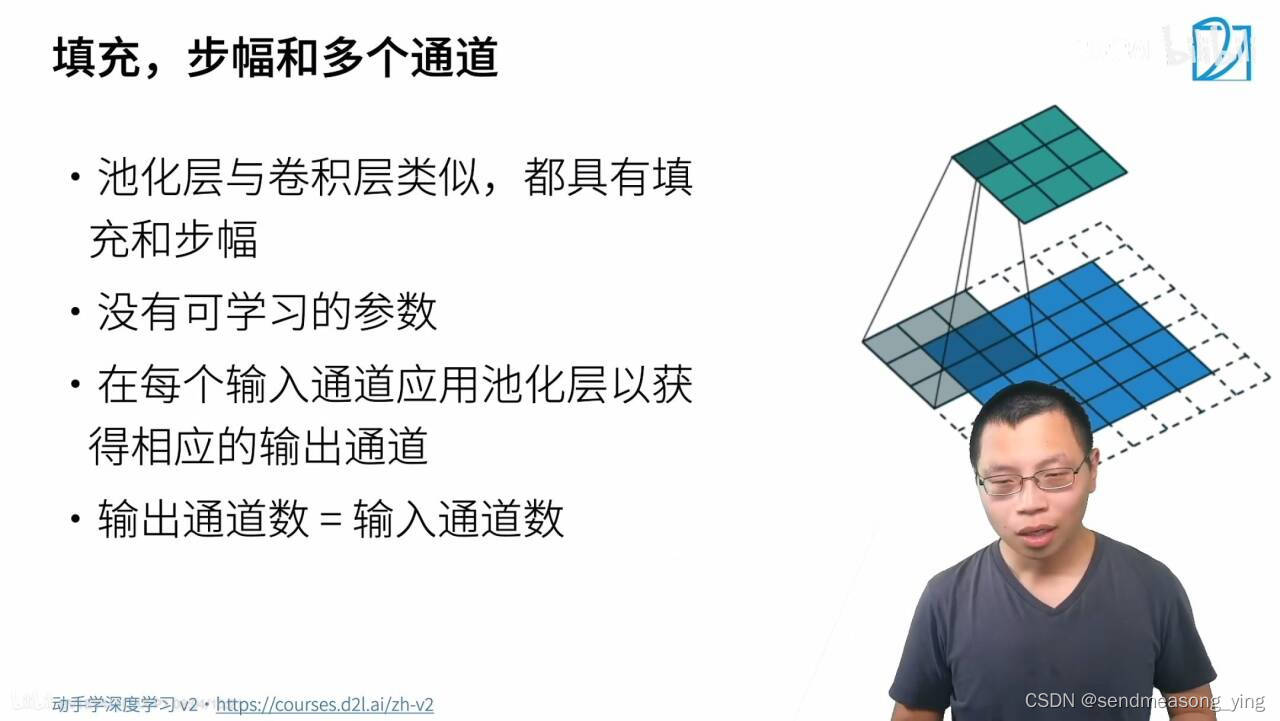

这里池化是不会融合多个通道的,而是对每个通道都作一次池化。

2.代码实现

2.1 最大汇聚层和平均汇聚层

import torch

from torch import nn

from d2l import torch as d2l

def pool2d(X,pool_size,mode='max'):

p_h,p_w=pool_size

Y=torch.zeros((X.shape[0]-p_h+1,X.shape[1]-p_w+1))

for i in range(Y.shape[0]):

for j in range(Y.shape[1]):

if mode=='max':

Y[i,j]=X[i:i+p_h,j:j+p_w].max()

elif mode=='avg':

Y[i,j]=X[i:i+p_h,j:j+p_w].mean()

return Y

#构建 图6.5.1中的输入张量X,验证二维最大汇聚层的输出。

X = torch.tensor([[0.0, 1.0, 2.0], [3.0, 4.0, 5.0], [6.0, 7.0, 8.0]])

pool2d(X,(2,2))

"""结果输出:

tensor([[4., 5.],

[7., 8.]]) """

#还可以验证平均汇聚层。

pool2d(X,(2,2),'avg')

"""结果输出:

tensor([[2., 3.],

[5., 6.]])"""2.2 填充和步幅

#我们可以通过填充和步幅以获得所需的输出形状。用深度学习框架中内置的二维最大汇聚层,来演示汇聚

#层中填充和步幅的使用。 我们首先构造了一个输入张量X,它有四个维度,其中样本数和通道数都是1。

X=torch.arange(16,dtype=torch.float32).reshape(1,1,4,4)

X

"""结果输出:

tensor([[[[ 0., 1., 2., 3.],

[ 4., 5., 6., 7.],

[ 8., 9., 10., 11.],

[12., 13., 14., 15.]]]])"""

#默认情况下,深度学习框架中的步幅与汇聚窗口的大小相同。 因此,如果我们使用形状为(3, 3)的

#汇聚窗口,那么默认情况下,我们得到的步幅形状为(3, 3)。步幅和窗口相等的意思就是,每一次窗口的

#计算都没有重叠的部分(下一块核上一块窗口)

pool2d=nn.MaxPool2d(3)

pool2d(X)

"""结果输出:

tensor([[[[10.]]]])"""

#填充和步幅可以手动设定。

pool2d=nn.MaxPool2d(3,padding=1,stride=2)

pool2d(X)

"""结果输出:

tensor([[[[ 5., 7.],

[13., 15.]]]])

"""2.3 多个通道

#在处理多通道输入数据时,汇聚层在每个输入通道上单独运算,而不是像卷积层一样在通道上对输入

#进行汇总。 这意味着汇聚层的输出通道数与输入通道数相同。 下面,我们将在通道维度上连结

#张量X和X + 1,以构建具有2个通道的输入。

X=torch.cat((X,X+1),1)

#在通道的维度上再拼接一个

X

"""结果输出:

tensor([[[[ 0., 1., 2., 3.],

[ 4., 5., 6., 7.],

[ 8., 9., 10., 11.],

[12., 13., 14., 15.]],

[[ 1., 2., 3., 4.],

[ 5., 6., 7., 8.],

[ 9., 10., 11., 12.],

[13., 14., 15., 16.]]]])"""

#汇聚后输出通道的数量仍然是2。

pool2d=nn.MaxPool2d(3,padding=1,stride=2)

pool2d(X)

"""结果输出:

tensor([[[[ 5., 7.],

[13., 15.]],

[[ 6., 8.],

[14., 16.]]]])"""3. 部分函数 :

3.1 nn.MaxPool2d

nn.MaxPool2d() 函数是 PyTorch 中用于创建最大池化(Max Pooling)层的函数。最大池化是一种常用的神经网络层,通常用于减小图像或特征图的空间尺寸,同时保留重要的特征。

torch.nn.MaxPool2d(

?? ?kernel_size,

?? ?stride=None,

?? ?padding=0,

?? ?dilation=1,

?? ?return_indices=False,

?? ?ceil_mode=False

)2. 参数解释

- ??? kernel_size (int or tuple)【必选】:max pooling 的窗口大小,当最大池化窗口是方形的时候,只需要一个整数边长即可;最大池化窗口不是方形时,要输入一个元组表高和宽。

- ??? stride (int or tuple, optional)【可选】:max pooling 的窗口移动的步长。默认值是 kernel_size

- ??? padding (int or tuple, optional)【可选】:输入的每一条边补充0的层数

- ??? dilation (int or tuple, optional)【可选】:一个控制窗口中元素步幅的参数

- ??? return_indices (bool)【可选】:如果等于 True,会返回输出最大值的序号,对于上采样操作会有帮助

- ??? ceil_mode (bool)【可选】:如果等于True,计算输出信号大小的时候,会使用向上取整,代替默认的向下取整的操作

?

3.2 torch.cat()

函数将两个张量(tensor)按指定维度拼接在一起,注意:除拼接维数dim数值可不同外其余维数数值需相同,方能对齐,如下面例子所示。torch.cat()函数不会新增维度,而torch.stack()函数会新增一个维度,相同的是两个都是对张量进行拼接.

文章来源:https://blog.csdn.net/m0_51133942/article/details/135505541

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- Ubuntu 18.04使用Qemu和GDB搭建运行内核的环境

- python学习笔记7

- LeetCode //C - 1493. Longest Subarray of 1‘s After Deleting One Element

- 骨传导蓝牙耳机怎么使用?使用骨传导耳机对人体有没有伤害?

- RK3399平台入门到精通系列讲解(实验篇)lseek 函数进行读写位置的调整

- 静物摄影在UE5里运用几点记要

- 八大算法排序@冒泡排序

- 鸿蒙(HarmonyOS)项目方舟框架(ArkUI)之Text文本组件

- FPGA设计时序约束十六、虚拟时钟Virtual Clock

- 计算机基础之U盘重装系统