使用jieba库进行中文分词和去除停用词

发布时间:2024年01月03日

jieba.lcut?

jieba.lcut()和jieba.lcut_for_search()是jieba库中的两个分词函数,它们的功能和参数略有不同。

jieba.lcut()方法接受三个参数:需要分词的字符串,是否使用全模式(默认为False)以及是否使用HMM模型(默认为True)。它返回一个列表,其中包含分词后的词语。该方法适合用于普通的文本分词任务。

而jieba.lcut_for_search()方法接受两个参数:需要分词的字符串和是否使用HMM模型。该方法适合用于搜索引擎的分词,因为它在精确模式的基础上,对长词进行了再次切分,以提高召回率。

import jieba

text = '中文分词是将中文文本切分成一系列有意义的词语的过程。'

#定义词典列表

b=['中文分词','中午文本','有意义']

jieba.load_userdict(b) #应用自定义词典列表

print(jieba.lcut(text,cut_all=False)) # 默认精确模式,即cut_all=False

print(jieba.lcut(text,cut_all=True)) # 改为全模式,即cut_all=True

print(jieba.lcut_for_search(text)) # 搜索引擎模式

import jieba

text2 = '我们中出了一个叛徒'

print(jieba.lcut(text2))

# 删除一个单词

jieba.del_word('中出')

print(jieba.lcut(text2))

#增加一个单词

jieba.add_word('出了')

print(jieba.lcut(text2))

# 如果我们不想删除“中出”这个词,但是又不想让它合在一起,可以增大它的词频

jieba.add_word('中出') # 为了演示效果,我们需要回到最初始的样子

jieba.del_word('出了')

print(jieba.lcut(text2))

# 调节词的词频,使其能(或不能)被分词

# tune=True:执行词频调整,默认False不执行

jieba.suggest_freq(('中','出'),tune=True)

print(jieba.lcut(text2))

去除停用词语

最全中文停用词表

?

import re

import jieba

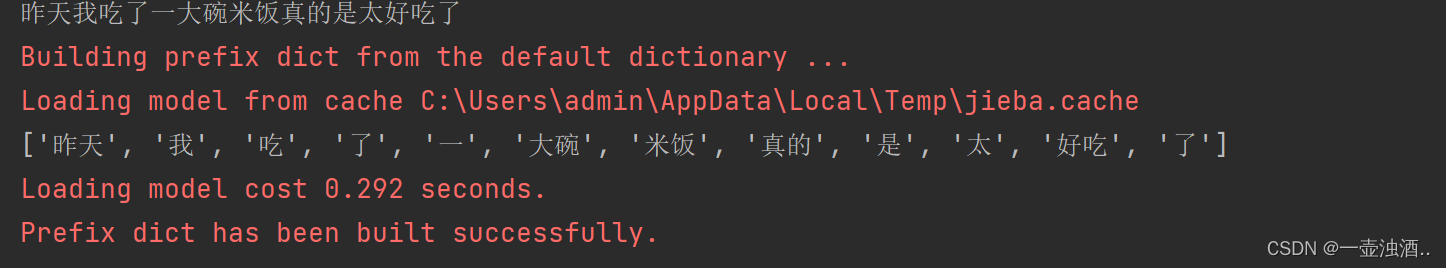

text3 = '昨天我吃了一大碗米饭,真的是太好吃了!###@'

# 去除一些无用的字符只提取出中文出来

new_text = "".join(re.findall('[\u4e00-\u9fa5]+', text3, re.S))

print(new_text)

print(jieba.lcut(new_text))

综合案例?

import re

import jieba

def chinese_word_cut(mytext):

# jieba.load_userdict('自定义词典.txt') # 这里你可以添加jieba库识别不了的网络新词,避免将一些新词拆开

jieba.initialize() # 初始化jieba

# 文本预处理 :去除一些无用的字符只提取出中文出来

new_data = re.findall('[\u4e00-\u9fa5]+', mytext, re.S)

new_data = " ".join(new_data)

# 文本分词

seg_list_exact = jieba.lcut(new_data)

result_list = []

# 读取停用词库

with open('cn_stopwords.txt', encoding='utf-8') as f: # 可根据需要打开停用词库,然后加上不想显示的词语

con = f.readlines()

stop_words = set()

for i in con:

i = i.replace("\n", "") # 去掉读取每一行数据的\n

stop_words.add(i)

# 去除停用词并且去除单字

for word in seg_list_exact:

if word not in stop_words and len(word) > 1:

result_list.append(word)

return result_list

if __name__=='__main__':

with open('new.txt','r',encoding='utf-8') as f:

text_file=f.read()

# 分词得到词典

result=chinese_word_cut(text_file)

result=set(result)

print(result)

# print(text_file)

?

参考:

文章来源:https://blog.csdn.net/qq_40107571/article/details/135361241

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 一文看懂LIN总线

- idea SVN更新报错Error:svn: E155038

- Java核心知识点1-java和c++区别、隐式和显示类型转换

- SpringBoot框架+原生HTML开发,基于云端SaaS服务方式的电子病历编辑器源码

- 机器学习笔记(四)初识卷积神经网络

- HTTP协议和TCP协议的区别

- 在ubuntu上的18个非常实用的命令行工具软件

- 多个搜索引擎跳转

- 【npm】npm i 与 npm install 的区别

- Altair SimSolid 工程仿真软件 衡祖仿真