ChatGPT如何计算token数?

GPT 不是适用于某一门语言的大型语言模型,它适用于几乎所有流行的自然语言。所以 GPT 的 token 需要?兼容?几乎人类的所有自然语言,那意味着 GPT 有一个非常全的 token 词汇表,它能表达出所有人类的自然语言。如何实现这个目的呢?

答案是通过 unicode 编码。

Unicode(统一码、万国码、单一码)是一种在计算机上使用的字符编码。Unicode 是为了解决传统的字符编码方案的局限而产生的,它为每种语言中的每个字符设定了统一并且唯一的二进制编码,以满足跨语言、跨平台进行文本转换、处理的要求。

以下的网址可以计算一个语料的tokens数目:

https://platform.openai.com/tokenizer![]() https://platform.openai.com/tokenizer

https://platform.openai.com/tokenizer ?

?

?

?

有两个问题:

- 汉字是怎么编码的?

- 编码和模型是否相关?

虽然 GPT-3.5 的代码和模型权重并未开源,但是 tokenizer 部分是开源到 GitHub - openai/tiktoken: tiktoken is a fast BPE tokeniser for use with OpenAI's models.tiktoken is a fast BPE tokeniser for use with OpenAI's models. - GitHub - openai/tiktoken: tiktoken is a fast BPE tokeniser for use with OpenAI's models.![]() https://github.com/openai/tiktoken 的,这是一个 ?BPE(Byte-Pair Encoding tokenization)方法的 tokenizer。

https://github.com/openai/tiktoken 的,这是一个 ?BPE(Byte-Pair Encoding tokenization)方法的 tokenizer。

关于第一个问题,ChatGPT 是一个多语言模型,因此编码的问题不局限于汉字。tiktoken 的词表绝大多数是英文子词,并包含少量 unicode token 和表示字节的 token,以 UTF-8 的形式表示多语言。

关于第二个问题,不同的 OpenAI 模型采用了不同的编码方式。

- GPT-4、GPT-3.5-turbo 等模型采用的是 cl100k_base,词表 100k 大小。

- text-davinci 系列采用的是 p50k_base,词表大小 50k。

- 还有一些其他模型采用了 r50k_base。

- 更早的 GPT-2 有单独的编码方式,也开源在 HuggingFace。

?

?

作用:

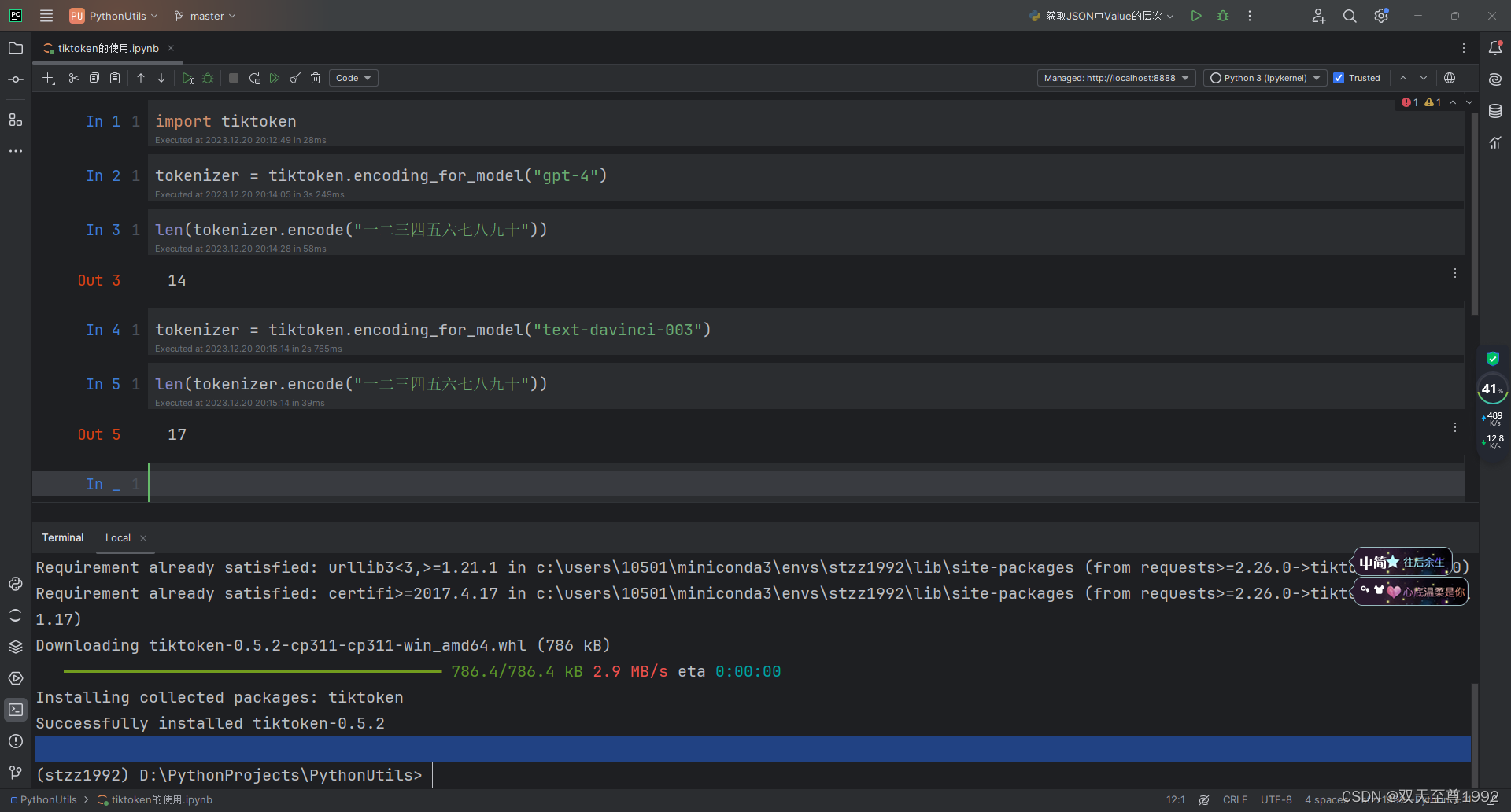

用tiktoken进行token计数

?

OpenAI的模型都有token限制。有时在将文本传递给API之前,需要计算中的token数量,以确保不超过该限制。其中,一个需要计算token数量的技术是“检索增强生成(Retrieval Augmented Generation)”,通过对文档语料库运行搜索(或嵌入搜索)来回答用户的问题,提取最有可能的内容,并将其作为上下文涵盖在prompt中。成功实现这种模式的关键是,在token限制内包含尽可能多的相关上下文,因此需要能够计算token数量。OpenAI提供了一个名为tiktoken(https://github.com/openai/tiktoken)的Python库来实现这一功能。如果你深入研究这个库,就会发现它目前包括五种不同的切分方案:r50k_base、p50k_base、p50k_edit、cl100k_base和gpt2。其中,cl100k_base是最相关的,它是GPT-4和当前ChatGPT使用的经济型gpt-3.5-turbo模型的tokenizer。text-davinci-003 使用的是p50k_base 。在tiktoken/model.py 的MODEL_TO_ENCODING 词典中可以找到模型与tokenizer的完整映射。

?

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- LeetCode206反转链表(java实现)

- 嵌入式培训机构四个月实训课程笔记(完整版)-C++和QT编程第二天-类与对象(物联技术666)

- 5-Docker实例-安装redis

- B端产品经理学习-权限管理

- UE的蓝图开发

- TikTok真题第7天 | 2422.使用合并操作将数组转换为回文序列、200.岛屿的个数、694.不同岛屿的个数

- C语言学习day10:三目运算符

- 【漏洞复现】大华 DSS 数字监控系统 itcBulletin SQL 注入

- 从零开始学Python:分支结构

- 墙地砖外形检测的技术方案-外部轮廓检测算法