【RT-DETR有效改进】轻量化CNN网络MobileNetV1改进特征提取网络

前言

大家好,这里是RT-DETR有效涨点专栏。

本专栏的内容为根据ultralytics版本的RT-DETR进行改进,内容持续更新,每周更新文章数量3-10篇。

专栏以ResNet18、ResNet50为基础修改版本,同时修改内容也支持ResNet32、ResNet101和PPHGNet版本,其中ResNet为RT-DETR官方版本1:1移植过来的,参数量基本保持一致(误差很小很小),不同于ultralytics仓库版本的ResNet官方版本,同时ultralytics仓库的一些参数是和RT-DETR相冲的所以我也是会教大家调好一些参数和代码,真正意义上的跑ultralytics的和RT-DETR官方版本的无区别

👑欢迎大家订阅本专栏,一起学习RT-DETR👑???

一、本文介绍

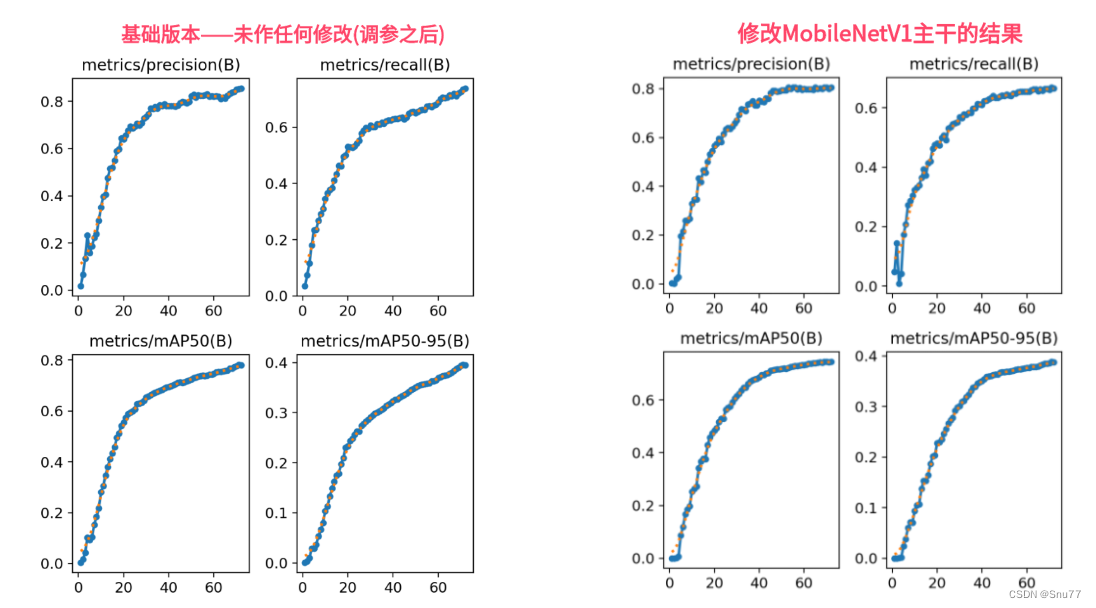

本篇文章给大家带来的改进机制是MobileNetV1,其是专为移动和嵌入式视觉应用设计的轻量化网络结构。这些模型基于简化的架构,并利用深度可分离卷积构建轻量级深度神经网络,其引入了两个简单的全局超参数,用于在延迟和准确性之间进行有效的权衡。接下来,我会展示一下原始版本和我改进后版本在训练上的对比图。之后会在文章中介绍该网络结构,然后教大家如何修改该网络结构,下面的图片为在我的数据上的实验对比图,左边为基础版本 ,右边为修改了本文该机制的结果,但是需要注意的是本文的结构为轻量化网络结构。

?

?

目录

二、MobileNetV1的框架原理

?官方论文地址:?论文地址点击即可跳转

官方代码地址:?官方代码地址

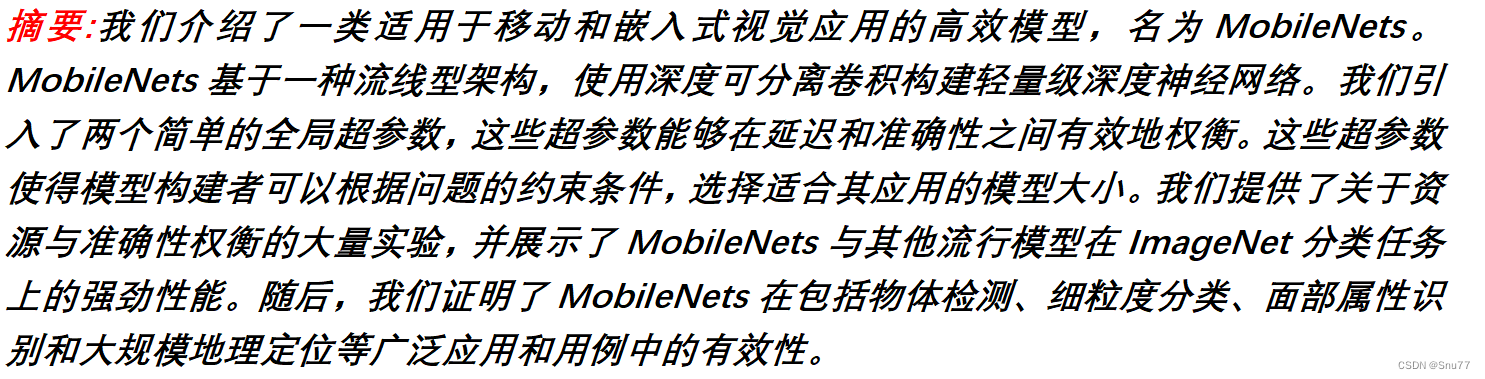

MobileNetV1的论文《MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Applications》介绍了一种高效的模型集合,专为移动和嵌入式视觉应用设计。这些模型基于简化的架构,并利用深度可分离卷积构建轻量级深度神经网络,从而适应移动和嵌入式设备的计算和存储限制。这种架构包含两个步骤:深度卷积(Depthwise Convolution)用于单独处理每个输入通道,然后是逐点卷积(Pointwise Convolution),用于整合深度卷积的输出。通过这种分解,MobileNet显著减少了模型的大小和计算复杂度,同时保持了良好的性能。论文还引入了两个全局超参数,允许在网络大小、速度和准确性之间进行灵活的权衡。

MobileNet的主要创新点包括:

1. 深度可分离卷积:该网络架构使用深度可分离卷积代替标准卷积,显著减少模型参数和计算量。

2. 宽度乘数:提供了一个超参数来调节网络的宽度,从而使得模型可以根据需要进行缩放,适应不同的性能和资源要求。

3. 分辨率乘数:允许调整输入图像的分辨率,进一步减少计算量。

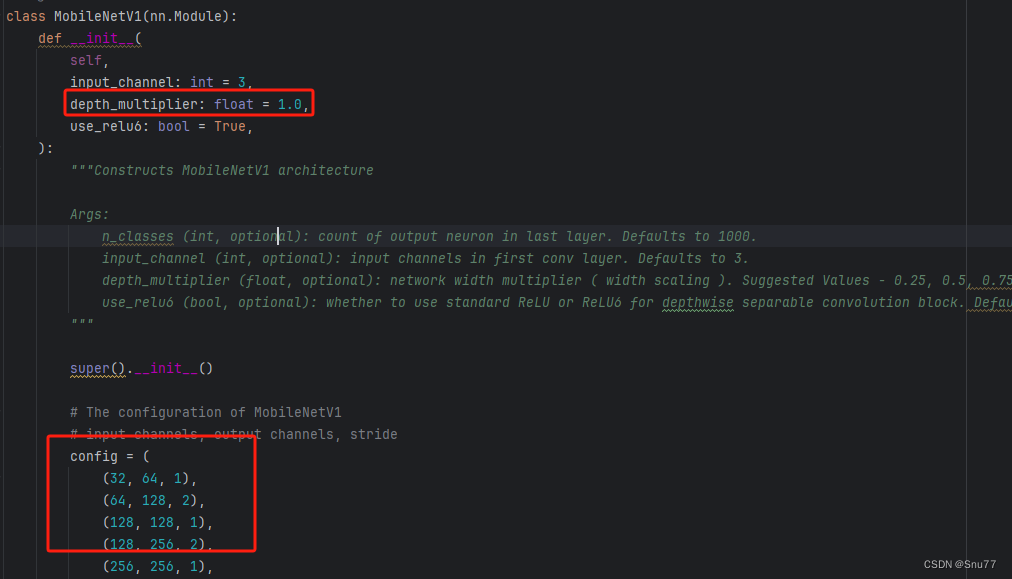

其中第二点和第三点,在代码中很清楚的就能看到如下图红框的所示,分别对应第二点和第三点。

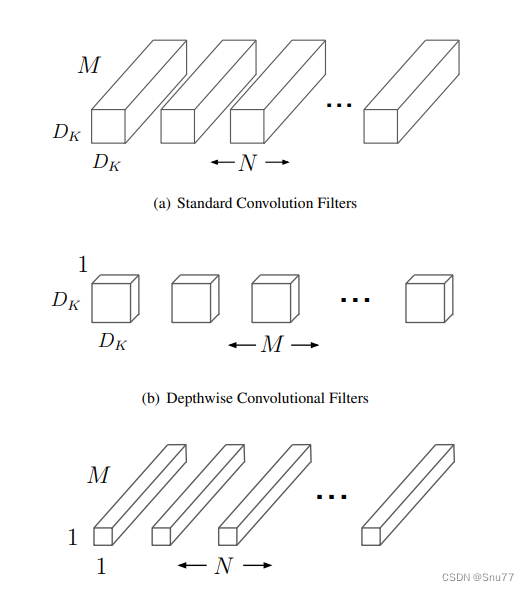

深度可分离卷积如下图所示?

这张图片描绘了深度可分离卷积的概念,其中标准的卷积滤波器(a)被分解为两个独立的层:深度卷积(b)和逐点卷积(c)。在深度卷积中,每个输入通道独立应用一个滤波器,而逐点卷积则使用1x1的卷积核来组合深度卷积的输出。这种分解方法显著减少了计算量,因为它将卷积操作分为两个更简单的步骤:一个是应用于每个通道的滤波(深度卷积),另一个是这些滤波输出的组合(逐点卷积)。?

三、MobileNetV1的代码

使用方式看章节四。

import torch

from torch import nn

class DepthwiseSepConvBlock(nn.Module):

def __init__(

self,

in_channels: int,

out_channels: int,

stride: int = 1,

use_relu6: bool = True,

):

Args:

in_channels (int): input channels for depthwise convolution

out_channels (int): output channels for pointwise convolution

stride (int, optional): stride paramemeter for depthwise convolution. Defaults to 1.

use_relu6 (bool, optional): whether to use standard ReLU or ReLU6 for depthwise separable convolution block. Defaults to True.

"""

super().__init__()

# Depthwise conv

self.depthwise_conv = nn.Conv2d(

in_channels,

in_channels,

(3, 3),

stride=stride,

padding=1,

groups=in_channels,

)

self.bn1 = nn.BatchNorm2d(in_channels)

self.relu1 = nn.ReLU6() if use_relu6 else nn.ReLU()

# Pointwise conv

self.pointwise_conv = nn.Conv2d(in_channels, out_channels, (1, 1))

self.bn2 = nn.BatchNorm2d(out_channels)

self.relu2 = nn.ReLU6() if use_relu6 else nn.ReLU()

def forward(self, x):

"""Perform forward pass."""

x = self.depthwise_conv(x)

x = self.bn1(x)

x = self.relu1(x)

x = self.pointwise_conv(x)

x = self.bn2(x)

x = self.relu2(x)

return x

class MobileNetV1(nn.Module):

def __init__(

self,

input_channel: int = 3,

depth_multiplier: float = 1.0,

use_relu6: bool = True,

):

"""Constructs MobileNetV1 architecture

Args:

n_classes (int, optional): count of output neuron in last layer. Defaults to 1000.

input_channel (int, optional): input channels in first conv layer. Defaults to 3.

depth_multiplier (float, optional): network width multiplier ( width scaling ). Suggested Values - 0.25, 0.5, 0.75, 1.. Defaults to 1.0.

use_relu6 (bool, optional): whether to use standard ReLU or ReLU6 for depthwise separable convolution block. Defaults to True.

"""

super().__init__()

# The configuration of MobileNetV1

# input channels, output channels, stride

config = (

(32, 64, 1),

(64, 128, 2),

(128, 128, 1),

(128, 256, 2),

(256, 256, 1),

(256, 512, 2),

(512, 512, 1),

(512, 512, 1),

(512, 512, 1),

(512, 512, 1),

(512, 512, 1),

(512, 1024, 2),

(1024, 1024, 1),

)

self.model = nn.Sequential(

nn.Conv2d(

input_channel, int(32 * depth_multiplier), (3, 3), stride=2, padding=1

)

)

# Adding depthwise block in the model from the config

for in_channels, out_channels, stride in config:

self.model.append(

DepthwiseSepConvBlock(

int(in_channels * depth_multiplier), # input channels

int(out_channels * depth_multiplier), # output channels

stride,

use_relu6=use_relu6,

)

)

self.index = [128, 256, 512, 1024]

self.width_list = [i.size(1) for i in self.forward(torch.randn(1, 3, 640, 640))]

def forward(self, x):

"""Perform forward pass."""

results = [None, None, None, None]

for model in self.model:

x = model(x)

if x.size(1) in self.index:

position = self.index.index(x.size(1)) # Find the position in the index list

results[position] = x

return results

四、手把手教你添加MobileNetV1网络结构

下面教大家如何修改该网络结构,主干网络结构的修改步骤比较复杂,我也会将task.py文件上传到CSDN的文件中,大家如果自己修改不正确,可以尝试用我的task.py文件替换你的,然后只需要修改其中的第1、2、3、5步即可。

?修改过程中大家一定要仔细?

4.1 修改一

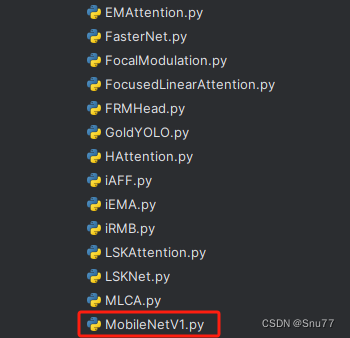

首先我门中到如下“ultralytics/nn”的目录,我们在这个目录下在创建一个新的目录,名字为'Addmodules'(此文件之后就用于存放我们的所有改进机制),之后我们在创建的目录内创建一个新的py文件复制粘贴进去 ,可以根据文章改进机制来起,这里大家根据自己的习惯命名即可。

4.2 修改二?

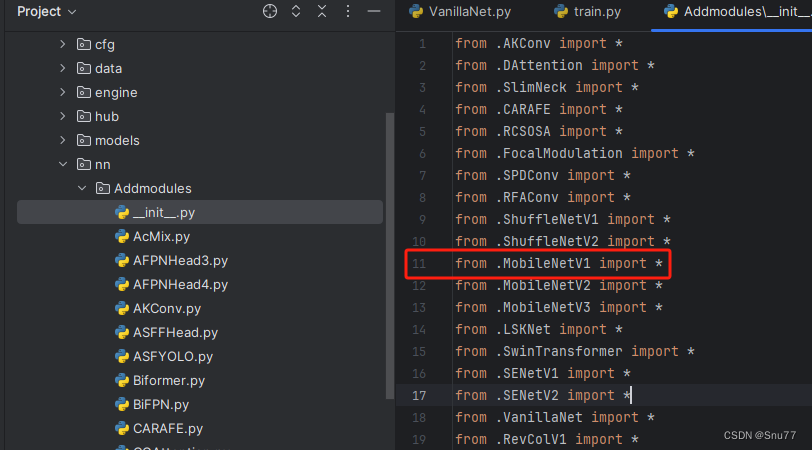

第二步我们在我们创建的目录内创建一个新的py文件名字为'__init__.py'(只需要创建一个即可),然后在其内部导入我们本文的改进机制即可,其余代码均为未发大家没有不用理会!。

4.3 修改三?

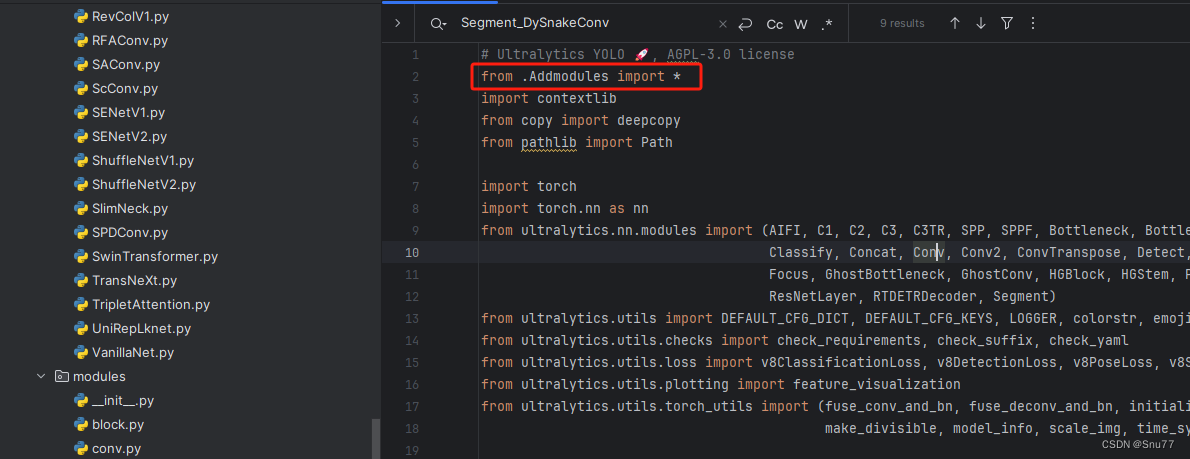

第三步我门中到如下文件'ultralytics/nn/tasks.py'然后在开头导入我们的所有改进机制(如果你用了我多个改进机制,这一步只需要修改一次即可)。

4.4 修改四

添加如下两行代码!!!

?

?

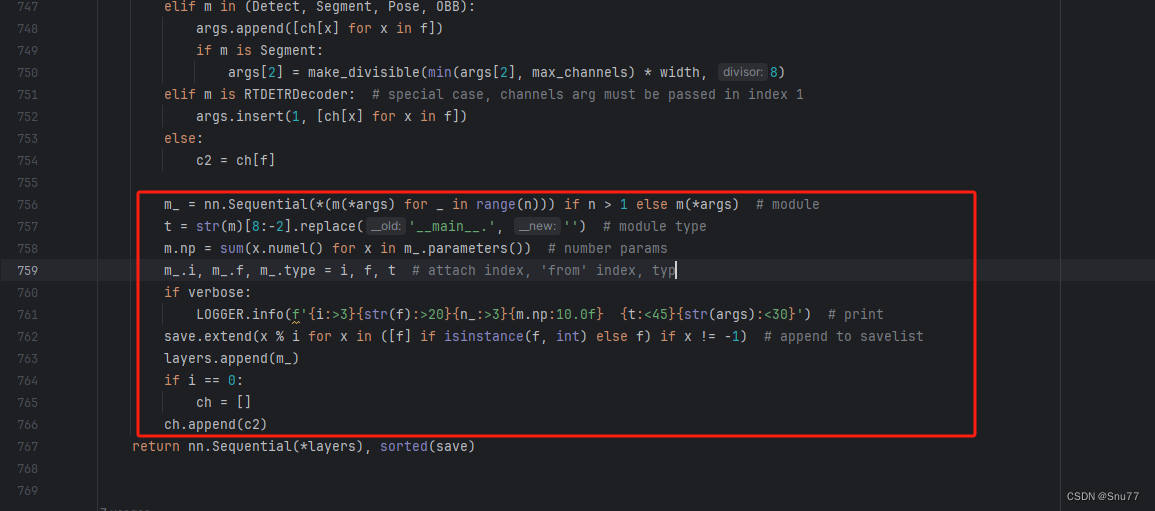

4.5 修改五

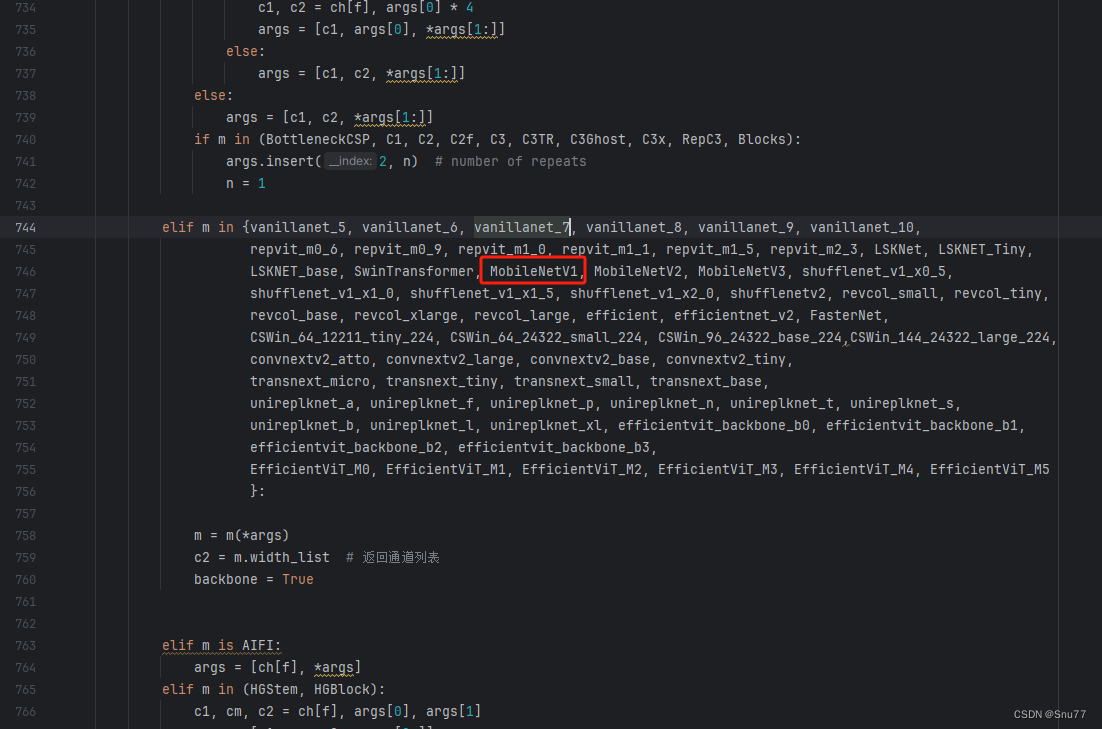

找到七百多行大概把具体看图片,按照图片来修改就行,添加红框内的部分,注意没有()只是函数名。(此处我的文件里已经添加很多了后期都会发出来,大家没有的不用理会即可)。

elif m in {自行添加对应的模型即可,下面都是一样的}:

m = m(*args)

c2 = m.width_list # 返回通道列表

backbone = True4.6 修改六

用下面的代码替换红框内的内容。?

?

?

if isinstance(c2, list):

m_ = m

m_.backbone = True

else:

m_ = nn.Sequential(*(m(*args) for _ in range(n))) if n > 1 else m(*args) # module

t = str(m)[8:-2].replace('__main__.', '') # module type

m.np = sum(x.numel() for x in m_.parameters()) # number params

m_.i, m_.f, m_.type = i + 4 if backbone else i, f, t # attach index, 'from' index, type

if verbose:

LOGGER.info(f'{i:>3}{str(f):>20}{n_:>3}{m.np:10.0f} {t:<45}{str(args):<30}') # print

save.extend(

x % (i + 4 if backbone else i) for x in ([f] if isinstance(f, int) else f) if x != -1) # append to savelist

layers.append(m_)

if i == 0:

ch = []

if isinstance(c2, list):

ch.extend(c2)

if len(c2) != 5:

ch.insert(0, 0)

else:

ch.append(c2)4.7 修改七?

修改七这里非常要注意,不是文件开头YOLOv8的那predict是400+行的RTDETR的predict!!!初始模型如下,用我给的代码替换即可!!!

?

?

代码如下->

def predict(self, x, profile=False, visualize=False, batch=None, augment=False, embed=None):

"""

Perform a forward pass through the model.

Args:

x (torch.Tensor): The input tensor.

profile (bool, optional): If True, profile the computation time for each layer. Defaults to False.

visualize (bool, optional): If True, save feature maps for visualization. Defaults to False.

batch (dict, optional): Ground truth data for evaluation. Defaults to None.

augment (bool, optional): If True, perform data augmentation during inference. Defaults to False.

embed (list, optional): A list of feature vectors/embeddings to return.

Returns:

(torch.Tensor): Model's output tensor.

"""

y, dt, embeddings = [], [], [] # outputs

for m in self.model[:-1]: # except the head part

if m.f != -1: # if not from previous layer

x = y[m.f] if isinstance(m.f, int) else [x if j == -1 else y[j] for j in m.f] # from earlier layers

if profile:

self._profile_one_layer(m, x, dt)

if hasattr(m, 'backbone'):

x = m(x)

if len(x) != 5: # 0 - 5

x.insert(0, None)

for index, i in enumerate(x):

if index in self.save:

y.append(i)

else:

y.append(None)

x = x[-1] # 最后一个输出传给下一层

else:

x = m(x) # run

y.append(x if m.i in self.save else None) # save output

if visualize:

feature_visualization(x, m.type, m.i, save_dir=visualize)

if embed and m.i in embed:

embeddings.append(nn.functional.adaptive_avg_pool2d(x, (1, 1)).squeeze(-1).squeeze(-1)) # flatten

if m.i == max(embed):

return torch.unbind(torch.cat(embeddings, 1), dim=0)

head = self.model[-1]

x = head([y[j] for j in head.f], batch) # head inference

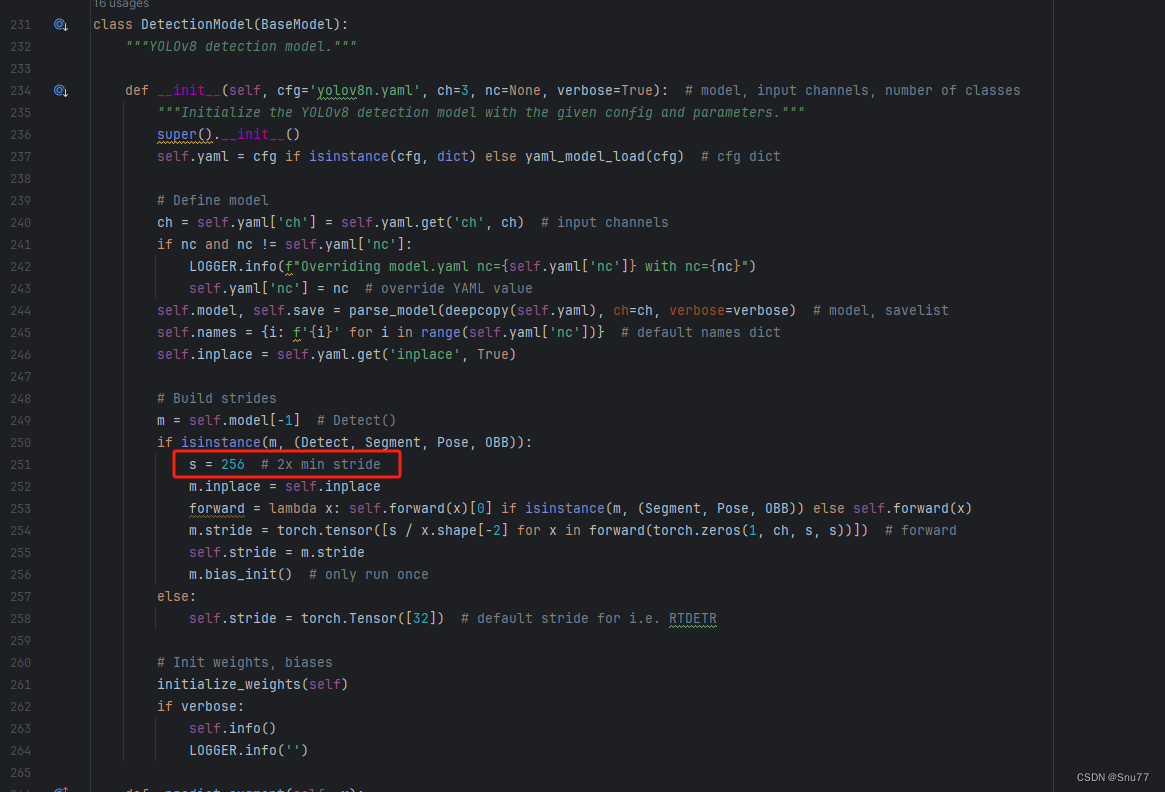

return x4.8 修改八

我们将下面的s用640替换即可,这一步也是部分的主干可以不修改,但有的不修改就会报错,所以我们还是修改一下。

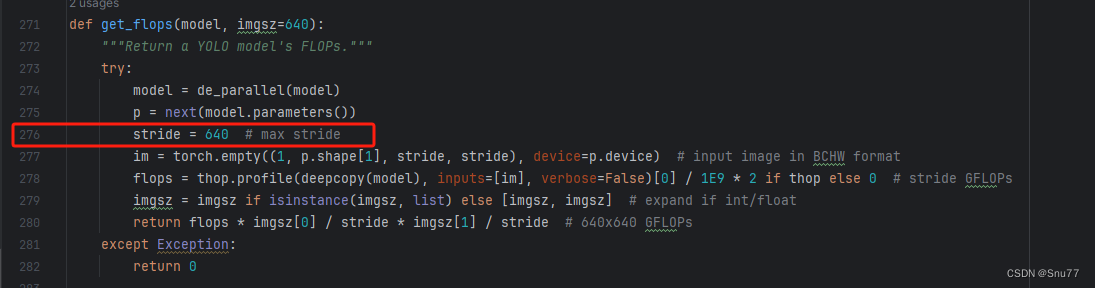

4.9 RT-DETR不能打印计算量问题的解决

计算的GFLOPs计算异常不打印,所以需要额外修改一处,?我们找到如下文件'ultralytics/utils/torch_utils.py'文件内有如下的代码按照如下的图片进行修改,大家看好函数就行,其中红框的640可能和你的不一样, 然后用我给的代码替换掉整个代码即可。

def get_flops(model, imgsz=640):

"""Return a YOLO model's FLOPs."""

try:

model = de_parallel(model)

p = next(model.parameters())

# stride = max(int(model.stride.max()), 32) if hasattr(model, 'stride') else 32 # max stride

stride = 640

im = torch.empty((1, 3, stride, stride), device=p.device) # input image in BCHW format

flops = thop.profile(deepcopy(model), inputs=[im], verbose=False)[0] / 1E9 * 2 if thop else 0 # stride GFLOPs

imgsz = imgsz if isinstance(imgsz, list) else [imgsz, imgsz] # expand if int/float

return flops * imgsz[0] / stride * imgsz[1] / stride # 640x640 GFLOPs

except Exception:

return 0

4.10 可选修改

有些读者的数据集部分图片比较特殊,在验证的时候会导致形状不匹配的报错,如果大家在验证的时候报错形状不匹配的错误可以固定验证集的图片尺寸,方法如下?->

找到下面这个文件ultralytics/models/yolo/detect/train.py然后其中有一个类是DetectionTrainer class中的build_dataset函数中的一个参数rect=mode == 'val'改为rect=False

五、MobileNetV1的yaml文件

5.1 yaml文件

大家复制下面的yaml文件,然后通过我给大家的运行代码运行即可,RT-DETR的调参部分需要后面的文章给大家讲,现在目前免费给大家看这一部分不开放。

# Ultralytics YOLO 🚀, AGPL-3.0 license

# RT-DETR-l object detection model with P3-P5 outputs. For details see https://docs.ultralytics.com/models/rtdetr

# Parameters

nc: 80 # number of classes

scales: # model compound scaling constants, i.e. 'model=yolov8n-cls.yaml' will call yolov8-cls.yaml with scale 'n'

# [depth, width, max_channels]

l: [1.00, 1.00, 1024]

backbone:

# [from, repeats, module, args]

- [-1, 1, MobileNetV1, []] # 4

head:

- [-1, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 5 input_proj.2

- [-1, 1, AIFI, [1024, 8]] # 6

- [-1, 1, Conv, [256, 1, 1]] # 7, Y5, lateral_convs.0

- [-1, 1, nn.Upsample, [None, 2, 'nearest']] # 8

- [3, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 9 input_proj.1

- [[-2, -1], 1, Concat, [1]] # 10

- [-1, 3, RepC3, [256, 0.5]] # 11, fpn_blocks.0

- [-1, 1, Conv, [256, 1, 1]] # 12, Y4, lateral_convs.1

- [-1, 1, nn.Upsample, [None, 2, 'nearest']] # 13

- [2, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 14 input_proj.0

- [[-2, -1], 1, Concat, [1]] # 15 cat backbone P4

- [-1, 3, RepC3, [256, 0.5]] # X3 (16), fpn_blocks.1

- [-1, 1, Conv, [256, 3, 2]] # 17, downsample_convs.0

- [[-1, 12], 1, Concat, [1]] # 18 cat Y4

- [-1, 3, RepC3, [256, 0.5]] # F4 (19), pan_blocks.0

- [-1, 1, Conv, [256, 3, 2]] # 20, downsample_convs.1

- [[-1, 7], 1, Concat, [1]] # 21 cat Y5

- [-1, 3, RepC3, [256, 0.5]] # F5 (22), pan_blocks.1

- [[16, 19, 22], 1, RTDETRDecoder, [nc, 256, 300, 4, 8, 3]] # Detect(P3, P4, P5)

5.2 运行文件

大家可以创建一个train.py文件将下面的代码粘贴进去然后替换你的文件运行即可开始训练。

import warnings

from ultralytics import RTDETR

warnings.filterwarnings('ignore')

if __name__ == '__main__':

model = RTDETR('替换你想要运行的yaml文件')

# model.load('') # 可以加载你的版本预训练权重

model.train(data=r'替换你的数据集地址即可',

cache=False,

imgsz=640,

epochs=72,

batch=4,

workers=0,

device='0',

project='runs/RT-DETR-train',

name='exp',

# amp=True

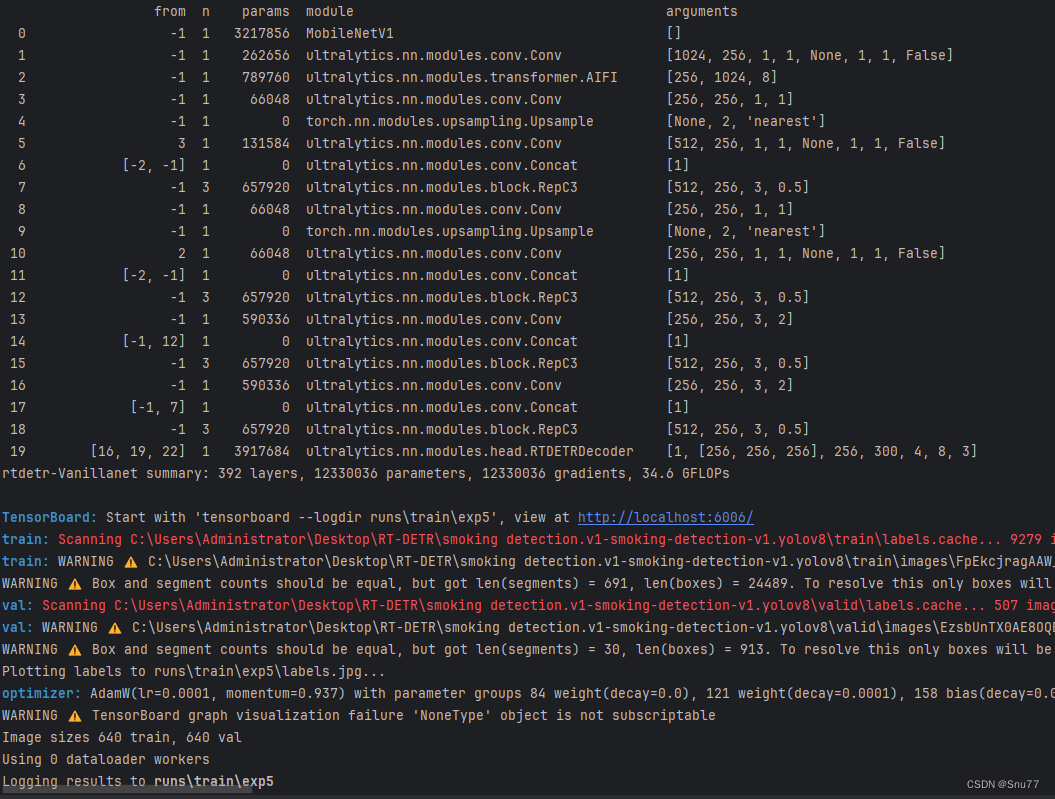

)5.3 成功训练截图

下面是成功运行的截图(确保我的改进机制是可用的),已经完成了有1个epochs的训练,图片太大截不全第2个epochs了。?

?

六、全文总结

从今天开始正式开始更新RT-DETR剑指论文专栏,本专栏的内容会迅速铺开,在短期呢大量更新,价格也会乘阶梯性上涨,所以想要和我一起学习RT-DETR改进,可以在前期直接关注,本文专栏旨在打造全网最好的RT-DETR专栏为想要发论文的家进行服务。

?

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- Linux修改文件名

- selenium利用图鉴 破点击验证码 登录b站

- Scrapy框架入门-爬虫

- MFC用代码加载一张bmp图片到picture control并适应到控件大小 解决OnInitDialog中调用不显示

- 【华为OD机试真题2023C&D卷 JAVA&JS】开源项目热榜

- Flink实战之运行架构

- 软件测试/测试开发丨Linux常用命令之性能统计

- Vue学习计划-Vue3--核心语法(九)slot插槽

- uniapp的nvue是什么

- 基于JAVA+SSM+VUE的前后端分离的大学竞赛管理系统