「吴恩达」机器学习笔记 - 改进梯度下降的技术

发布时间:2024年01月13日

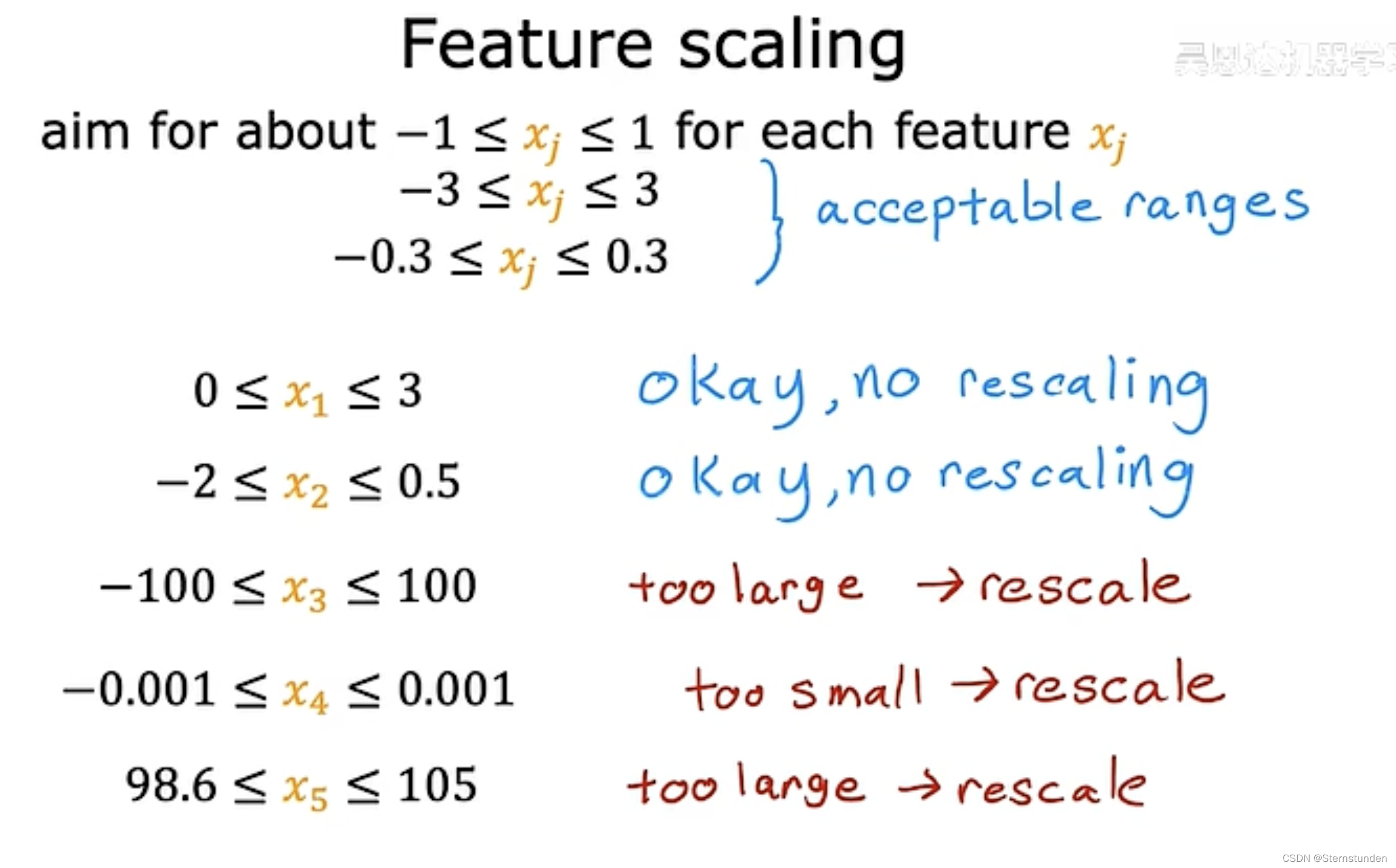

一、特征放缩

1. 目标:

将每个特征 1 ≤ x_j ≤ 1

几乎无坏处,可多尝试特征放缩

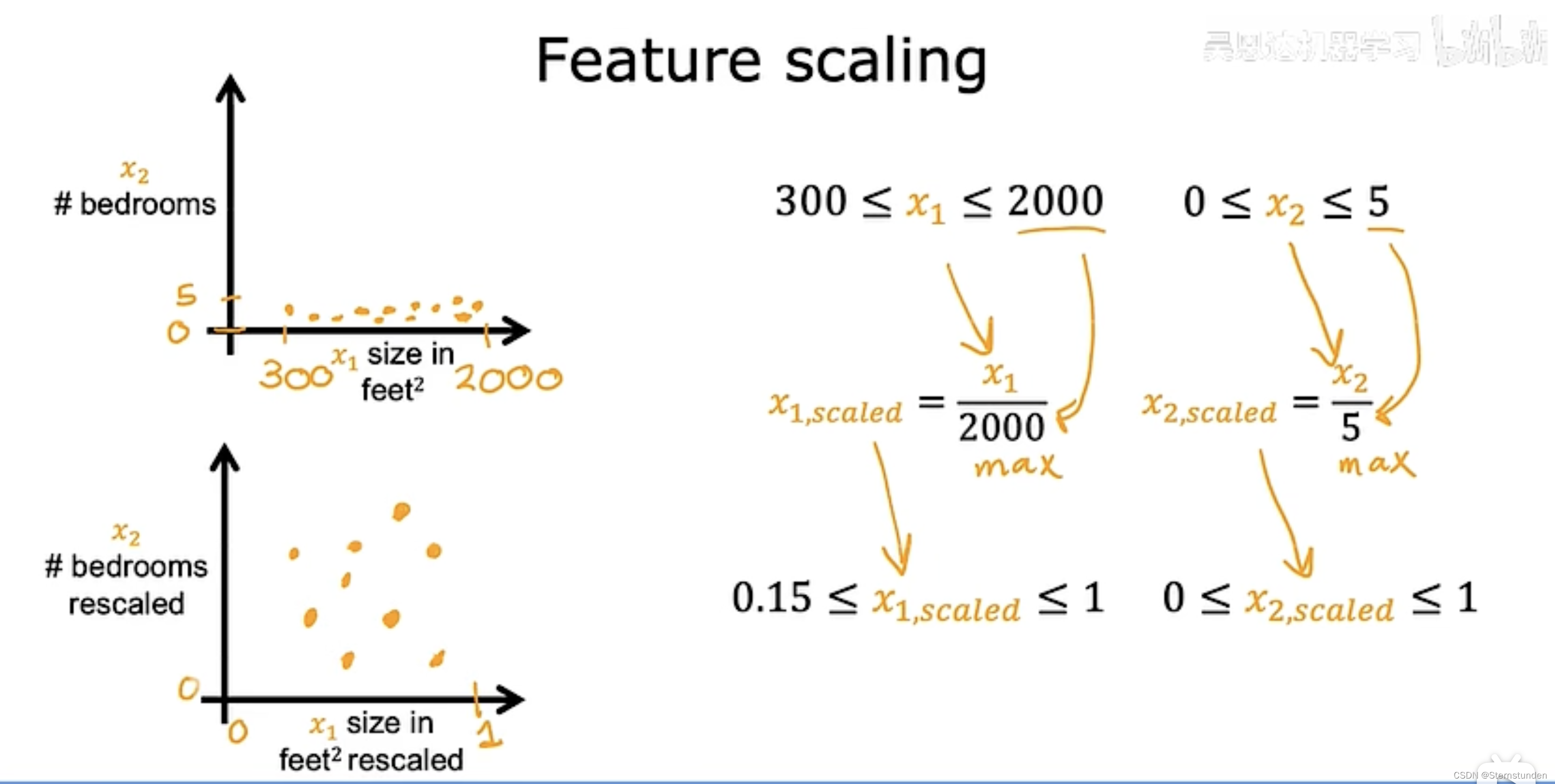

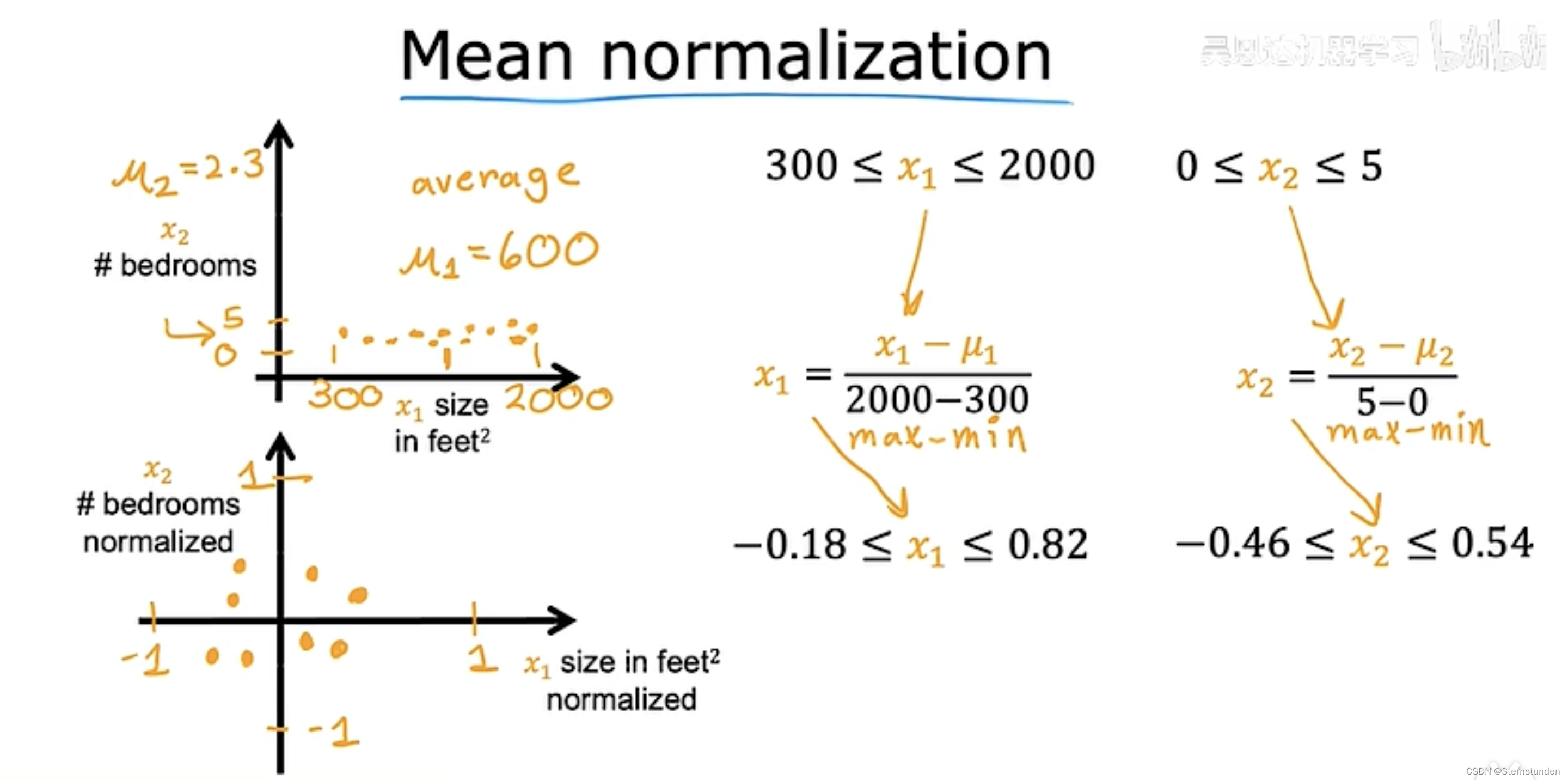

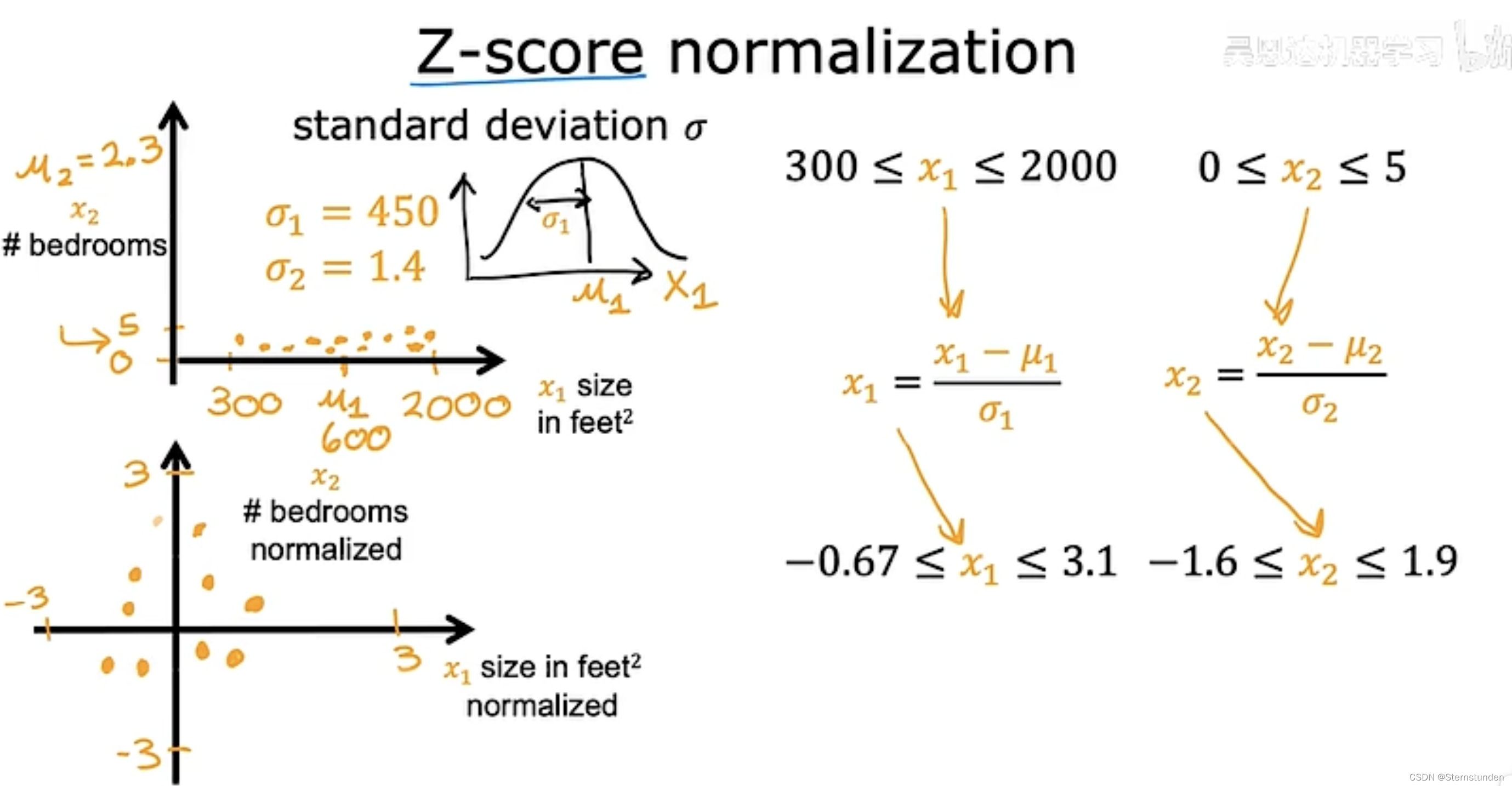

2. 方法

(1) 除以最大值

(2) 均值正常化

(3) z 分数归一化

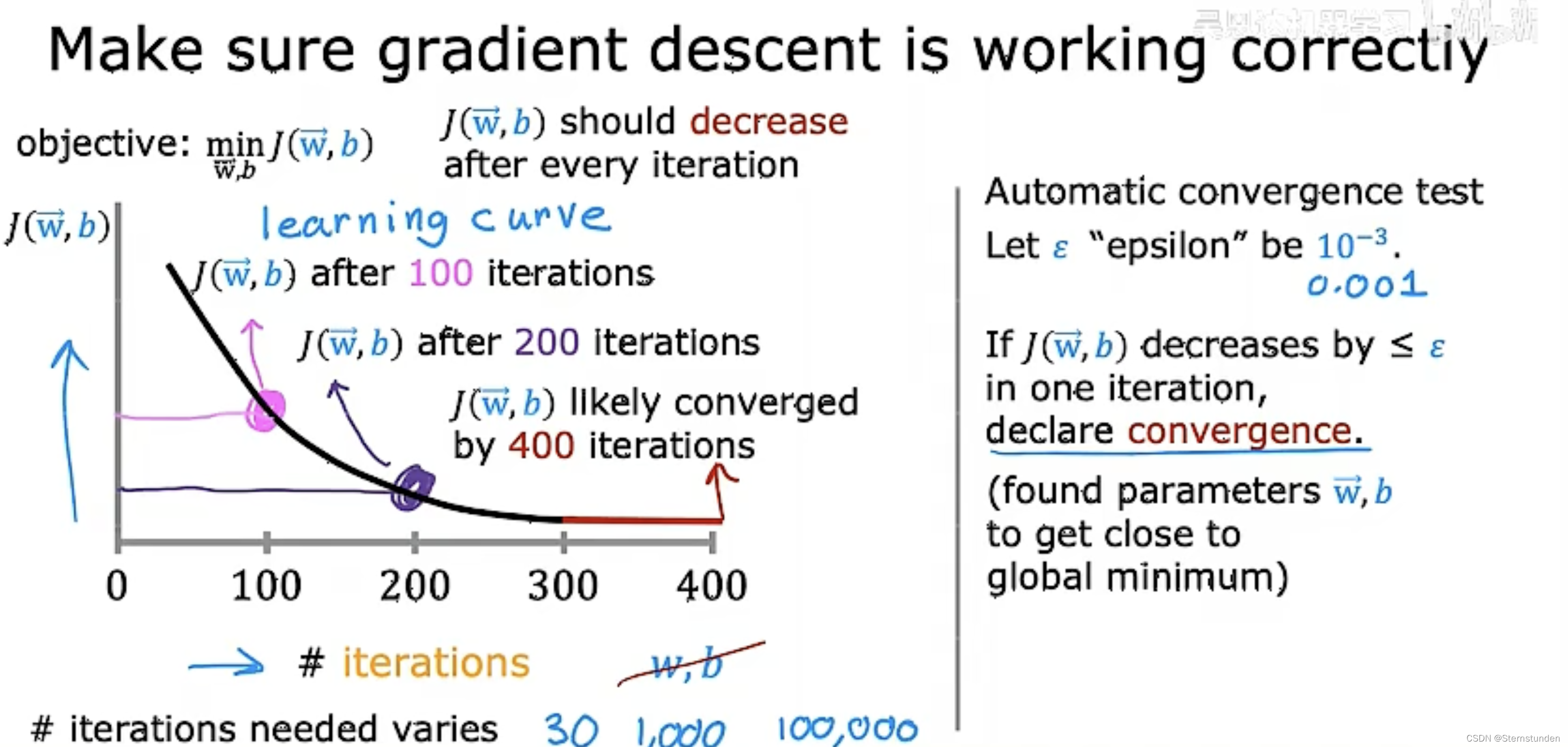

二、判断是否收敛

学习曲线?/ 自动收敛测试

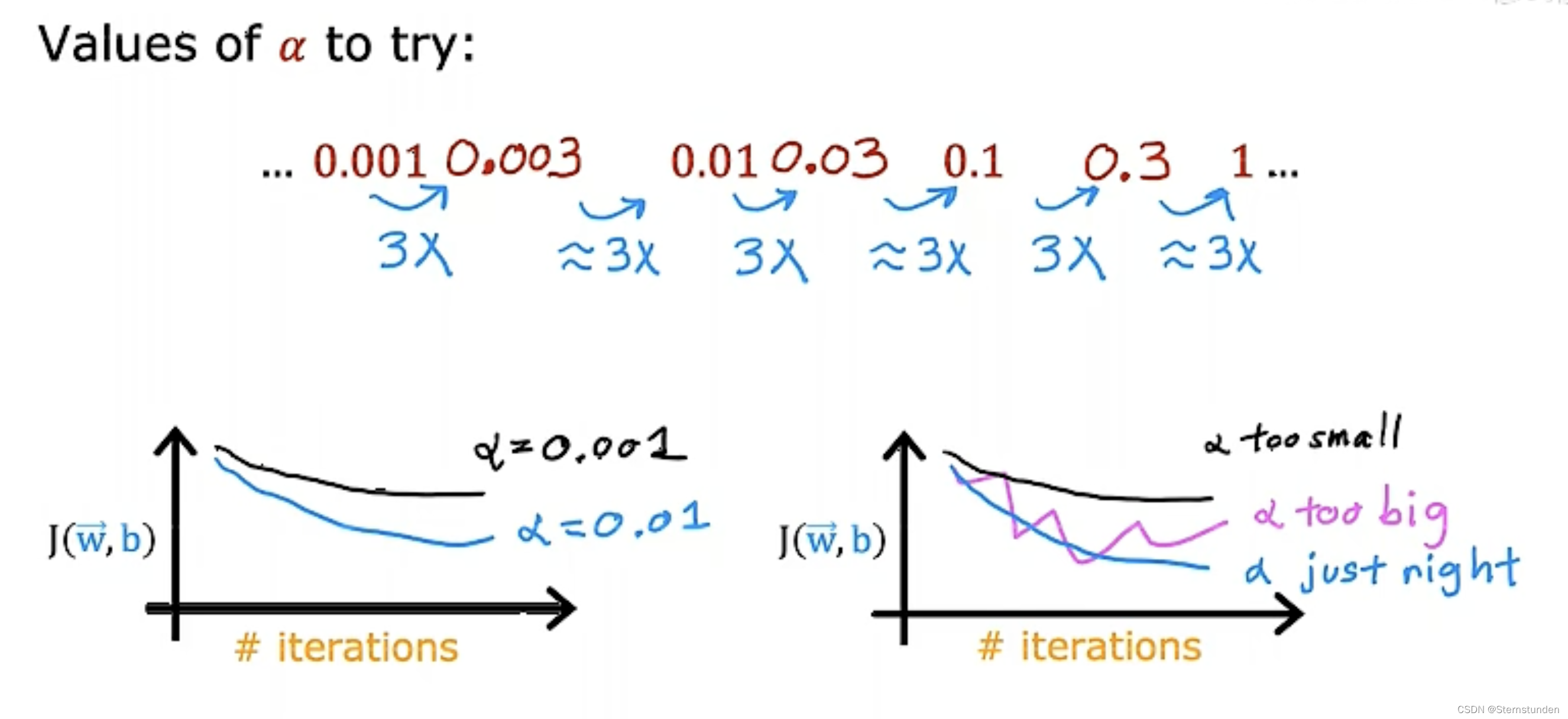

三、选择合适的学习率

四、特征工程

目标:选择合适的特征

特征工程: 利用知识或直觉设计新的特征(通常通过转换或结合原始特征),使算法作出更准确的预测。

-

多元线性回归的特征工程 —— 多项式回归的新算法:

次方/开根号

库学习:sciki

文章来源:https://blog.csdn.net/qq_52063383/article/details/135465213

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- GEE——使用cart机器学习方法对Landsat影像条带修复以NDVI和NDWI为例(全代码)

- 智慧燃气产业链的发展详析

- Unity手机移动设备重力感应

- 数字化医疗新篇章:构建智能医保支付购药系统

- 关于IDEA中Git版本回滚整理

- 阿里云服务器+宝塔 (尝试部署一个最简单的静态页面)

- 使用 Elasticsearch 和 LlamaIndex 进行高级文本检索:句子窗口检索

- 我劝你千万不要去做CSGO游戏搬砖

- Unity Mirror VR联机开发 实战篇(二)

- python股票分析挖掘预测技术指标知识大全之MACD详解(2)