Wilcoxon秩和检验-校正P值(自备)

发布时间:2024年01月09日

R语言 boxplot作图 图内展示校正后的P值(padj)_r语言 p值校正-CSDN博客?

FDR错误发现率-P值校正学习_fdr和p值的关系-CSDN博客

原理介绍:

Benjamini-Hochberg 方法介绍

有N次假设检验,对每一次假设检验都计算其P值,然后将计算出的P值按照从小到大的方式排序,接着从最小的P值开始,按照P(k)≤α*k/N进行比较,然后可以找到最大的第K个满足上述不等式的P值,最终可以认为这K个P值是显著的,其余的P值不显著。

Benjamini-Hochberg方法原理

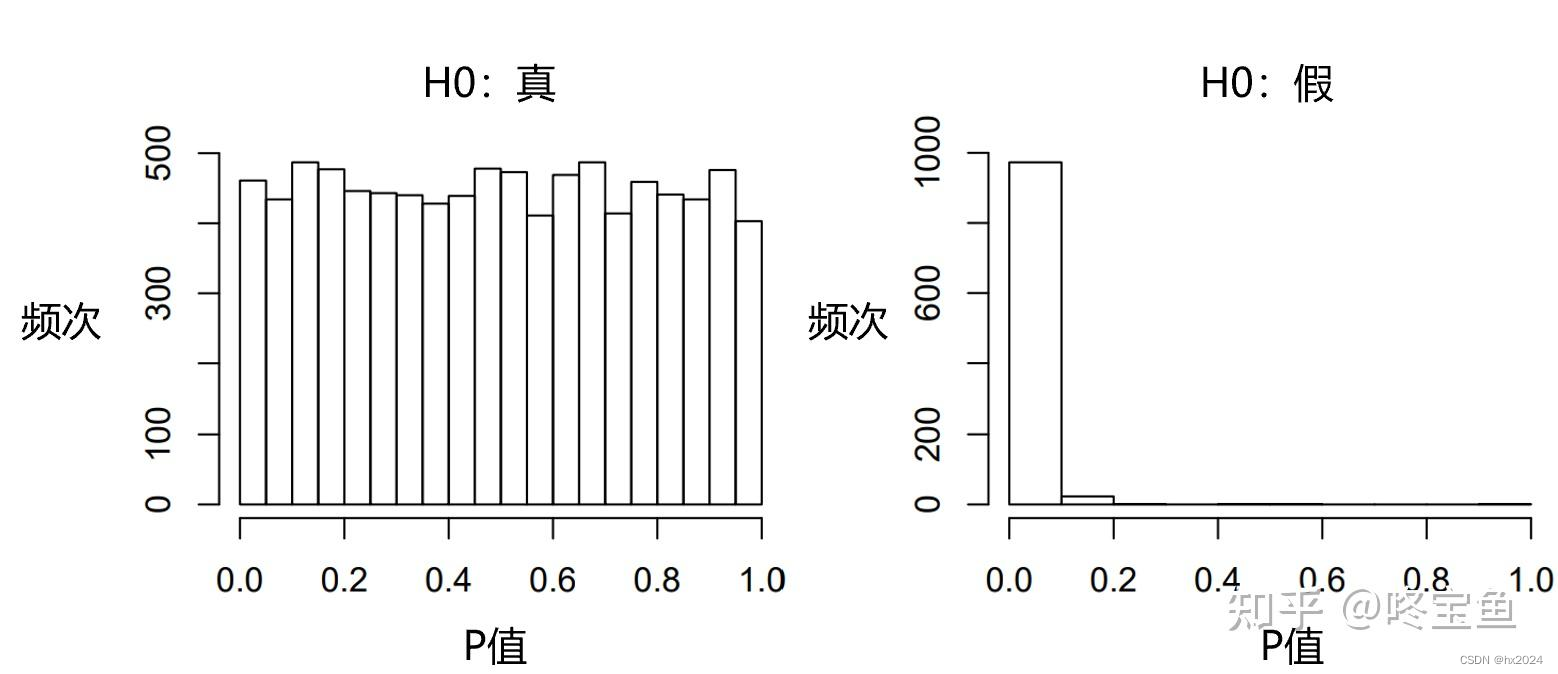

我们将10000次假设检验分为2组:

- 9000次检验的零假设H0:真;

- 1000次检验的零假设H0:假。

然后,可以看到这两组检验的P值分布情况如下图所示:

H0为真时,P值均匀分布在0%-100%之间,为什么会是均匀分布呢?是因为在零假设H0条件下,P值有5%的可能性小于5%,有10%的可能性小于10%,有20%的可能性小于20%,以此类推,可以很直观理解P值的均匀分布。而上图之所以不是完全的均匀分布,是因为样本数量还不够大(当样本数量越大,P值也就越接近于均匀分布)。

H0为假时,P值就不再是均匀分布了,而是集中在0%附近,其他区间基本没有出现。这也比较好理解:H0是假,假设检验的功效越大,检验出H0为假的能力就越好,也就意味着P值越小,拒绝H0的证据越明显。

彻底理解Benjamini-Hochberg方法原理 - 知乎 (zhihu.com)

校正P值比较:?p.adjust函数

?p.adjust

p.adjust(p, method = p.adjust.methods, n = length(p))

p.adjust.methods

# c("holm", "hochberg", "hommel", "bonferroni", "BH", "BY",

# "fdr", "none")##示例:

set.seed(123)

#前25个元素的均值为0,后25个元素的均值为3

x <- rnorm(50, mean = c(rep(0, 25), rep(3, 25)))

#基于向量x计算了一个对应的概率值向量p,概率值乘以2

p <- 2*pnorm(sort(-abs(x)))

round(p, 3)#保留3位小数

round(p.adjust(p), 3)

round(p.adjust(p, "BH"), 3)

Data$Bonferroni =

p.adjust(Data$Raw.p,

method = "bonferroni")

Data$BH =

p.adjust(Data$Raw.p,

method = "BH")

Data$Holm =

p.adjust(Data$ Raw.p,

method = "holm")

Data$Hochberg =

p.adjust(Data$ Raw.p,

method = "hochberg")

Data$Hommel =

p.adjust(Data$ Raw.p,

method = "hommel")

Data$BY =

p.adjust(Data$ Raw.p,

method = "BY")

Data详见:R语言多重比较示例:Bonferroni校正法和Benjamini & Hochberg法-腾讯云开发者社区-腾讯云 (tencent.com)

文章来源:https://blog.csdn.net/hx2024/article/details/135472214

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 【c语言】2每日一练,用指针为5个字符串排序

- ★3. 无重复字符的最长子串

- 桃红葡萄酒是如何成为当代宠儿的?

- LeetCode //C - 1372. Longest ZigZag Path in a Binary Tree

- D3703F 汽车音响静音检测电路芯片,6V~16V SOP8封装

- Aigtek高压放大器使用注意事项及要求有哪些

- DragGAN、DragDiffusion、Edit One for All、RPG(写论文 ing,略读几篇最新及相关论文)

- [ CTF ]【天格】战队WriteUp-第七届“强网杯”全国安全挑战赛

- 具有超低功耗性能的R7F102GAC3CSP、R7F102GAC2DSP、R7F102G6C3CSP RL78/G22微控制器 16-bit MCU

- 基于LDPC和QAM的通信链路误码率MATLAB仿真