多任务学习(MTL),分类任务调研

发布时间:2023年12月18日

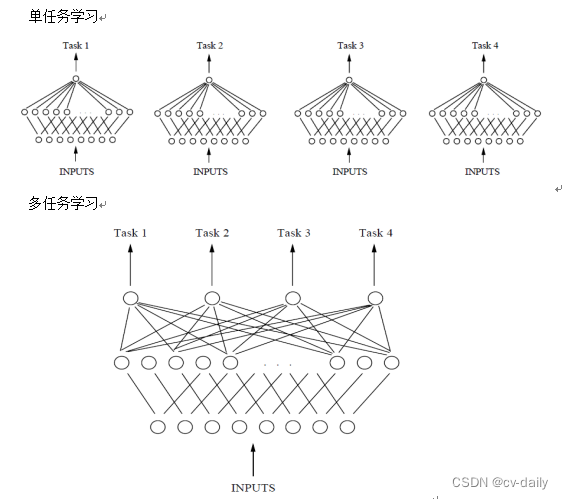

多任务学习的模式

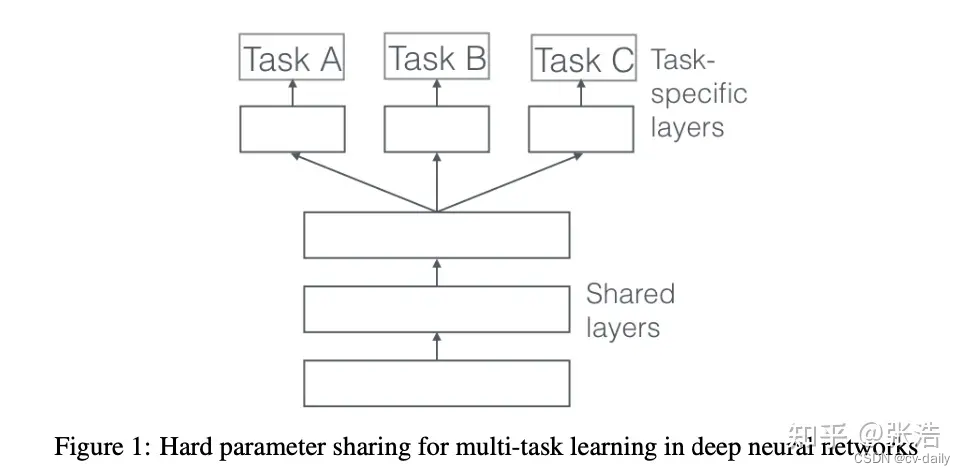

隐层参数的硬共享机制hard parameter sharing:在所有任务之间共享隐藏层,同时保留几个特定任务的输出层来实现。降低了过拟合的风险。直观来讲,越多任务同时学习,我们的模型就能捕捉到越多任务的同一个表示,从而导致在我们原始任务上的过拟合风险越小。

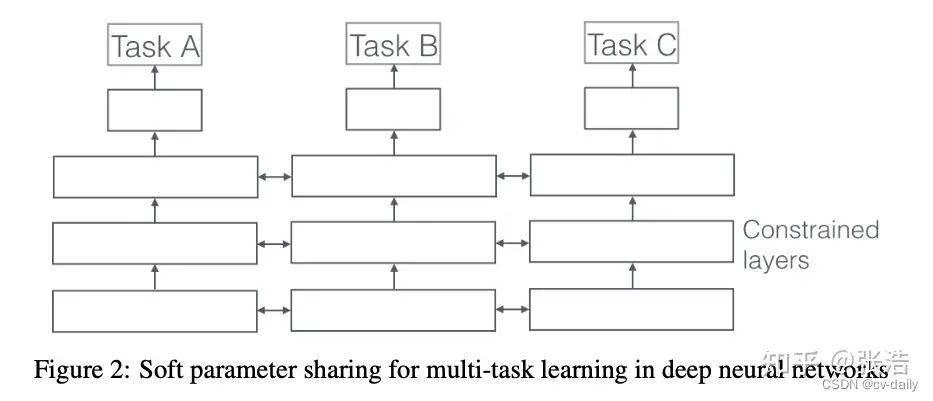

隐层参数的软共享机制soft parameter sharing:每个任务都有自己的模型,自己的参数。模型参数之间的距离是正则化的,以便鼓励参数相似化。

隐层参数的软共享机制soft parameter sharing:每个任务都有自己的模型,自己的参数。模型参数之间的距离是正则化的,以便鼓励参数相似化。

文章来源:https://blog.csdn.net/weixin_41012399/article/details/135062374

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- Python异常、模块和包

- 呵护眼睛·守护视力·2024山东国际青少年眼健康产业展览会

- GC6139——单通道5V高细分步进电机,应用于摇头机,X,Y控制,聚焦控制等产品中,可替代MS41939

- 手把手教你学会接口自动化4系列-封装登录调用之后的代码展示

- 初识 WebGPU 以及遇到 WebGPU not supported 错误的解决方法

- 【C#与Redis】--目录

- TypeScript【枚举、联合类型函数_基础、函数_参数说明 、类的概念、类的创建】(二)-全面详解(学习总结---从入门到深化)

- 人工智能在医疗领域的突破:从诊断到治疗的创新

- JS获取当前时间以及一个月前的时间

- 命令行下载huggingface 受保护模型