Torch not compiled with CUDA enabled

发布时间:2024年01月12日

最近接触chatglm3对话预训练模型,从git上下载,装包装半天,最后终于跑起来了,但是一对他进行对话,后台就开始报错了

File "E:\Python311\Lib\site-packages\torch\nn\modules\linear.py", line 114, in forward return F.linear(input, self.weight, self.bias)

反正大概是torch这个包有问题,于是就单独写个torch的代码执行一下,代码如下:

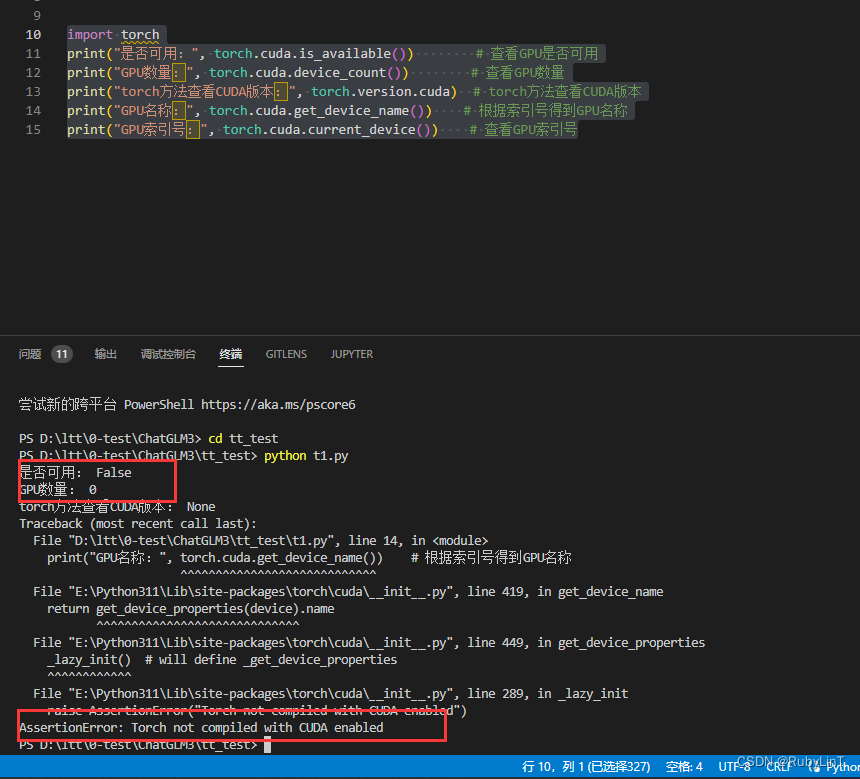

import torch

print("是否可用:", torch.cuda.is_available()) # 查看GPU是否可用

print("GPU数量:", torch.cuda.device_count()) # 查看GPU数量

print("torch方法查看CUDA版本:", torch.version.cuda) # torch方法查看CUDA版本

print("GPU名称:", torch.cuda.get_device_name()) # 根据索引号得到GPU名称

print("GPU索引号:", torch.cuda.current_device()) # 查看GPU索引号然后就报错:说我的GPU显卡不可用

报错信息1:?Torch not compiled with CUDA enabled

搜了一下大概是说CUDA不可用

咱就说一个硬件小白,完全不知道是啥情况,搜了一下解决办法也是说用NVIDIA驱动更新一下CUDA版本的与你电脑的GPU版本一致

电脑终端输入了一下:nvidia-smi

又执行报错了,说电脑没有nvidia-smi

于是又搜索了一下是要我去nvidia官网去下载一个nvidia驱动

那么到了下载的时候要选择对应的类型、系列啥的要与电脑的显卡匹配

找了一下根本没有我这个型号的

后来才发现

nvidia是有自己的nvidia显卡,然而我电脑的显卡是intel的

nvidia的驱动只能给nvidia的显卡用

那么这条路就断了

于是直接搜什么可以装CUDA

一搜才知道CUDA是卡厂商NVIDIA推出的运算平台

破案了,intel目前还没有在任何一款GPU中支持CUDA驱动程序

看有些大佬是通过租用服务器实现的

太难了,难道就没人更新一下chatglm3文档吗,跟咱们小白说一下chatglm3不支持intel开发嘛

补充:后来找到了一篇文章,很仔细的教我们怎么搭建chatglm

文章来源:https://blog.csdn.net/RubyLinT/article/details/135533963

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!