MATLAB实现主成分回归数学建模算法

发布时间:2024年01月13日

主成分回归(Principal Component Regression,简称PCR)是一种在多元统计分析中用于建模和预测的方法。PCR结合了主成分分析(Principal Component Analysis,简称PCA)和多元线性回归(Multiple Linear Regression)的思想。

下面是主成分回归的基本步骤:

1. **数据标准化:** 对原始数据进行标准化处理,使得每个变量具有相同的尺度。

2. **主成分分析:** 利用主成分分析方法对标准化后的数据进行降维,得到一组称为主成分的新变量。主成分是原始变量的线性组合,其中第一个主成分包含数据中最大的方差,第二个主成分包含的方差次之,以此类推。

3. **选择主成分:** 选择一定数量的主成分,通常通过保留累积方差的百分比或者其他准则来确定。

4. **建立回归模型:** 利用选定的主成分作为新的自变量,建立多元线性回归模型。回归系数表示了每个主成分在原始数据中的权重。

5. **模型评估和预测:** 对建立的主成分回归模型进行评估,包括模型的拟合度、预测精度等。

主成分回归的优势在于可以通过主成分的选择来减少变量的数量,解决多重共线性问题,提高模型的解释性。然而,PCR也有一些限制,包括对噪声敏感以及在解释模型时可能较为困难。此外,主成分回归的性能与选取的主成分数量密切相关,需要通过交叉验证等方法来确定最佳的主成分数量。

MATLAB的代码如下所示:

clc,clear

a=load('data10_5.txt'); [m,n]=size(a);

x0=a(:,[1:n-1]); y0=a(:,n);

hg1=[ones(m,1),x0]\y0; %计算普通最小二乘法回归系数

hg1=hg1' %变成行向量显示回归系数,其中第1个分量是常数项,其它按x1,...,xn排序

fprintf('y=%f',hg1(1)); %开始显示普通最小二乘法回归结果

for i=2:n

if hg1(i)>0

fprintf('+%f*x%d',hg1(i),i-1);

else

fprintf('%f*x%d',hg1(i),i-1)

end

end

fprintf('\n')

r=corrcoef(x0) %计算相关系数矩阵

xd=zscore(x0); %对设计矩阵进行标准化处理

yd=zscore(y0); %对y0进行标准化处理

[vec1,lamda,rate]=pcacov(r) %vec1为r的特征向量,lamda为r的特征值,rate为各个主成分的贡献率

f=repmat(sign(sum(vec1)),size(vec1,1),1); %构造与vec1同维数的元素为±1的矩阵

vec2=vec1.*f %修改特征向量的正负号,使得特征向量的所有分量和为正

contr=cumsum(rate) %计算累积贡献率,第i个分量表示前i个主成分的贡献率

df=xd*vec2; %计算所有主成分的得分

num=input('请选项主成分的个数:') %通过累积贡献率交互式选择主成分的个数

hg21=df(:,[1:num])\yd %主成分变量的回归系数,这里由于数据标准化,回归方程的常数项为0

hg22=vec2(:,1:num)*hg21 %标准化变量的回归方程系数

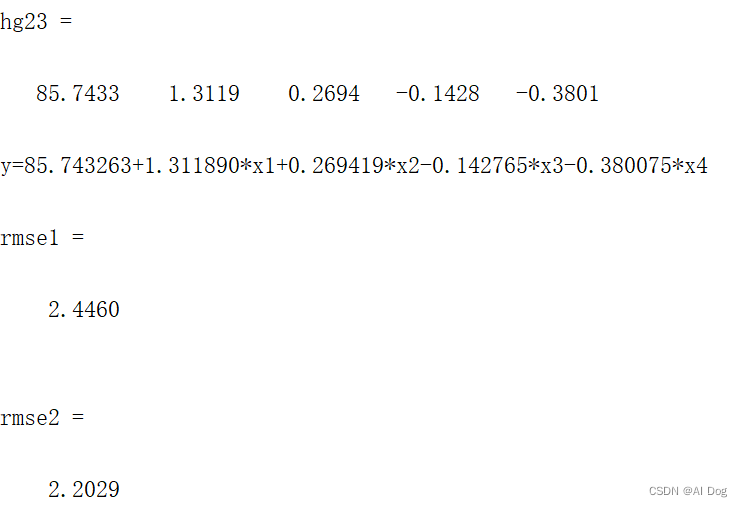

hg23=[mean(y0)-std(y0)*mean(x0)./std(x0)*hg22, std(y0)*hg22'./std(x0)] %计算原始变量回归方程的系数

fprintf('y=%f',hg23(1)); %开始显示主成分回归结果

for i=2:n

if hg23(i)>0

fprintf('+%f*x%d',hg23(i),i-1);

else

fprintf('%f*x%d',hg23(i),i-1);

end

end

fprintf('\n')

%下面计算两种回归分析的剩余标准差

rmse1=sqrt(sum((hg1(1)+x0*hg1(2:end)'-y0).^2)/(m-n)) %拟合了n个参数

rmse2=sqrt(sum((hg23(1)+x0*hg23(2:end)'-y0).^2)/(m-num)) %拟合了num个参数

运行结果如下:

文章来源:https://blog.csdn.net/weixin_58438203/article/details/135525329

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 小白入门基础 - Spring的Bean超详解

- 这可能是最全面的Spring面试八股文了

- 谷达冠楠:抖音开网店创业怎么做

- 线性代数 --- 为什么LU分解中L矩阵的行列式一定等于(+-)1?

- 揭开`this`的神秘面纱:探索 JavaScript 中的上下文密钥(下)

- javacv和opencv对图文视频编辑-idea搭建项目

- 045.Python包和模块_初识包和模块

- 内存卡为什么会提示格式化,内存卡提示格式化还能恢复吗

- 字符迷宫(期末考模拟题)

- missingno——缺失数据可视化