如何优化k8s中HPA的弹性速率?

本文分享自华为云社区《K8s 核心资源指标HPA性能优化之路》,作者:可以交个朋友。

一 背景

以弹性指标为cpu、memory为例。在Kubernetes 1.7版本中引入了聚合层,允许第三方应用程序注册相关API接口到kube-apiserver上。其中?/apis/metrics.k8s.io/v1beta1?一般由metrics-server程序提供,以插件的形式安装在K8s集群中。相关流程如下:

纵观整个链路如何优化HPA的弹性速率呢?

二 关键时间点分析

- 首先对于HPA controller

Kubernetes 将HPA pod自动扩缩实现为一个间歇运行的控制回路,间隔由kube-controller-manager的 --horizontal-pod-autoscaler-sync-period参数设置,默认间隔为15s。

- 然后kubelet指标汇总。kubelet提供指标端点:10250/metrics/resource 15刷新一次指标数据。容器指标由cadvisor负责采集,cAdvisor已经集成到kubelet程序当中。

- metrics-server默认抓取时间为60s一次,60s的时间间隔内,kubelet的指标已经刷新4轮了,HPAcontroller也运行4轮了。

所以我们优化的思路可以从metrics-server程序入手,可以将HPA弹性响应速率提高45s左右。kube-controller-manager的参数不宜修改,设置过短会对集群控制面造成压力,产生过载风险。kubelet刷新指标间隔15s 同样也是一个合理且推荐的数值。

三 优化方案

metrics-server启动参数--metric-resolution可用于设置指标保留的时间。默认是60s,我们可以将该值设置为15s 加快pod资源指标的获取速率。

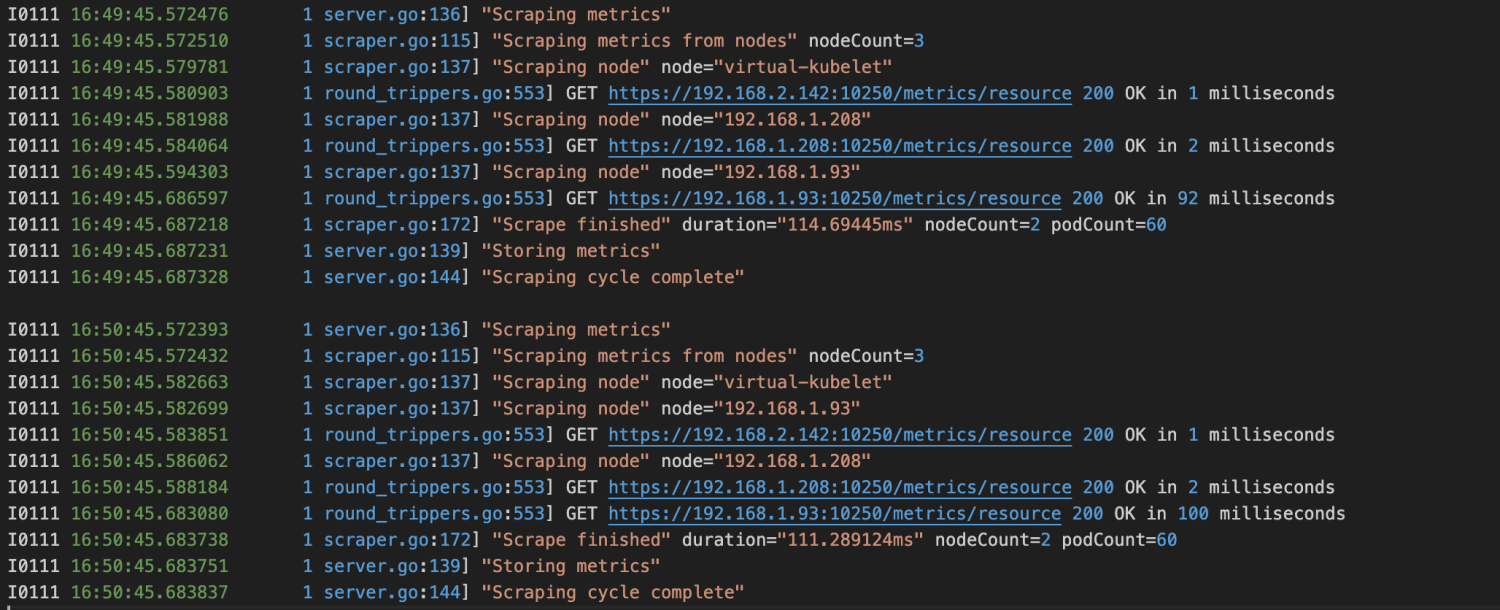

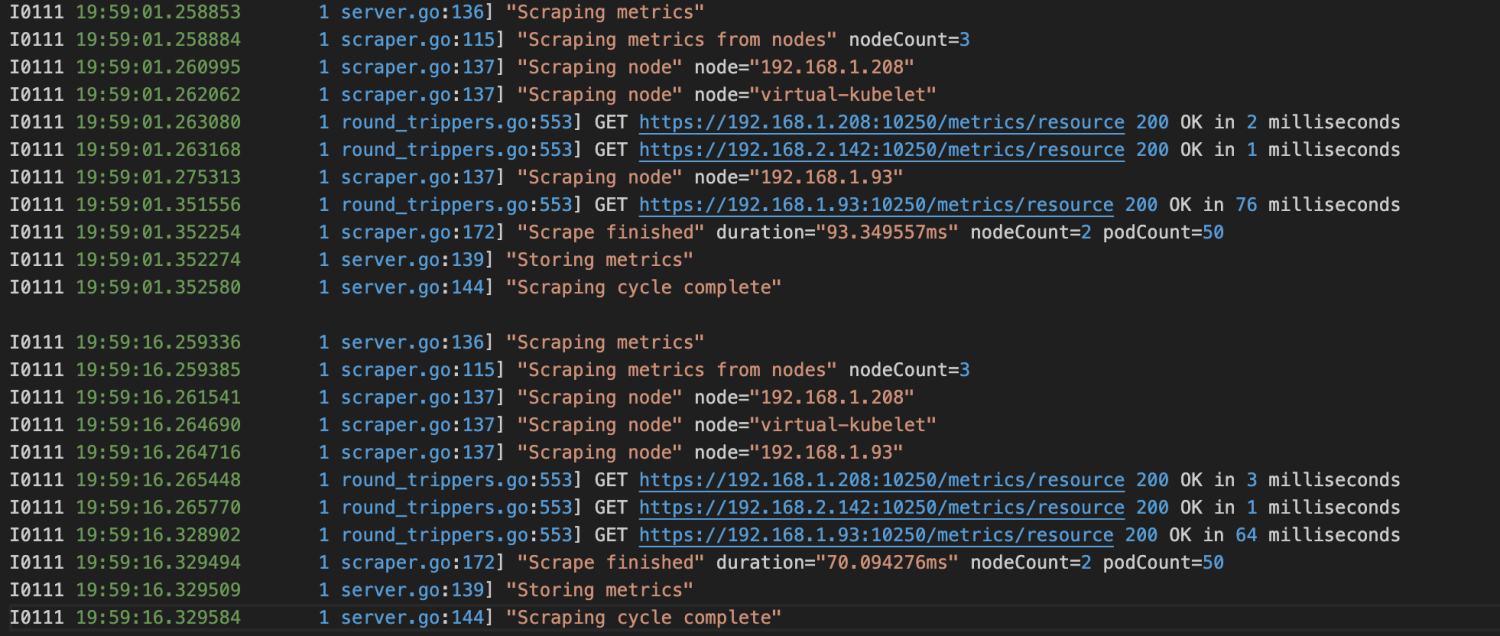

1、未修改指标保存时间前,查看metrics-server日志可以发现平均60s抓取一次指标

2、修改metrics-server负载配置,添加启动参数

containers:

- command:

- /metrics-server

- --metric-resolution=15s # 添加该参数,加快指标更新速率

- --v=6 # 可设置日志级别,可以通过日志查看进程工作信息

- xxx查看metrics-server日志发现抓取指标间隔为15s

四 验证过程

主要是对比优化该参数后,HPA弹性的速率是否提高。

基于负载app01创建伸缩策略,以cpu指标为例,HPA配置清单如下:

apiVersion: autoscaling/v2

kind: HorizontalPodAutoscaler

metadata:

name: app01

namespace: hu

spec:

scaleTargetRef:

apiVersion: apps/v1

kind: Deployment

name: app01

minReplicas: 1

maxReplicas: 10

metrics:

- type: Resource

resource:

name: cpu

target:

type: Utilization

averageUtilization: 504.1 优化前

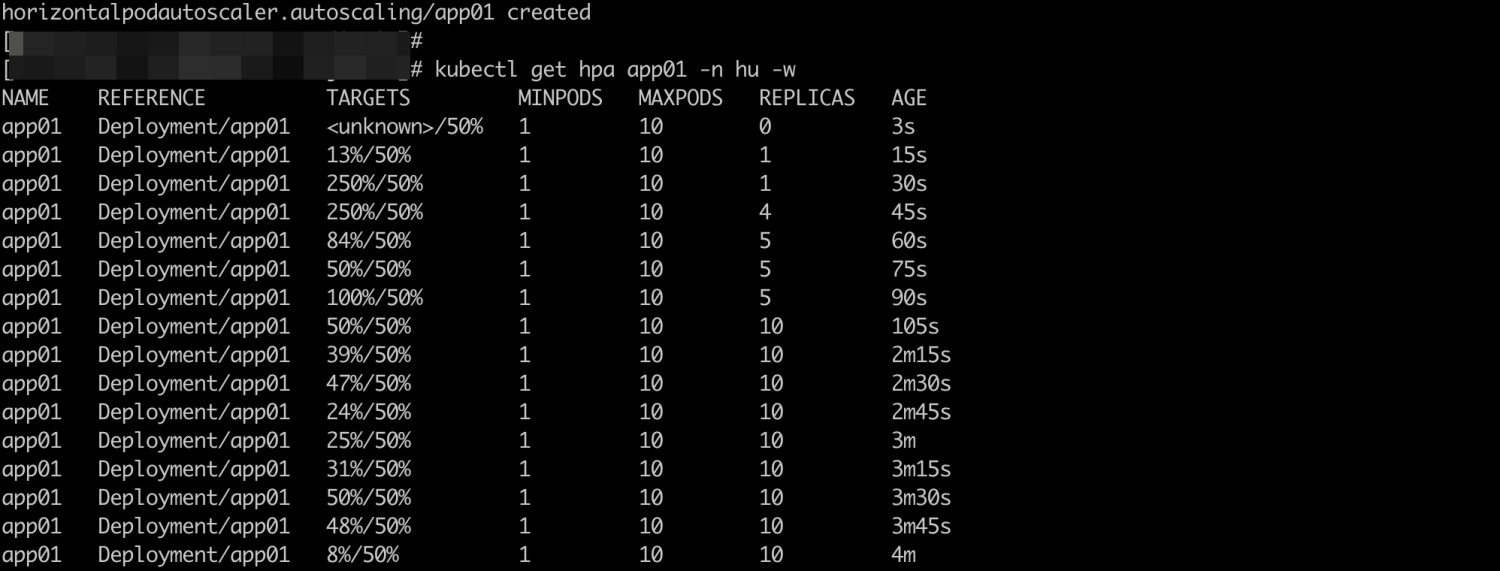

对工作负载进行压测,探知HPAcontroller感知metrics的变化并观察HPA弹性的灵敏度

通过上图我们可以发现,HPA对指标变化感知滞后:

其中60s-90s区间内,指标数值一直为250%,未发生变化。实际情况是HPAcontroller已经运转三次,但是每次获取的指标均为250%。

4m-7m15s区间内,每隔60s HPA状态刷新一次,也就是说60s后 HPAcontroller才能感知下游服务的状态变化。

可能大家也会有疑问,在执行 kubectl get xxx -w 的时候,每隔15s也刷新了一次数据,那是因为有其它value值发生了变化,例如REPLICAS值发生了变化,所以被记录了下来,并不是因为指标刷新触发的。

4.2 优化后

对工作负载进行压测,探知HPAcontroller感知metrics的变化并观察HPA弹性的灵敏度

通过上图我们可以发现,HPA对指标变化的获取提升明显,几乎每隔15s指标都会变化一次,如果获取的指标满足扩容条件则会立马扩容。

其中 60s-90s 区间内,其它选项保持不变(MINPODS、MAXPODS、REPLICAS),指标每隔15s就会刷新一次。HPA会根据当前获取的指标结合特定算法进行扩缩的实例的判断。

其中2m15s-4m 区间内,其它选项保持不变,指标固定每隔15s会刷新一次。

可能大家会有疑问,明明指标已经达到扩容条件了,例如60s那个时间点,这就和HPA算法有关系了,如果存在未就绪状态或者不健康的pod,这些pod会被搁置掉不参与计算,所以75s那个时间,并未看到扩容行为。但是这些动作不与metrics指标层面冲突,metrics-server每隔15s上报一次指标,剩下具体的扩缩就是HPA controller该做的了。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 外汇天眼:在交易中有多少属于你的行情?

- Windows安装SQL server2022数据库教程

- BACCM业务模型核心概念

- 助力智能人群检测计数,基于YOLOv7开发构建通用场景下人群检测计数识别系统

- Cnas认证路上你关心的那些个问题

- 亚信科技AntDB数据库——深入了解AntDB-M元数据锁的实现(二)

- 旭日X3派开发板部署自己的yolov5模型

- 动态编译 - Dynamically Compile and Load External Java Classes

- Linux之后台执行命令:nohup和&的使用

- 408数据结构错题知识点拾遗