【MATLAB】PSO粒子群优化LSTM(PSO_LSTM)的时间序列预测

有意向获取代码,请转文末观看代码获取方式~也可转原文链接获取~

1 基本定义

PSO粒子群优化LSTM(PSO-LSTM)是一种将粒子群优化算法(PSO)与长短期记忆神经网络(LSTM)相结合的混合模型。该算法通过模拟鸟群觅食行为,在解空间中搜索和迭代,以找到全局最优解。

在PSO-LSTM中,每个粒子代表一个LSTM模型的参数组合。粒子的位置表示参数的取值,速度表示参数的更新方向和幅度。粒子群根据个体最优和全局最优的信息进行搜索和更新,通过迭代找到最优的参数组合,从而提高LSTM模型的性能。

具体来说,PSO-LSTM的训练过程包括初始化粒子群、计算适应度、更新粒子位置和速度等步骤。首先,随机生成一组初始参数,并为每个粒子分配初始位置和速度。然后,根据当前参数组合计算适应度,评估模型的性能。接下来,根据粒子群中各个粒子的适应度值和历史最优值,更新粒子的位置和速度。最后,不断迭代以上步骤,直到满足停止条件或达到最大迭代次数。

通过使用粒子群优化算法对LSTM模型进行参数搜索和优化,PSO-LSTM在训练过程中能够更好地避免陷入局部最优,并且能够更快地收敛到全局最优解。实验证明,PSO-LSTM在多个任务和数据集上都取得了较好的性能表现,比传统的LSTM模型具有更好的泛化能力和稳定性。

PSO-LSTM的时间序列预测算法的原理基于以下步骤:

-

「初始化粒子群」:首先,需要为每个粒子(即一组LSTM参数)设定初始位置和速度。这些初始值通常随机生成,范围根据参数的约束条件确定。

-

「适应度评估」:对于每个粒子,使用当前的参数配置构建LSTM模型,然后使用该模型对训练数据进行预测。预测误差(通常使用均方误差MSE等指标)即为该粒子的适应度值。

-

「更新粒子位置和速度」:基于粒子的历史最佳位置和全局最佳位置,更新粒子的速度和位置。这是PSO算法的核心步骤,它利用了鸟群觅食行为的模拟,通过个体和群体信息的交互,引导粒子向最优解的方向移动。

-

「迭代优化」:重复上述步骤,直到满足停止条件(如达到预设的最大迭代次数,或适应度值达到预设阈值等)。在每次迭代中,都会更新粒子的位置和速度,并重新评估适应度值。

-

「模型预测」:在训练完成后,使用得到的全局最优参数配置构建最终的LSTM模型,并对测试数据进行预测。

通过这样的流程,PSO-LSTM 能够在搜索空间中找到一组最佳的参数配置,使得 LSTM 模型能够更好地拟合训练数据,并提高预测精度。这种算法结合了群体智能和优化技术的优点,能够在处理复杂和动态的时间序列数据时表现出色。

PSO-LSTM时间序列预测算法的优势主要包括以下几个方面:

-

「全局搜索能力强」:PSO算法是一种基于种群的优化算法,它利用群体智慧,通过个体之间的信息交流与合作,能够更有效地搜索全局最优解。这避免了传统优化算法容易陷入局部最优的问题。

-

「参数调整优化效果好」:PSO-LSTM算法能够自动调整LSTM模型的参数,优化模型的性能。相较于传统的手工调整参数方法,PSO-LSTM能够更快地找到最优参数组合,提高预测精度。

-

「自适应能力强」:PSO-LSTM算法能够根据问题的复杂性和数据的变化自动调整参数和模型结构,具有较强的自适应能力。这使得PSO-LSTM在处理具有不确定性和复杂性的时间序列预测问题时具有更大的优势。

-

「可扩展性强」:PSO-LSTM算法可以与其他机器学习算法和深度学习算法相结合,形成更加复杂的混合模型。这为解决复杂问题提供了更多的可能性。

-

「易于实现和理解」:PSO算法相对简单易懂,实现起来较为方便。相较于一些复杂的优化算法,PSO-LSTM算法更加易于理解和实现,降低了算法的应用门槛。

总之,PSO-LSTM时间序列预测算法在全局搜索、参数调整、自适应能力、可扩展性和易实现性等方面具有优势,使得它在处理时间序列预测问题时具有更高的性能和效率。

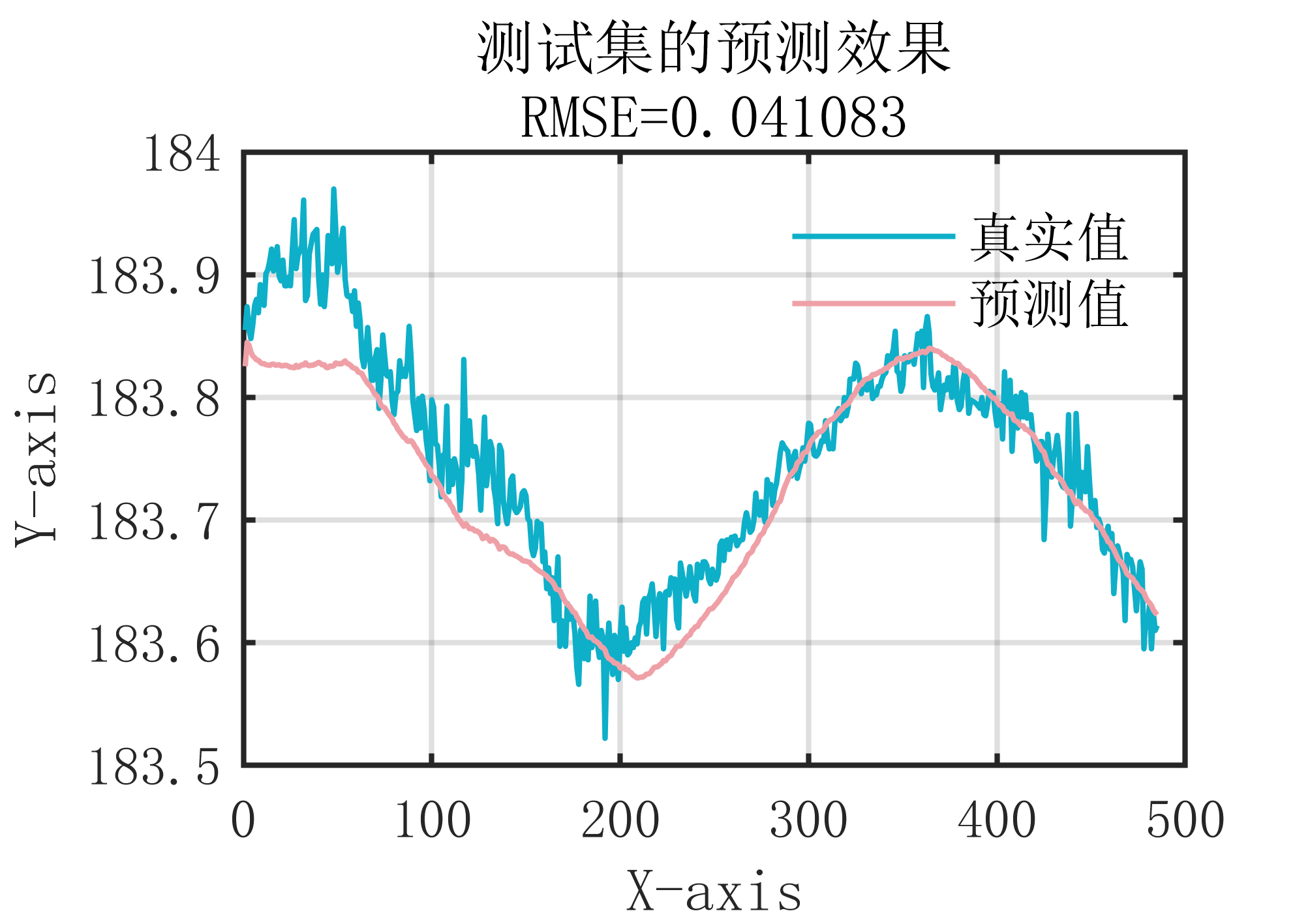

2 出图效果

附出图效果如下:

附视频教程操作:

【MATLAB】PSO粒子群优化LSTM(PSO

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 字符串序列判定 - 华为OD统一考试

- Linux stm32串口下载程序

- ensp vlan小实验

- Android Studio(Flutter)常用快捷键

- Vscode 上安装 Compilot

- pandas 笔记:corr(计算各列之间的相似性)

- 将二叉搜索树转换成排序的双向链表:深入解析与实现 ——剑指offer - JZ36 二叉搜索树与双向链表

- 43.@Bean之间的方法调用是怎么保证单例的?(@Configuration加与不加的区别是什么?)

- spark-sql字段血缘实现

- 使用R从高程相对坐标数据生成tif图层的详细方法及代码