Spark编程语言选择:Scala、Java和Python

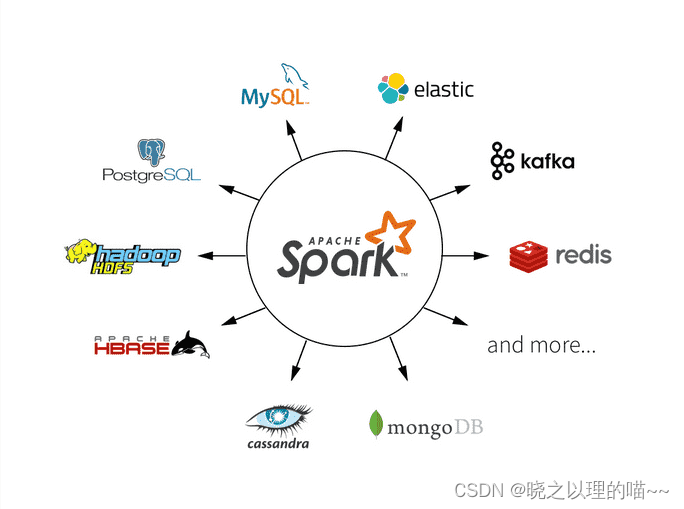

在大数据处理和分析领域,Apache Spark已经成为一种非常流行的工具。它提供了丰富的API和强大的性能,同时支持多种编程语言,包括Scala、Java和Python。选择合适的编程语言可以直接影响Spark应用程序的性能、可维护性和开发效率。在本文中,我们将详细探讨每种编程语言,并提供示例代码来演示它们在Spark中的用法。

Scala编程

Scala简介

Scala是一种多范式编程语言,结合了面向对象编程和函数式编程的特性。它具有静态类型系统和强大的类型推断功能,使得代码更加安全和具有可读性。

Scala与Spark的结合

Scala是Spark的官方支持语言,Spark的核心代码就是用Scala编写的。这意味着Scala在Spark中具有天然的优势,API设计与Spark高度契合。

// 示例:使用Scala创建一个RDD并执行转换操作

val data = Array(1, 2, 3, 4, 5)

val rdd = sparkContext.parallelize(data)

val doubledRDD = rdd.map(x => x * 2)

Scala的优势

- 性能:Scala通常比Python快,因为它是一种静态类型语言,编译时类型检查可以优化代码。

- 类型安全:Scala的类型系统可以在编译时捕获错误,减少运行时异常。

- 函数式编程:Scala支持函数式编程,可以更容易地进行数据转换和处理。

// 示例:使用Scala进行高性能的数据处理

val bigData = sparkContext.parallelize(1 to 1000000)

val result = bigData.reduce((x, y) => x + y)

Java编程

Java简介

Java是一种广泛使用的编程语言,具有跨平台性和丰富的生态系统。它是一种静态类型语言,以其稳定性和性能而闻名。

Java与Spark的结合

Spark提供了Java API,允许开发人员使用Java编写Spark应用程序。Java API与Scala API非常相似,因此Java开发人员可以轻松迁移到Spark。

// 示例:使用Java创建一个RDD并执行转换操作

List<Integer> data = Arrays.asList(1, 2, 3, 4, 5);

JavaRDD<Integer> rdd = sparkContext.parallelize(data);

JavaRDD<Integer> doubledRDD = rdd.map(x -> x * 2);

Java的优势

- 广泛应用:Java是一种流行的编程语言,在大型企业和项目中广泛使用,有大量的Java开发人员和资源。

- 大型团队支持:对于大型团队和组织,Java通常更容易管理和维护。

- 成熟的工具:Java有丰富的开发工具和框架,可以提高开发效率。

// 示例:使用Java进行大规模数据处理

JavaRDD<Integer> bigData = sparkContext.parallelize(IntStream.rangeClosed(1, 1000000).boxed().collect(Collectors.toList()));

int result = bigData.reduce((x, y) -> x + y);

Python编程

Python简介

Python是一种易学易用的编程语言,具有清晰的语法和大量的第三方库。它是一种解释型语言,适合快速原型开发和数据科学任务。

Python与Spark的结合

Spark提供了PySpark,允许使用Python编写Spark应用程序。虽然PySpark的性能通常低于Scala和Java,但它在数据科学和机器学习领域非常流行。

# 示例:使用Python创建一个RDD并执行转换操作

data = [1, 2, 3, 4, 5]

rdd = sparkContext.parallelize(data)

doubled_rdd = rdd.map(lambda x: x * 2)

Python的优势

- 易学易用:Python是一种非常容易学习和使用的语言,适合快速原型开发。

- 数据科学支持:Python拥有丰富的数据科学库,如NumPy、Pandas和Scikit-Learn,使其成为数据分析的理想选择。

- 快速原型开发:Python允许快速迭代开发,适合探索性分析和实验性工作。

# 示例:使用Python进行数据分析和可视化

import pyspark.sql.functions as F

df = spark.read.csv("data.csv", header=True, inferSchema=True)

result = df.groupBy("Category").agg(F.avg("Price"), F.max("Quantity"))

如何选择编程语言

在选择Spark中的编程语言时,需要考虑以下因素:

- 项目需求:根据项目的性质和需求选择最合适的语言。

- 开发团队:考虑开发团队的技能和经验。

- 性能要求:如果性能是首要考虑因素,Scala或Java可能更合适。

- 数据科学任务:如果需要进行数据科学或机器学习任务,Python是一个不错的选择。

- 快速原型开发:如果需要快速原型开发或探索性分析,Python可能更方便。

总结

选择合适的编程语言对于在Apache Spark中成功开发和部署大数据应用程序至关重要。Scala、Java和Python都有各自的优势和适用场景。根据项目需求、团队技能和性能要求做出明智的选择,并随着项目的发展不断优化和调整。希望本文提供的详细描述和示例代码有助于您更好地理解和选择适当的编程语言来应对大数据挑战。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!