感知机、多层感知机、激活函数sigmoid

发布时间:2024年01月11日

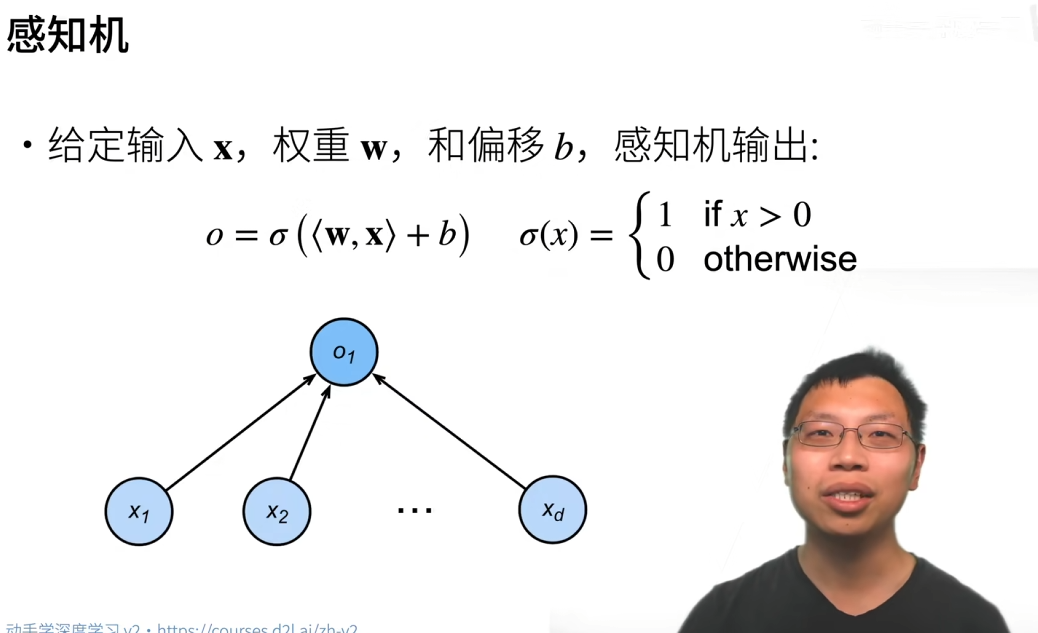

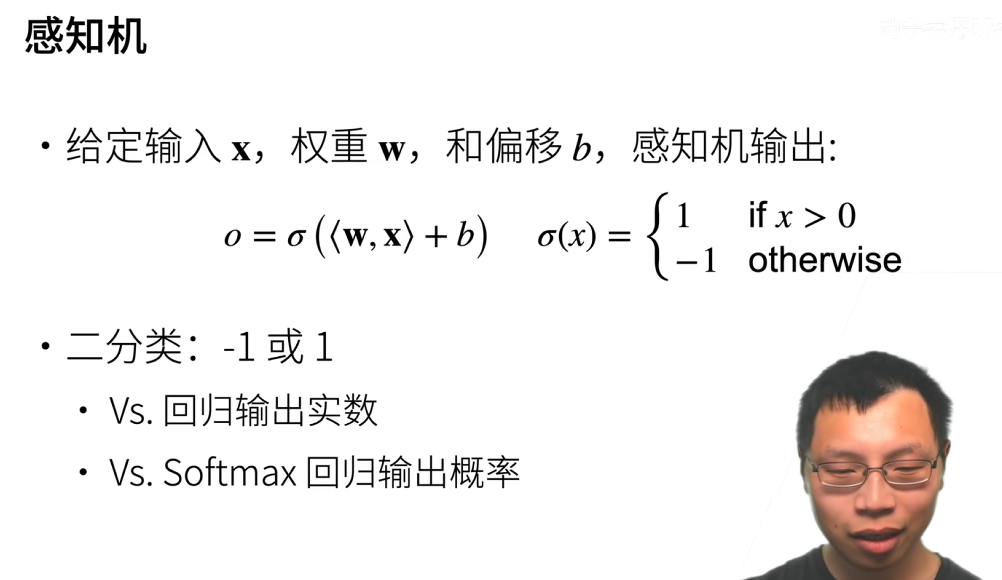

感知机

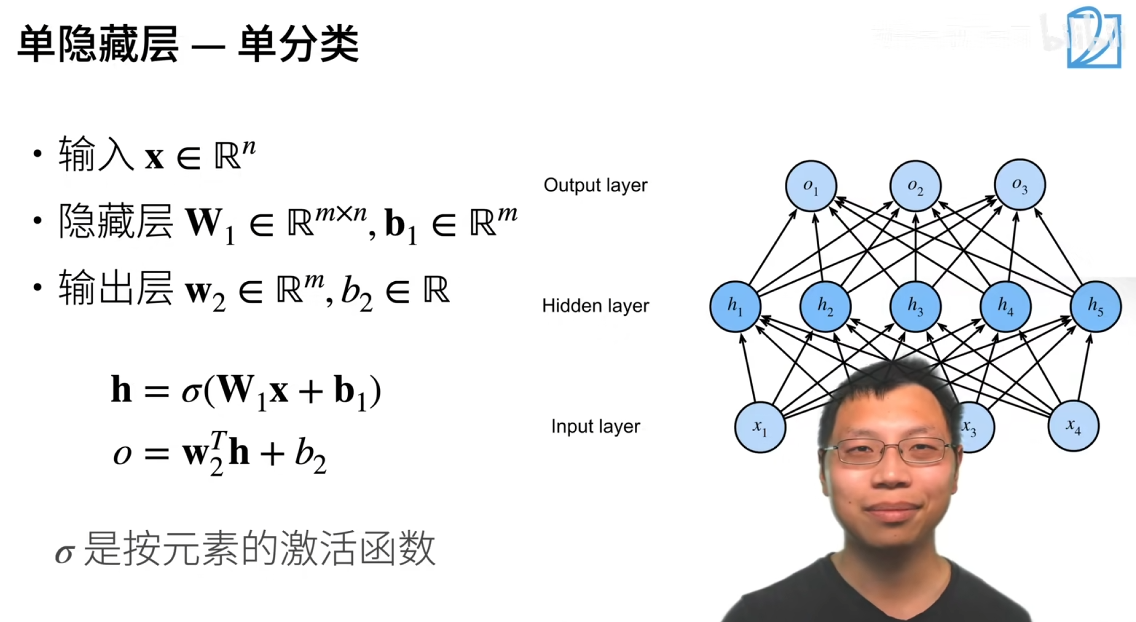

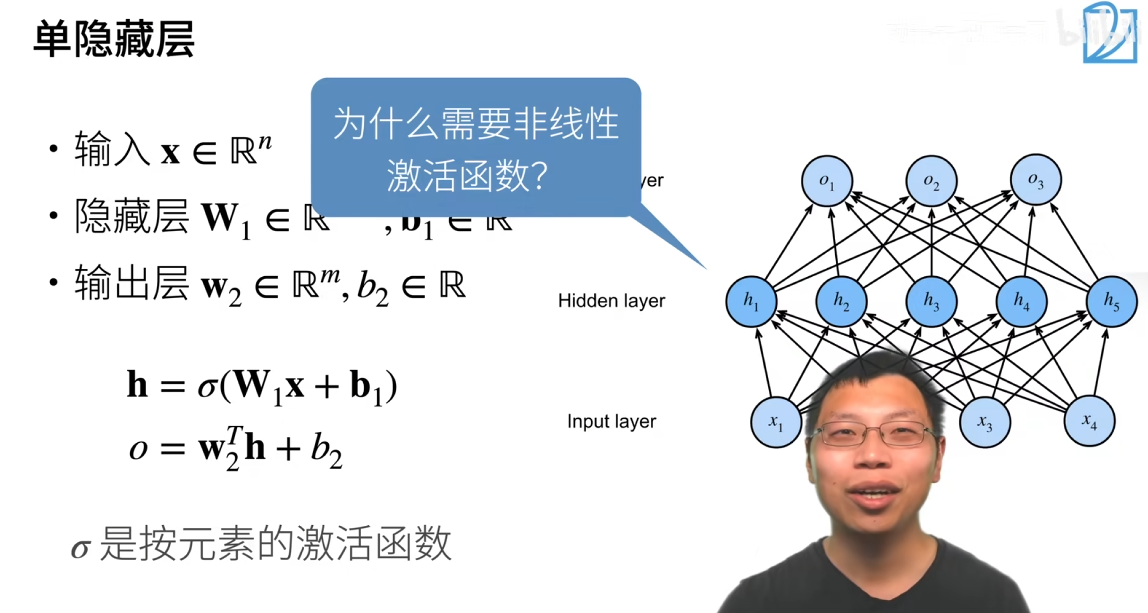

w和x做内积加上一个偏置常熟b,让其做一个σ函数,σ函数可以有多个选择。

感知机其实就是二分类问题。

以前回归输出的是实数,softmax回归输出的是概率。

以前回归输出的是实数,softmax回归输出的是概率。

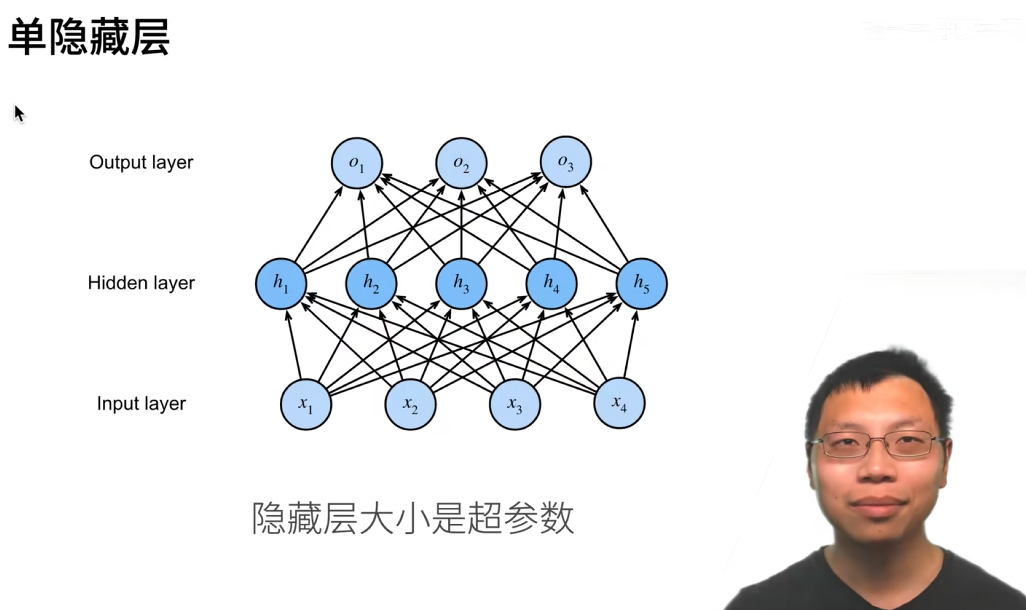

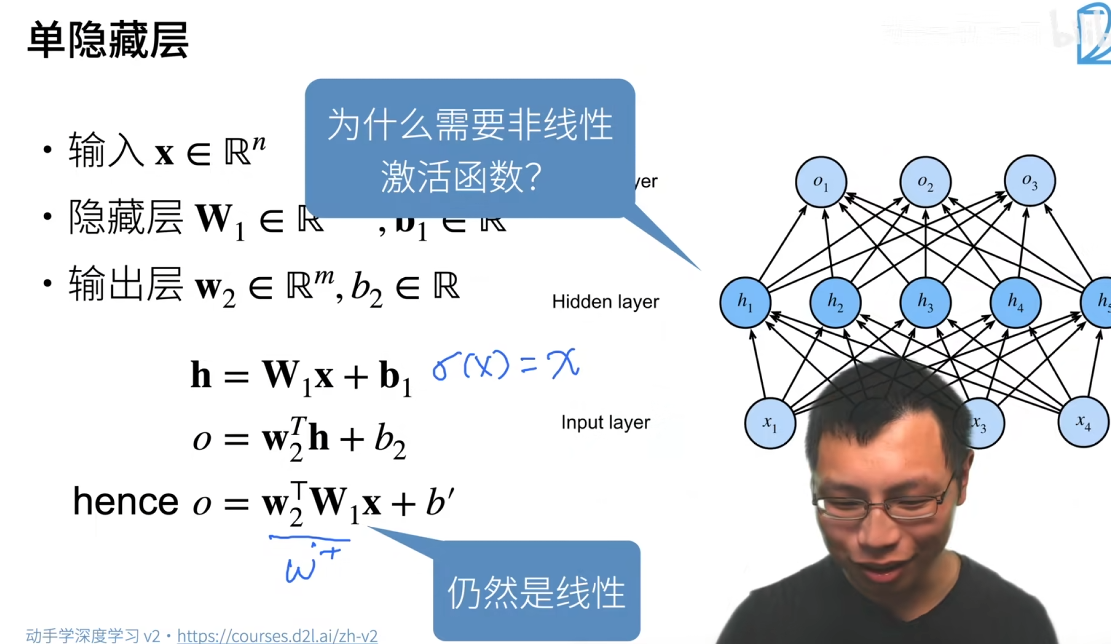

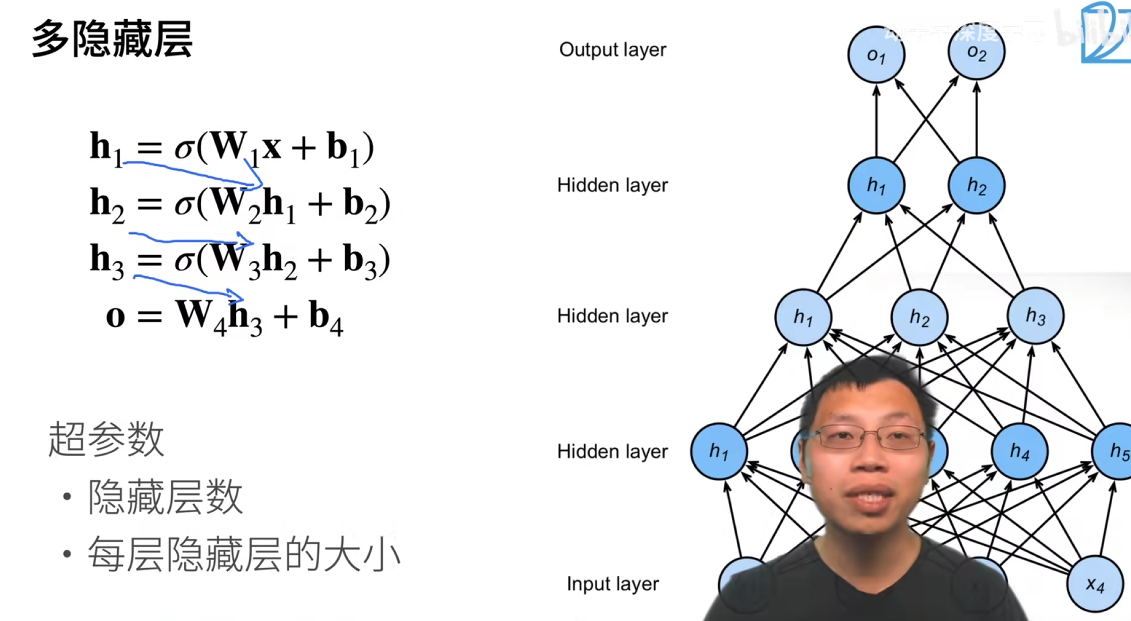

多层感知机

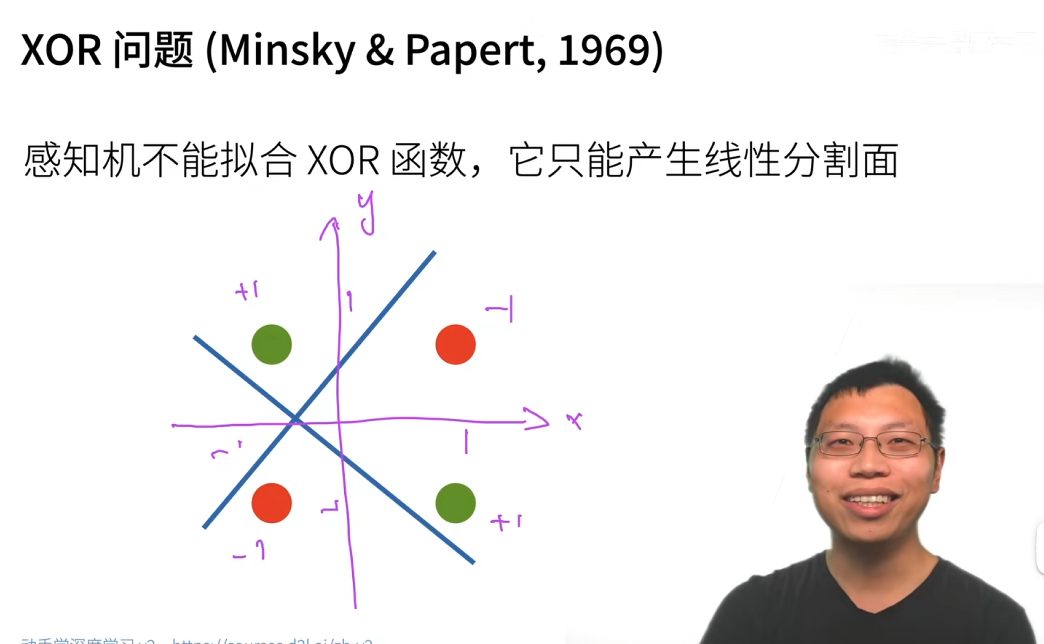

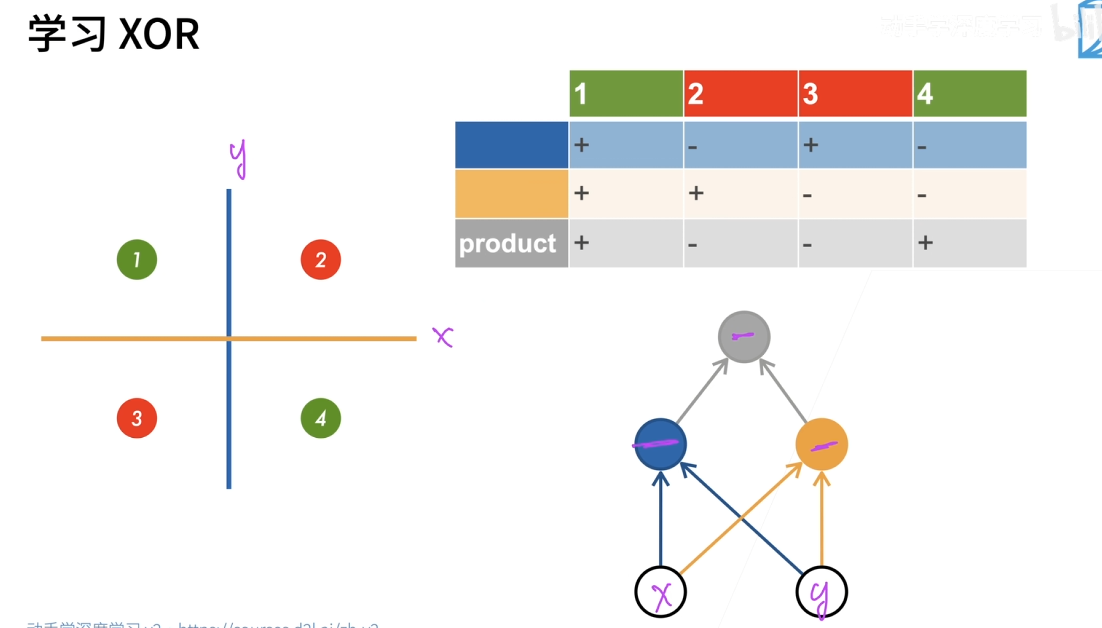

多层感知机可以拟合XOR函数。

一个函数实现不了,再来一个函数,组合多个函数。

σ不能是一个线性函数,因为线性模型无法解决XOR问题,我们多层感知机是为了解决这个问题的,必须是非线性的。

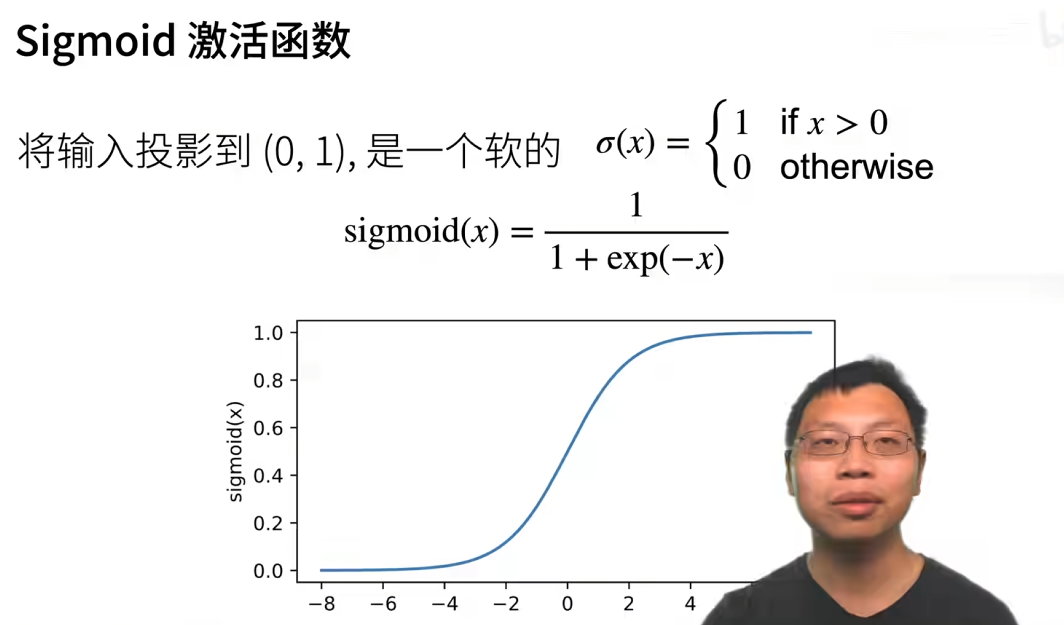

激活函数

sigmoid激活函数

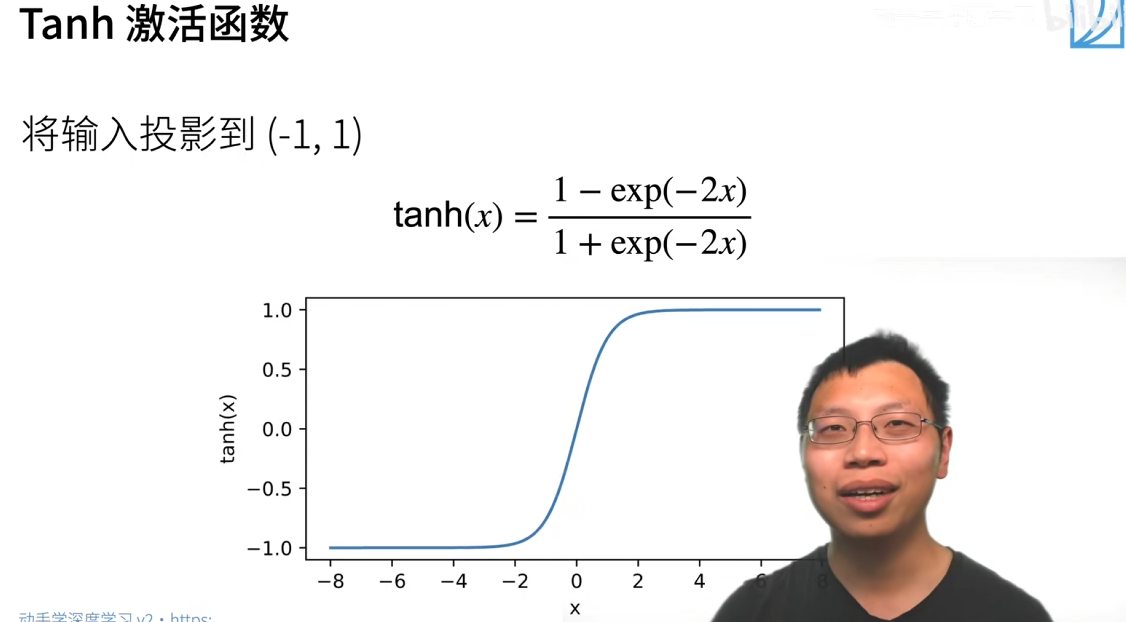

Tanh激活函数

为什么要有一个-2?

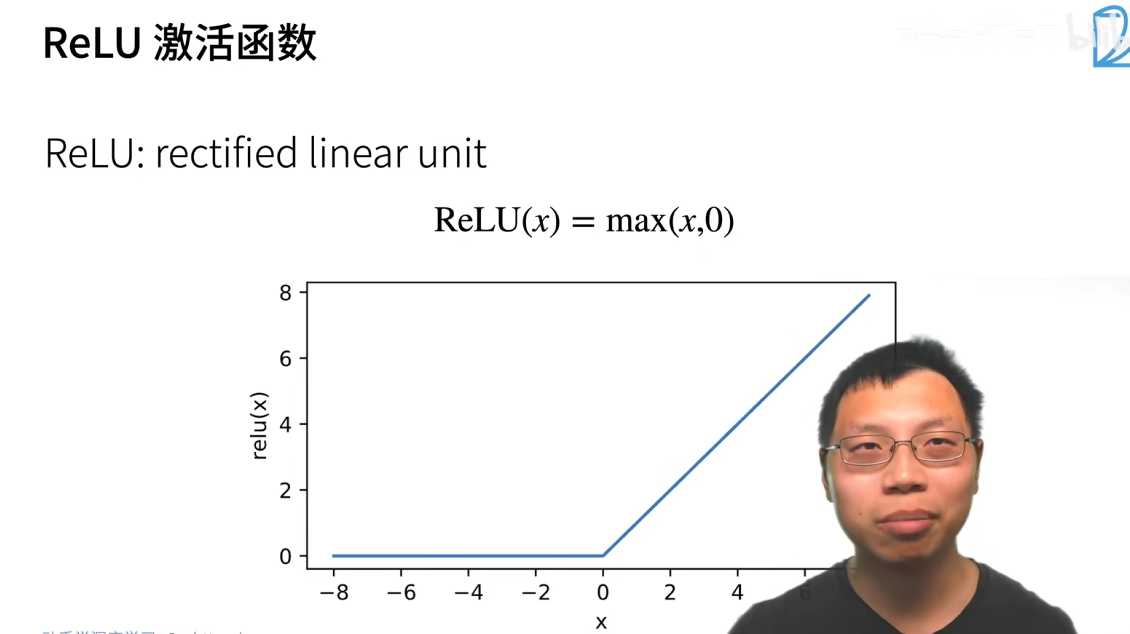

ReLU激活函数

就是一个max函数,深度学习都是经典的东西重命名。2014年之前,之后很多新的概念出来。

优点:算起来快,不需要进行指数运算。简单

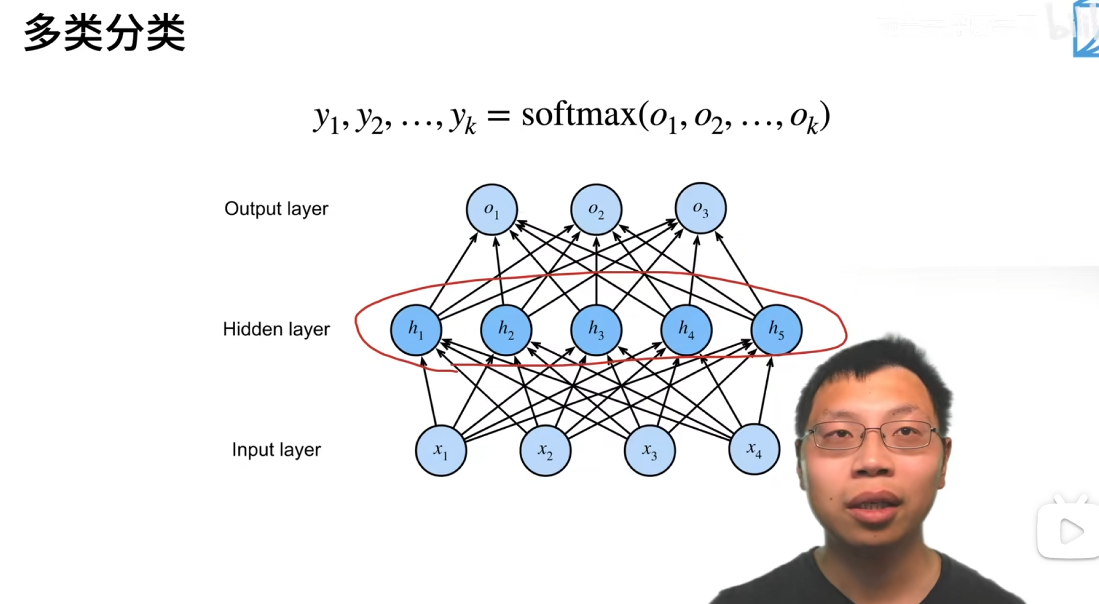

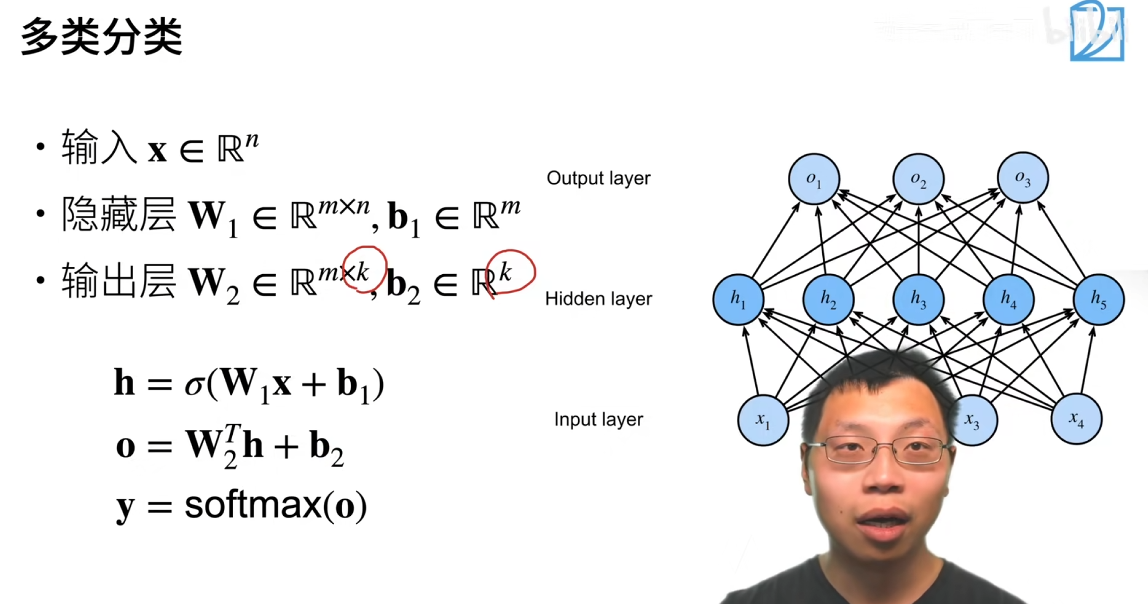

多类分类

softmax函数就是把所有的输入拉到一个(0,1)区间范围内的函数,使得y1+y2+```yk=1。

多类分类与softmax回归没有本质的区别,与单分类就是多了一层隐藏层,就变成了多层感知机。

区别:W2从向量变成了矩阵,b2从标量变成了向量。

必须要有激活函数,少一个激活函数,就少了一层。

本质上机器学习就是多维压缩成低维。

文章来源:https://blog.csdn.net/daima3/article/details/135530906

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 微服务的调用使用

- 寒假护眼台灯哪款更好?五款高品质护眼台灯推荐

- 【Redis】Redis分布式锁有什么缺陷

- Vue学习计划-Vue2--VueCLi(六)插槽、过渡

- 国内信创软件的发展环境及驱动因素相关思考

- Helm Dashboard — Kubernetes 中管理 Helm 版本的 GUI

- 2024年外贸新兴市场有哪些 | 箱讯科技国际贸易平台

- AxGlyph安装教程

- GO——flag

- 21. 合并两个有序链表(Java)