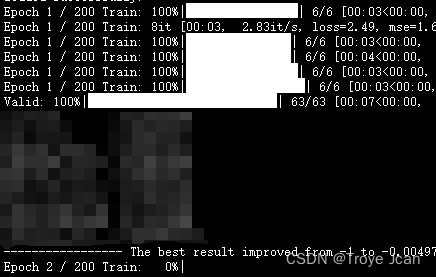

#Pytorch 使用DDP训练第一轮,验证后第二轮卡住

发布时间:2024年01月19日

问题:在使用DDP分布式训练的时候,在第一轮训练后验证结果,在第二轮开始时就卡住了。因为设置了dist.barrier(),所以只有第一个GPU跑了验证,在第二轮时只有第一个GPU的模型在,其他卡的模型都被阻塞住了。

解决方法:在验证时不要使用model进行验证,要使用model.module,这样就可以顺利运行了。

文章来源:https://blog.csdn.net/qq_43190189/article/details/135700877

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- QGIS平常遇到的小问题汇总

- 微信小程序基本使用2:wxs,组件的使用以及弹窗、滚动条

- Vue2 跨域问题报错

- telnet的交互原理(wireshark分析)

- JavaScript 入门手册

- Linux——Ubuntu切换到root用户提示“认证失败”,看这篇文章就够了

- 【前端素材】bootstrap5实现绿色果蔬电商Frutin

- leetcode - 1249. Minimum Remove to Make Valid Parentheses

- Java Swing实现多窗口

- MySQL是什么?它有什么功能?值不值得我们去学习?我们该如何去学习呢?