拉索回归(Lasso Regression)的原理是什么?

发布时间:2024年01月19日

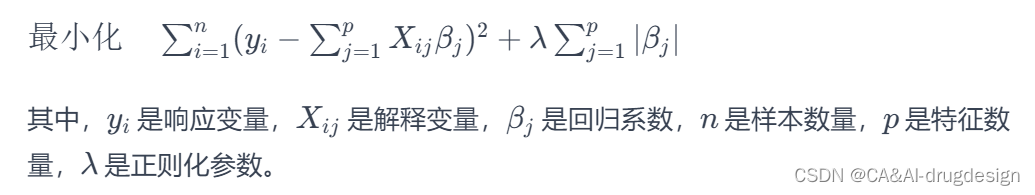

拉索回归(Lasso Regression),全称Least Absolute Shrinkage and Selection Operator回归,是一种线性回归的改进方法,主要用于数据分析和特征选择。其核心原理是在传统的线性回归损失函数中加入了一个L1正则化项(即参数的绝对值之和)。拉索回归的数学表达式如下:

拉索回归的主要特点和优势包括:

-

参数收缩与特征选择:通过L1正则化项,拉索回归可以将某些回归系数精确地压缩到0,从而实现特征选择的目的。这使得模型更为简洁,减少了模型的复杂度。

-

防止过拟合:在拟合过于复杂的模型时,拉索回归通过正则化项对系数进行惩罚,有助于防止过拟合现象。

-

适用于高维数据:对于特征数多于样本数的高维数据,拉索回归能够有效地进行参数估计和变量筛选。

正则化参数 λ 的选择对模型效果有显著影响。λ 值越大,正则化效果越强,越多的系数被压缩为0;反之,λ 值越小,模型越接近于普通的线性回归。通常,λ 的值通过交叉验证等方法来确定。

总的来说,拉索回归是一种在实践中非常有用的工具,特别适合于具有大量特征但样本量有限的数据集。通过正则化方法,它不仅提高了模型的预测准确性,还帮助识别出最重要的特征。

文章来源:https://blog.csdn.net/weixin_40551464/article/details/135704761

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- RLT8762D ADC模块

- Web安全之XXE漏洞原理及实践学习

- Nginx代理proxy

- CSP CCF 201509-2 日期计算 C++满分题解

- git(安装,常用命令,分支操作,gitee,IDEA集成git,IDEA集成gitee,IDEA集成github,远程仓库操作)

- PyTorch Tutorial

- 使用Triton部署ONNX模型

- Qt/QML编程学习之心得:QML和C++的相互调用(十五)

- 逆强化学习为什么不直接把专家行为作为 label 进行学习,而是来拟合奖励模型,使得预测模型与专家行为的奖励更接近

- 三种方式简单搭建http本地文件服务