深度学习记录--梯度检验

发布时间:2024年01月17日

数值逼近

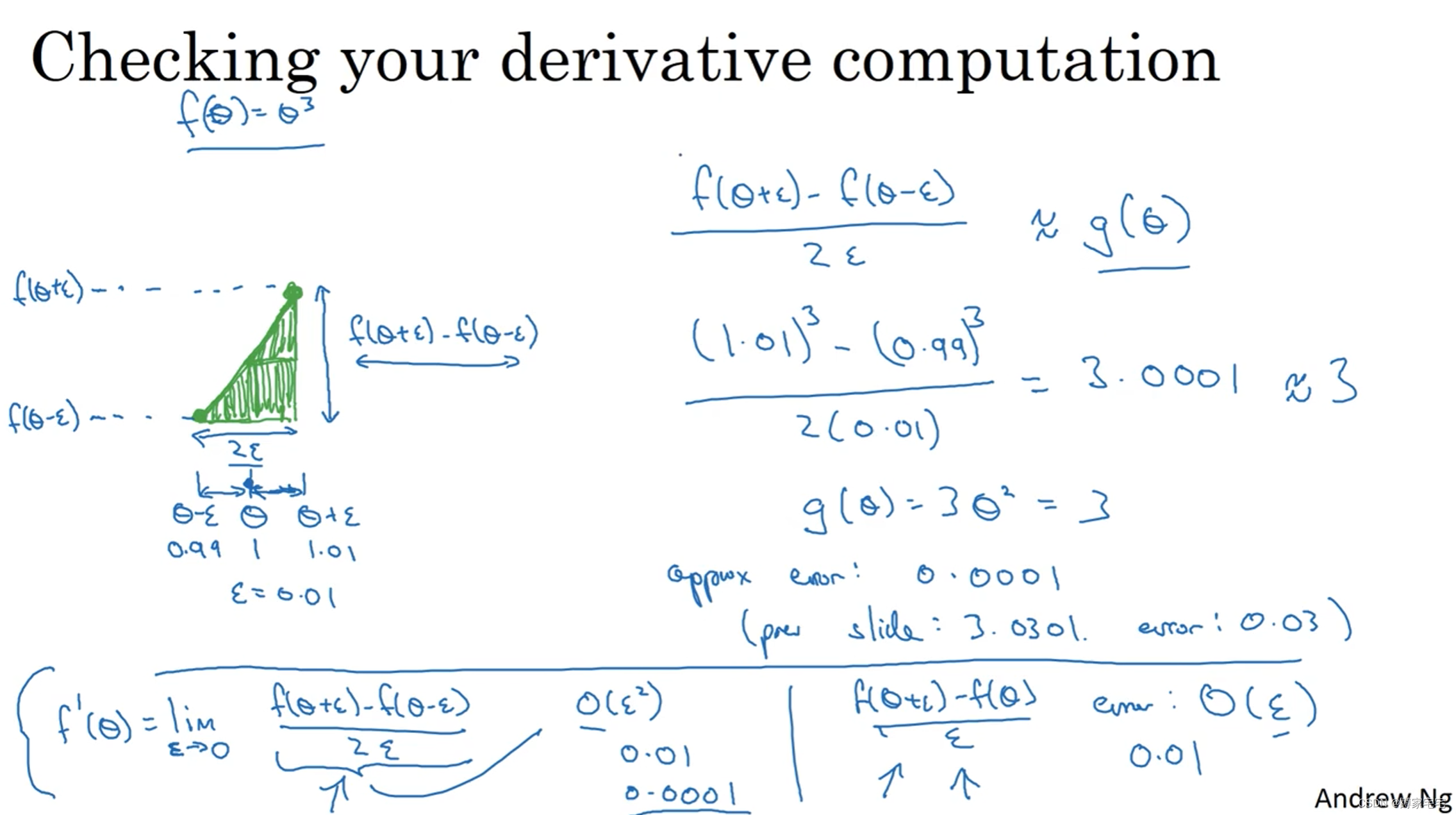

为了对梯度进行检验,需要计算近似误差值来接近梯度

对于单边误差和双边误差公式,其中双边误差与真实梯度相差更小,故一般采用双边误差公式

双边误差

公式:

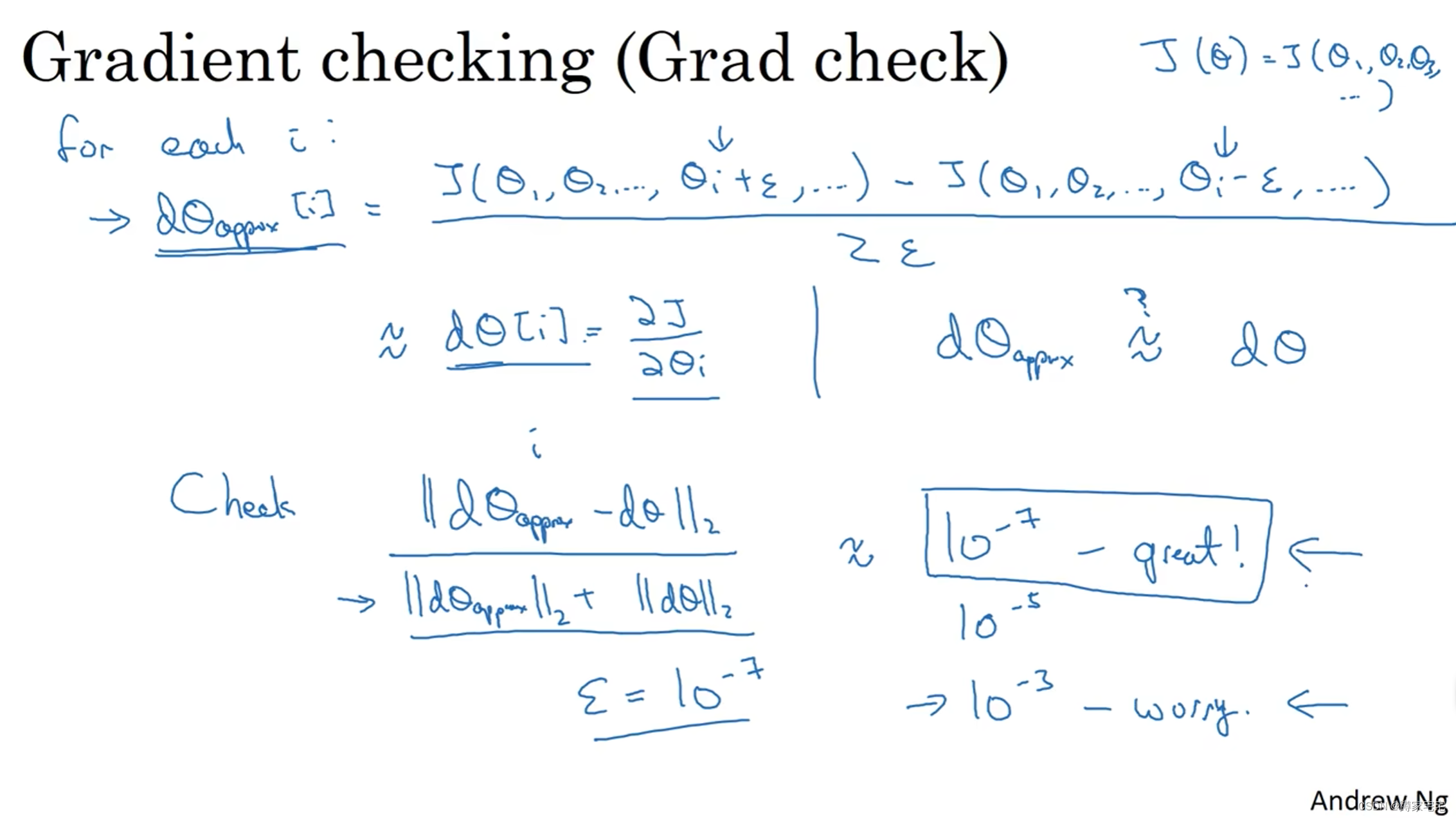

梯度检验(gradient checking)

对于成本函数,求出

的导数,计算出双边误差

,再将两者进行比较

比较方法:

,判断

的大小

若

,则误差很小,效果很好

若

,则误差一般,效果一般

若

,则误差较大,需要考虑是否错误较多

梯度检验的注意事项

不要在训练中使用梯度检验,它只适用于调试

梯度检验的计算时间较长,且通常在backprop后向传播中进行

当梯度检验得出偏差过大时,要对所有参数进行检查

使用正则化时,要记住在梯度检验中保留正则项

不要在梯度检验的过程中使用dropout

在每次迭代过程中,dropout会随机消除隐层单元的不同子集,J函数难以明确计算

文章来源:https://blog.csdn.net/Xudong_12345/article/details/135650450

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 高并发场景下的延时双删

- 代码随想录算法训练营第四十二天 | 01背包问题、416. 分割等和子集

- NIO的实战教程(简单且高效)

- URL编码揭秘:为什么要进行URL编码?

- Intel FPGA 技术开放日

- java经典程序

- ARP协议分析实验

- 6K star! 100%本地运行LLM的AI助手

- GAN网络的全称是什么?是用来干什么的?可以用来生成数据,解决深度学习模型中数据集不足的问题吗?

- JAVA网络个人博客系统设计与实现(Springboot框架)