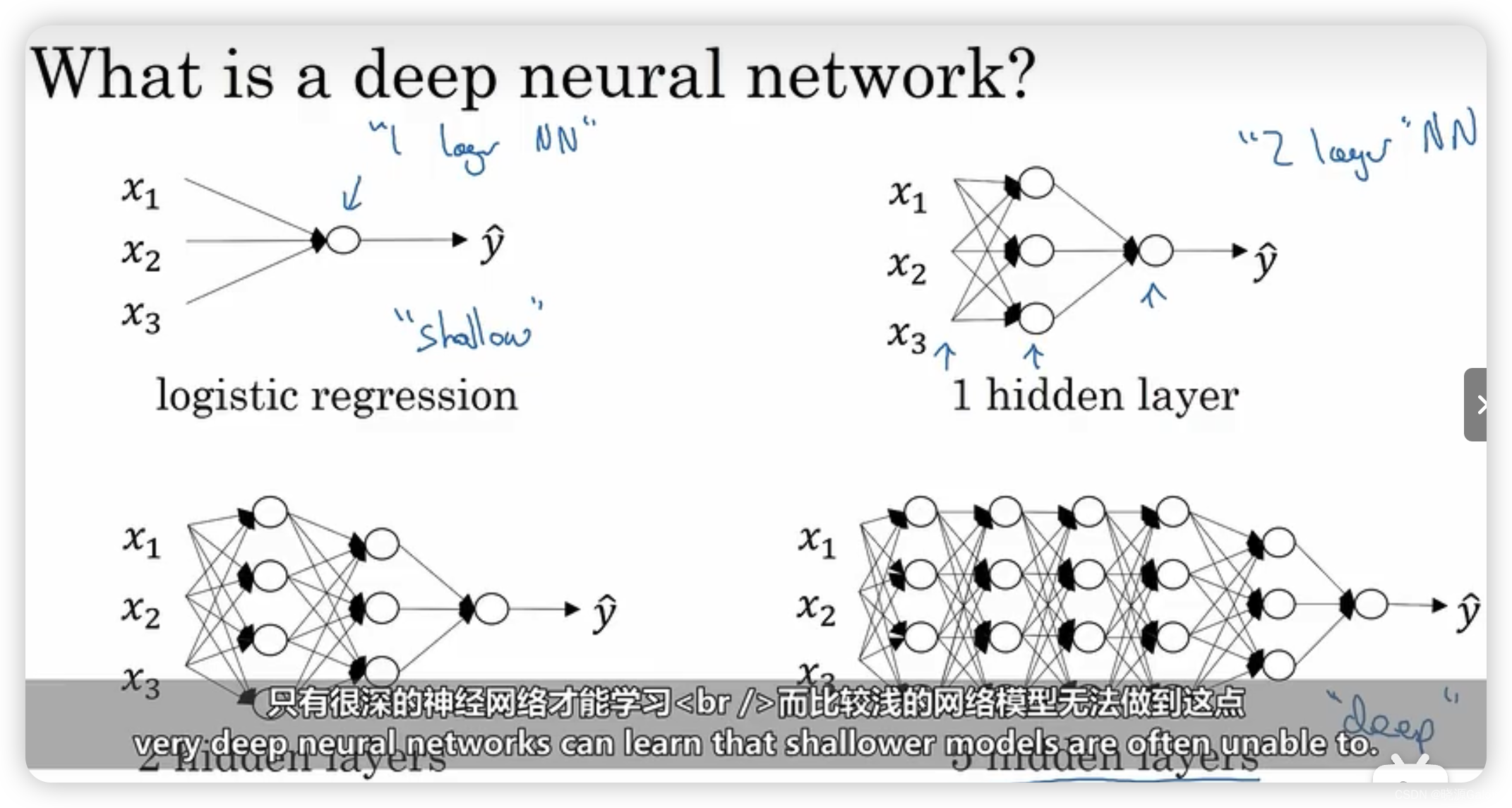

深度学习|4.1 深L层神经网络 4.2 深层网络的正向传播

4.1 深L层神经网络

对于某些问题来说,深层神经网络相对于浅层神经网络解决该问题的效果会较好。所以问题就变成了神经网络层数的设置。

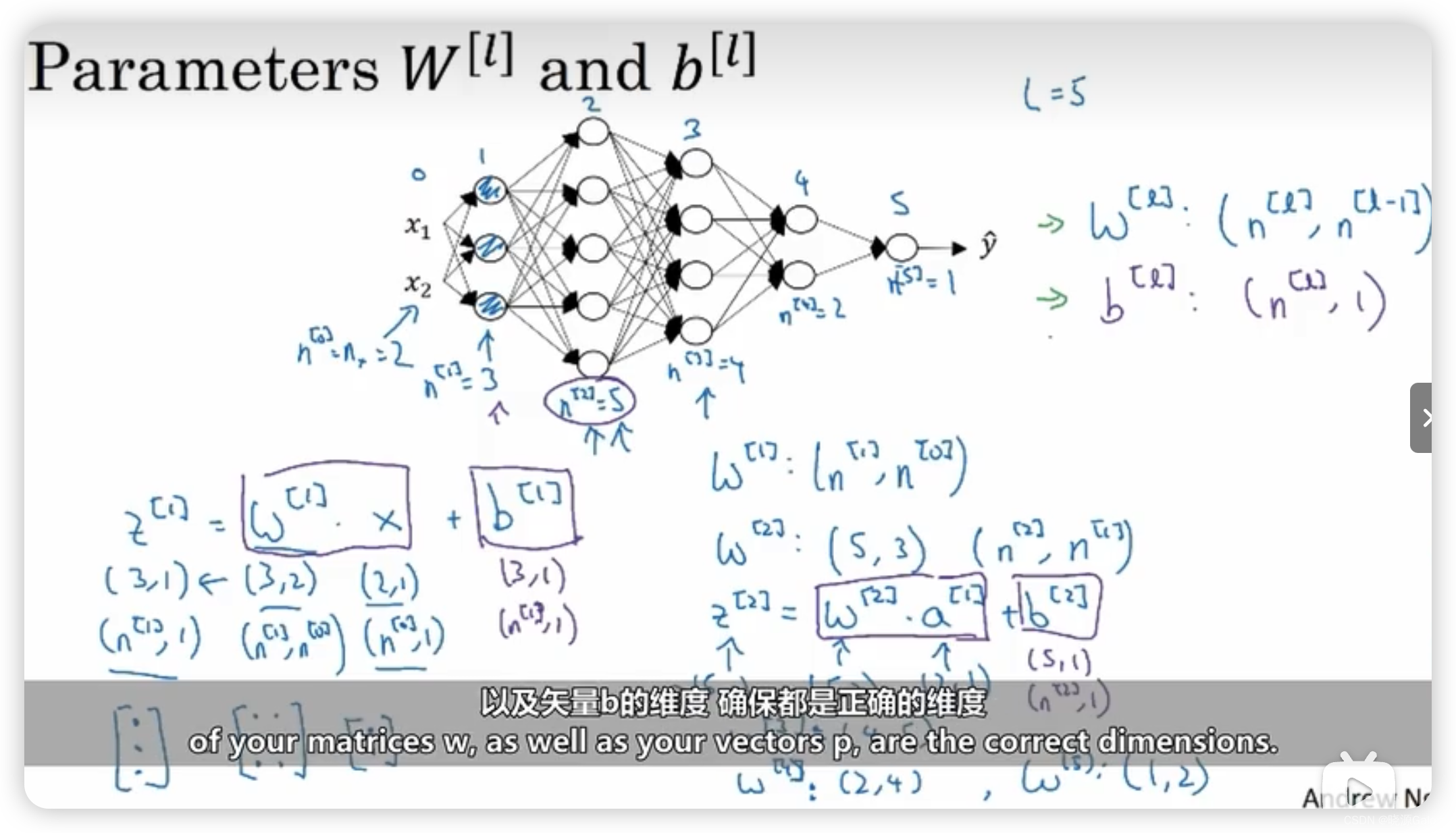

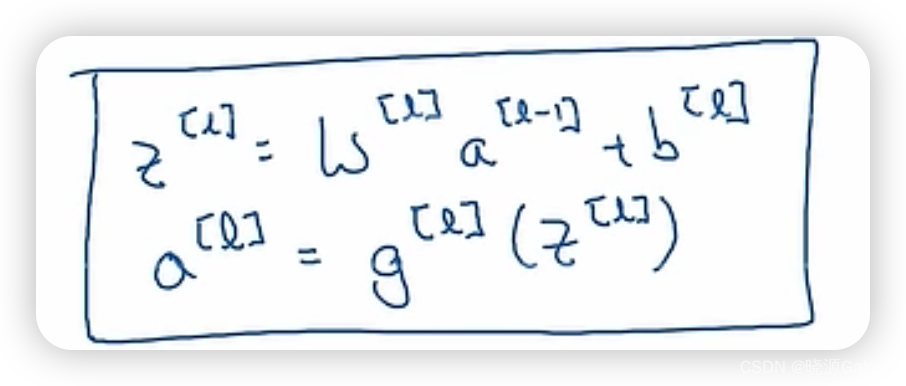

其中

n

[

i

]

n^{[i]}

n[i]表示第i层神经节点的个数,

w

[

l

]

w^{[l]}

w[l]代表计算第l层所采用的权重系数,

b

[

l

]

b^{[l]}

b[l]代表计算第l层所用的偏移量,

g

[

i

]

g^[i]

g[i]表示第i层所配置的激活函数,常见的激活函数有sigmoid,tanh、relu和leaky-relu等。

b

[

i

]

b^[i]

b[i]表示第i层配置的参数/偏移量

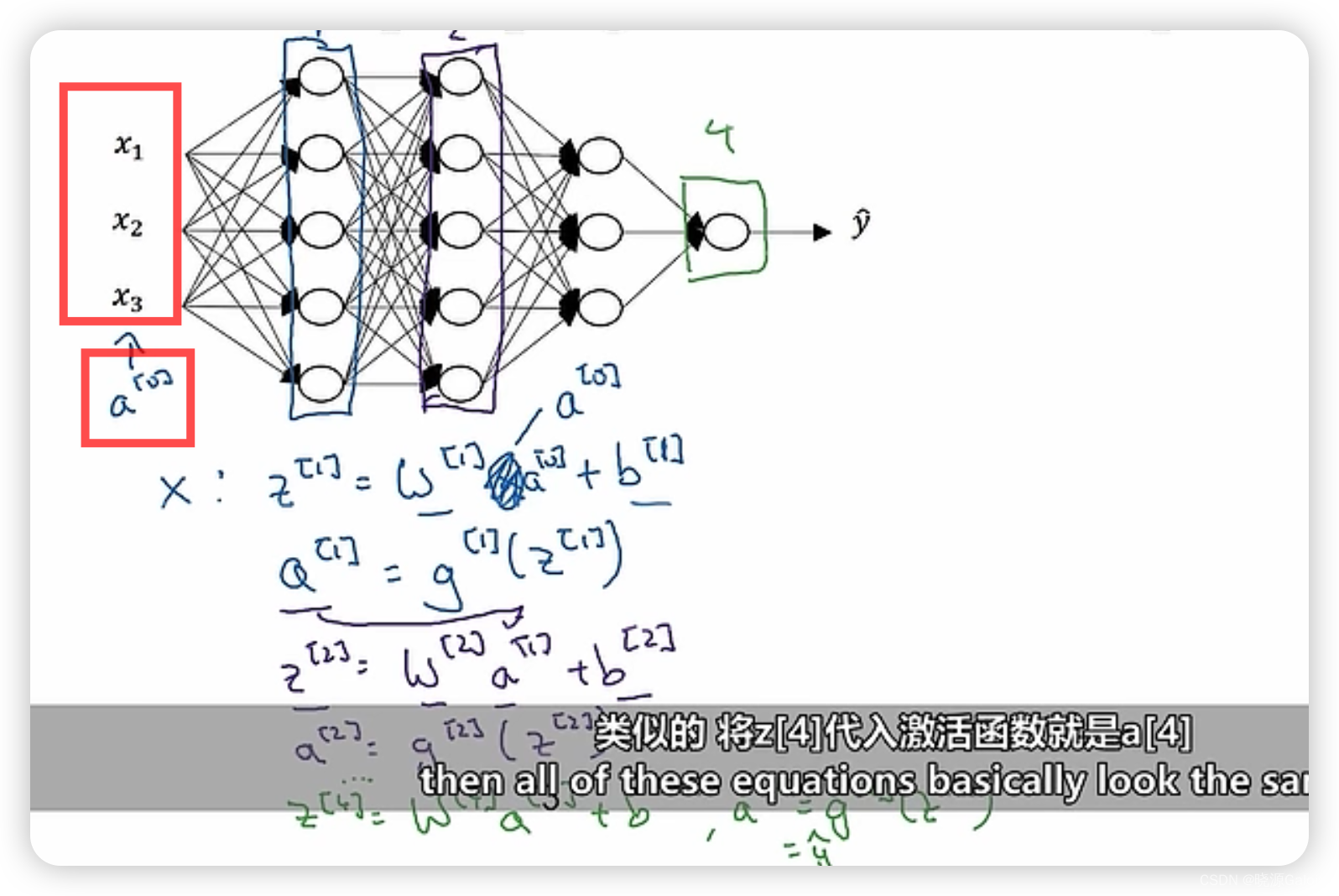

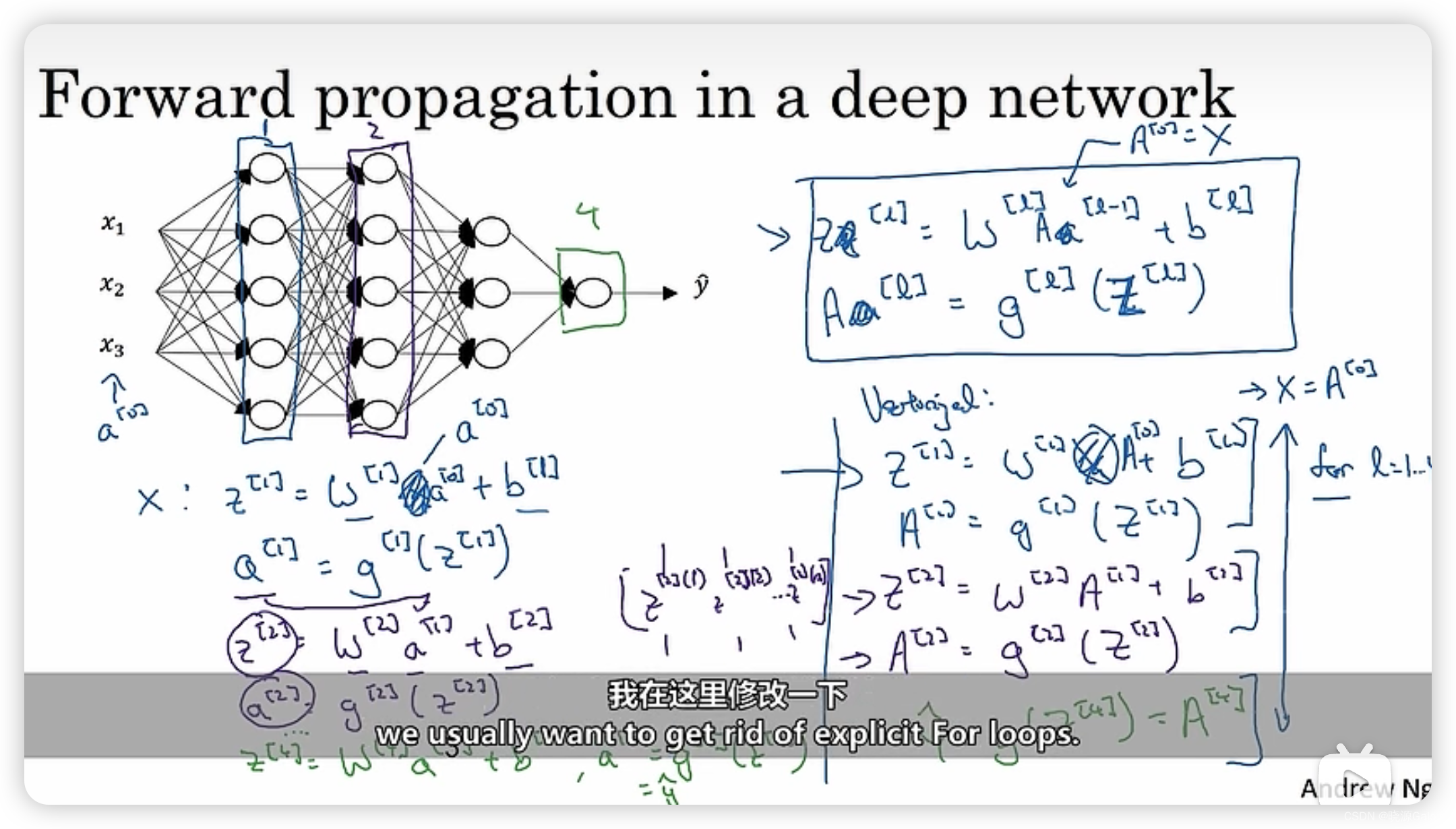

4.2 深层网络中的正向传播

为了统一格式,可以将输入向量x改写成

a

[

0

]

a^{[0]}

a[0]

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!