大语言模型(LLM)训练平台与工具

?LLM 是利用深度学习和大数据训练的人工智能系统,专门 设计来理解、生成和回应自然语言。

????????大模型训练平台和工具提供了强大且灵活的基础设施,使得开发和训练复杂的语言模型变得可行且高效。

? ? ? ? 平台和工具提供了先进的算法、预训练模型和优化技术,极大地简化了模型开发过程,加速了实验周期,并使得模型能够更好地适应各种不同的应用场景。此外,它们还促进了学术界和工业界之间的合作与知识共享,推动了自然语言处理技术的快速发展和广泛应用。

?大模型训练平台与工具:

? ? ? ? 1、云服务和商业平台

????????平台提供了从模型开发到部署的综合解决方案,包括计算资源、 数据存储、模型训练和部署服务。它们通常提供易于使用的界面,支 持快速迭代和大规模部署。Amazon SageMaker、Google Cloud AI Platform 和 Microsoft Azure Machine Learning 都是提供端到 端机器学习服务的云平台。

? ? ? ? 2、硬件加速增加算力

????????硬件工具和库专门为加速机器学习模型的训练和推理而设计,通常利 用 GPU 或 TPU 等硬件。这类工具可以显著提高训练和推理的速度, 使得处理大规模数据集和复杂模型变得可行。NVIDIA CUDA 和 Google Cloud TPU 均是此类工具。

? ? ? ? 3、开源框架和开源库

????????这类工具通常由开源社区支持和维护,提供了灵活、可扩展的工具和 库来构建和训练大型机器学习模型,如 TensorFlow 和 PyTorch 和 Hugging Face Transformers 等

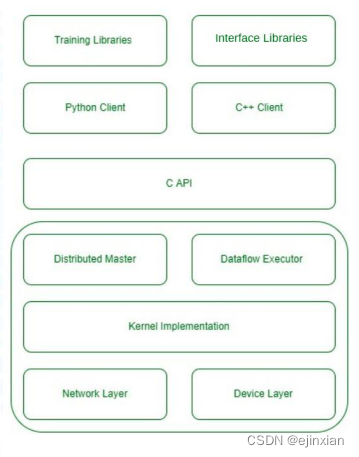

?TensorFlow 架构图 (图源:https://www.geeksforgeeks.org/architecture-oftensorflow/)

?

原文:《LLM技术报告》

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 构建一个动态时钟

- 【Go语言入门:Go语言的数据结构】

- ssm基于vue的大学生社团管理系统的设计与实现+vue论文

- 漏刻有时百度地图API实战开发(12)(切片工具的使用、添加自定义图层TileLayer)

- Mysql实时数据同步工具Alibaba Canal 使用

- Python命名规范中的[单/双]&[前导/后缀]下划线小结

- 利用C/C++实现的水波纹特效

- 网络安全新形势下的动态防御体系研究(下)

- openGauss学习笔记-169 openGauss 数据库运维-备份与恢复-导入数据-更新表中数据-使用DML命令更新表

- 杨中科 ASP.NET Core前后端分离开发