互信息,条件熵,联合熵

发布时间:2024年01月09日

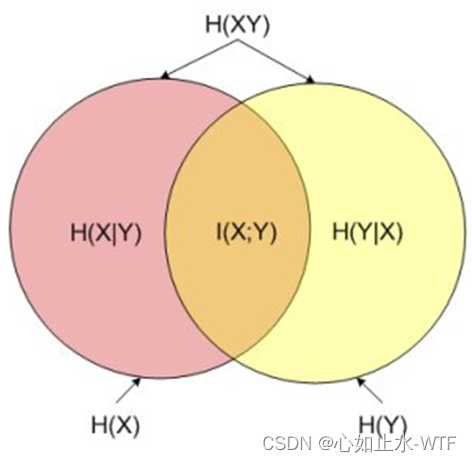

看到一个图介绍互信息,条件熵,联合熵,还不错,做个记录:

图上的红色和黄色圈分别代表X,Y原始的信息量H(X)/H(Y)/熵值。 (注意信息量度量的是一个具体事件发生了所带来的信息,而熵则是在结果出来之前对可能产生的信息量的期望)

I(X;Y) : 表示互信息, 知道X,Y损失了多少信息量(知道Y,X损失了多少信息量)。

H(X|Y)或H(Y|X): 表示条件熵, 知道X,Y还剩多少信息量(H(Y|X))。或者知道Y后,X还剩多少信息量(H(X|Y))。

H(XY): 联合熵,XY联合起来有多少信息量(H(XY))。

图上可以看出:

I(X;Y) = H(X)-H(X|Y)

I(X;Y) = H(Y)-H(Y|X)

I(X;Y) = H(X)+H(Y)-H(XY)

参考:

https://blog.csdn.net/class_brick/article/details/79651173

https://www.cnblogs.com/wqbin/p/12752610.html

文章来源:https://blog.csdn.net/qq_28723681/article/details/135481604

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- EDM邮件营销与短信营销谁更胜一筹

- 腾讯云4核8G服务器CVM标准型S5优惠价格表

- UKP3d协同设计搭建VPN的注意事项

- TensorFlow 的基本概念和使用场景。

- 面试官:说说设备像素、css像素、设备独立像素、dpr、ppi 之间的区别?

- 最新高质量信息管理毕业设计分享50例(一)

- 带你深度理解什么是CRM客户关系管理?

- 新人如何做好功能测试,学会这几项够用了

- NXP应用随记(六):S32K3xx的时钟与PIN简介

- IntelliJ IDEA 拉取gitlab项目