【Pytorch】学习记录分享5——PyTorch卷积神经网络

发布时间:2023年12月20日

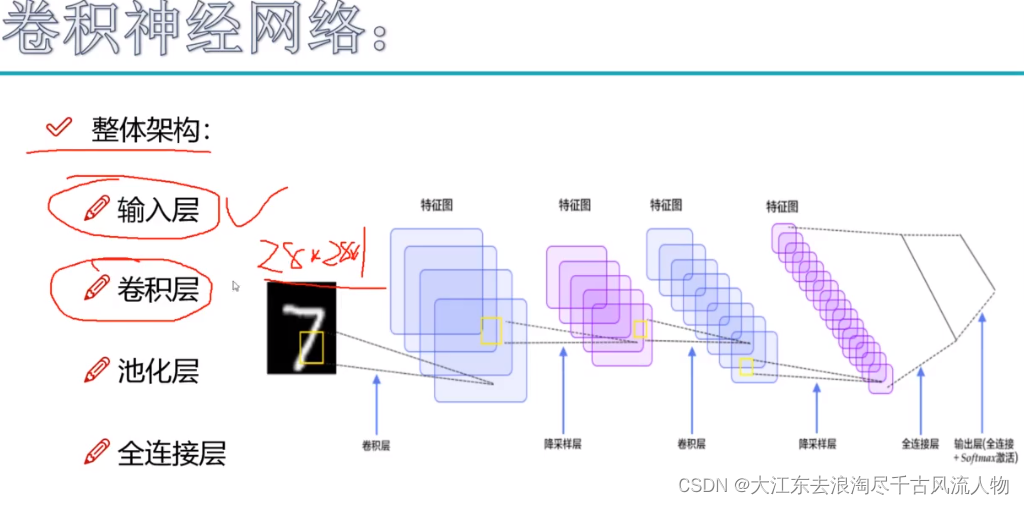

卷积神经网络

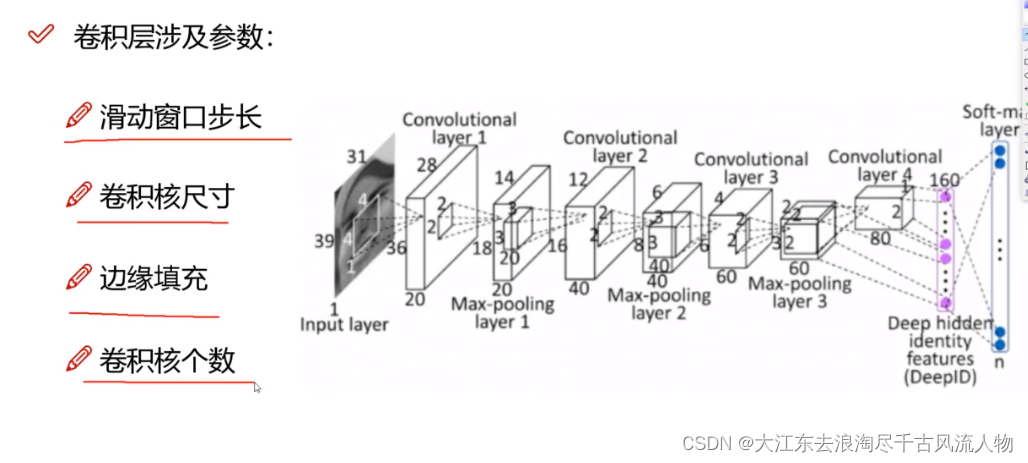

1. 卷积层涉及参数及其含义

概述:

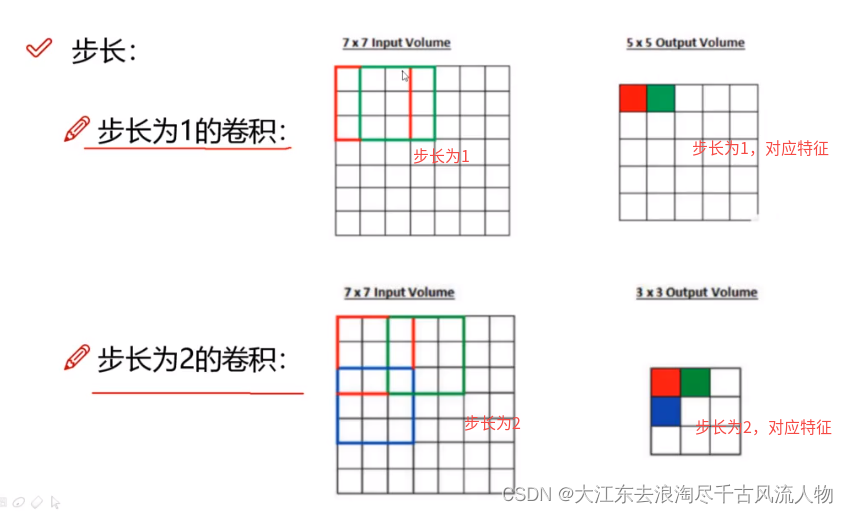

1. 滑动窗口步长:

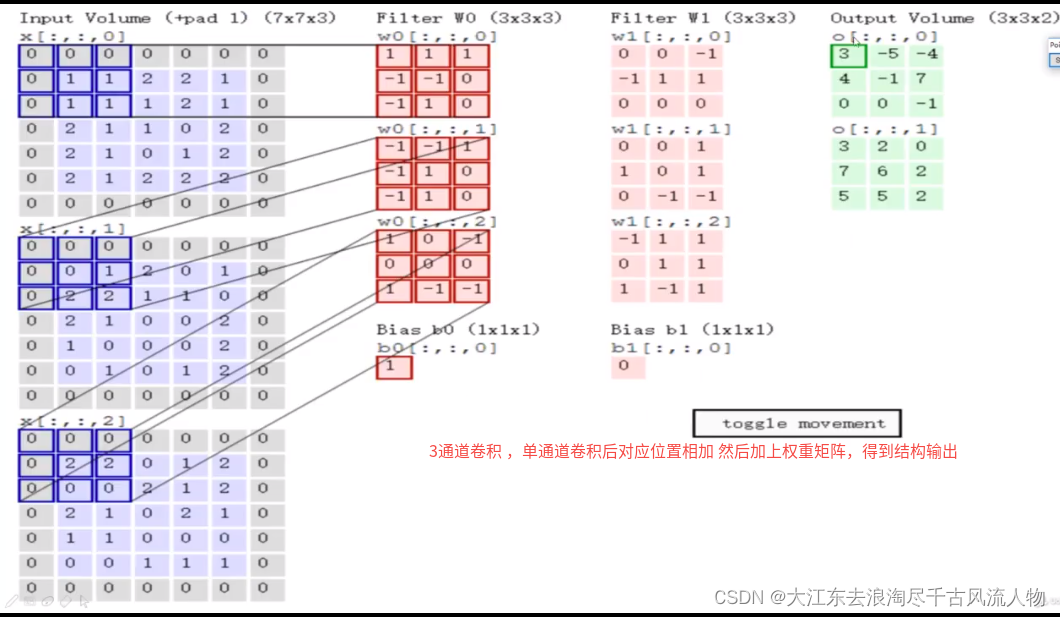

2. 卷积核尺寸:通常33 55等等

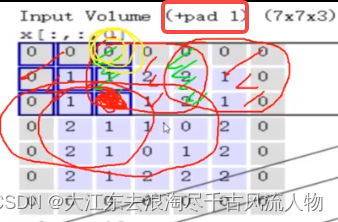

3. 边缘填充:pad==1 zero_padding,以0为边缘的填充

4. 卷积核个数

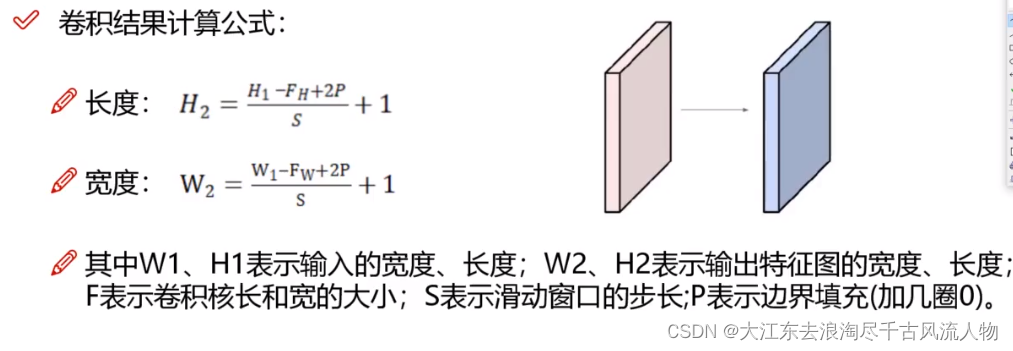

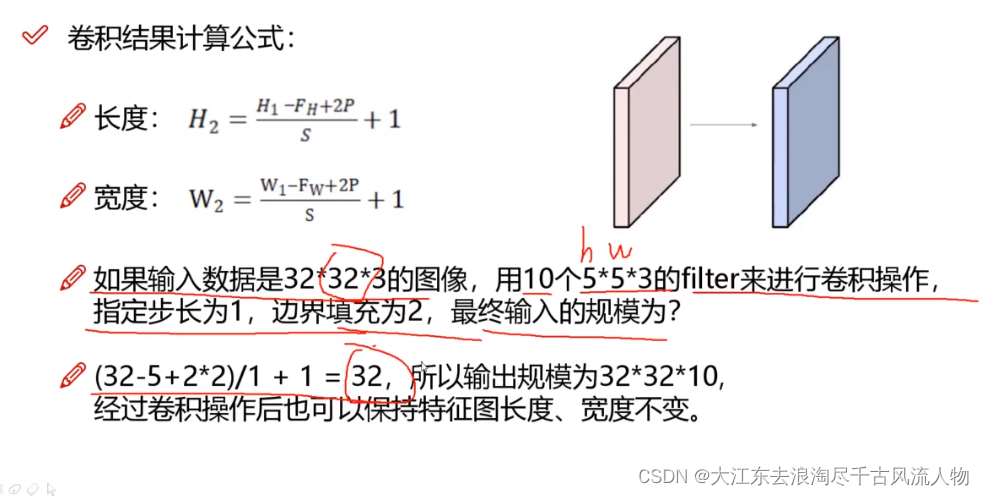

5. 卷积结果计算公式

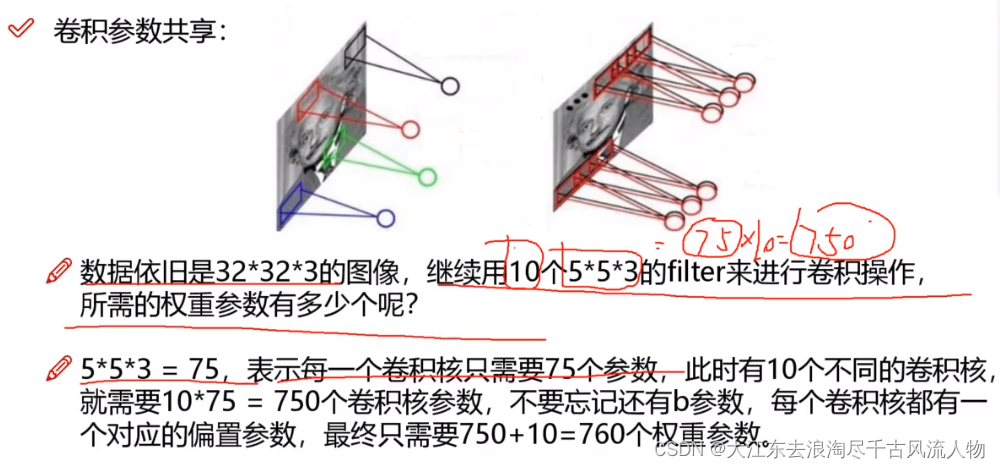

如果输入数据是 32 323 的图像,用 10个 553 的filter来进行卷积操作,指定步长为1,边界填充为2

最终输入的规模为 (32-5+22)/1 + 1 = 32,

所以输出规模为 323210, 经过卷积操作后也可以保持特征图长度、宽度不变。

6. 卷积参数共享

是指:同一轮卷积操作,卷积核内参数不变

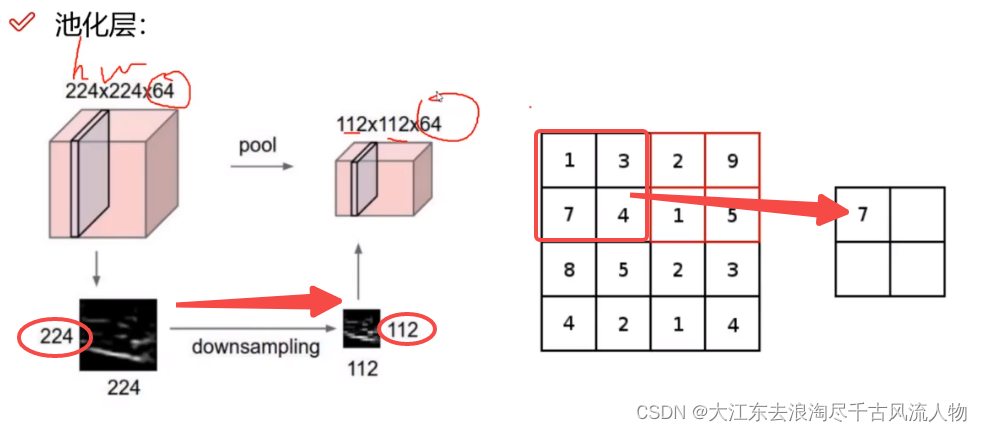

2. 池化层涉及参数及其含义

作用:数据压缩或者下采样

起到了 筛选 压缩 过滤的作用

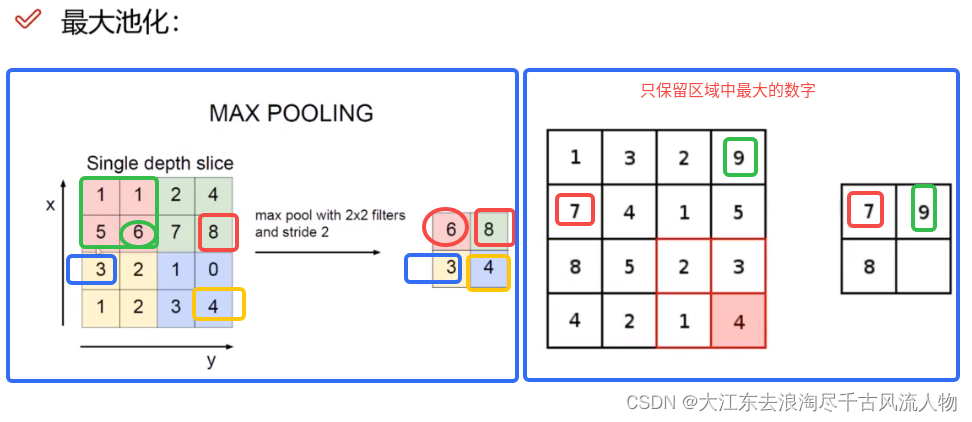

1. 最大池化 MAX POOLING

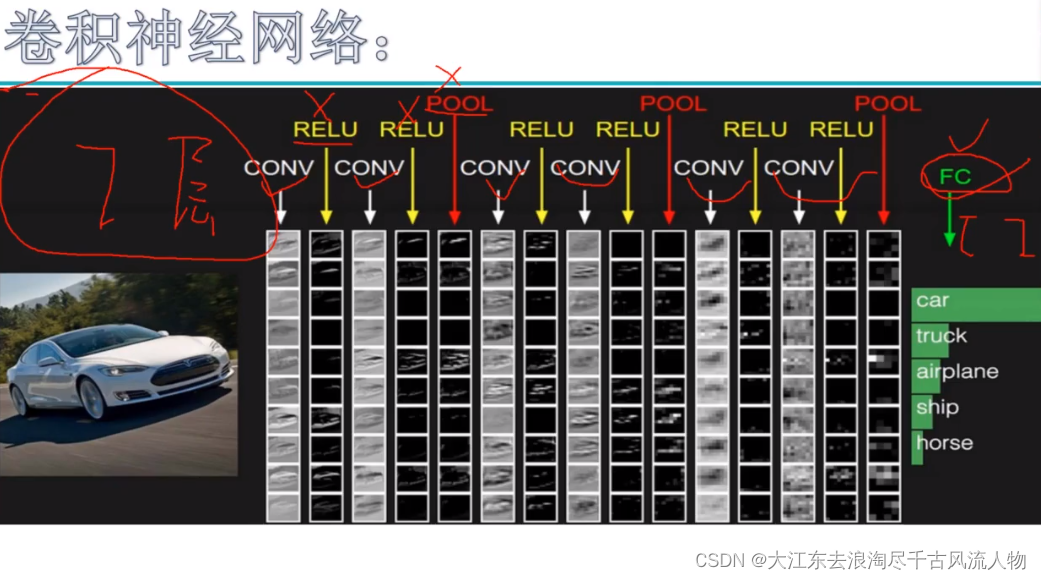

2. 神经网络层数怎么计算

如下网络总共7层,只有含有矩阵计算的才能算作一层,因此这里只有卷积层和全连接层算, 激活函数和池化层不算在内

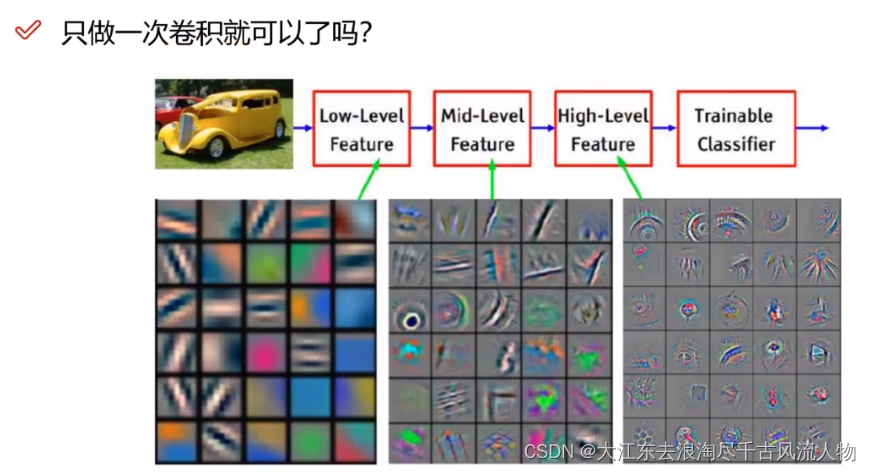

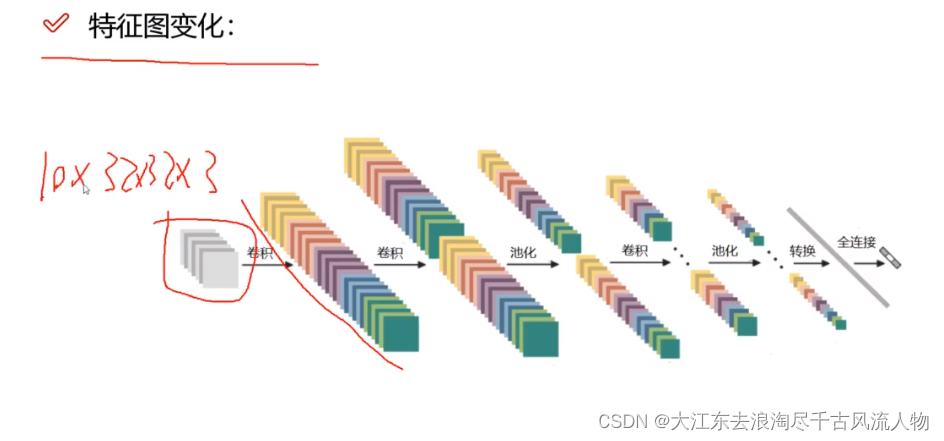

3. 特征图变化

4. 经典网络架构

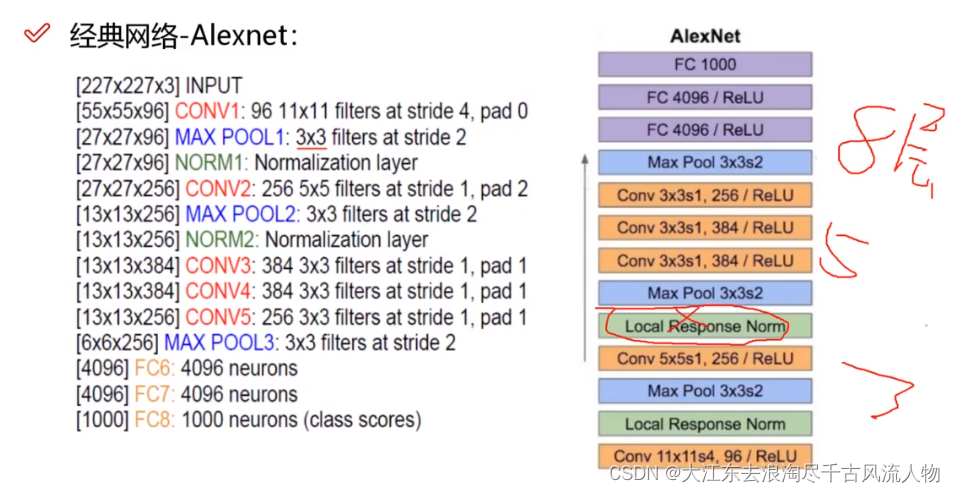

AlexNet 12年 8层

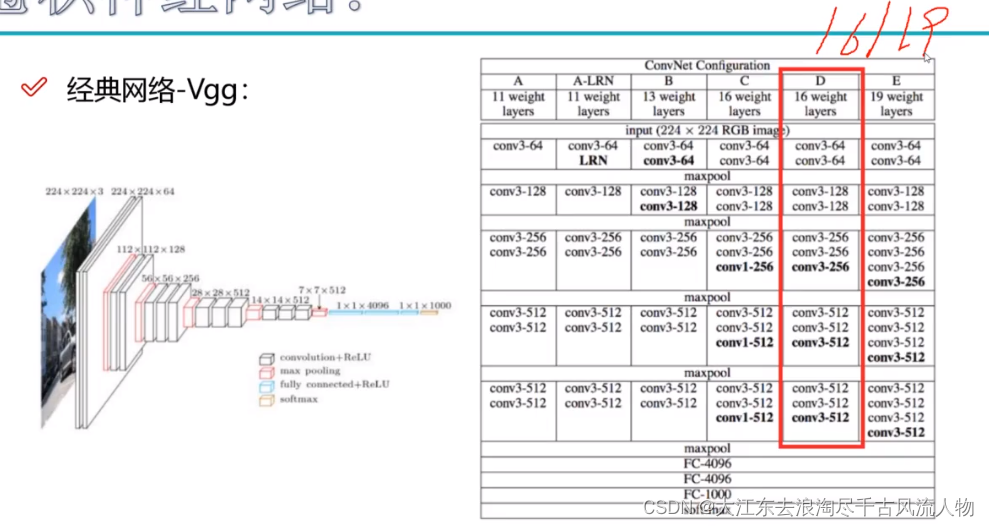

VGG 14年 16层网络

5. 经典网络架构

文章来源:https://blog.csdn.net/Darlingqiang/article/details/135071998

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- flutter3使用dio库发送FormData数据格式时候的坑,和get库冲突解决办法

- 03、Kafka ------ CMAK(Kafka 图形界面管理工具) 下载、安装、启动

- 【大数据学习笔记】新手学习路线图

- C:宏:编程风格:井号与define之间的空格

- 项目从npm迁移到pnpm

- 数据结构-猴子吃桃问题

- 判断时间差是否大于1年,需考虑闰年

- 精品基于Uniapp+springboot医疗住院医生医疗挂号缴费管理系统App

- 如何查看iPad尺寸,这里提供两种办法

- FPGA UDP协议栈:基于88E1111,支持RGMII、GMII、SGMII三种模式,提供3套工程源码和技术支持