scrapy框架核心知识Spider,Middleware,Item Pipeline,scrapy项目创建与启动,Scrapy-redis与分布式

发布时间:2024年01月24日

scrapy项目创建与启动

创建项目

在你的工作目录下直接使用命令:

scrapy startproject scrapytutorial

运行后创建了一个名为scrapytutorial的爬虫工程

创建spider

在爬虫工程文件内,运行以下命令:

scrapy genspider quotes

创建了名为quotes的爬虫

修改爬虫代码,实现自己想要的爬虫逻辑

启动爬虫

在爬虫项目目录下,运行:

scrapy crawl quotes

即可运行爬虫

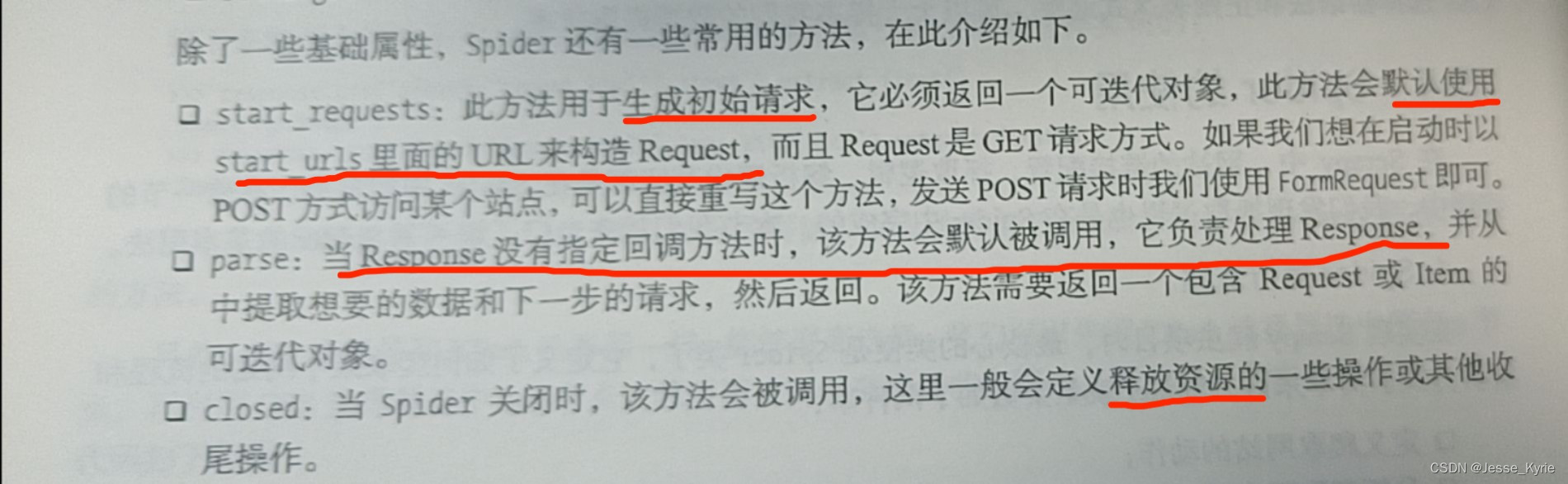

Spider

在scrapy中,网站的链接配置,抓取逻辑,解析逻辑都是在spider内配置。

start_requests

分析以下简单的爬虫代码:

import scrapy

class HttpbinspiderSpider(scrapy.Spider):

# 定义 Spider 的名称

name = "httpbinspider"

# 设置允许爬取的域名

allowed_domains = ["www.httpbin.org"]

# 定义起始 URL

start_uri = 'https://www.httpbin.org/get'

# 定义 Spider 的起始请求

def start_requests(self):

# 使用循环生成多个请求,这里生成了 1 到 5 的 offset 参数

for offset in range(1, 6):

url = self.start_uri + f'?offset={offset}'

# 生成请求,并指定回调函数为 parse

# 同时将 offset 通过 meta 传递给回调函数

yield scrapy.Request(url, callback=self.parse, meta={'offset': offset})

# 定义数据处理逻辑

def parse(self, response):

# 打印 offset 和响应文本

print(f"===============offset {response.meta['offset']}=========")

print(response.text)

# 打印 meta 数据,这里包含了在 start_requests 中传递的 offset

print(response.meta)

这里我重写了start_requests方法,使用scrapy.Request构造了5个GET请求,并使用yield方法发送到下载器用于下载,同时指定了响应的解析回调函数,并通过meta参数传递offset参数。

简要说明:

name:定义 Spider 的名称。

allowed_domains:定义允许爬取的域名。

start_uri:定义起始 URL。

start_requests:生成起始请求,使用循环生成多个带有不同 offset 参数的请求,每个请求的回调函数是 parse。

parse:处理响应的回调函数,打印 offset、响应文本和 meta 数据。

spider发送GET请求

使用scrapy.Request(url=url)

或 scrapy.Request(method=‘GET’,url=url)

发送GET请求,查询参数建议拼接在url内。

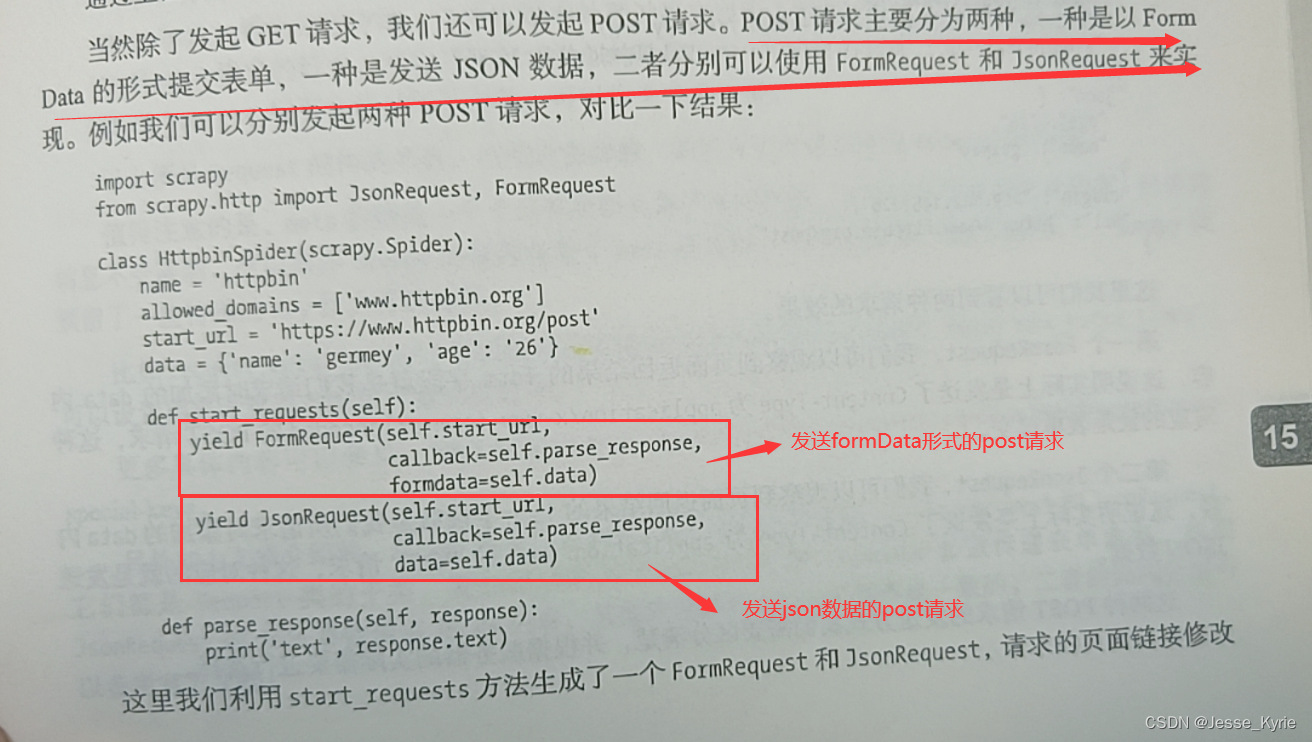

spider发送POST请求

文章来源:https://blog.csdn.net/Jesse_Kyrie/article/details/135814748

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- mysql5.7之从入门到放弃

- Peter算法小课堂—简单建模(3)

- HarmonyOS鸿蒙学习基础篇 - 什么是HarmonyOS

- js中浅拷贝和深拷贝的区别

- 算法-两数之和

- Vue将数据存放在会话存储中

- 用户逻辑删除配置 - PC端通用管理模块配置教程(5)-多八多AI低代码多端应用开发助手在线IDE

- CentOS 7 实战指南:文件或目录的权限操作命令详解

- Lazada店铺销量不上去?如何提升关键词排名?

- VUE v-if 和 v-show 区别和例子