P21 类神经网络训练不起来怎么办- 自动调整学习率 Adapative learning rate

发布时间:2023年12月18日

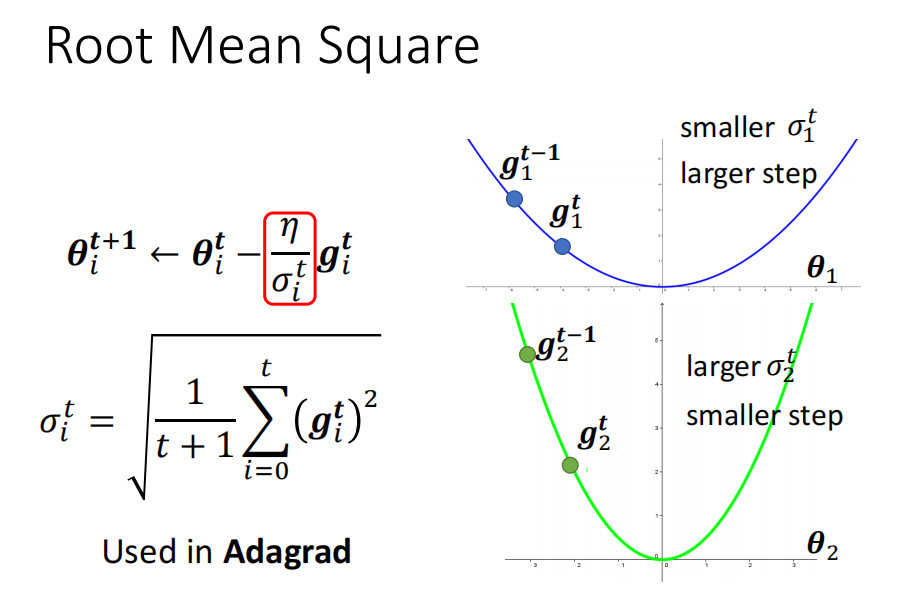

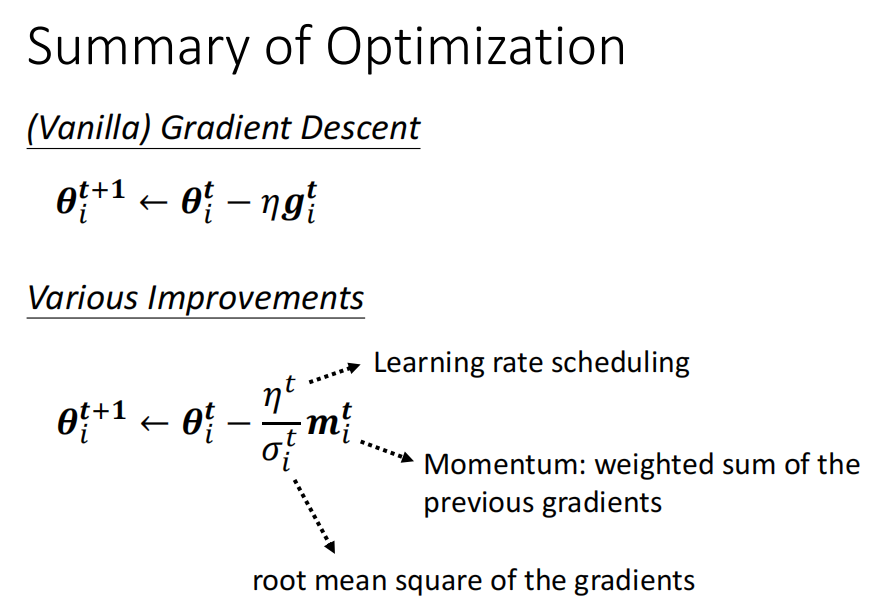

- 梯度大,学习率减小

- 梯度小,学习率变大

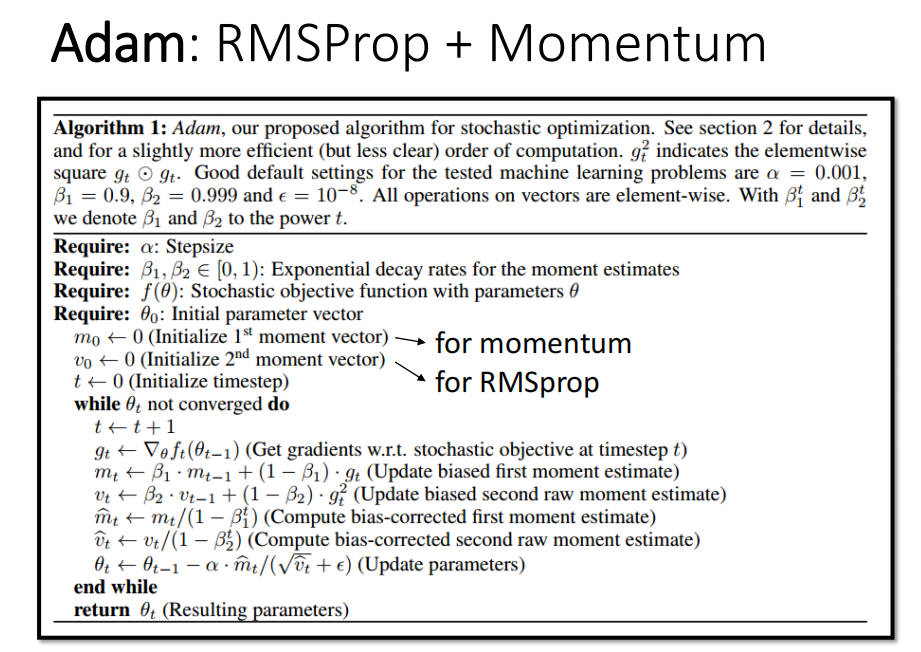

- adam

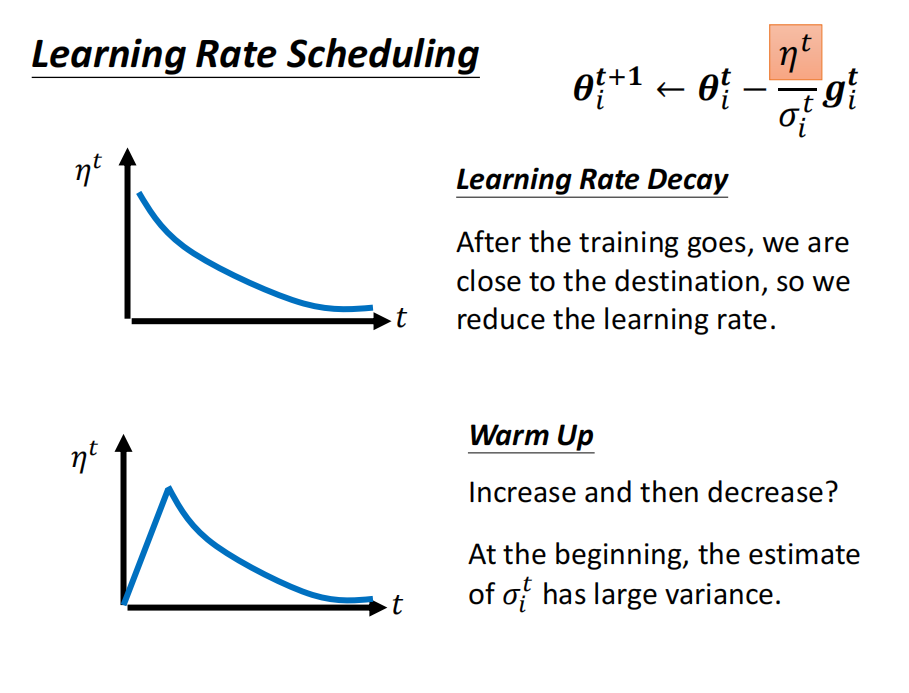

- 随时间变化 , decay / warm up

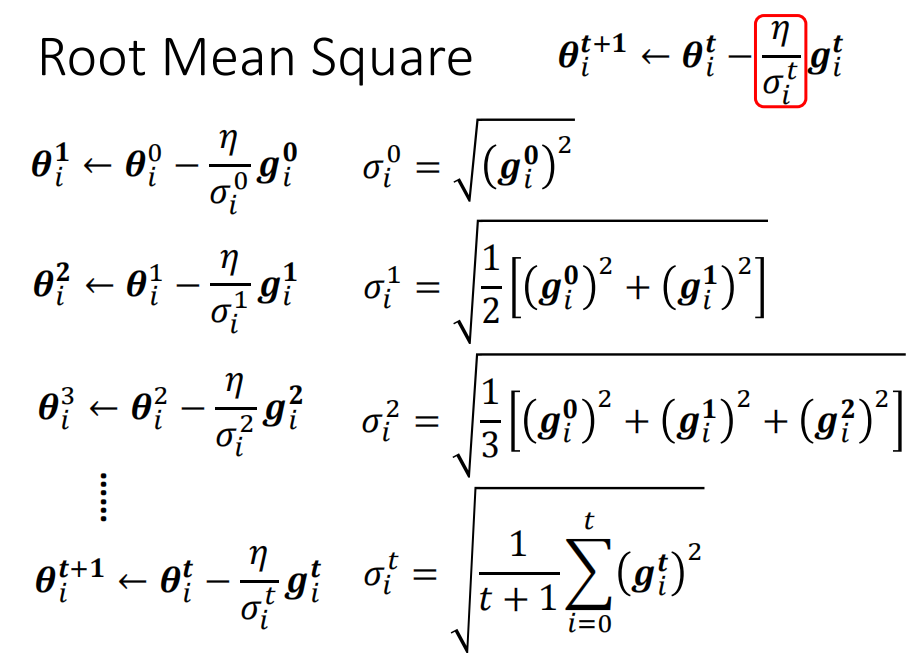

调整学习率方法一 adagrad

学习率除以 梯度的方差

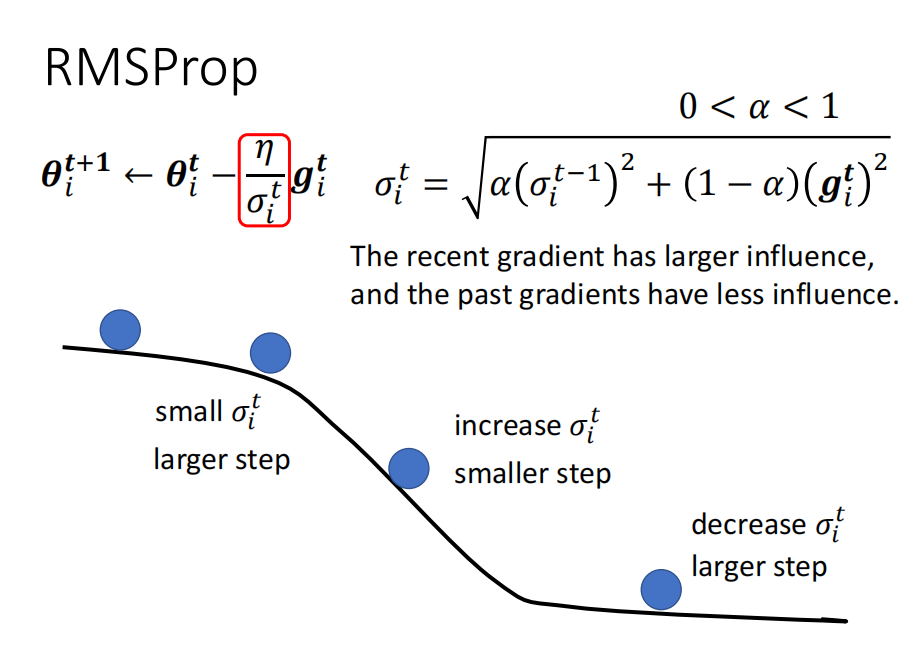

方法二 RMSProp

目前最常用的: Adam: RMSProp + Moment

Learning rate schedule : decay/ warm up

learnign rate 随时间的变化情况

文章来源:https://blog.csdn.net/weixin_39107270/article/details/135000835

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- (C)一些题15

- CTF数据分析题详解

- 第二章、时间服务器

- Navicat连接linux虚拟机上的MySQL

- HarmonyOS【应用服务开发】在模块中添加Ability

- 下一代实时数据库:Apache Doris 【四】扩容缩容

- 成语跑酷游戏Uml建模

- 【运维路不弯】通过acme为你的网站添加ssl证书

- CPU测试方案浅析

- YOLOv8改进 | 损失函数篇 | QualityFocalLoss质量焦点损失(含代码 + 详细修改教程)