图像卷积操作

目录

一、互相关运算

???????严格来说,卷积层是个错误的叫法,因为它所表达的运算其实是互相关运算(cross-correlation),而不是卷积运算。在卷积层中,输入张量和核张量通过互相关运算产生输出张量。

???????首先,我们暂时忽略通道(第三维)这一情况,看看如何处理二维图像数据和隐藏表示。在 下图中,输入是高度为?、宽度为?

?的二维张量(即形状为?

?)。卷积核的高度和宽度都是?

,而卷积核窗口(或卷积窗口)的形状由内核的高度和宽度决定(即?

?)。

???????在二维互相关运算中,卷积窗口从输入张量的左上角开始,从左到右、从上到下滑动。当卷积窗口滑动到新一个位置时,包含在该窗口中的部分张量与卷积核张量进行按元素相乘,得到的张量再求和得到一个单一的标量值,由此我们得出了这一位置的输出张量值。

???????在如上例子中,输出张量的四个元素由二维互相关运算得到,这个输出高度为?、宽度为?

,如下所示:

???????注意,输出大小略小于输入大小。这是因为卷积核的宽度和高度大于1,而卷积核只与图像中每个大小完全适合的位置进行互相关运算。所以,输出大小等于输入大小??减去卷积核大小?

?加

,即:

???????接下来,我们在`corr2d`函数中实现如上过程,该函数接受输入张量`X`和卷积核张量`K`,并返回输出张量`Y`。

import torch

from torch import nn

from d2l import torch as d2ldef corr2d(X, K):

"""计算二维互相关运算"""

h, w = K.shape

Y = torch.zeros((X.shape[0] - h + 1, X.shape[1] - w + 1)) # 先算出输出张量的形状并初始化为0

for i in range(Y.shape[0]):

for j in range(Y.shape[1]):

Y[i, j] = (X[i:i + h, j:j + w] * K).sum() # 输出张量的每一个元素都是X与K经过某种计算得到的

return Y # 返回二维互相关运算后的结果Y???????我们来验证上述二维互相关运算的输出。

X = torch.tensor([[0.0, 1.0, 2.0], [3.0, 4.0, 5.0], [6.0, 7.0, 8.0]])

K = torch.tensor([[0.0, 1.0], [2.0, 3.0]])

print(corr2d(X, K))tensor([[19., 25.],

[37., 43.]])二、卷积层

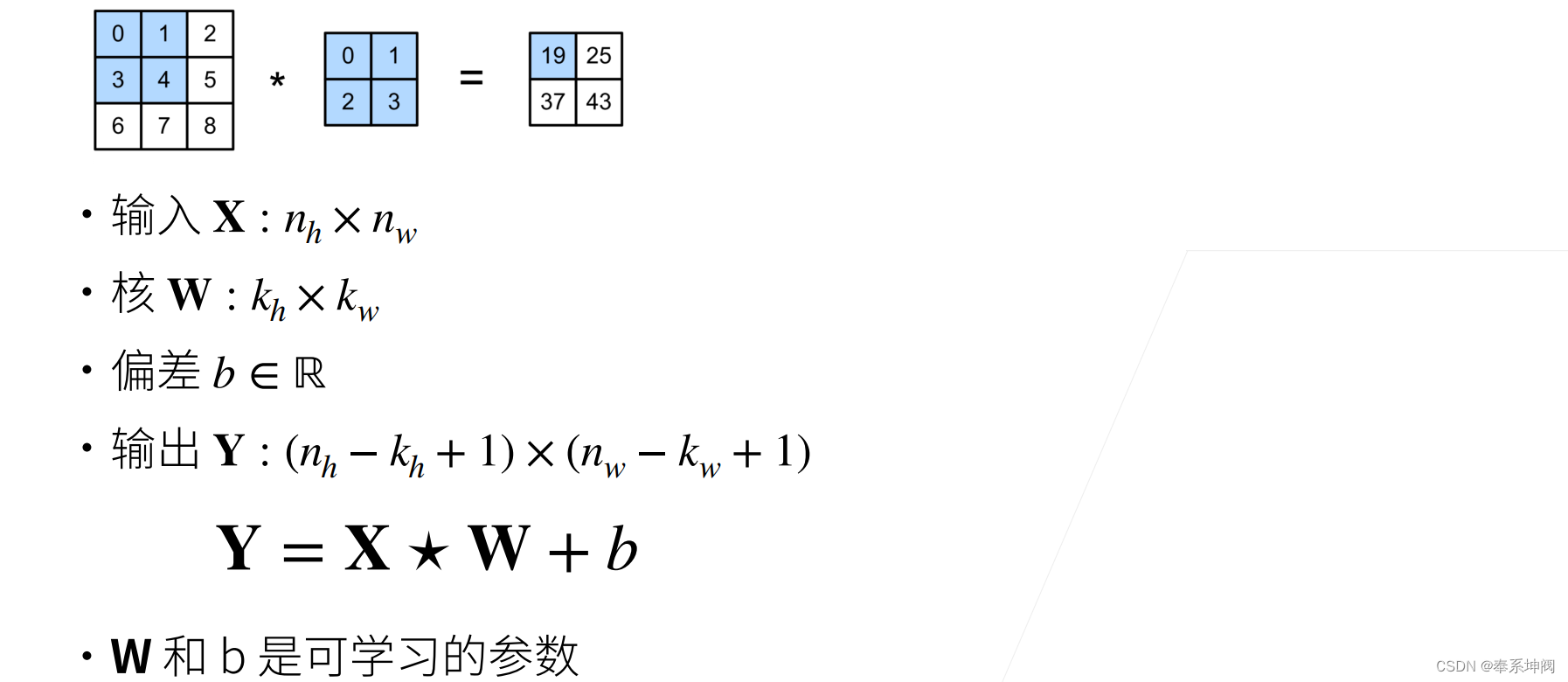

???????卷积层对输入和卷积核权重进行互相关运算,并在添加标量偏置之后产生输出。所以,卷积层中的两个被训练的参数是卷积核权重和标量偏置,如下图所示。就像我们之前随机初始化全连接层一样,在训练基于卷积层的模型时,我们也随机初始化卷积核权重。

???????基于上面定义的`corr2d`函数实现二维卷积层。在`__init__`构造函数中,将`weight`和`bias`声明为两个模型参数。前向传播函数调用`corr2d`函数并添加偏置。

class Conv2D(nn.Module):

def __init__(self, kernel_size):

super().__init__()

self.weight = nn.Parameter(torch.rand(kernel_size))

self.bias = nn.Parameter(torch.zeros(1))

def forward(self, x):

return corr2d(x, self.weight) + self.bias???????高度和宽度分别为??和?

?的卷积核可以被称为?

?卷积或?

?卷积核。我们也将带有?

?卷积核的卷积层称为?

?卷积层。

三、图像中目标的边缘检测

???????如下是卷积层的一个简单应用:通过找到像素变化的位置,来检测图像中不同颜色的边缘。

???????首先,我们构造一个??像素的黑白图像。中间四列为黑色(

),其余像素为白色(

)。

X = torch.ones((6, 8))

X[:, 2:6] = 0

print(X)tensor([[1., 1., 0., 0., 0., 0., 1., 1.],

[1., 1., 0., 0., 0., 0., 1., 1.],

[1., 1., 0., 0., 0., 0., 1., 1.],

[1., 1., 0., 0., 0., 0., 1., 1.],

[1., 1., 0., 0., 0., 0., 1., 1.],

[1., 1., 0., 0., 0., 0., 1., 1.]])???????接下来,我们构造一个高度为 、宽度为

?的卷积核`K`。当进行互相关运算时,如果水平相邻的两元素相同,则输出为零,否则输出为非零。

K = torch.tensor([[1.0, -1.0]])???????现在,我们对参数`X`(输入)和`K`(卷积核)执行互相关运算。如下所示,输出`Y`中的1代表从白色到黑色的边缘,-1代表从黑色到白色的边缘,其他情况的输出为0。

Y = corr2d(X, K)

Ytensor([[ 0., 1., 0., 0., 0., -1., 0.],

[ 0., 1., 0., 0., 0., -1., 0.],

[ 0., 1., 0., 0., 0., -1., 0.],

[ 0., 1., 0., 0., 0., -1., 0.],

[ 0., 1., 0., 0., 0., -1., 0.],

[ 0., 1., 0., 0., 0., -1., 0.]])???????现在我们将输入的二维图像转置,再进行如上的互相关运算。其输出如下,之前检测到的垂直边缘消失了。不出所料,这个卷积核`K`只可以检测垂直边缘,无法检测水平边缘。

corr2d(X.t(), K)tensor([[0., 0., 0., 0., 0.],

[0., 0., 0., 0., 0.],

[0., 0., 0., 0., 0.],

[0., 0., 0., 0., 0.],

[0., 0., 0., 0., 0.],

[0., 0., 0., 0., 0.],

[0., 0., 0., 0., 0.],

[0., 0., 0., 0., 0.]])四、学习卷积核

???????如果我们只需寻找黑白边缘,那么以上`[1, -1]`的边缘检测器足以。然而,当有了更复杂数值的卷积核,或者连续的卷积层时,我们不可能手动设计滤波器。那么我们可以学习由`X`生成`Y`的卷积核。

???????现在让我们看看是否可以通过仅查看“输入-输出”对来学习由`X`生成`Y`的卷积核。我们先构造一个卷积层,并将其卷积核初始化为随机张量。接下来,在每次迭代中,我们比较`Y`与卷积层输出的平方误差,然后计算梯度来更新卷积核。为了简单起见,我们在此使用内置的二维卷积层,并忽略偏置。

# 构造一个二维卷积层,它具有1个输入通道、1个输出通道和形状为(1,2)的卷积核

conv2d = nn.Conv2d(1, 1, kernel_size=(1, 2), bias=False) # 因为我们前面用的是二维互相关运算corr2d()由X生成的Y,因此不需要bias

# 这个二维卷积层使用四维输入和输出格式(批量大小、通道、高度、宽度),

# 其中批量大小和通道数都为1

X = X.reshape((1, 1, 6, 8))

Y = Y.reshape((1, 1, 6, 7))

lr = 3e-2 # 学习率

for i in range(10):

Y_hat = conv2d(X)

l = (Y_hat - Y) ** 2 # 使用均方误差

conv2d.zero_grad()

l.sum().backward()

# 迭代卷积核

conv2d.weight.data[:] -= lr * conv2d.weight.grad # 手写实现梯度下降

if (i + 1) % 2 == 0:

print(f'epoch {i+1}, loss {l.sum():.3f}')epoch 2, loss 6.422

epoch 4, loss 1.225

epoch 6, loss 0.266

epoch 8, loss 0.070

epoch 10, loss 0.022???????在10次迭代之后,误差已经降到足够低。现在我们来看看我们所学的卷积核的权重张量。

conv2d.weight.data.reshape((1, 2))tensor([[ 1.0010, -0.9739]])???????我们学习到的卷积核权重非常接近我们之前定义的卷积核`K`。

五、特征映射和感受野

???????下图中输出的卷积层有时被称为特征映射(feature map),因为它可以被视为一个输入映射到下一层的空间维度的转换器。

???????在卷积神经网络中,对于某一层的任意元素?,其感受野(receptive field)是指在前向传播期间可能影响?

?计算的所有元素(来自所有先前层)。

???????请注意,感受野可能大于输入的实际大小。让我们用上图为例来解释感受野:给定??卷积核,阴影输出元素值?

?的感受野是输入阴影部分的四个元素。假设之前输出为?

,其大小为?

,现在我们在其后附加一个卷积层,该卷积层以?

?为输入,输出单个元素

。在这种情况下,

?上的?

?的感受野包括?

?的所有四个元素,而输入的感受野包括最初所有九个输入元素。

???????因此,当一个特征图中的任意元素需要检测更广区域的输入特征时,我们可以构建一个更深的网络。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- macbook电脑2024免费好用的系统清理优化软件CleanMyMac X4.14.7

- swift对接环信sdk

- Bridge桥模式(单一职责)

- 汽车加油问题(贪心)

- 电影《年会不能停!》观后感

- 八、C++指针(1)

- 从入门到放弃之「ClickHouse」

- 一个IP证书里可以包含多个ip地址吗

- Android getApplication()、getApplicationContext的区别

- 数据预处理时,怎样处理类别型特征?