【文末送书】TVM编译器原理与实践

欢迎关注博主 Mindtechnist 或加入【智能科技社区】一起学习和分享Linux、C、C++、Python、Matlab,机器人运动控制、多机器人协作,智能优化算法,滤波估计、多传感器信息融合,机器学习,人工智能等相关领域的知识和技术。关注公粽号 《机器和智能》 回复关键词 “python项目实战” 即可获取美哆商城视频资源!

博主介绍:

CSDN优质创作者,CSDN实力新星,CSDN内容合伙人;

阿里云社区专家博主;

华为云社区云享专家;

51CTO社区入驻博主,掘金社区入驻博主,支付宝社区入驻博主,博客园博主。

《TVM编译器原理与实践》

🎉🎉🎉🎉🎉 重磅福利 🎉🎉🎉🎉🎉

🎉本次送2套书 ,评论区抽2位小伙伴送书

🎉活动时间:截止到 2024-01-1510:00:00

🎉抽奖方式:评论区随机抽奖。

🎉参与方式:关注博主、点赞、收藏,评论。

?注意:一定要关注博主,不然中奖后将无效!

🎉通知方式:通过私信联系中奖粉丝。

💡提示:有任何疑问请私信公粽号 《机器和智能》

TVM介绍

TVM 是一个端到端的深度学习编译器栈,旨在提供高效的模型部署和优化。它结合了机器学习、编译器优化和硬件加速的技术,使得机器学习模型可以在各种硬件上高效运行。

结构和原理

- 前端:TVM 支持多种深度学习框架的前端接口,如 TensorFlow、PyTorch 和 Keras。它能够将这些框架的模型表示为中间层表示形式,称为 Relay。

- 中间层表示(Relay IR):Relay 是一种中间表示形式,它将神经网络模型表示为图形表示法。这种 IR 提供了对模型优化和转换的支持。

- 优化器和转换:TVM 的优化器使用各种传统编译器优化技术,如图优化、内存优化和算子融合,以提高模型性能和减少计算资源消耗。

- 后端:TVM 支持多种硬件后端,如 CPU、GPU 和专用加速器(如 FPGA、ASIC)。这些后端能够将优化后的 Relay IR 转换为特定硬件的优化代码。

代码示例

以下是一个简单的示例,展示了使用 TVM 进行模型优化和部署的过程:

import tvm

from tvm import relay

# 定义模型

data = relay.var("data", relay.TensorType((1, 3, 224, 224), "float32"))

net = ...

# Relay IR 优化

mod = relay.Function(relay.analysis.free_vars(net), relay.Call(net, []))

mod = relay.transform.SimplifyInference()(mod)

mod = relay.transform.FuseOps()(mod)

# 选择目标后端(例如 CPU)

target = "llvm"

# 编译和构建可执行代码

with tvm.transform.PassContext(opt_level=3):

graph, lib, params = relay.build(mod, target=target)

实践案例

结合实际案例可以更好地展示 TVM 的应用。可以选择一个特定的模型(如 ResNet、BERT 等),通过 TVM 对其进行优化和部署,比较不同优化级别和后端对性能的影响,并展示优化前后的性能提升和资源消耗。

结语

TVM 是一个强大的深度学习编译器,它通过将机器学习模型编译为高效的硬件代码,提高了模型的部署效率和性能。结合代码示例和实践案例,可以更好地展示 TVM 的原理与实践。

在撰写文章时,可以按照这些框架逐步展开,结合相关代码和图示来阐述 TVM 编译器的原理、结构和实践。

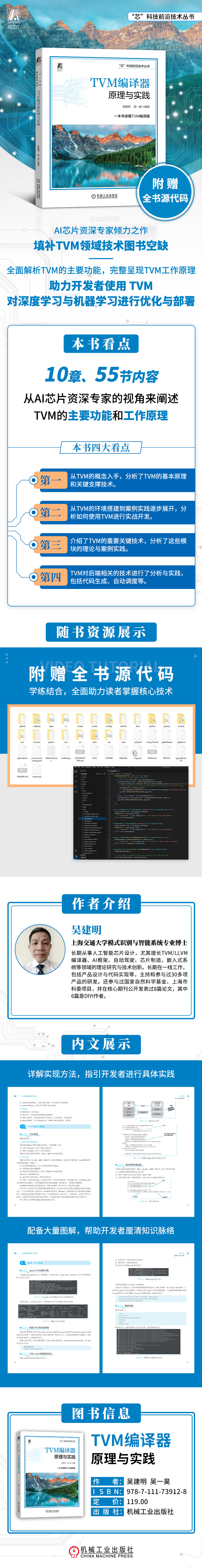

图书推荐-《TVM编译器原理与实践》

TVM(Tensor Virtual Machine, 张量虚拟机)是一种开源的模型编译框架,旨在将机器学习模型自动编译成可供下层硬件执行的机器语言,从而利用多种类型的算力。其工作原理是,先将深度学习模型进行优化推理、内存管理与线程调度,再借用LLVM框架将模型部署在CPU、GPU、FPGA、ARM等硬件设备上。

本书全面解析TVM的主要功能,帮助读者理解TVM工作原理,以及使用 TVM对深度学习与机器学习进行优化与部署。

本书结合作者多年的工作与学习经验,力求将TVM基础理论与案例实践融合在一起进行详细讲解。全书共9章,包括TVM基本知识,使用TVM开发,算子融合与图优化,TVM量化技术,TVM 优化调度,Relay IR,代码生成,后端部署与OpenCL(Open Computing Language,开放运算语言),自动调度、自动搜索与成本模型。各章除了包含重要的知识点和实践技能外,还配备了精心挑选的典型案例。

本书适合从事AI算法、软件、编译器开发以及硬件开发等专业的工程技术人员、科研工作人员、技术管理人员阅读,也可以作为编译器相关专业高校师生的参考用书。

购买链接:点击购买

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 第6课 用window API捕获麦克风数据并加入队列备用

- 如何本地搭建轻量级图床Qchan并结合内网穿透实现远程访问

- SpringBoot整合Kafka (一)

- 构建Python随机密码生成器:保障账户安全的简易工具

- QQ录屏保存在哪个文件夹?教你轻松找回!

- 微服务治理:如何实现断路器?

- Java入门高频考查基础知识2(超详细28题2.5万字答案)

- Salesforce生态系统2024年就业趋势

- CVE-2023-50164 Apache Struts2漏洞复现

- linux安装rabbitmq