transformers Trainer自定义optimizer和scheduler

发布时间:2024年01月03日

1.需求

我自定义了一个evaluate方法,想在每一轮训练过后都执行一次。如果只是在TrainingArguments里设置warmup_steps=100,那么每轮都会重置学习率,也就是每一轮开始的时候都会按照warmup刚开始的学习率进行训练,这就很头疼。

2.解决方案

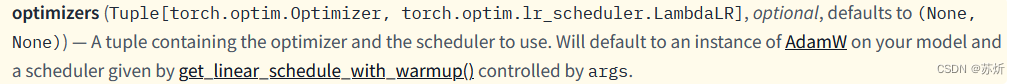

在Trainer里设置optimizers参数,它需要输入一个optimizer和scheduler的tuple,在官方文档里是这样写的:

?所以我们自己设定一个optimizer和scheduler传入即可正常运行

optimizer=transformers.AdamW(model.parameters(),lr=learning_rate)

linear_scheduler = torch.optim.lr_scheduler.LinearLR(optimizer, total_iters=100)

trainer = transformers.Trainer(

model=model,

args=train_args,

optimizers=(optimizer,linear_scheduler),

train_dataset=train_dataset,

eval_dataset=test_dataset,

data_collator=data_collator,

)

文章来源:https://blog.csdn.net/weixin_44902962/article/details/135367949

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- awk基本用法、处理条件、awk应用案例、监控脚本编写

- servlet总结

- kafka报错The server time zone value ‘????????‘ is unrecognized or represents more than one time zon

- 网站安全每日话题——网页内容被篡改怎么办

- .Net6使用SignalR实现前后端实时通信

- 将毫秒数量转换为时分秒字符串(毫秒数→转换为→00:00:00.000形式)

- 「Verilog学习笔记」求最小公倍数

- NSIS 安装windows 安装包(包括QT和MFC)

- 用JAVA实现樱花飘落

- 【Unity 摄像机组件】Camera场景摄像机的认识