LLM 幻觉现象及 RAG 解决方案

发布时间:2024年01月03日

1. 幻觉现象及原因

- 什么是幻觉(hallucination)现象? 大模型的回答有编造成分或错误.

- 比如问 “tensorflow 1.12 版本有 xxx 这个api 么”, 模型回答 “有”, 其实没有.

- 原因

- 训练语料质量低, 本身有错误答案存在.

- LLM 的训练并不关注 “事实是否正确”, 自然不能保证生成答案一定符合事实.

- 推断期间引入错误,

2. RAG 方案

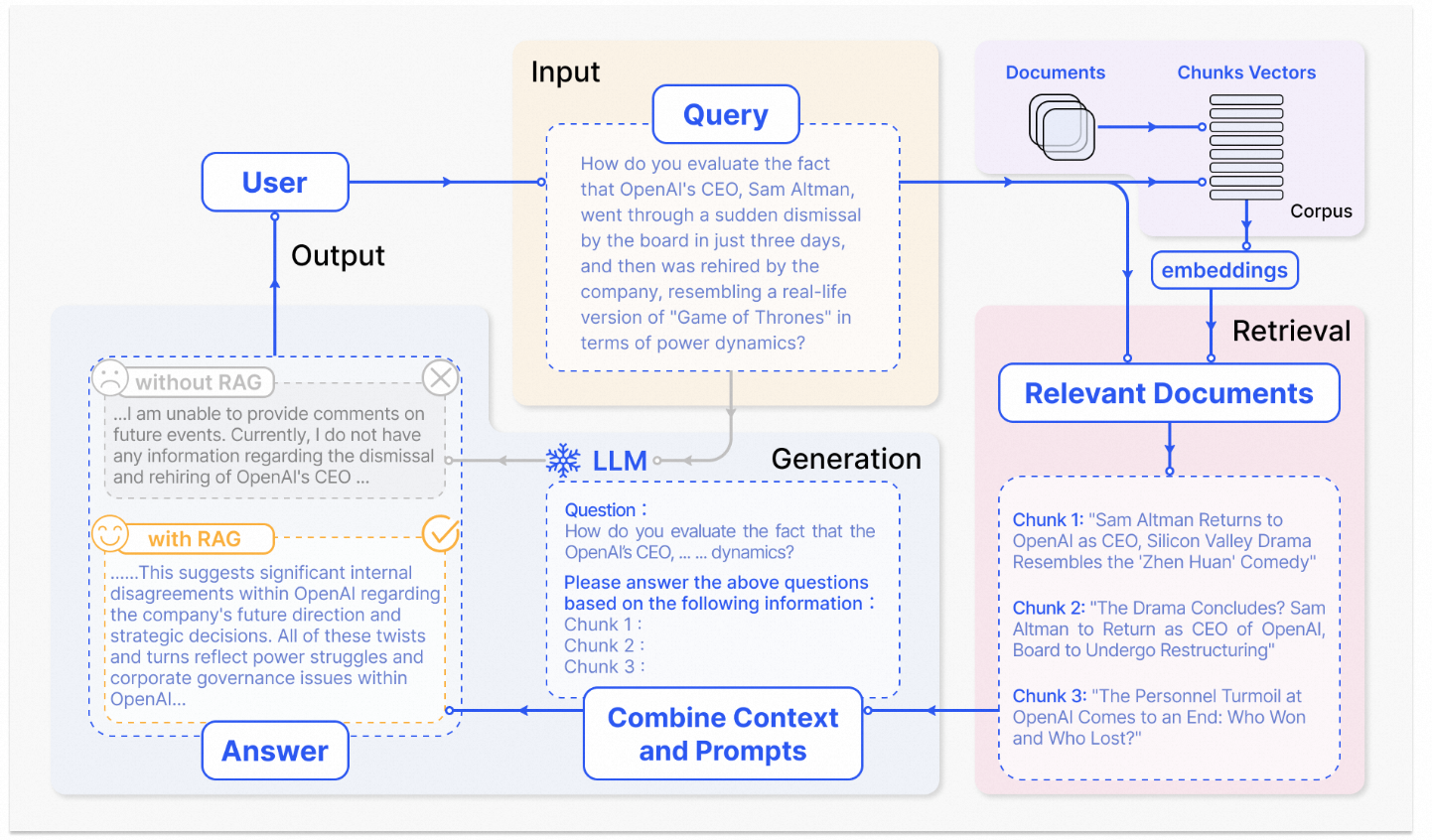

流程简介:将文本分块,然后使用一些 Transformer Encoder 模型将这些块嵌入到向量中,将所有向量放入索引中,最后创建一个 LLM 提示,告诉模型根据我们在搜索步骤中找到的上下文回答用户的查询。

文章来源:https://blog.csdn.net/chuchus/article/details/135358414

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 复选框全选反选效果

- TypeError the JSON object must be str, bytes or bytearray, not ‘list‘

- windows11右键菜单-新建文本文档(记事本、txt文件)不见了的修复方法

- Elasticsearch 8.10.0同义词API用法详解,支持同义词热更新

- 全球化时代跨境企业协作之道:实用策略与实践分享

- 优思学院|调优操作(EVOP)是什么?

- 【LeetCode:34. 在排序数组中查找元素的第一个和最后一个位置 | 二分】

- Python 利用PYQT5设计基于RSA算法盲签名的匿名化电子支付系统设计与实现

- YHZ010 Python 的类型转换

- 怎样衡量负载箱的好坏