大模型实战营Day5笔记

发布时间:2024年01月23日

大模型部署背景

? ? ? ? 大模型部署是指将训练好的模型在特定的软硬件环境中启动的过程,使模型能够接收输入并返回预测结果。大模型的内存开销巨大,7B模型仅权重需要14G内存。另外大模型是自回归生成,需要缓存Attention的 k/v。

LMDeploy 简介如下:

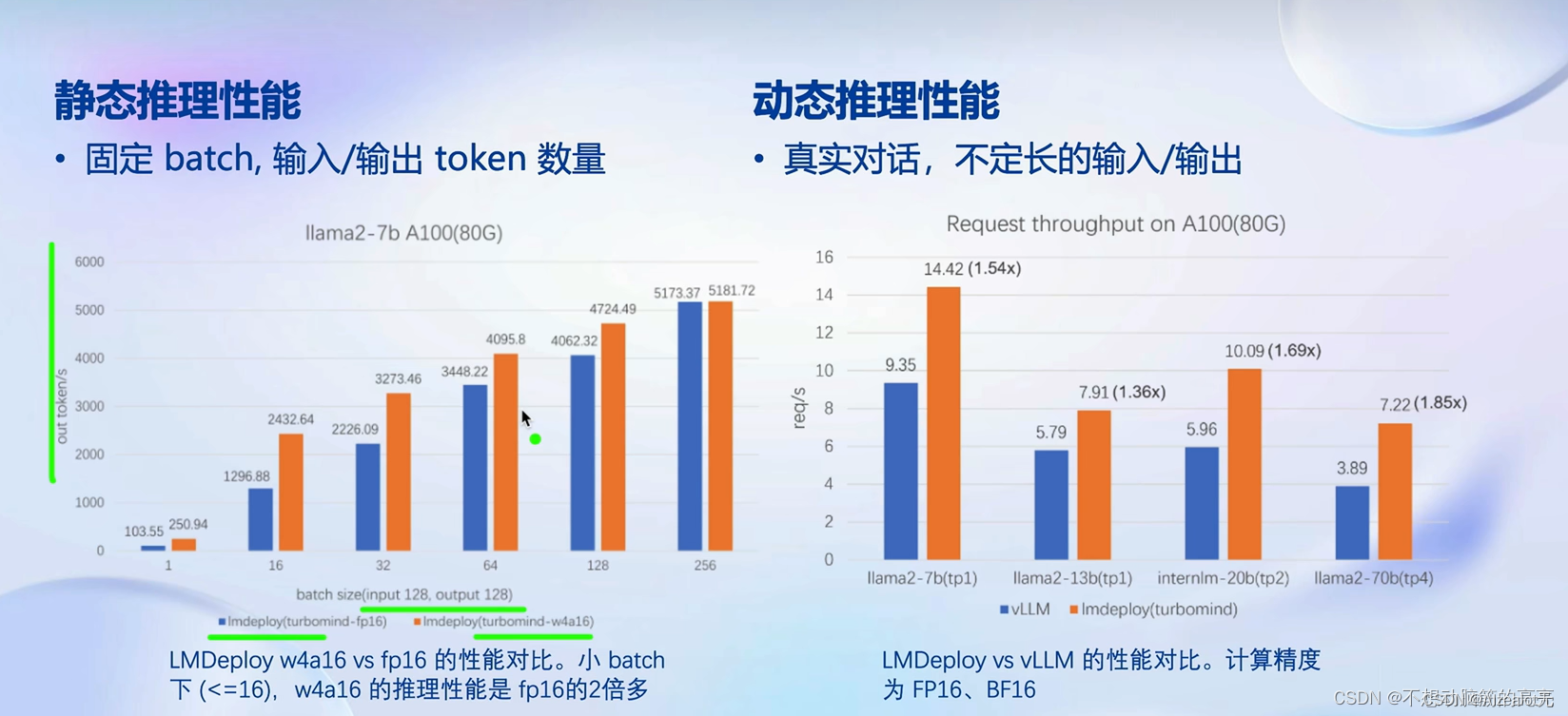

推理性能如图所示:

核心功能-量化

? ? ? ? 量化可以大大降低显存,同时提升推理速度。LLM 是典型的访存密集型任务?

? ? ? ? Weight Only 量化:

核心功能——推理引擎 TurboMind

? ? ? ? 主要包括四个部分:1. 持续批处理;2. 有状态的推理; 3. Blocked k/v cache; 4. 高性能 cuda kernel。

1. 持续批处理

2. 有状态的推理

3. Blocked K/V Cache

4. Cuda Kernel (算子融合可以有效减少访存次数)

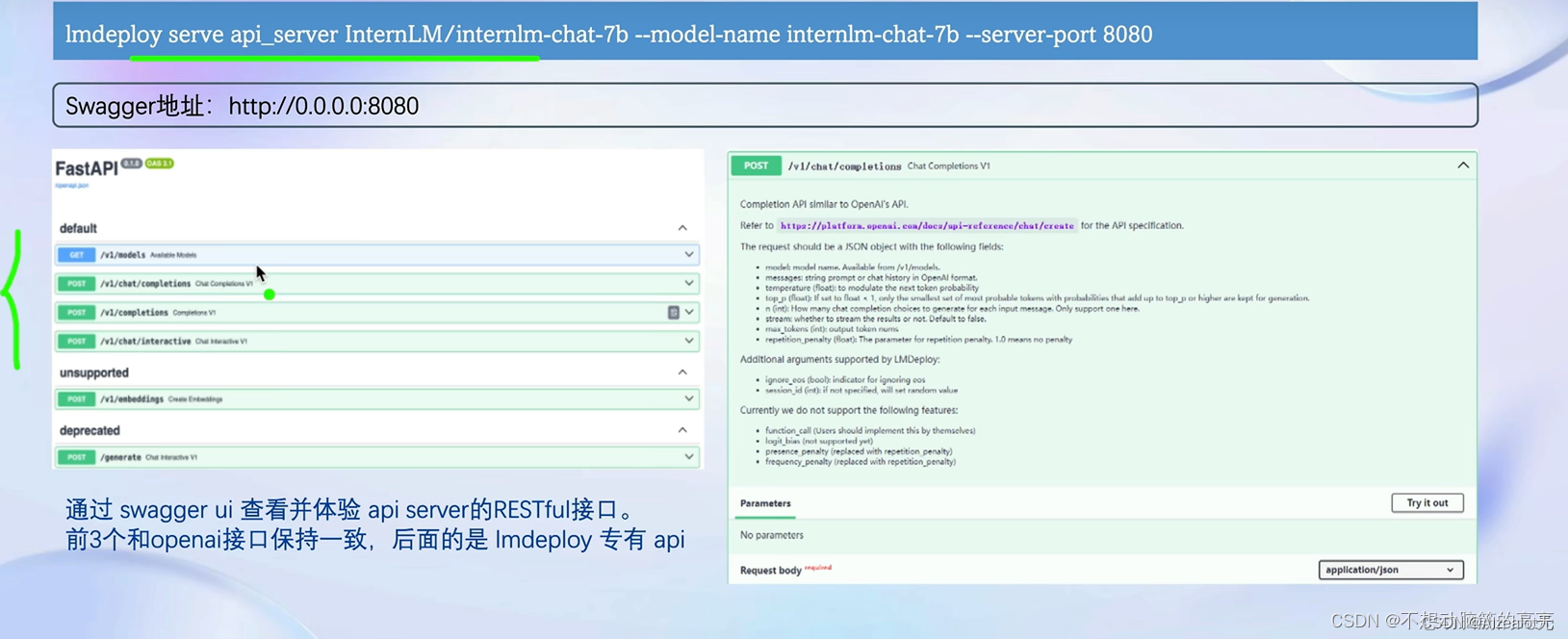

核心功能-推理服务 api server如图所示:

?

文章来源:https://blog.csdn.net/m0_72806612/article/details/135761093

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- Syn_SegNet:用于常规 3T MRI 中超高场 7T MRI 合成和海马亚场分割的联合深度神经网络

- 采访亚马逊云科技代闻:深度解读2023re:Invent与生成式AI

- Linux|centos7操作系统|无线WiFi的命令行配置---wpa_supplicant详解

- 全系统各类型工程水土保持方案编制实践技术

- C语言中的作用域与储存期(包含局部变量、全局变量、auto、register、static、extern)

- 数据入表倒逼数据治理,国有企业如何做好数据资产管理

- MSVCP140_1.dll文件丢失的解决方法指南,MSVCP140_1.dll最快捷的修复手段

- C++ list的模拟实现

- 智能到底有什么用?如何影响收入?chatGPT的定位 智能的可用性与不确定性,数据较多的领域影响较大 GPTs有什么用?

- ansible_jinja2模板的使用