IBM打造“全球最大、最酷的”量子计算机,现在,真正的挑战来了——

近期,一篇发表在外网的文章总结了IBM工程师们在量子计算领域的最新进展和挑战。

为了提高量子计算机的性能和纠错能力,他们通过研究和实践不断改进量子比特的质量和相干时间;新型的柔性带状电缆和多层次布线技术也被引入,以增加芯片连接的效率。

未来,工程师们还计划在系统二中采用新的控制设备,以降低能耗和噪音,进一步提高系统性能。

尽管面临着复杂的工程难题,但IBM团队展示了在量子计算领域迈出的重要一步,并展望了更大规模、更高性能的量子计算系统的可能性。

IBM Quantum System Two

此刻,在纽约威彻斯特郡的一栋大楼大厅外,一间简陋的会议室里,世界上最大的量子计算机系统安静地嗡嗡作响。

这座建筑就是托马斯-J-沃森研究实验室(Thomas J. Watson Research Lab),曾诞生现代激光器、DRAM、曼德布罗特集、国际象棋计算机“深蓝”以及协助宇航员登月的一系列产品。

坐落在约克镇高地的小山上,距离曼哈顿约一小时车程,从高处俯瞰如同一个新月。

这座建筑由埃罗·沙里宁(Eero Saarinen)于1961年为IBM研究部设计,设计风格与他在肯尼迪机场设计的已关闭环球航空公司航站楼的曲线相呼应。

至今,这里仍然是IBM公司前沿科研的地方,涉及人工智能和半导体设计。

即便在现代,楼梯上方悬挂的木制格言仍然是这座建筑同名者的古老座右铭:思考(Think)。

在这一背景之下,两个月前,一台名为“量子系统二号”(Quantum System Two)的机器亮相:被描述为“不仅是计算机历史的新篇章,更是一本全新的书”。

这个宽22英尺、高15英尺的六边形平台由玻璃和抛光铝制成,搭载了三个量子“鹭”(Heron)处理器,设计旨在以模块化的方式进行扩展。

其外观和雄心让人回想起60年代IBM改变世界的大型机房,80年代Cray的超级计算机;如果你眯起眼睛,甚至可能联想到HAL和天网。

与此同时,因为它就坐落在大堂旁,外观酷炫,任务离谱,或许你会误以为这是一件企业艺术品:或许是一场奢华贸易展示,又或者是一台Cybertruck风格的工业冰箱?

“量子系统二号”制造团队的负责人杰伊·甘贝塔(Jay Gambetta)表示:“我们为此感到非常自豪。”

在宇宙最冷的温度下,在绝对零度之上几分之一的温度下,在最微小的尺度上,这就是他所说的可工作、可容错的量子计算机的构件:一块为“量子系统二号”奠定基础的芯片,一台量子超级计算机,又一个时代的超级计算机。

首席量子架构师马蒂亚斯·斯蒂芬(Mattias Steffen)和量子副总裁杰伊·甘贝塔(Jay Gambetta)

对于44岁的澳大利亚人、IBM量子副总裁甘贝塔来说,近二十年的艰苦努力让他倍感自豪。

量子计算最早出现在上世纪80年代初,通常需要庞大的低温制冷机和复杂的电子设备,但至今仍然难以实现、且难以扩展。

这些机器仍然受到噪音和错误的困扰,可能会破坏可靠的计算;为了真正发挥作用,它们需要更大的体积,并需要系统纠错。

因此,有人对成熟可靠的量子计算机是否能够很快问世产生了质疑。

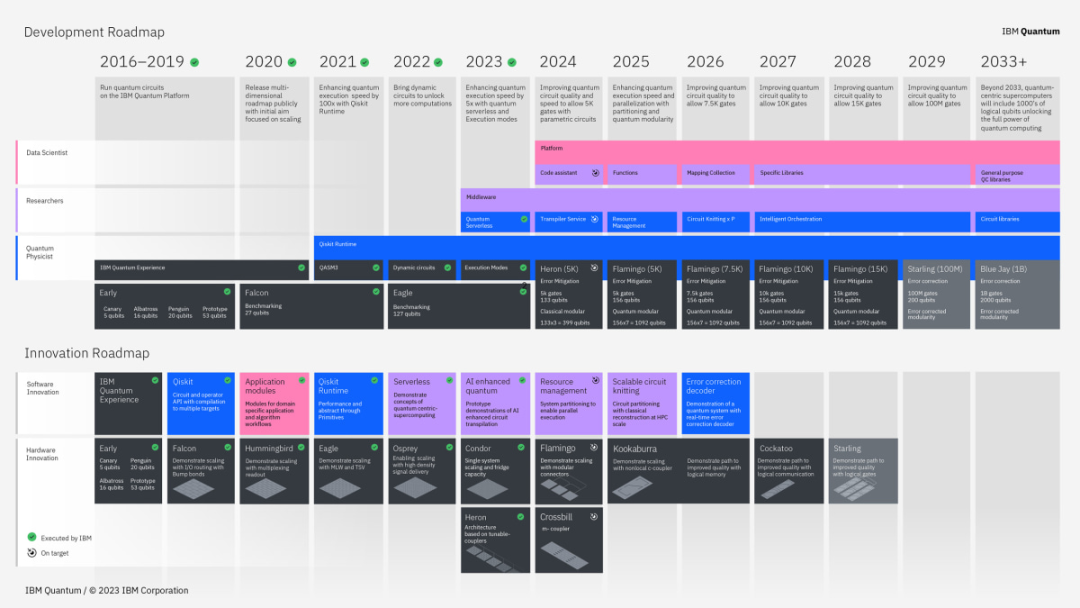

然而,根据IBM的最新路线图,具备纠错功能的机器将在十年内问世。

关于目前仍存在的问题,甘贝塔表示:“我认为这些是一系列工程挑战,但我没有看到任何无法克服的障碍。”

量子计算机的设计理念是用更强大的东西替代经典计算机中的简单1和0。

利用量子力学的奇异原理,如叠加和纠缠,量子比特可以实现0和1的混合,就像是一只既活又死的猫,或者一枚抛掷中的硬币。

即便是爱因斯坦本人也对量子力学的“远距离幽灵作用”感到困扰,并坚持认为上帝“不会与宇宙玩骰子”。

然而,量子的“怪异性”是真实存在的,对于某些问题,量子计算所带来的速度提升会让经典计算机看起来像算盘。

在经典计算机中增加一个比特,只是以线性方式增加计算能力,而量子系统中每一个新的量子比特都会以指数方式扩展计算空间:两个量子比特代表4个可能的值;三个代表8个;四个包含16个值,以此类推。

只要有足够多的量子比特,纠错量子计算机就能处理最好的经典计算机无法处理的计算。

在2023年4月,谷歌公司(该公司在量子计算领域也投入了数十亿美元)报告说,它的70量子比特机器解决了一个超级计算机需要近50年才能解决的问题,而且只用了几秒钟。

理论物理学家理查德·费曼(Richard Feynman)在1982年首次提出量子计算机时所设想的应用可能是最巧妙的:在量子水平上模拟物质的行为。

甘贝塔解释说,经典计算机可以模拟量子系统,但超过50个粒子或量子比特就很难做到;超过100个粒子或量子比特时,“很多有趣的(科学)问题就会在这个范围内发生”。

在量子计算机上运行这些模拟可以帮助科学家发现新的药物、燃料和电池,或者帮助揭开宇宙中一些最棘手的谜团。

它们的数学可以为人工智能提供超级动力,破解最难的问题,包括保护我们所有数字秘密的素数分解问题。

根据麦肯锡的数据,2022年,量子公司共融资23.5亿美元,略高于前一年的融资总额。

除了以美国和中国为首的数十亿美元政府资金外,谷歌、亚马逊和微软也在投资研究。

“财大气粗”的公司一直在探索石油和天然气、化工、航空、制药和金融领域的用途。各国政府正在推行新的标准,以确保数据安全,避免被破解加密的量子机器窃取。

自2016年IBM首次将量子计算机放在云端供任何人开始实验以来,它一直在商业和科学领域保持领先地位,并在该领域制定了最清晰、最具体的技术路线图。

值得注意的是,它也一直在履行自己的许多承诺。

IBM称,这款名为“苍鹭”(Heron)的新芯片是其迄今为止“性能最强”的量子处理器,是其上一款创纪录的127量子比特芯片“鹰”(Eagle)的三倍,甚至优于去年的巨无霸433量子比特芯片“鹗”(Osprey)。

除了“苍鹭”,甘贝塔的团队还发布了“秃鹰”(Condor),这是世界上最大的量子芯片,拥有1121个量子比特。

不过,经过多年的越做越大之后,甘贝塔的团队现在正把精力集中在更小、质量更高的“鸟类”身上,并开发如何把它们连接成更大的、并行的系统,就像经典的超级计算机一样。

这就需要使用经典和量子网络的新方法来连接相邻和相距较远的量子比特。根据修订后的路线图,到2033年,IBM将把多个System Two连接在一起,形成一个能够在多达16632个量子比特上执行10亿门的系统。

届时,甘贝塔团队将设计出一款拥有2000量子比特的芯片:Blue Jay。

虽然计算结果非常关键,但甘贝塔对研究人员是如何做到这一点的感到非常兴奋:他们与所有量子工程师都头疼的误差展开了一场持久战。

这是让每个量子比特变得无比强大的原理,也让它们变得无比脆弱,对来自环境、控制电子设备,甚至彼此间的微小噪音都非常敏感。

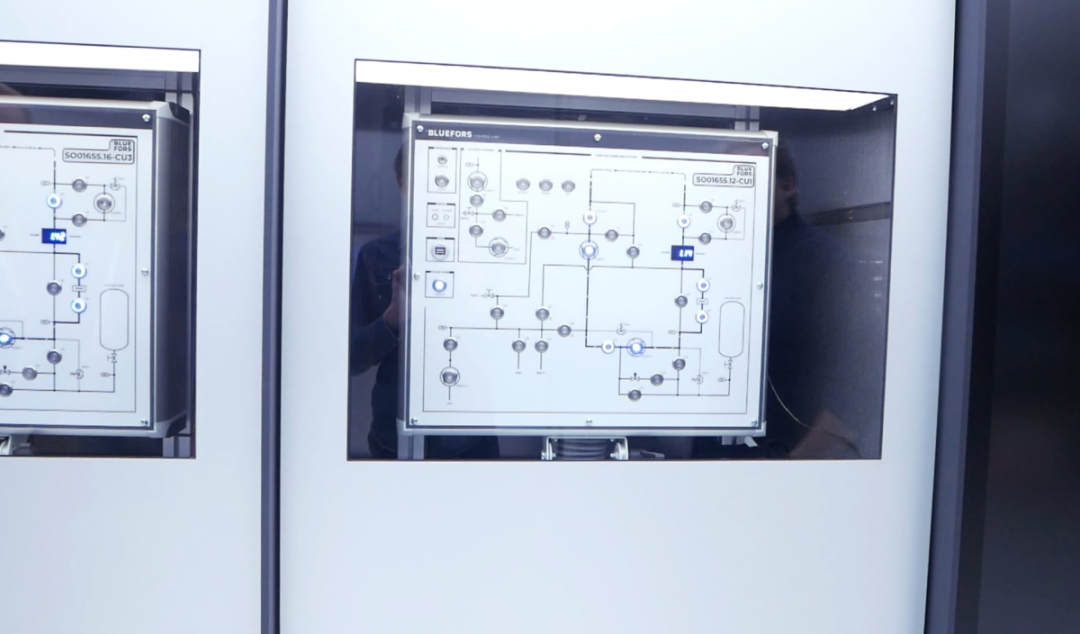

“系统二号”的冷却系统设计为全自动,减轻了工程师们的一大头疼问题

在这种情况下,IBM采用了一套新的“误差缓解”技术,旨在更好地理解噪音,从而更好地减少噪音:这有点像降噪耳机的过程。

在误差缓解方法的帮助下,IBM实现了一个创纪录大小的量子电路,其规模为124量子比特和2,600个纠缠门。

IBM量子公司的实验物理学家、该论文的第一作者阿比纳夫·坎达拉(Abhinav Kandala)说:“Eagle在计算上的表现代表了一个非常大的思想转变。”

现在的目标是在量子比特之间建立更多高质量的纠缠门,也就是计算机运行的逻辑运算。

门的数量或电路的长度编码了算法的精确度。甘贝塔解释说,经过多年增加量子比特,“现在我们已经进入实用阶段,是时候关注如何增加更多的门了”。

甘贝塔表示,IBM很快就会拥有一个能够运行100个量子比特和3000个门的系统,这应该会带来更多的实用性。

到2024年底,IBM的目标是实现5000个门。这一数字每年稳步增长,直到2029年使用200个量子比特达到15000个门。

“那将是另一个时代,”甘贝塔说:“当我们实现纠错的时候。”

但是,减少误差只是一种更困难技术的前奏:完全量子纠错,或称QEC。

即使是世界上制造最好的量子比特也需要进行纠错,这就需要制造许多高质量的冗余物理量子比特——可能是数千个或更多,来制造一个“逻辑”量子比特。

一直以来,量子计算机工程师们的目标就是制造出足够好的量子比特来进行QEC。

到目前为止,IBM和谷歌的超导量子比特芯片大约每100或1000步就会出错一次;IBM的目标是将这一错误率降低到百万分之一,这时纠错技术开始变得更加可行。

随着IBM试图从现有的噪声处理器中榨取更多有用的信息,并制造出更好的量子比特,它也一直在研究如何减少纠错所需的额外量子比特数量。

该代码或表面代码描述了如何将芯片上多余的物理量子比特排列在网格上,以创建一个工作的逻辑量子比特,IBM一直在测试适应其芯片设计的复杂六边形几何结构的各种变体。

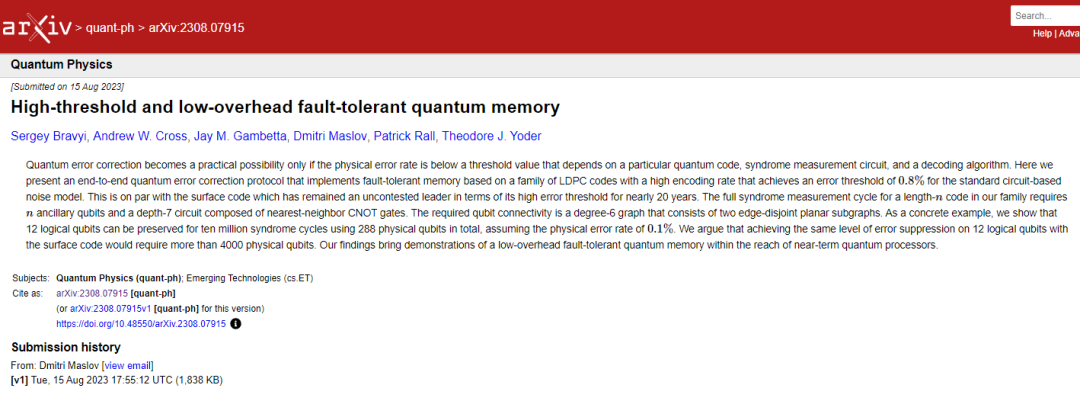

2023年8月,IBM分享了一项研究成果,描述了一种被称为“格罗斯码”(Gross code)的新方法。

论文链接:

https://arxiv.org/abs/2308.07915

“格罗斯码”方法不使用单一网格层,而是通过两个平行网格将更多非直接相邻的量子比特耦合在一起,这意味着只需更少的物理量子比特就能编码一个逻辑量子比特。

IBM称,目前使用的大多数表面码需要多达4000个物理量子比特才能承载12个逻辑量子比特;而“格罗斯码”只需使用288个物理量子比特就能编码一个逻辑量子比特。

尽管如此,纠错只是在一连串错误面前运行和测量可靠量子计算所需技巧的一部分。

所有这些:控制、读出、解码、缓解、纠正,都必须在量子比特解旋或整个系统被错误淹没之前快速完成。

想想看,这就像是在深空温度下以最微小的尺度进行的复杂冒险:在超级计算机中上演一场充满特技的“不可能的任务。

所有这些挑战,尤其是随着机器的大型化,让人们对超级计算机始终心存疑虑。

但是,通过“苍鹭”和其他正在进行的研究,甘贝塔现在看到了隧道尽头的更多曙光:看到了摆脱“含噪声的”、容易出错的机器时代的方法。

甘贝塔说:“我们非常、非常、非常坚定地认为,我们现在有了一条纠错之路。有了Heron,IBM已经找到了一种基本设计和工艺,可以让它一直走下去。”

“对材料的理解和量子比特的设计,我不会说这是一个已经解决的问题,但基本上已经解决了。”

量子芯片的物理原理极为复杂,而其工程设计也反映了这一复杂性。

为了管理和读取每个量子比特,IBM的机器使用了微波脉冲。

在“系统二号”中,这意味着每个量子比特都需要大量的电线、连接和经典装置:成千上万根镀金微波电缆从冰箱顶部蜿蜒而下,穿过一系列同心板,直到底部的处理器。

这一切的结果形成了“量子吊灯”:一个巨大、摇摇欲坠、倒立的蒸汽朋克金字塔,它已经成为量子计算机设计的主要元素。

该吊灯被放置在一个巨型冰箱的真空环境中,温度达到了“宇宙中最冷的程度”。

IBM和谷歌的芯片使用的是超导量子比特(transmon qubit),这是一种微小的超导金属环,可以利用现有的微芯片技术制造。

超导体只要保持在大约20毫开尔文(或零下273摄氏度)的温度下就不会产生电阻(这也是室温超导体如此重要的原因之一)。

其他公司也在用不同的方法取得进展。

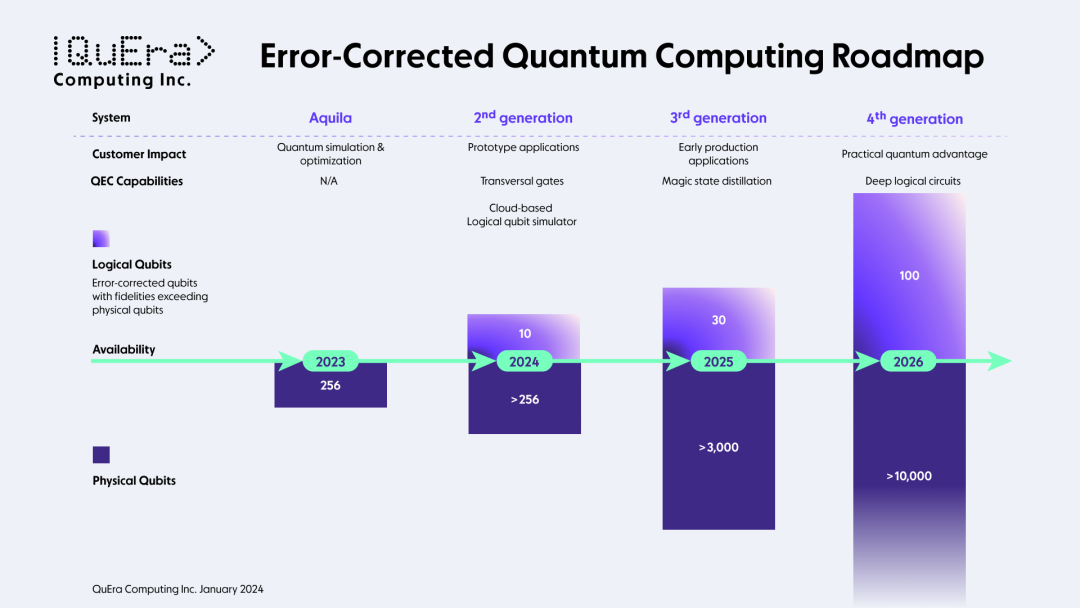

在IBM宣布苍鹭和系统二号后不久,哈佛大学的一个实验室与波士顿的QuEra公司、麻省理工学院以及美国国家标准与技术研究院和马里兰大学的一个联合项目合作,宣布在量子计算机上取得了突破:他们成功将280个量子比特转化为多达48个逻辑量子比特,是迄今为止逻辑量子比特数量的10倍多。

2024年1月9日,QuEra发布战略路线图。即从2024年开始研发一系列纠错量子计算机,到2026年,将有约10,000个物理量子比特和100个逻辑量子比特

德克萨斯大学奥斯汀分校量子信息中心主任斯科特·阿伦森(Scott Aaronson)上个月在他的博客中指出,如果这一成果成立,“它有可能是2023年量子计算实验的最大突破”。

与IBM的量子计算方法不同,QuEra的量子比特是由铷原子构成的。它的系统使用激光束而不是多根导线来控制每个量子比特。

其他公司也在尝试用捕获离子、中性原子、量子点、光子等理论上任何类似原子的物质来构建量子比特。

甘贝塔表示:“作为一名科学家,我们完全支持研究替代的量子比特。如果有好的想法,我们将会将其融入我们的研究。”

IBM、谷歌、D-Wave等公司还在探索一种名为fluxonium的替代量子比特,它在超导量子比特中具有最长的相干时间。

据马里兰大学的一个研究小组称,它的相干时间为1.48毫秒,保真度约为99.991%。

参与fluxonium研究的Seeqc是一家位于威彻斯特郡的初创公司,其设计的量子计算机控制设备采用超导技术,具有更低的能耗,并且可以直接安装在量子比特旁边。

Seeqc的联合创始人兼首席执行官约翰·列维(John Levy)表示,与基于半导体的设备相比,这种技术可以提高速度和其他效率,并且更容易扩展量子比特。

他指出,目前IBM和其他量子公司需要解决的主要问题是:“我们如何从一开始就建立一个解决可扩展性问题的架构?”

多年来,试图扩大量子计算机规模的公司一直致力于在芯片上“挤压”出更多的量子比特。

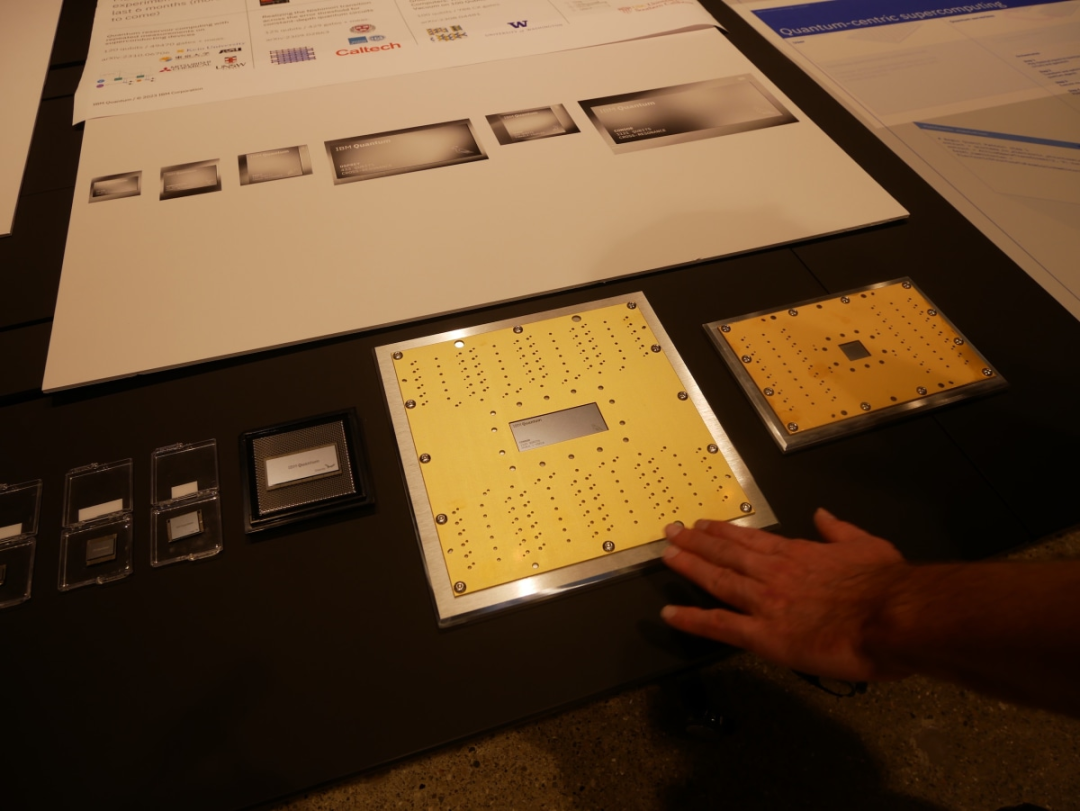

就在上个月,甘贝塔的团队发布了目前世界上最大的量子计算机芯片Condor,拥有1,121个量子比特。

而加利福尼亚的初创公司Atom Computing在10月份击败了IBM,成功突破了1000量子比特的壁垒,达到了1225个量子比特。

然而,Atom Computing的计算机是由捕获的中性原子构成的,而非微小的超导电路。

IBM首席量子架构师马蒂亚斯·斯蒂芬(Matthias Steffen)表示,Condor的推出证明了IBM有能力生产更小的量子比特,并持续制造大量的量子比特。

他指出:“Condor成功地突破了单个处理器的扩展极限,以及在一个制冷机中冷却和测量大型处理器的能力。”

为了将芯片冷却到接近绝对零度,IBM还建造了世界上最大的制冷机(系统二号的制冷机由芬兰公司Bluefors制造,也是同类产品中最大的低温制冷机之一)。

在2022年底,IBM的制冷机“金眼”(Goldeneye)终于启用并冷却下来,将比三个家用厨房冰箱还大的体积变成了比外太空还冷的温度。

斯蒂芬说:“在当时,那是最大的稀释制冷机。”

2022年底,IBM的制冷机——“金眼”(Goldeneye),终于被打开并冷却下来,它把比三个家用厨房冰箱还大的体积变成了比外太空还冷的温度。

斯蒂芬说:“在当时,这是最大的稀释制冷机。”

然而,对于甘贝塔、斯蒂芬和其他人来说,巨型芯片和制冷机都是量子系统扩大所面临的硬性限制的明证。

每增加一个量子比特,就需要增加电缆和经典设备,从而引入更多噪声和误差。

科学家们不仅需要应对量子效应,还需要考虑将多少个量子比特和其他元件挤在一起的纯物理限制。

Condor芯片的尺寸凸显了这一问题。

放置量子比特的芯片大约有两张邮票那么大,采用蜂巢设计,在五层超导金属上密集封装了1121个量子比特。

然而,QPU的其他部分,即处理器周围的主板,即布线的地方,非常庞大,有黑胶唱片封面那么大:如果将与之相连的所有线路都拉出来,那么它将延伸两英里。

1,121量子比特的“秃鹰”和周围巨大的“主板”,电缆就连接在“主板”上

“如果我们只是一味地进一步缩小(量子比特),而不解决控制和读取时涉及的电缆和设备问题,实际上并没有解决任何难题。”

斯蒂芬解释道:“仅仅通过将温度调低到接近绝对零度,然后再升高,就足以让量子机器瘫痪好几天:连接器可能会松动,微小的零部件会因为收缩和膨胀而出现问题。”

他接着提到:“以2022年发布的Osprey芯片为例,它拥有433个比特。如果现在每根同轴电缆上有5个连接器,再乘以433个连接器,那么其中一个连接器松动的概率就变成了1。这就需要重新连接每一个连接器。”

IBM的工程师们计划利用一种名为“可调耦合器”(tunable coupler)的功能,将多个芯片上相邻并最终相距甚远的量子比特连接起来,而不是制造越来越大的芯片。

可调耦合器是一种可调装置,位于两个量子比特之间,通过有效适应噪声干扰,使它们在执行操作时减少错误。

在将其集成到新的“苍鹭”之前的四年时间里,研究团队对误差进行了研究,并在6到10量子比特的小型设备上对耦合器进行了实践。

结果发现,最大的挑战之一就是如何将耦合器完全关闭。

斯蒂芬说:“这听起来微不足道,但却耗费了大量心血。”

据去年发表的一篇论文,“苍鹭”的错误率和栅极速度比“老鹰”高出四到五倍,根据该论文,苍鹭的2量子比特栅极保真度高达99.68%。

他补充道:“串扰几乎无法测量。”

系统二号的制冷机包含三个133量子比特芯片

现在,工程师们仍在努力更好地理解各种错误,包括一类与未知微观缺陷有关的神秘错误。

他们的希望是达到99.99%——这被认为是纠错所必需的“圣杯”。

为了进一步降低错误率,控制、读取和纠正错误,工程师们还需要构建寿命更长的量子比特。量子比特的相干时间越长,其保持纠缠的时间就越长,就有更多的时间在错误发生之前进行复杂的计算。

多年来,这些相干时间一直稳定地停留在几十微秒:不够长。通过最新的测试量子比特,IBM的相干时间达到了1毫秒甚至更长。

斯蒂芬说:“考虑到栅极时间等因素,如果将其转换为每个栅极的预测误差,我们的误差将在10到负4之间。”

“我们需要将这些(量子比特)应用到我们的大型设备中。”

就像微小的缺陷会给量子比特带来问题一样,其他微小的物理调整也能带来宝贵的效率。

一种新型的柔性带状电缆——类似于笔记本电脑或微波炉内的那种非常昂贵的带状电缆,几乎可以实现两倍数量的芯片连接。

为“鹰”计划开发的多层次布线技术,将读出和控制所需的导线和其他元件分别放在不同的层上,从而允许更多的量子比特和补充器件。

类似的几何创新技术首次应用于433量子比特的 "鹰"(Osprey)芯片上,可以提高量子比特密度,同时减少串扰。

不过,量子比特只是拼图的一部分;更大、更好的系统将取决于处理器周围经典器件的性能。

斯蒂芬表示,正确的微波工程,包括发送和接收量子比特微波信号的电子设备,是“巨大的挑战之一”。

对于系统二号,IBM还升级了附近机架上的控制和读出设备,这些设备采用了速度极快的现场可编程门阵列(FPGA)芯片。

最终,研究小组计划完全换掉这些芯片,改用特定应用集成电路(ASIC)芯片和低温CMOS控制器,它们可以在量子比特工作的大约4开尔文温度下运行。

这带来了速度的提升。

而且,由于较新的芯片比FPGA芯片更小、能耗更低,因此产生的噪音更小,扩展也更容易。

甘贝塔说,有了新的控制设备,“系统二号”的能耗有望从每个量子比特约100瓦降至约10毫瓦,从而实现更大的系统。

为了扩大芯片的规模,使其与新的纠错方法相匹配,甘贝塔的团队必须弄清楚如何在未来的芯片上构建量子比特,使每个量子比特与其他多个量子比特相连。

这将需要一系列新的耦合器来连接远处的量子比特或其他芯片上的量子比特:L耦合器、C耦合器、M耦合器,以及高速经典和量子网络。

他的团队需要确保整个系统以难以想象的速度协调运行。

甘贝塔站在“系统二号”的后面,描述着从闸门、读出、纠错到云软件的严格协调,他的手势从寒冷的中心到附近的控制电子设备柜,再到附近的云服务器。

“这是一个时间尺度。”他说:“这个需要纳秒级,这个需要微秒级,然后云可能是毫秒级。”

斯蒂芬笑着说,他还停留在另一个时间尺度上。他还记得二十多年前冷却他的第一台笨重的低温冰箱的情景。

“如果你在我做博士后的第一年问我,你会不会有一台这样的冰箱,里面的量子比特具有我们这样的相干时间,具有我们这样的性能,我会说这太荒谬了。”

“但基本上,从某种意义上说,我们现在的成果就是活生生的证明——永远不要说‘这是不可能的’。”

参考链接:

[1]https://cointelegraph.com/news/mit-harvard-spinout-plans-10-000-qubit-error-corrected-quantum-computer-2026

[2]https://www.fastcompany.com/90992708/ibm-quantum-system-two

[3]https://insidehpc.com/2024/01/quera-releases-quantum-roadmap/

[4]https://arstechnica.com/science/2024/01/quantum-computing-startup-says-it-will-beat-ibm-to-error-correction/

[5]https://www.hpcwire.com/2024/01/09/quera-debuts-3-year-roadmap-to-10000-physical-and-100-logical-qubits/

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 找磨损度最高和最低的硬盘 - 华为机试真题题解

- 如何接手并维护一个新的项目?

- 数据库MySQL入门课程

- 4-Docker命令之docker tag

- STM32——通用定时器脉冲计数实验

- springboot可配置开启自定义starter

- 如何在 Ubuntu 20.04 上安装 Rust

- 众和策略股市行情分析:炒股一定要分仓吗?

- C#未能加载文件或程序集。需要强名称程序集,异常来自 HRESULT:0x80131044

- Allins 官网正式上线,铭文赛道进入 AMM 交易时代