2022-ECCV-Explaining Deepfake Detection by Analysing Image Matching

发布时间:2024年01月11日

一、研究背景

1.大量工作将深度伪造检测作为一个二分类任务并取得了良好的性能。

2.理解模型如何在二分类标签的监督下学习伪造相关特征仍难是个艰巨的任务。

3.视觉概念:具有语义的人脸区域,如嘴、鼻子、眼睛。

二、研究目标

1.验证假设,并从图像匹配的角度评估视觉概念的关系,以此解释检测模型的预测结果。

2.解释深度伪造检测模型如何在二分类标签的监督下学习伪影特征。

3.习得更好的检测模型,提高在压缩视频上的伪造检测性能。

三、研究动机(3种假设)

1.检测模型将既不与原图相关也不与目标图相关的视觉概念看作是与伪造相关的视觉概念,性能良好的检测模型应该基于源/目标-无关的视觉概念来判断真伪。

2.在标签的监督下,伪造-原图-目标图匹配可以帮助丢弃伪造无关视觉特征,隐式学习伪造相关的视觉概念。

3.利用原始训练集进行图片匹配习得的视觉概念容易受到视频压缩的影响。

四、技术路线

假设1:

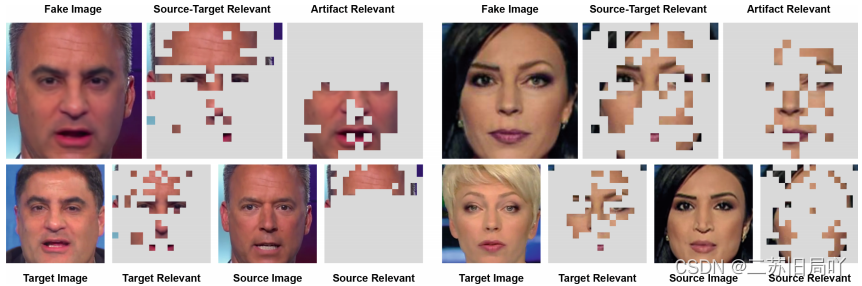

- 设计源编码器 v s v_s vs?和目标编码器 v t v_t vt?区分图片中的视觉概念。

- 令伪造图片与相应源/目标图片具有相同属性标签,以此训练编码器。

- 用Shapley value评估视觉概念的区域贡献。例如:

对输入图片做 L × L L\times L L×L区域划分,得到 G = { g 11 , … , g L L } G=\{g_{11},\dots,g_{LL}\} G={g11?,…,gLL?}。

当 ? v d ( g i j ∣ G ) > 0 \phi_{v_{d}}(g_{ij}\mid G)>0 ?vd??(gij?∣G)>0时,证明区域 g i j g_{ij} gij?与伪造相关。 - 评估视觉概念间的关系:

利用掩膜操作定位源/目标相关区域:

M τ = I ( m a x ( ? v s , ? v s ) ) > τ M_{\tau}=I(max(\phi_{v{s}},\phi_{v{s}}))>\tau Mτ?=I(max(?vs?,?vs?))>τ

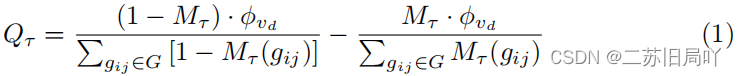

评估视觉概念间的交叉强度,第一项为无关区域的相关强度,第二项为相关区域的相关强度:

假设2:

设置两种训练集:

第一种:真实图片仅包含和伪造图片相关的原图/目标图

第二种:真实图片与伪造图片不相关

假设3:

评估稳定性:

对于压缩图片,由源/目标编码器习得的视觉概念更加稳定。

![]()

FST-Matching Deepfake Detection Model:

直接将源/目标无关特征从源/目标视觉概念中分离出来去进行真伪检测可以提升在压缩视频上的性能。

- 习得源特征 f s f_s fs?和目标特征 f t f_t ft?

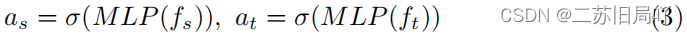

- 利用通道注意力自动解纠缠源/目标无关特征

f

s

i

r

f_s^{ir}

fsir?、

f

t

i

r

f_t^{ir}

ftir?和源/目标相关特征

f

s

r

f_s^{r}

fsr?、

f

t

r

f_t^{r}

ftr?

- 设置 Fake-Source/Target Pair Verification module验证解纠缠的有效性,令伪造图片与相关源/目标图片的

f

i

r

f^{ir}

fir具有相同属性标签

- 增强

[

f

s

i

r

,

f

t

i

r

]

[f_s^{ir}, f_t^{ir}]

[fsir?,ftir?]的影响

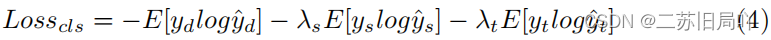

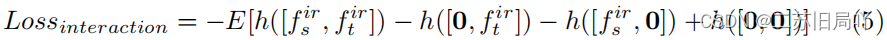

- 总损失

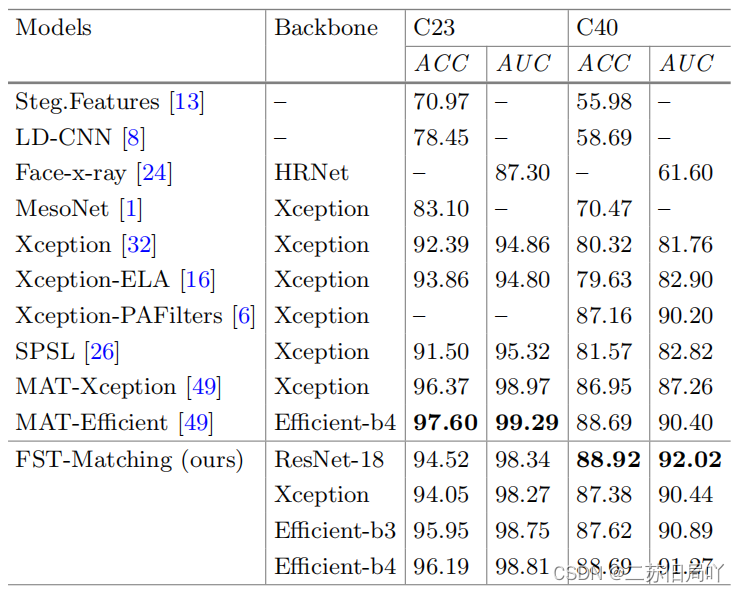

五、实验结果

文章来源:https://blog.csdn.net/qq_37246721/article/details/135519372

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 如何使用vscode调试R

- 小米手机游戏中通过xposed edge pro,自动设置拦截所有电话!

- 泛型- Collections工具类- file类

- 【解决方法】zip文件压缩后还是太大,怎么办?

- 8.架构设计系列:常用设计模式的实践

- 完全背包问题,原理剖析,公式推导,OJ详解

- 基于C语言的坦克大战游戏开发

- 全国1900+监测站点空气质量日数据,shp/excel格式,2023年最新数据

- Python深度学习029:pytorch中常用的模块或方法

- 域环境权限提升