卷积神经网络基础与补充

发布时间:2023年12月24日

参考自?

CNN的历史发展:

这一点老师上课的时候也有讲到,BP的出现对CNN的发展至关重要

卷积的特性:关于具体体现在哪,上课老师的ppt讲的非常的明白

目的:进行特征提取,减少训练过程中需要的参数数量

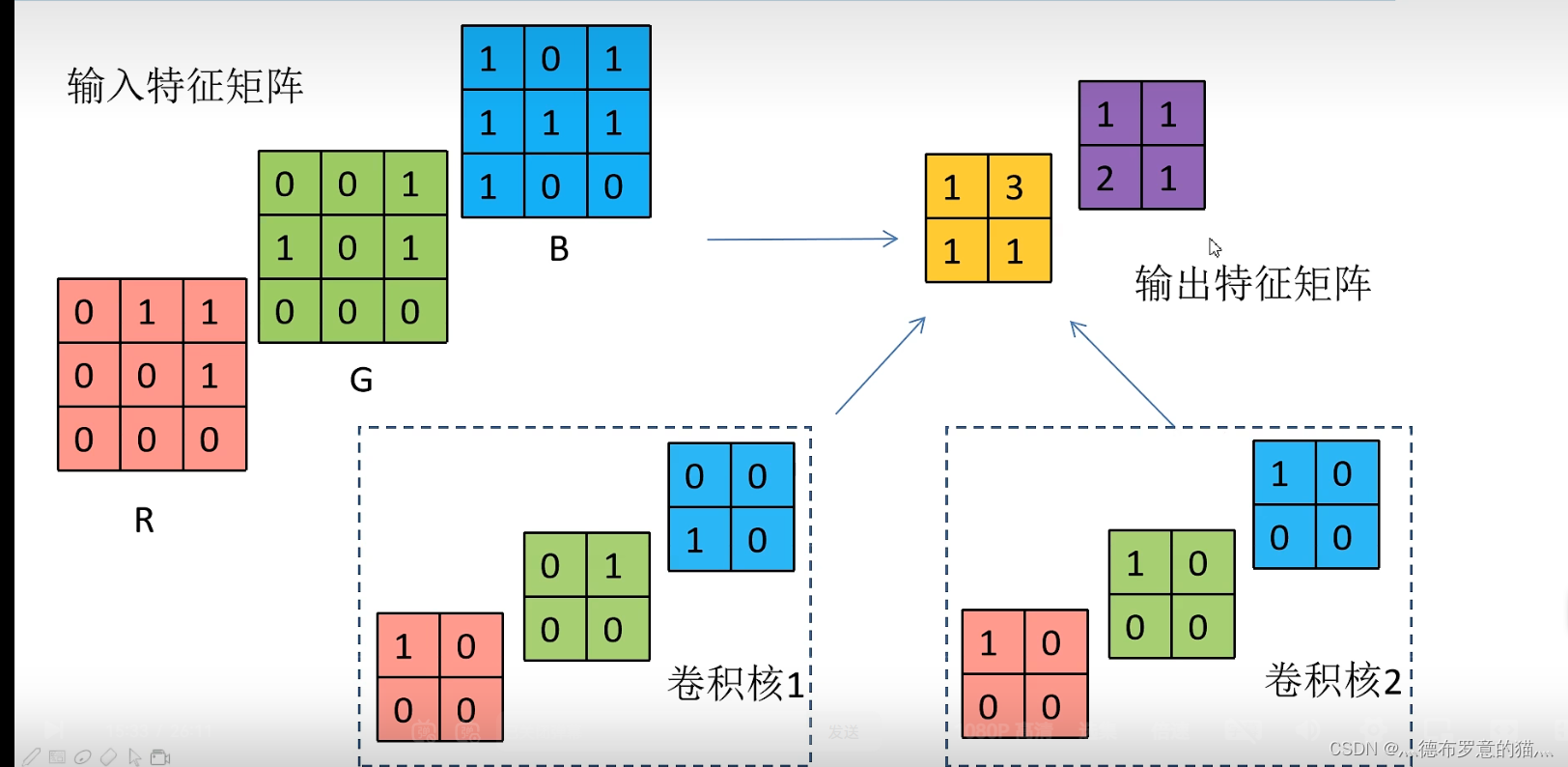

下面这种图也是非常的好,对于理解卷积的过程有很好的理解

需要注意的是:

1.卷积核的chanel和输入矩阵的阿chanel是一致的

2.根据卷积的过程也可以知道最后输出矩阵的chanel是卷积核的个数

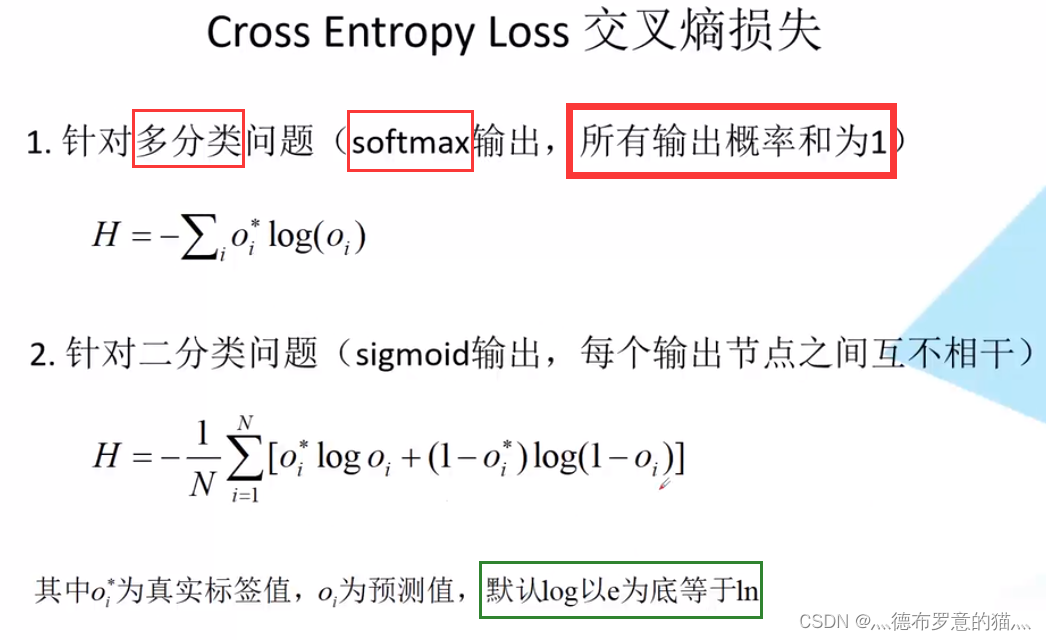

反向传播中误差的计算:softmax/sigmoid

一般是用?交叉熵损失?(Cross Entropy Loss)来计算误差

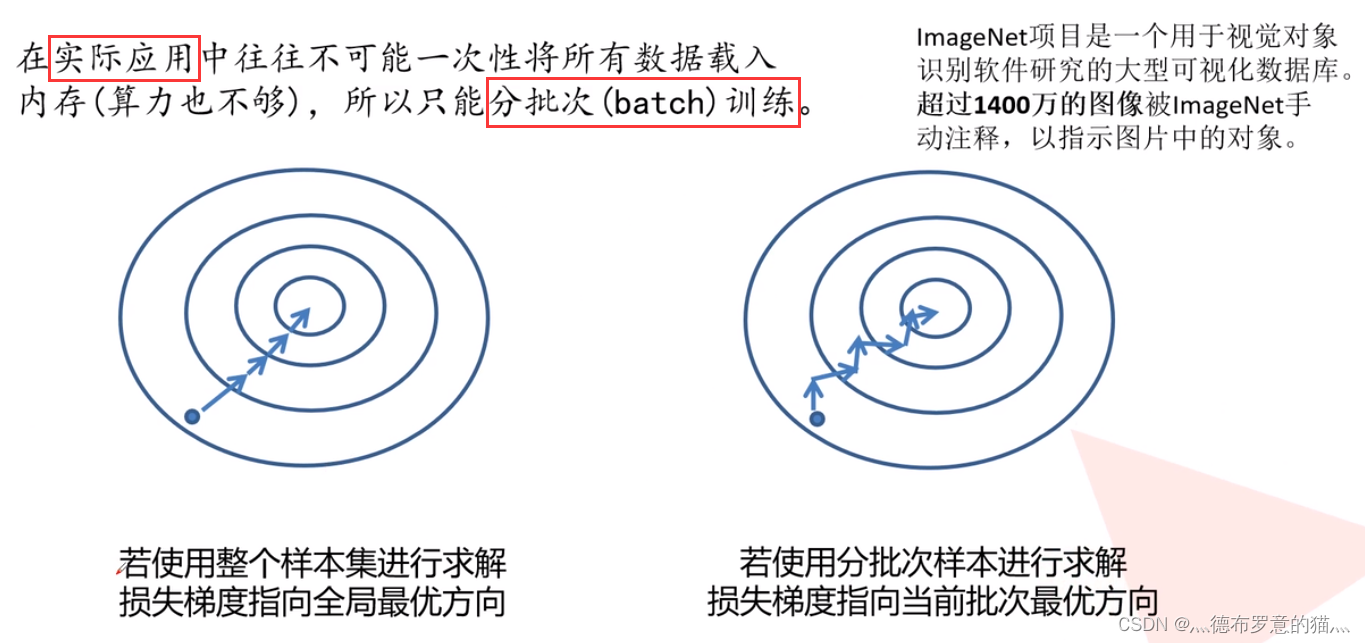

权重的更新

常用优化器:SGD优化器(Stochastic Gradient Descent 随机梯度下降)

- 缺点:1. 易受样本噪声影响;2. 可能陷入局部最优解

- 改进:SGD+Momentum优化器

文章来源:https://blog.csdn.net/m0_60921016/article/details/135178492

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!