神经网络-非线性激活

发布时间:2024年01月06日

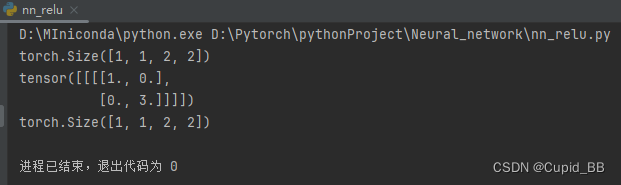

ReLU

import torch

from torch import nn

input = torch.tensor([[1, -0.5],

[-1, 3]])

input = torch.reshape(input, (-1, 1, 2, 2))

print(input.shape) # torch.Size([1, 1, 2, 2]) .shape = .size()

class Tudui(nn.Module):

def __init__(self):

super(Tudui, self).__init__()

self.relu1 = nn.ReLU()

def forward(self, input):

output = self.relu1(input)

return output

tudui = Tudui()

output = tudui(input)

print(output) # tensor([[[[1., 0.],[0., 3.]]]])

Result

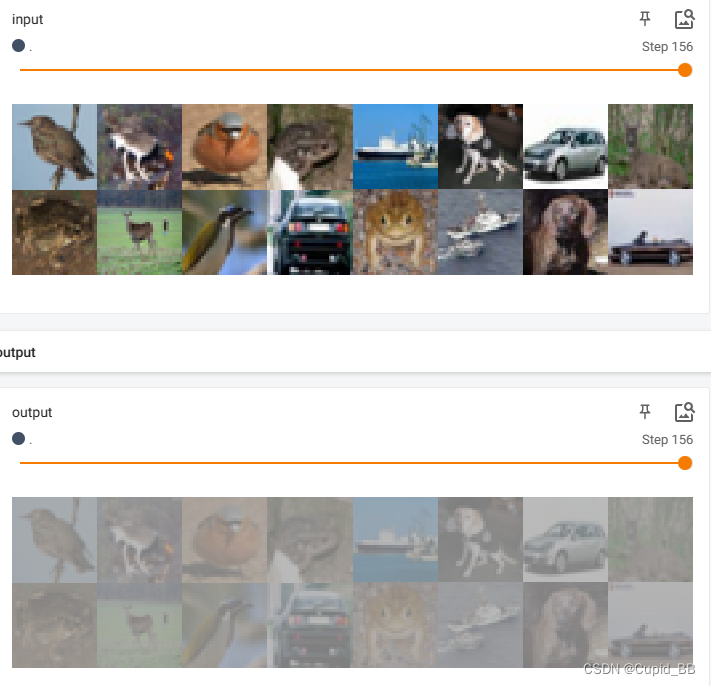

Sigmoid

import torch

import torchvision

from torch import nn

from torch.utils.data import DataLoader

from torch.utils.tensorboard import SummaryWriter

'''input = torch.tensor([[1, -0.5],

[-1, 3]])

input = torch.reshape(input, (-1, 1, 2, 2))

print(input.shape) # torch.Size([1, 1, 2, 2]) .shape = .size()'''

dataset = torchvision.datasets.CIFAR10(root='./data', train=False, download=True, transform=torchvision.transforms.ToTensor())

dataloader = DataLoader(dataset, batch_size=64, shuffle=True)

class Tudui(nn.Module):

def __init__(self):

super(Tudui, self).__init__()

self.relu1 = nn.ReLU()

self.sigmoid1 = nn.Sigmoid()

def forward(self, input):

output = self.sigmoid1(input)

return output

tudui = Tudui()

writer = SummaryWriter('./logs_relu')

step = 0

for data in dataloader:

imgs, targets = data

writer.add_images('input', imgs, step)

output = tudui(imgs)

writer.add_images('output', output, step)

step += 1

writer.close()

目的:引入非线性特征,非线性越多,才能训练出符合各种曲线,符合各种特征的模型,泛化能力好

下面是ReLU的结果

文章来源:https://blog.csdn.net/weixin_51788042/article/details/135414928

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 会声会影2024什么出来?会声会影2024有什么新功能

- vite 打包优化

- MMWave API

- 计算机毕业设计—springboot+vue房屋租赁管理系统(附源码)

- 基于51单片机的八路抢答器(普中)

- 红帽秘笈,第三十四章角色

- 二蛋赠书十一期:《TypeScript入门与区块链项目实战》

- uniapp打包配置 (安卓+ios)

- 淘宝关键字搜索商品列表接口API(通过关键字获取商品ID)

- 动手学深度学习-自然语言处理-预训练