最新能让老外对口型讲中文的AI 视频教程,免费开源AI工具——Wav2Lip

本期就来教大家制作海外大佬们新年祝福视频吧!对口型视频一直在全网都非常的火爆,随便一个视频都是几千赞以上,简直堪称涨粉利器!

是不是很有意思,口型完全对得上,表情也很自然逼真,不懂内行的人,还真的以为是大佬中文说得非常溜!

这种内容形态非常适合短视频上平台进行引流获客,比如抖音爆火的曾仕强老师讲国学,基本现在这类账号的内容都是利用对口型的方式制作出来的,粉丝超10万+的账号比比皆是。

其实视频对口型的工具早在几年前就有,但应用领域甚少,直到2023AI视频生成式工具大爆发,带动一系列厂商投入到这块领域,像最近这两个月被大家熟知的Runway口型翻译功能,仅凭一条郭德纲说英文就有5000万播放量,几百万点赞量,制作简单,涨粉强,适合新手突围,非常香。

但是Runway的价格确实劝退一大波人,今天重点介绍一款视频对口型AI开源神器——Wav2Lip,直接在SD上安装插件即可免费畅玩。

由于教程篇幅较长,因此会分2期内容进行介绍,本期重点介绍Wav2Lip按照教程,下期将介绍详细的操作教程。

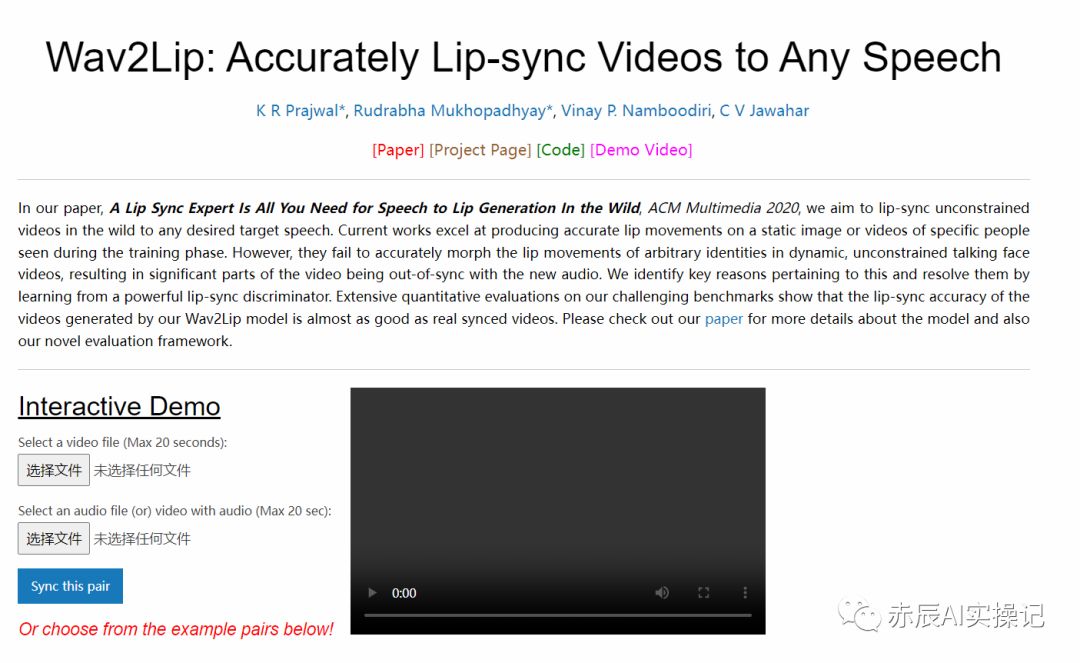

1.Wav2Lip介绍

官方网站:http://wav2lip.cn/

Wav2Lip是一种基于深度学习的技术,旨在将音频与静态图像中的嘴部动作进行同步,生成逼真的口播视频。

它可以让我们在视频中看到一个人说话的样子,而实际上这个人可能根本没有说过这些话。你可以把它想象成一种”口型变脸”的魔术。比如,你可以用任何想要的声音,比如你自己的声音,来配上一段视频,就好像这个人真的在说那些话一样。

它的原理是利用了深度学习技术来分析视频中人物的嘴部动作,并将这些动作与音频同步,生成一个看起来非常真实的口型。为了达到这个效果,它需要一个预测模型来分析视频中的嘴部形状和动作,还需要一个合成器来将声音和嘴部动作结合起来,生成最后的口型视频。

项目演示地址:

https://bhaasha.iiit.ac.in/lipsync/

2.SD上如何使用Wav2Lip

在安装插件之前,得进行安装Wav2Lip所需的环境“FFmpeg”。然后再下载并安装所需的模型。

第一步

(https://ffmpeg.org/download.html)

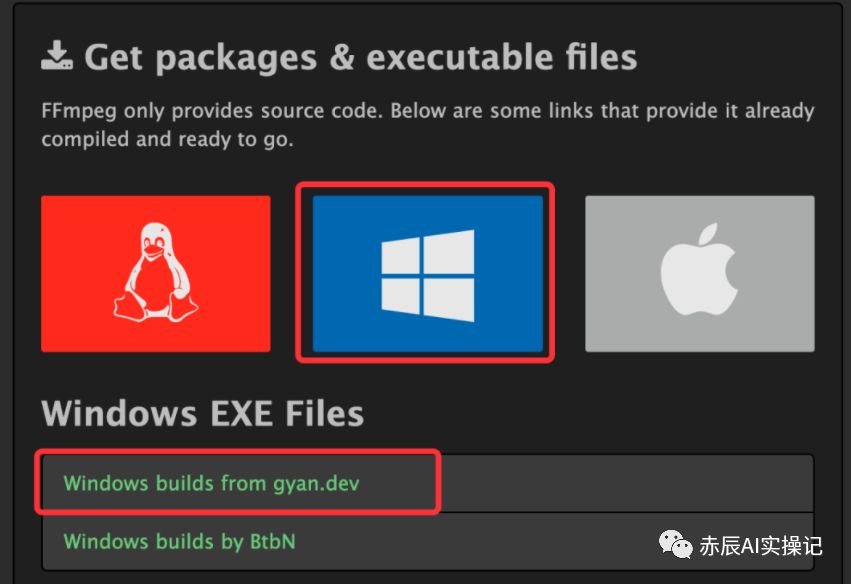

点击链接,进入“FFmpeg”官网,鼠标在主页中往下滑,在“Get packages & executable files”选择适合电脑的操作系统。

第二步

以Windows为例,点击Windows的图标,然后选择“Windows builds from gyan.dev”。

第三步

打开之后,鼠标往下滑,找到“ffmpeg-git-essentials.7z”文件,点击下载,同时解压当前文件。

第四步

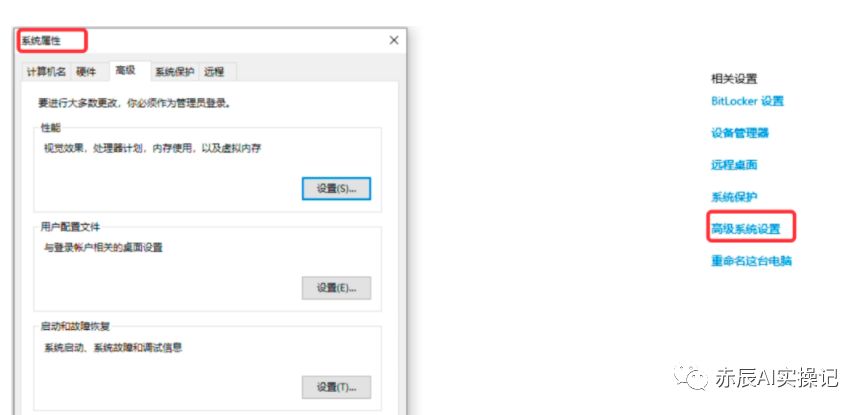

下载完成后,将“FFmpeg”添加到环境变量设置中。在“此电脑”图标上右击并点击“属性”,找到“相关设置”选择“高级系统设置”,将“系统属性”面板打开。

第五步

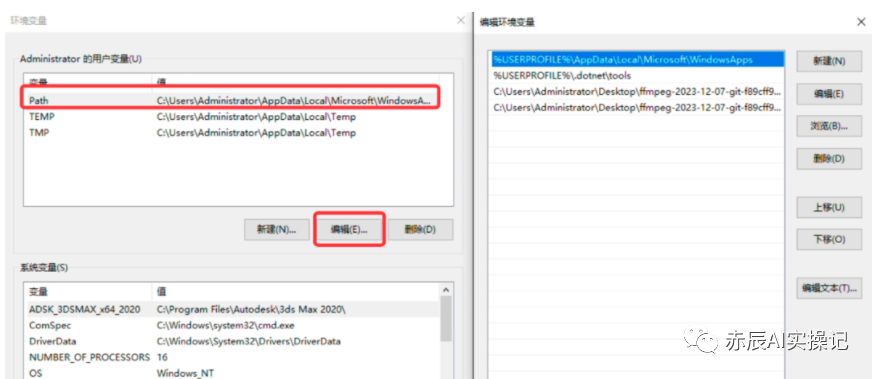

选择下方的“环境变量”,点击环境变量面板,最后在上方的“用户变量”,选择“Path”,且点击“编辑”。

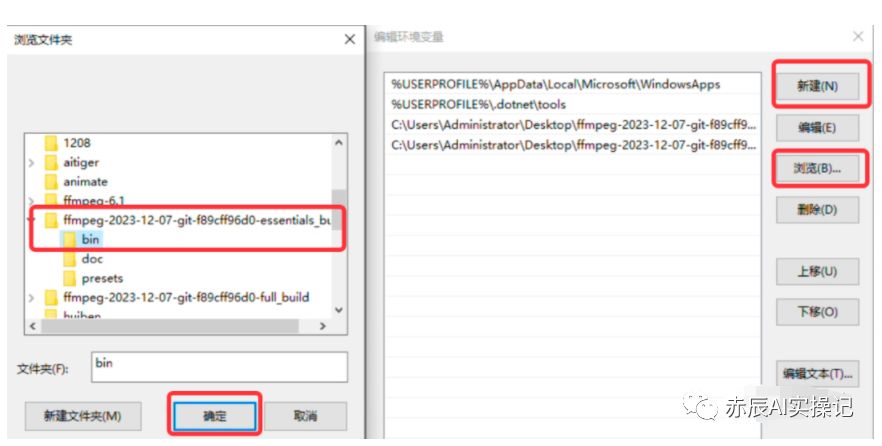

第六步

在“编辑环境变量”面板中,点击“新建”,然后在点击“预览”,找到刚刚下载好并解压好的文件夹下的“bin”文件夹,然后点击“确定”即可。

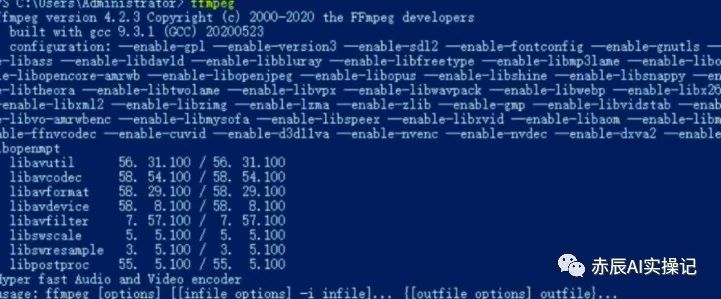

第七步

FFmpeg添加后,选择“终端”,并且执行“ffmpeg”命令。最后界面如果出现以下信息,就代表ffmpeg安装成功啦。

环境设置完成后,接着打开Stable Diffusion安装“Wav2Lip”插件。

3.插件安装

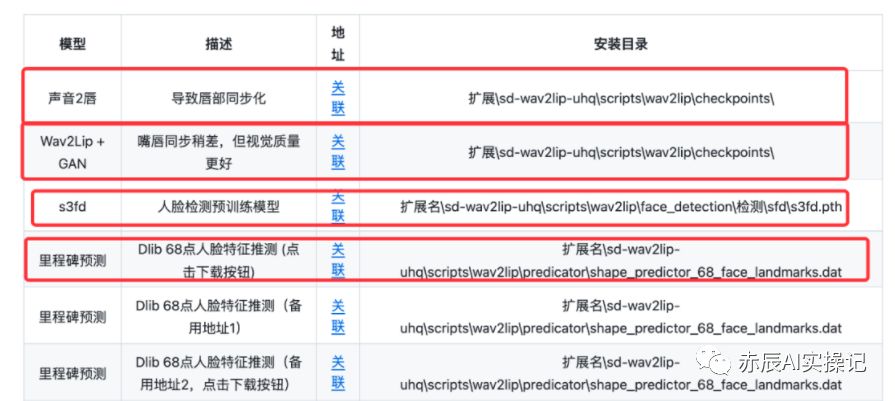

首先在Github下载“Wav2Lip”模型。

Wav2Lip插件地址:

https://github.com/numz/sd-wav2lip-uhq

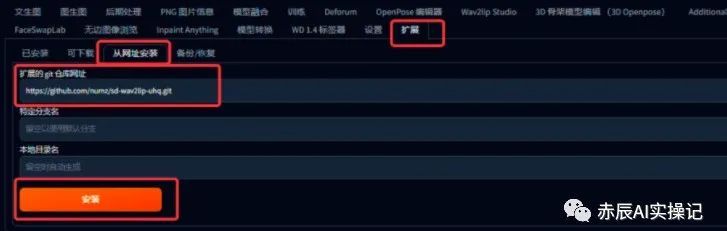

第一步

下载好模型后,在“Stable Diffusion”中选择“扩展”-“从网址安装”,接着将插件的URL复制粘贴在“扩展的git仓库网址”中,最后点击“安装”。

第二步

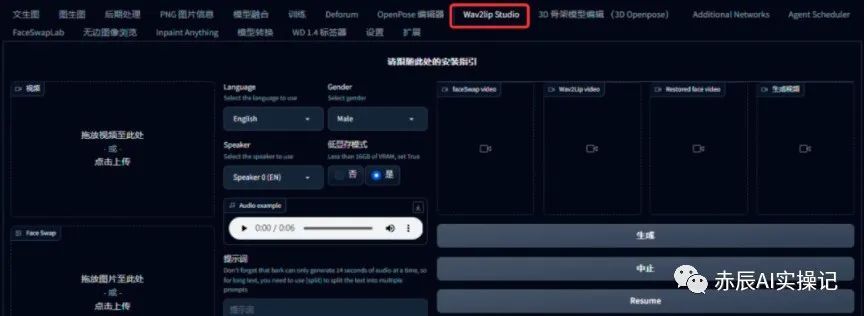

完成插件安装后,先对Stable Diffusion进行关闭,接着将下载好的模型,拉入对应的文件夹中,接着再次打开“Stable Diffusion”,“Wav2Lip”插件就显示在上方啦。

当然!如果像要对视频人物进行“换脸”,那就还得进行安装和下载“FaceSwap”的模型以及环境。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!