AlexNet

发布时间:2023年12月22日

一、AlexNet介绍

1、历史背景

???????AlexNet赢得了2012年ImageNet竞赛的冠军。AlexNet本质上相当于一个更深更大的LeNet,相比于LeNet的主要改进有下面三个:

- 丢弃法:用丢弃法来做正则,在多个全连接层组成的多层感知机里面使用了丢弃法(Dropout)。

- ReLU:将激活函数从LeNet的Sigmoid改成了ReLU,ReLU相对于Sigmoid的梯度更大。

- MaxPooling:将平均池化改成了最大池化,使得输出的值比较大,梯度相对来说就比较大,训练更加容易。

2、AlexNet与LeNet模型对比

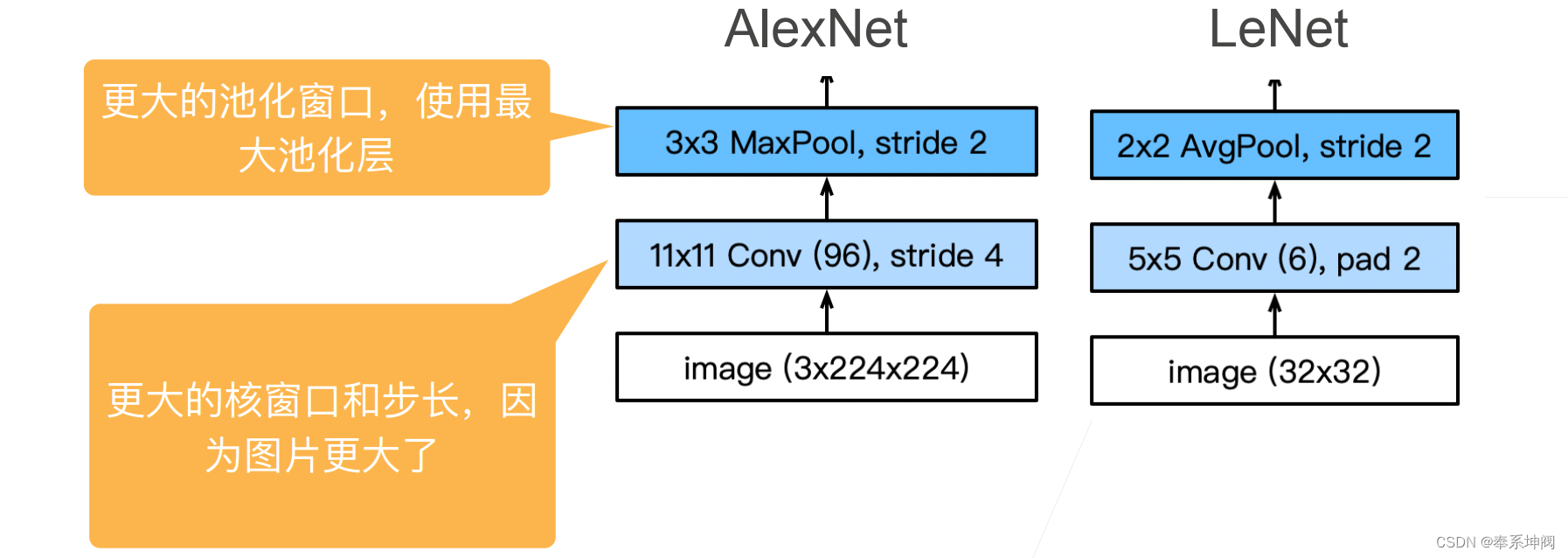

(1)第一层卷积

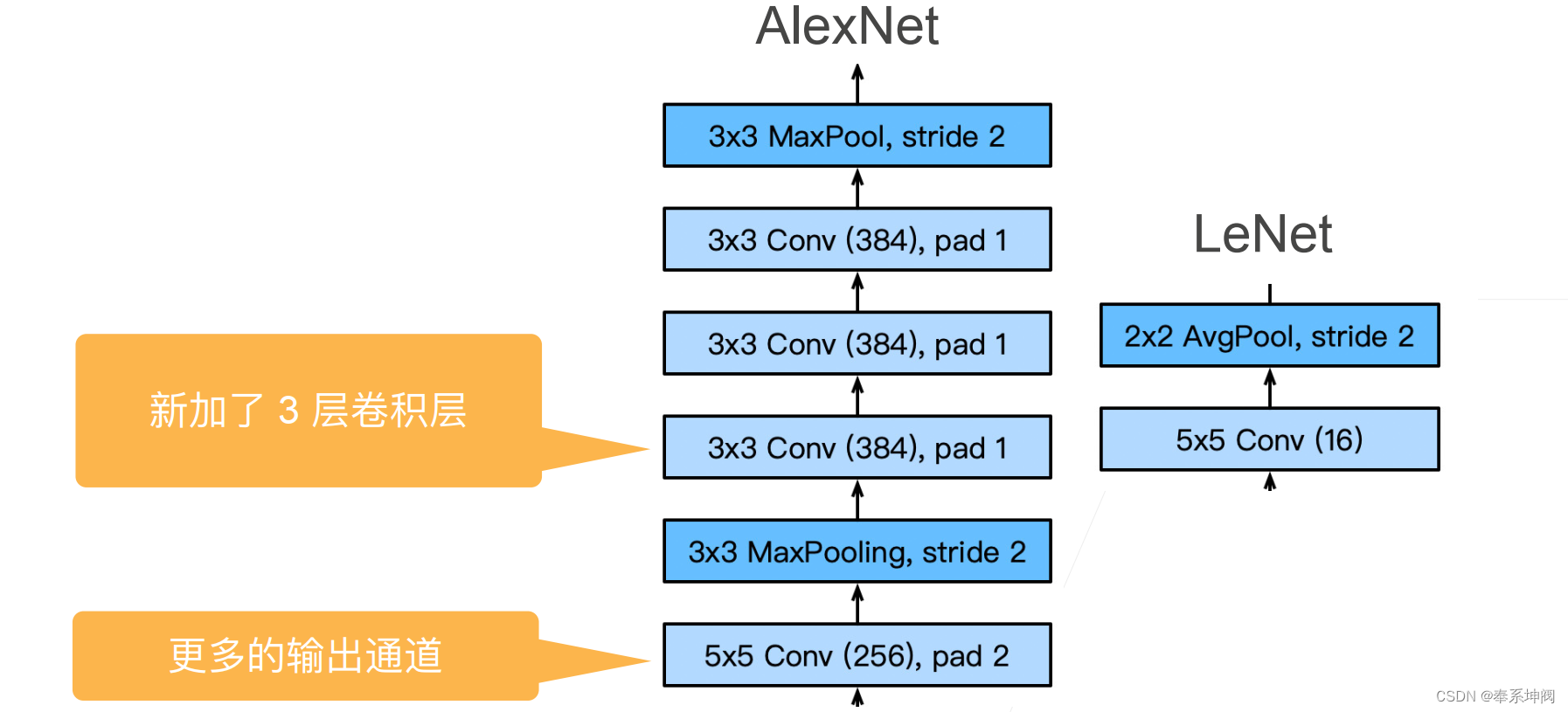

(2)中间卷积层

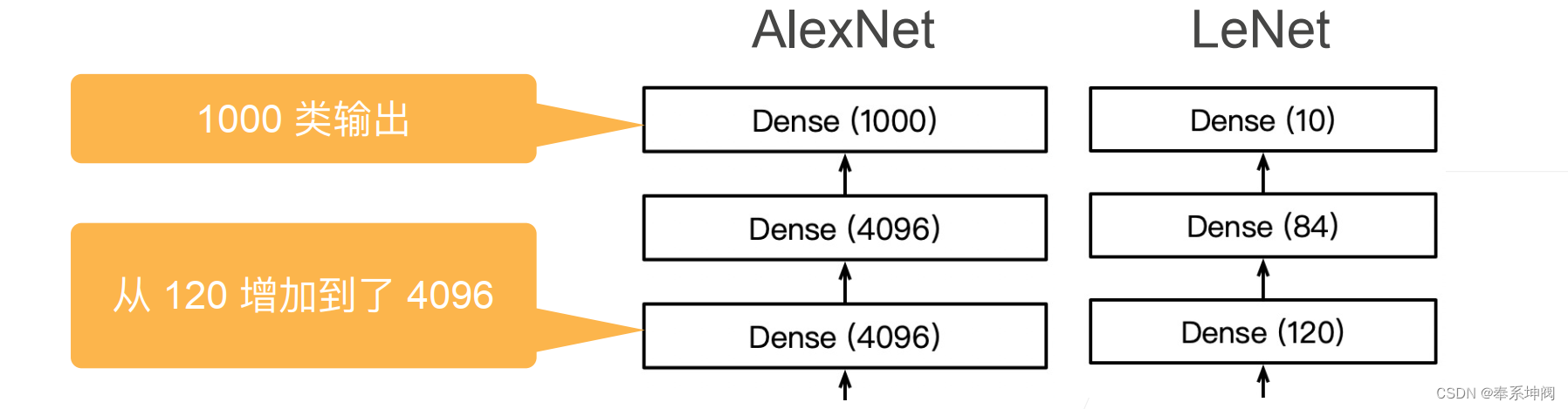

(3)多层感知机

3、AlexNet更多细节

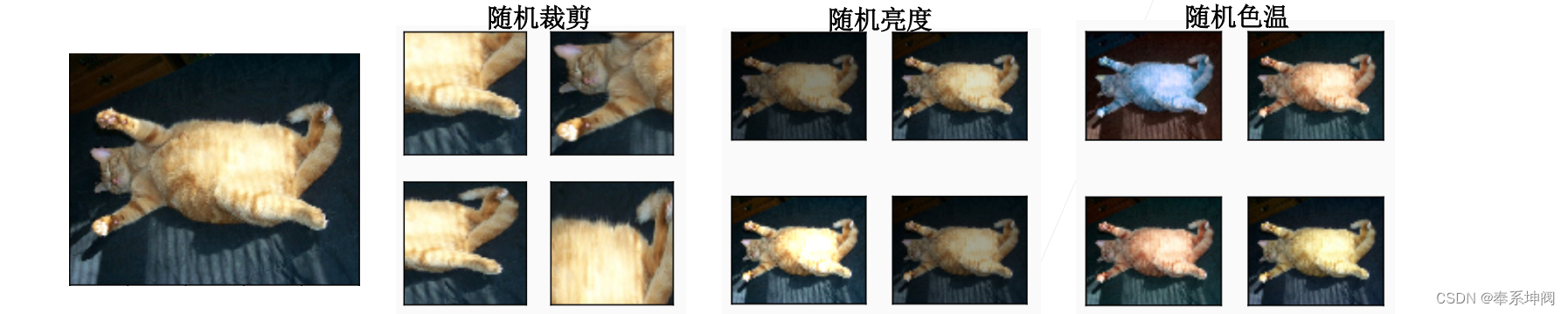

???????数据增强操作对原始图片进行随机裁剪、随机亮度和随机色温,在输入图片中增加大量变种,减小模型的敏感程度,提高鲁棒性。

4、总结

二、代码实现

文章来源:https://blog.csdn.net/m0_56312629/article/details/135141402

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 点赞模块设计 - Redis缓存 + 定时写入数据库实现高性能点赞功能

- 趣味少儿编程:用Scratch开启孩子的创新之旅

- 【硬件安全】硬件安全模块—HSM

- 计算机网络题目复习与解析

- java版微信小程序商城 免 费 搭 建 java版直播商城平台规划及常见的营销模式有哪些?电商源码/小程序/三级分销

- STM32CubeMX+STM32F4系列教程文章汇总贴

- 使用arthas排查请求超时问题

- 管理类联考——英语二——考点+记忆篇——小作文——按行应战

- 微信小程序实战-01翻页时钟-1

- 【Rust】第五节:所有权