Lasso回归(Lasso Regression)

发布时间:2024年01月10日

什么是机器学习

Lasso回归(Lasso Regression),也称为 L1 正则化线性回归,是一种在线性回归模型中加入 L1 正则化项以防止过拟合的方法。与岭回归(Ridge Regression)不同,Lasso回归使用的是参数的绝对值(L1范数)来添加正则化项。

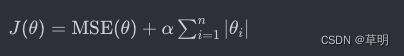

Lasso回归的目标函数可以表示为:

其中:

J(θ)是Lasso回归的目标函数MSE(θ)是均方误差(Mean Squared Error)α是正则化参数θ1, θ2, ... , θn是模型的参数。

与岭回归类似,Lasso回归通过最小化目标函数找到最适合数据的参数。正则化项对模型的参数进行惩罚,使得参数趋向于较小的值,同时也有助于产生稀疏模型,即某些特征的权重为零。

代码示例(使用 Python 和 scikit-learn)

以下是一个使用 scikit-learn 库进行Lasso回归的简单示例:

from sklearn.linear_model import Lasso

from sklearn.preprocessing import StandardScaler

from sklearn.pipeline import Pipeline

import numpy as np

import matplotlib.pyplot as plt

# 生成随机数据

np.random.seed(0)

X = 2 * np.random.rand(100, 1)

y = 4 + 3 * X + np.random.randn(100, 1)

# 创建Lasso回归模型

lasso_model = Pipeline([

('scaler', StandardScaler()), # 特征标准化

('lasso', Lasso(alpha=0.1)) # Lasso回归模型,alpha是正则化强度

])

# 拟合模型

lasso_model.fit(X, y)

# 预测新数据

X_new = np.array([[1.5]])

y_pred = lasso_model.predict(X_new)

print("预测结果:", y_pred[0])

# 绘制散点图和拟合的直线

plt.scatter(X, y, color='blue')

plt.plot(X, lasso_model.predict(X), color='red', linewidth=3)

plt.xlabel("自变量")

plt.ylabel("因变量")

plt.title("Lasso回归")

plt.show()

在这个例子中,我们使用了 scikit-learn 的 Lasso 类来构建 Lasso 回归模型。模型中的 alpha 参数表示正则化强度,你可以根据实际问题调整这个参数。同样,模型包括一个 StandardScaler,用于对输入特征进行标准化。

文章来源:https://blog.csdn.net/galoiszhou/article/details/135494731

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- MATLAB实现图像变换和滤波

- 用23种设计模式打造一个cocos creator的游戏框架----(十八)责任链模式

- Windows内网渗透篇-后门持久化姿势总结

- 几种类型的相互转换

- 如何用GPT快速写完论文?

- MATLAB对话框与菜单设计实验

- 淘宝爬虫评论数据采集的探索之旅

- 网站引导页源码带视频背景源码系统:HTML5开发的引导页 附带完整的搭建教程

- 解决方案 | 合规要求升级,法大大电子签助推企业高质量发展

- 竞赛保研 python+opencv+深度学习实现二维码识别